3次元点群処理の例(Open3D ライブラリ)

1. エグゼクティブサマリー

本記事では,Open3D ライブラリを用いた3次元点群処理の例を8つのパターンで解説する。Open3D は,3次元データの入出力,ダウンサンプリング,外れ値除去,法線推定,ポリゴン変換,セグメンテーション,クラスタリング等の機能を提供するライブラリである。

各パターンは以下の処理を段階的に実装している:

- パターン1:読み込み+表示(基本操作)

- パターン2:読み込み+ダウンサンプリング+表示

- パターン3:読み込み+外れ値除去+表示

- パターン4:読み込み+法線推定+結果表示

- パターン5:読み込み+ポリゴン変換+確認表示

- パターン6:読み込み+Convex Hull+確認表示

- パターン7:読み込み+平面抽出(RANSAC)+確認表示

- パターン8:読み込み+DBSCANクラスタリング+確認表示

各パターンは,室内環境(Redwood,デモデータ,リビングルーム),屋外環境(Eagle彫刻,噴水,Semantic3D 大規模データ),3Dスキャンデータ(Stanford Armadillo,Bunny)等,11種類のデータセットから選択できる。

本記事の8つのコードは,共通部分(import文,データ取得関数,データセット定義,読み込み処理)を統一し,各パターン固有の処理部分との境界を区分している。

- GitHub の Open3D の Web ページ: https://github.com/isl-org/Open3D

- Open3D の Web ページ: http://www.open3d.org/

- Open3D の公式ドキュメント: http://www.open3d.org/docs/release/

2. 前準備(必要ソフトウェアの入手)

ここでは,事前準備について説明する。機械学習や深層学習を行う場合は,NVIDIA CUDA,Visual Studio,Cursor などを追加でインストールする。これらについては別ページ https://www.kkaneko.jp/cc/dev/aiassist.html で解説しているので,必要に応じて参照のこと。

Python 3.12 のインストール(Windows 上) [クリックして展開]

以下のいずれかの方法で Python 3.12 をインストールする。Python がインストール済みの場合,この手順は不要である。

方法1:winget によるインストール

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには,Windows キーまたはスタートメニューから「cmd」と入力し,表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --id Python.Python.3.12 -e --scope machine --silent --accept-source-agreements --accept-package-agreements --override "/quiet InstallAllUsers=1 PrependPath=1 Include_test=0 Include_pip=1 Include_launcher=1 InstallLauncherAllUsers=1 TargetDir=\"C:\Program Files\Python312\""

powershell -Command "$p='C:\Program Files\Python312'; $s=\"$p\Scripts\"; $m=[Environment]::GetEnvironmentVariable('Path','Machine'); if($m -notlike \"*$s*\") { [Environment]::SetEnvironmentVariable('Path', \"$p;$s;$m\", 'Machine') }"--scope machine を指定することで,システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後,コマンドプロンプトを再起動すると PATH が設定される。

方法2:インストーラーによるインストール

- Python 公式サイト(https://www.python.org/downloads/)にアクセスし,「Download Python 3.x.x」ボタンから Windows 用インストーラーをダウンロードする。

- ダウンロードしたインストーラーを実行する。

- 初期画面の下部に表示される「Add python.exe to PATH」にチェックを入れてから「Customize installation」を選択する。このチェックを入れない場合,コマンドプロンプトから

pythonコマンドを実行できない。 - 「Install Python 3.xx for all users」にチェックを入れ,「Install」をクリックする。

インストールの確認

コマンドプロンプトで以下を実行する。

python --versionバージョン番号(例:Python 3.12.x)が表示されればインストールは完了である。「'python' は,内部コマンドまたは外部コマンドとして認識されていません。」と表示される場合は,インストールが完了していない。

AIエディタ Windsurf のインストール(Windows 上) [クリックして展開]

Python プログラムの編集・実行には,AIエディタ Windsurf を使用する。Windsurf がインストール済みの場合,この手順は不要である。

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには,Windows キーまたはスタートメニューから「cmd」と入力し,表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --scope machine --id Codeium.Windsurf -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --custom "/SP- /SUPPRESSMSGBOXES /NORESTART /CLOSEAPPLICATIONS /DIR=""C:\Program Files\Windsurf"" /MERGETASKS=!runcode,addtopath,associatewithfiles,!desktopicon"

powershell -Command "$env:Path=[System.Environment]::GetEnvironmentVariable('Path','Machine')+';'+[System.Environment]::GetEnvironmentVariable('Path','User'); windsurf --install-extension MS-CEINTL.vscode-language-pack-ja --force; windsurf --install-extension ms-python.python --force; windsurf --install-extension Codeium.windsurfPyright --force"--scope machine を指定することで,システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後,コマンドプロンプトを再起動すると PATH が設定される。

【関連する外部ページ】

Windsurf の公式ページ: https://windsurf.com/

Open3D ライブラリのインストール [クリックして展開]

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには,Windows キーまたはスタートメニューから「cmd」と入力し,表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

python -m pip install -U open3d numpy pandas py7zr matplotlib3. 実行のための準備とその確認手順(Windows 前提)

3.1 プログラムファイルの準備

第5章に掲載する8つのソースコードから,実行するパターンを1つ選択し,テキストエディタ(メモ帳,Windsurf 等)に貼り付け,open3d_demo.py として保存する(文字コード:UTF-8)。

3.2 実行コマンド

コマンドプロンプトでファイルの保存先ディレクトリに移動し,以下を実行する。

python open3d_demo.py実行すると,データセット選択画面が表示される。11種類のデータセットから番号(1〜9,A,B)を入力して選択する。

3.3 動作確認チェックリスト

| 確認項目 | 期待される結果 |

|---|---|

| プログラム起動時 | データセット選択画面が表示され,11種類の選択肢が番号付きで表示される |

| データセット番号入力後 | 選択したデータの読み込みが開始され,点数が表示される |

| 処理完了後 | 3D可視化ウィンドウが開き,マウス操作で視点変更ができる |

| 大規模データ選択時 | ダウンロード・解凍メッセージが表示され,2回目以降はキャッシュから読み込まれる |

4. 概要・使い方・実行上の注意

Open3D ライブラリの主要機能

- データ入出力:

o3d.io.read_point_cloud/write_point_cloudはファイル拡張子から形式を判別し,PLY・PCD・XYZ・XYZN・XYZRGB・PTS 等の形式に対応する(LAS 形式は laspy 等の外部ライブラリが必要)。 - ダウンサンプリング:

voxel_down_sample(voxel_size):空間を一辺voxel_sizeのボクセルで分割し,各ボクセル内の点の座標平均を代表点とすることで空間的に均一な点群を得る。random_down_sample(sampling_ratio):指定比率でランダムに点を選択する。

- 外れ値除去:

remove_statistical_outlier(nb_neighbors, std_ratio):各点から近傍nb_neighbors点までの平均距離を求め,その分布において標準偏差のstd_ratio倍を超える点を除去する。remove_radius_outlier(nb_points, radius):半径radius内の近傍点数がnb_points未満の点を除去する。

- 法線推定:

estimate_normals(search_param=KDTreeSearchParamHybrid(radius, max_nn))は各点の近傍点群に対して主成分分析(共分散行列の固有値分解)を適用し,最小固有値に対応する固有ベクトルを法線方向として推定する。法線の向きはorient_normals_to_align_with_direction,orient_normals_towards_camera_location,orient_normals_consistent_tangent_plane等で統一する必要がある。 - ポリゴン変換:

TriangleMesh.create_from_point_cloud_alpha_shape(pcd, alpha):アルファシェイプにより凹形状を含む外形を再現するメッシュを生成する(法線不要)。TriangleMesh.create_from_point_cloud_ball_pivoting(pcd, radii):指定した複数半径のボールを点群上で回転させ,接触する3点から三角形を逐次生成するボールピボッティング法(法線必要,radiiはDoubleVectorで指定)。TriangleMesh.create_from_point_cloud_poisson(pcd, depth):ポアソン再構成により水密なメッシュを生成する(法線必要,depthが大きいほど解像度が高い)。

- その他:

segment_plane:RANSAC ベースの平面検出(平面方程式の係数とインライア点インデックスを返す)cluster_dbscan:DBSCAN 密度ベースクラスタリング(epsとmin_pointsで制御,ラベル-1はノイズを示す)compute_convex_hull:Qhull ベースの実装(全点を包含する最小凸多面体をTriangleMeshとして返す)registration_icp:ICP による精密位置合わせregistration_ransac_based_on_feature_matching:FPFH 特徴量ベースのグローバル位置合わせdraw_geometries:3D 表示(色・法線・視点の描画オプション付き)

使用データ

以下の11種類のデータセットから選択できる。

キー 名称 環境 特徴 1 室内Redwood 室内 PCD・RGB色付き 2 室内デモ 室内 PCD・切り出しデモ 3 テーブルシーン 室内卓上 PCD・Sick LMS400 LiDAR 4 リビングルーム 室内 PLY・Redwood RGB-D 5 Eagle屋外彫刻 屋外 PLY・実計測 6 屋外噴水 屋外 RGB-D生成・ETH 7 Armadillo スキャン Stanford 3Dスキャン 8 Stanford Bunny スキャン Stanford 3Dスキャン 9 Semantic3D 教会 屋外 静的LiDAR・bildstein A Semantic3D 噴水広場 屋外 静的LiDAR・untermaederbrunnen B Semantic3D 大聖堂 屋外 静的LiDAR・domfountain

実行上の注意

- Semantic3D データセット(9,A,B)は大規模データ(数百MB〜1GB超)であり,初回実行時にダウンロード・解凍に時間がかかる。ダウンロードされたファイルは

~/.cache/o3d_demoにキャッシュされる。 - 各パターンは独立して動作する。

- 3D可視化ウィンドウでは,マウス操作で視点を変更できる(左ドラッグ:回転,右ドラッグ:並進,ホイール:ズーム)。

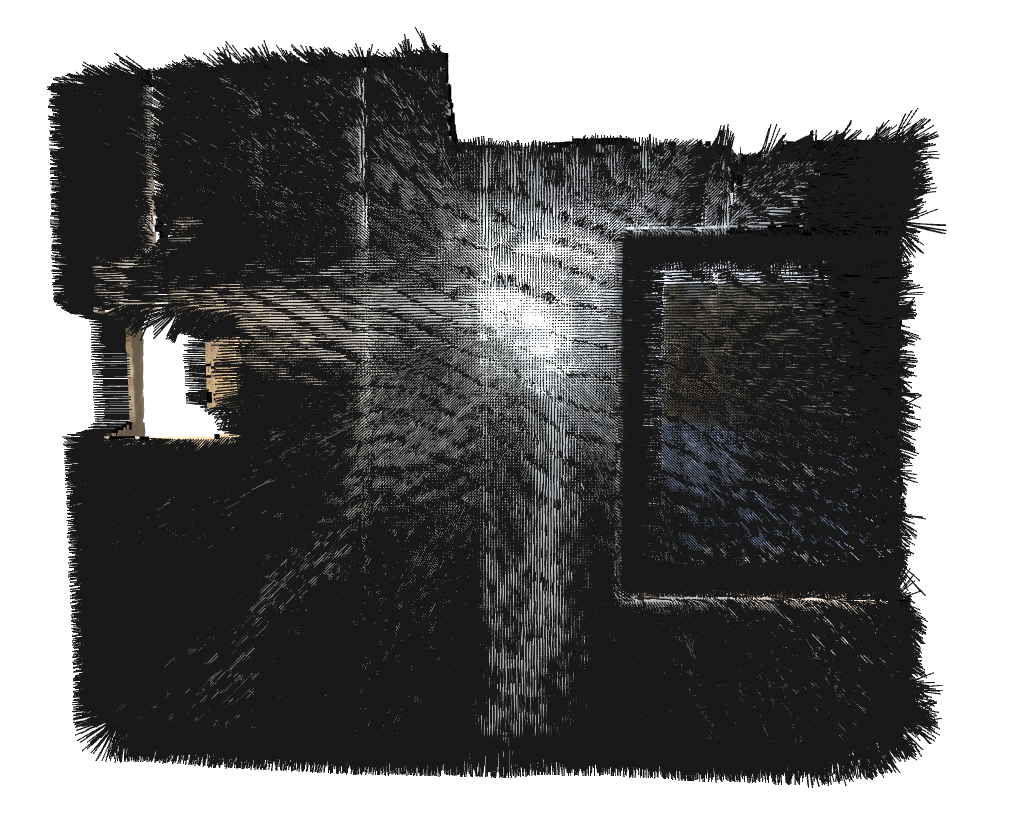

- パターン4では,

point_show_normal=Trueオプションにより法線ベクトルが可視化される。 - パターン5では,Alpha Shape,Ball Pivoting,Poisson の3つのメッシュ変換結果が順次表示される。

- パターン8では

matplotlibを使用する(色付けのためのカラーマップ取得に利用)。

5. ソースコード

以下に8つのパターンのソースコードを掲載する。各パターンは独立して動作する。共通部分は統一されており,パターン固有の処理部分との境界を区分している。

パターン1:読み込み+表示

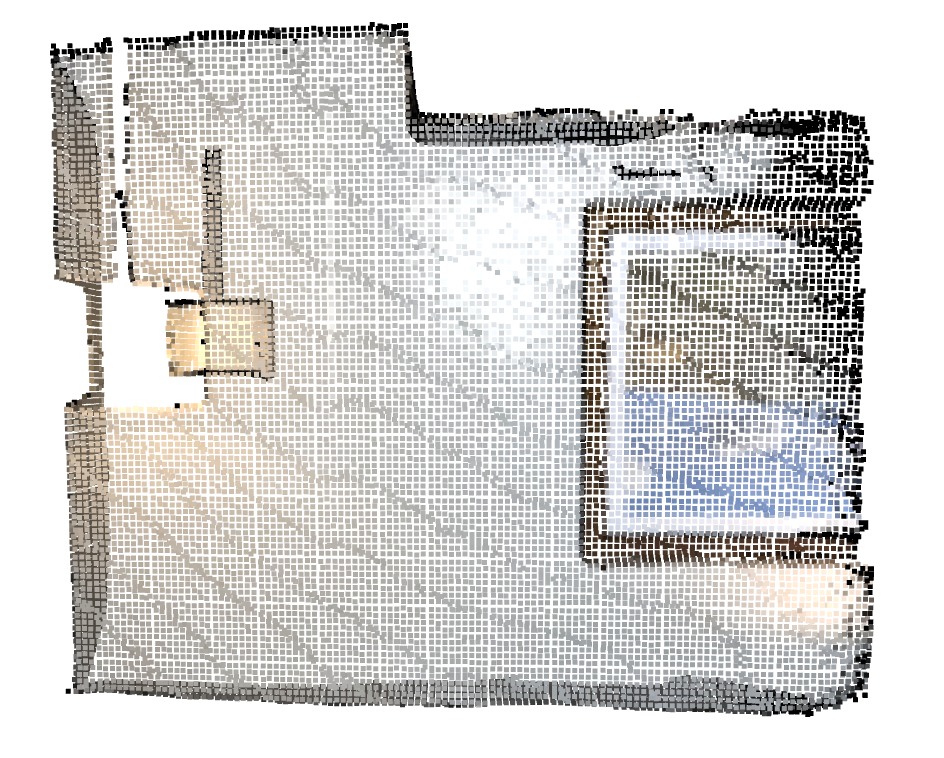

基本となるパターンである。データセットを読み込み,3D可視化ウィンドウで表示する。

# ════════════════════════════════════════

# パターン1:読み込み+表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン1固有の処理:表示のみ │

# └────────────────────────────────────┘

o3d.visualization.draw_geometries([pcd], window_name="元の点群")

パターン2:読み込み+ダウンサンプリング+表示

ボクセルダウンサンプリングにより点群を間引き,処理を高速化する。

# ════════════════════════════════════════

# パターン2:読み込み+ダウンサンプリング+表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン2固有の処理:ダウンサンプリング │

# └────────────────────────────────────┘

pcd = pcd.voxel_down_sample(voxel_size)

print(f"ダウンサンプリング後: {len(pcd.points)} 点")

o3d.visualization.draw_geometries([pcd], window_name="ダウンサンプリング後")

パターン3:読み込み+外れ値除去+表示

統計的外れ値除去により,ノイズ点を除去する。

# ════════════════════════════════════════

# パターン3:読み込み+外れ値除去+表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン3固有の処理:外れ値除去 │

# └────────────────────────────────────┘

pcd, _ = pcd.remove_statistical_outlier(nb_neighbors=20, std_ratio=2.0)

print(f"外れ値除去後: {len(pcd.points)} 点")

o3d.visualization.draw_geometries([pcd], window_name="外れ値除去後")

パターン4:読み込み+法線推定+結果表示

主成分分析(共分散行列の固有値分解)により各点の法線方向を推定し,可視化する。法線はポリゴン変換(パターン5)の前処理として用いる。

# ════════════════════════════════════════

# パターン4:読み込み+法線推定+結果表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン4固有の処理:法線推定 │

# └────────────────────────────────────┘

pcd.estimate_normals(o3d.geometry.KDTreeSearchParamHybrid(radius=voxel_size * 5, max_nn=30))

pcd.orient_normals_consistent_tangent_plane(100)

o3d.visualization.draw_geometries([pcd], window_name="法線推定後", point_show_normal=True)

パターン5:読み込み+ポリゴン変換+確認表示

点群からポリゴンメッシュを生成する。Alpha Shape,Ball Pivoting,Poisson の3つの手法を順次実行し,各手法の結果を比較できる。

# ════════════════════════════════════════

# パターン5:読み込み+ポリゴン変換+確認表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────────────────┐

# │ パターン5固有の処理:前処理+ポリゴン変換(3手法) │

# └────────────────────────────────────────────────┘

pcd = pcd.voxel_down_sample(voxel_size)

pcd, _ = pcd.remove_statistical_outlier(nb_neighbors=20, std_ratio=2.0)

pcd.estimate_normals(o3d.geometry.KDTreeSearchParamHybrid(radius=voxel_size * 5, max_nn=30))

pcd.orient_normals_consistent_tangent_plane(100)

def transfer_colors(src, mesh):

if not src.has_colors():

return

kd = o3d.geometry.KDTreeFlann(src)

cols = np.asarray(src.colors)

vcols = np.array([cols[kd.search_knn_vector_3d(v, 1)[1][0]]

for v in np.asarray(mesh.vertices)])

mesh.vertex_colors = o3d.utility.Vector3dVector(vcols)

mesh_a = o3d.geometry.TriangleMesh.create_from_point_cloud_alpha_shape(pcd, alpha=voxel_size * 5)

mesh_a.compute_vertex_normals()

o3d.visualization.draw_geometries([mesh_a], window_name="Alpha Shape")

radii = o3d.utility.DoubleVector([voxel_size * 2.5, voxel_size * 5, voxel_size * 10])

mesh_b = o3d.geometry.TriangleMesh.create_from_point_cloud_ball_pivoting(pcd, radii)

mesh_b.compute_vertex_normals()

o3d.visualization.draw_geometries([mesh_b], window_name="Ball Pivoting")

mesh_p, _ = o3d.geometry.TriangleMesh.create_from_point_cloud_poisson(pcd, depth=9)

mesh_p.compute_vertex_normals()

transfer_colors(pcd, mesh_p)

o3d.visualization.draw_geometries([mesh_p], window_name="Poisson (depth=9)")

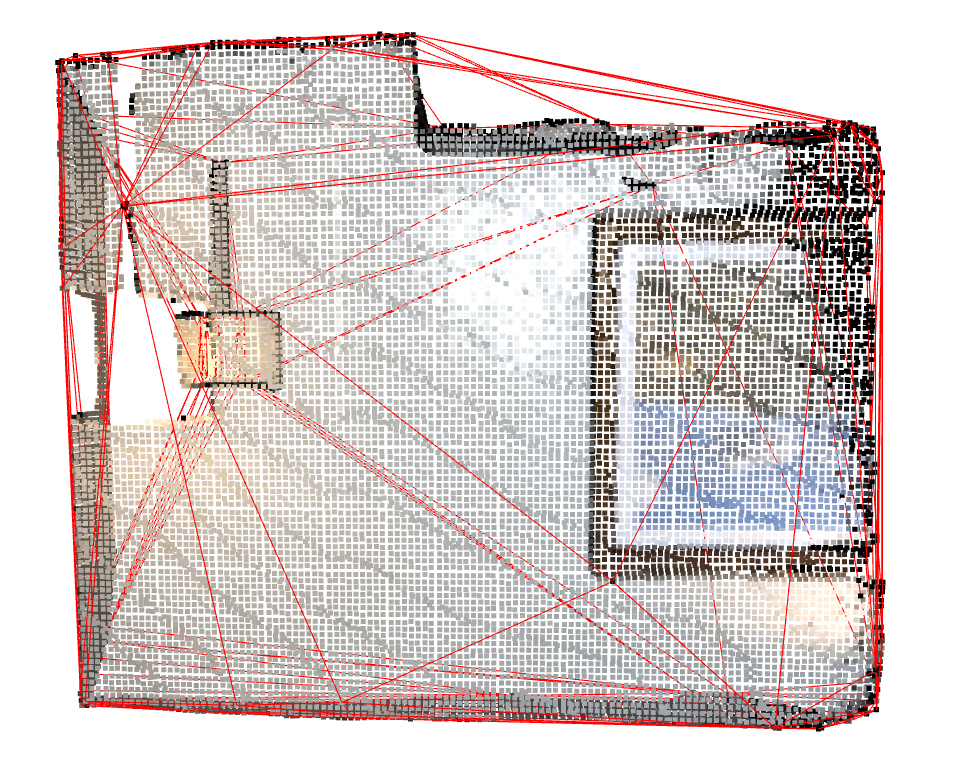

パターン6:読み込み+Convex Hull+確認表示

Qhull アルゴリズムにより点群の凸包(全点を包含する最小凸多面体)を計算し,赤色のワイヤーフレームで表示する。

# ════════════════════════════════════════

# パターン6:読み込み+Convex Hull+確認表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン6固有の処理:Convex Hull │

# └────────────────────────────────────┘

pcd = pcd.voxel_down_sample(voxel_size)

pcd, _ = pcd.remove_statistical_outlier(nb_neighbors=20, std_ratio=2.0)

hull, _ = pcd.compute_convex_hull()

hull_ls = o3d.geometry.LineSet.create_from_triangle_mesh(hull)

hull_ls.paint_uniform_color((1, 0, 0))

print(f"Convex Hull: {len(hull.vertices)} 頂点, {len(hull.triangles)} 三角形")

o3d.visualization.draw_geometries([pcd, hull_ls], window_name="Convex Hull")

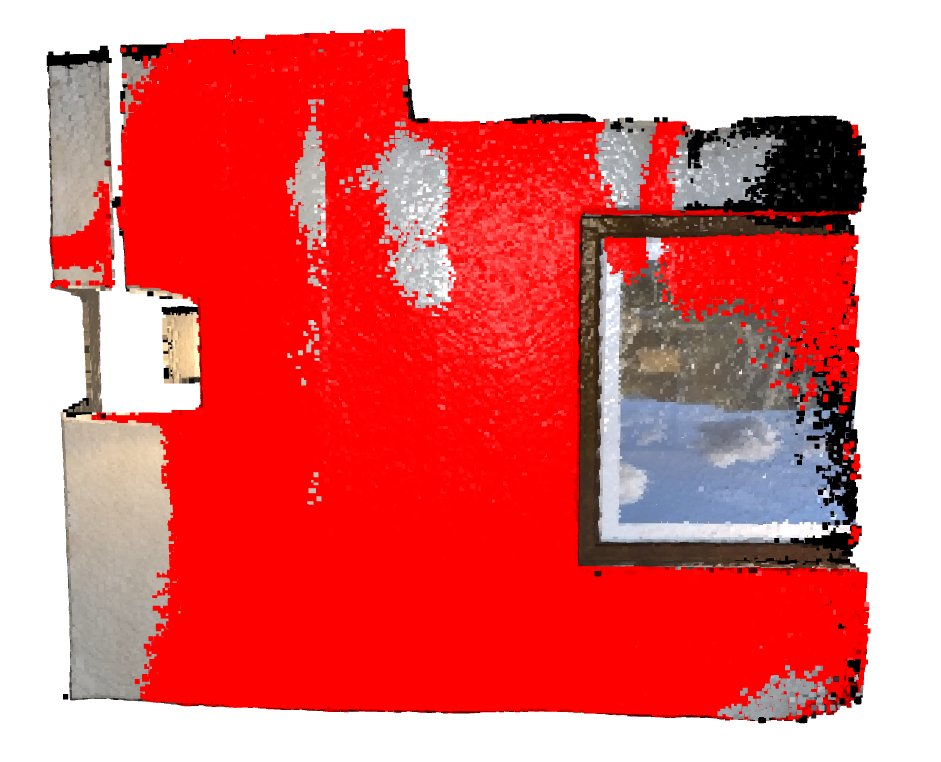

パターン7:読み込み+平面抽出(RANSAC)+確認表示

RANSAC アルゴリズムにより点群から平面を検出し,平面内点(赤色)と平面外点(元の色)を分離表示する。

# ════════════════════════════════════════

# パターン7:読み込み+平面抽出(RANSAC)+確認表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン7固有の処理:平面抽出(RANSAC)│

# └────────────────────────────────────┘

plane_model, inliers = pcd.segment_plane(

distance_threshold=voxel_size * 0.5, ransac_n=3, num_iterations=1000)

[a, b, c, d] = plane_model

print(f"平面方程式: {a:.2f}x + {b:.2f}y + {c:.2f}z + {d:.2f} = 0")

print(f"平面内点数: {len(inliers)}, 平面外点数: {len(pcd.points) - len(inliers)}")

inlier_cloud = pcd.select_by_index(inliers)

inlier_cloud.paint_uniform_color([1.0, 0, 0])

outlier_cloud = pcd.select_by_index(inliers, invert=True)

o3d.visualization.draw_geometries([inlier_cloud, outlier_cloud], window_name="平面抽出(RANSAC)")

パターン8:読み込み+DBSCANクラスタリング+確認表示

DBSCAN 密度ベースクラスタリングにより,点群を複数のクラスタに分割し,各クラスタを異なる色で表示する。ノイズ点は黒色で表示される。

# ════════════════════════════════════════

# パターン8:読み込み+DBSCANクラスタリング+確認表示

# ════════════════════════════════════════

# ┌────────────────────────────────────┐

# │ 共通部分:ライブラリインポート │

# └────────────────────────────────────┘

import open3d as o3d, os, numpy as np, urllib.request as ur, pandas as pd, matplotlib.pyplot as plt

# ┌────────────────────────────────────┐

# │ 共通部分:キャッシュディレクトリ設定 │

# └────────────────────────────────────┘

CACHE = os.path.expanduser("~/.cache/o3d_demo")

os.makedirs(CACHE, exist_ok=True)

# ┌────────────────────────────────────┐

# │ 共通部分:データ取得関数 │

# └────────────────────────────────────┘

def fetch(url, fname):

path = os.path.join(CACHE, fname)

if not os.path.exists(path):

print(f" ダウンロード中: {fname} ...")

ur.urlretrieve(url, path)

return path

def load_fountain():

d = o3d.data.SampleFountainRGBDImages()

color = o3d.io.read_image(d.color_paths[0])

depth = o3d.io.read_image(d.depth_paths[0])

rgbd = o3d.geometry.RGBDImage.create_from_color_and_depth(

color, depth, depth_trunc=4.0, convert_rgb_to_intensity=False)

# PrimeSenseカメラの内部パラメータを使用

intrinsic = o3d.camera.PinholeCameraIntrinsic(

o3d.camera.PinholeCameraIntrinsicParameters.PrimeSenseDefault)

return o3d.geometry.PointCloud.create_from_rgbd_image(rgbd, intrinsic)

S3D = "https://share.phys.ethz.ch/~pf/semantic3d/data/point-clouds/training1/"

def load_semantic3d(url, fname):

import py7zr

arc = fetch(url, fname)

txt = os.path.join(CACHE, fname.replace(".7z", ".txt"))

if not os.path.exists(txt):

print(f" 解凍中: {fname} ...")

with py7zr.SevenZipFile(arc, "r") as z:

z.extractall(CACHE)

print(f" 読み込み中(大規模データ)...")

df = pd.read_csv(txt, header=None, sep=r"\s+", dtype=np.float32)

pcd = o3d.geometry.PointCloud()

pcd.points = o3d.utility.Vector3dVector(df.iloc[:, :3].values)

pcd.colors = o3d.utility.Vector3dVector(df.iloc[:, 4:7].values / 255.0)

return pcd

# ┌────────────────────────────────────┐

# │ 共通部分:データセット定義 │

# └────────────────────────────────────┘

PCL = "https://raw.githubusercontent.com/PointCloudLibrary/data/master/"

DATASETS = {

"1": ("室内Redwood (PCD・RGB色付き)", lambda: o3d.io.read_point_cloud(o3d.data.PCDPointCloud().path), 0.02),

"2": ("室内デモ (PCD・切り出しデモ)", lambda: o3d.io.read_point_cloud(o3d.data.DemoCropPointCloud().point_cloud_path), 0.02),

"3": ("テーブルシーン (PCD・Sick LMS400 LiDAR)", lambda: o3d.io.read_point_cloud(fetch(PCL + "tutorials/table_scene_lms400.pcd", "table_lms400.pcd")), 0.005),

"4": ("リビングルーム (PLY・Redwood RGB-D)", lambda: o3d.io.read_point_cloud(o3d.data.LivingRoomPointClouds().paths[0]), 0.05),

"5": ("Eagle屋外彫刻 (PLY・実計測)", lambda: o3d.io.read_point_cloud(o3d.data.EaglePointCloud().path), 0.005),

"6": ("屋外噴水 (RGB-D生成・ETH)", lambda: load_fountain(), 0.02),

"7": ("Armadillo (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.ArmadilloMesh().path).sample_points_poisson_disk(50000), 2.0),

"8": ("Stanford Bunny (Stanford 3Dスキャン)", lambda: o3d.io.read_triangle_mesh(o3d.data.BunnyMesh().path).sample_points_poisson_disk(50000), 0.002),

"9": ("Semantic3D 教会 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "bildstein_station1_xyz_intensity_rgb.7z", "bildstein_station1_xyz_intensity_rgb.7z"), 0.1),

"A": ("Semantic3D 噴水広場 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "untermaederbrunnen_station1_xyz_intensity_rgb.7z", "untermaederbrunnen_station1_xyz_intensity_rgb.7z"), 0.1),

"B": ("Semantic3D 大聖堂 (屋外・静的LiDAR)", lambda: load_semantic3d(S3D + "domfountain_station3_xyz_intensity_rgb.7z", "domfountain_station3_xyz_intensity_rgb.7z"), 0.1),

}

# ┌────────────────────────────────────┐

# │ 共通部分:データセット選択と読み込み │

# └────────────────────────────────────┘

print("データセット選択:\n" + "\n".join(f" {k}: {v[0]}" for k, v in DATASETS.items()))

_, loader, voxel_size = DATASETS[input("番号: ").strip()]

pcd = loader()

print(f"読み込み完了: {len(pcd.points)} 点")

# ┌────────────────────────────────────┐

# │ パターン8固有の処理:DBSCANクラスタリング │

# └────────────────────────────────────┘

pcd = pcd.voxel_down_sample(voxel_size)

pcd, _ = pcd.remove_statistical_outlier(nb_neighbors=20, std_ratio=2.0)

labels = np.array(pcd.cluster_dbscan(eps=voxel_size * 10, min_points=10, print_progress=True))

max_label = labels.max()

print(f"クラスタ数: {max_label + 1} (ノイズ点: {(labels < 0).sum()} 点)")

colors = plt.get_cmap("tab20")(labels / (max_label if max_label > 0 else 1))

colors[labels < 0] = 0

pcd.colors = o3d.utility.Vector3dVector(colors[:, :3])

o3d.visualization.draw_geometries([pcd], window_name="DBSCANクラスタリング")

6. まとめ

Open3D ライブラリの特徴

Open3D は,ファイル拡張子から形式を判別する入出力機能により,多様な3次元データの読み書きに対応する。

ダウンサンプリングと外れ値除去

ボクセルダウンサンプリングは空間的に均一な点群を得る手法である。統計的外れ値除去は近傍点との平均距離の分布に基づいて異常点を除去する。

法線推定とポリゴン変換

法線推定は主成分分析(共分散行列の固有値分解)により各点の法線方向を推定する。法線情報を利用することで,点群からポリゴンメッシュを生成できる。

セグメンテーションとクラスタリング

RANSAC ベースの平面検出により平面構造を抽出できる。DBSCAN 密度ベースクラスタリングは密度の高い領域をクラスタとして検出する。

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)