OpenCV でビデオのフレーム間差分,トラッキングビジョン,オプティカルフロー(Python を使用)

1. エグゼクティブサマリー

OpenCV と Python を使用して,ビデオのフレーム間差分,トラッキングビジョン,オプティカルフロー(Farneback の方法,DIS optical flow),フレーム間差分による動体検出(二値化)を実現するプログラムを解説する.各プログラムは動画ファイルとパソコン接続ビデオカメラの両方に対応している.

本記事で扱う内容は以下のとおりである.

- 動画ファイルの表示

- 連続フレームの差分表示(フレーム間差分)

- トラッキングビジョン(Shi-Tomasi の手法による追跡用の点の抽出)

- オプティカルフロー(Farneback の方法による動きの情報の抽出)

- DIS optical flow

- フレーム間差分による動体検出(二値化)

- OpenCV の公式ページ: https://opencv.org

- GitHub の OpenCV のページ: https://github.com/opencv/opencv/releases

【サイト内の関連ページ】

- OpenCV について [PDF] , [パワーポイント]

- OpenCVとPythonを活用した画像・ビデオ処理プログラム: 別ページ »

2. 前準備(必要ソフトウェアの入手)

ここでは、最低限の事前準備について説明する。機械学習や深層学習を行う場合は、NVIDIA CUDA、Visual Studio、Cursorなどを追加でインストールすると便利である。これらについては別ページ https://www.kkaneko.jp/cc/dev/aiassist.htmlで詳しく解説しているので、必要に応じて参照してください。

Python 3.12 のインストール(Windows 上) [クリックして展開]

以下のいずれかの方法で Python 3.12 をインストールする。Python がインストール済みの場合、この手順は不要である。

方法1:winget によるインストール

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --id Python.Python.3.12 -e --scope machine --silent --accept-source-agreements --accept-package-agreements --override "/quiet InstallAllUsers=1 PrependPath=1 Include_test=0 Include_pip=1 Include_launcher=1 InstallLauncherAllUsers=1 TargetDir=\"C:\Program Files\Python312\""

powershell -Command "$p='C:\Program Files\Python312'; $s=\"$p\Scripts\"; $m=[Environment]::GetEnvironmentVariable('Path','Machine'); if($m -notlike \"*$s*\") { [Environment]::SetEnvironmentVariable('Path', \"$p;$s;$m\", 'Machine') }"--scope machine を指定することで、システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後、コマンドプロンプトを再起動すると PATH が自動的に設定される。

方法2:インストーラーによるインストール

- Python 公式サイト(https://www.python.org/downloads/)にアクセスし、「Download Python 3.x.x」ボタンから Windows 用インストーラーをダウンロードする。

- ダウンロードしたインストーラーを実行する。

- 初期画面の下部に表示される「Add python.exe to PATH」に必ずチェックを入れてから「Customize installation」を選択する。このチェックを入れ忘れると、コマンドプロンプトから

pythonコマンドを実行できない。 - 「Install Python 3.xx for all users」にチェックを入れ、「Install」をクリックする。

インストールの確認

コマンドプロンプトで以下を実行する。

python --versionバージョン番号(例:Python 3.12.x)が表示されればインストール成功である。「'python' は、内部コマンドまたは外部コマンドとして認識されていません。」と表示される場合は、インストールが正常に完了していない。

AIエディタ Windsurf のインストール(Windows 上) [クリックして展開]

Pythonプログラムの編集・実行には、AIエディタの利用を推奨する。ここでは、Windsurfのインストールを説明する。Windsurf がインストール済みの場合、この手順は不要である。

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --scope machine --id Codeium.Windsurf -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --custom "/SP- /SUPPRESSMSGBOXES /NORESTART /CLOSEAPPLICATIONS /DIR=""C:\Program Files\Windsurf"" /MERGETASKS=!runcode,addtopath,associatewithfiles,!desktopicon"

powershell -Command "$env:Path=[System.Environment]::GetEnvironmentVariable('Path','Machine')+';'+[System.Environment]::GetEnvironmentVariable('Path','User'); windsurf --install-extension MS-CEINTL.vscode-language-pack-ja --force; windsurf --install-extension ms-python.python --force; windsurf --install-extension Codeium.windsurfPyright --force"--scope machine を指定することで、システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後、コマンドプロンプトを再起動すると PATH が自動的に設定される。

【関連する外部ページ】

Windsurf の公式ページ: https://windsurf.com/

OpenCV ライブラリのインストール [クリックして展開]

Python で OpenCV を使用するためのライブラリである.

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

python -m pip install -U opencv-python opencv-contrib-python

3. 実行のための準備とその確認手順(Windows 前提)

3.1 プログラムファイルの準備

第5章のソースコードをテキストエディタ(メモ帳,Windsurf 等)に貼り付け実行する(文字コード:UTF-8).

3.2 実行コマンド

コマンドプロンプトでファイルの保存先ディレクトリに移動し,以下のように実行する(例:動画ファイルの表示).

python video_play.py他のプログラムも同様に,対応するファイル名を指定して実行する.

3.3 動作確認チェックリスト

| 確認項目 | 期待される結果 |

|---|---|

| 動画ファイルの表示プログラム起動時 | ウインドウが開き,動画が1フレームずつ表示される(早送りに見えるのは正常動作) |

| ビデオカメラのプログラム起動時 | ウインドウが開き,カメラ映像がリアルタイムで表示される |

| 「q」キーの押下 | ウインドウが閉じ,プログラムが終了する |

| オプティカルフローのプログラム起動時 | 元映像ウインドウ(source)とフロー表示ウインドウ(flow)の2つが開く |

4. 概要・使い方・実行上の注意

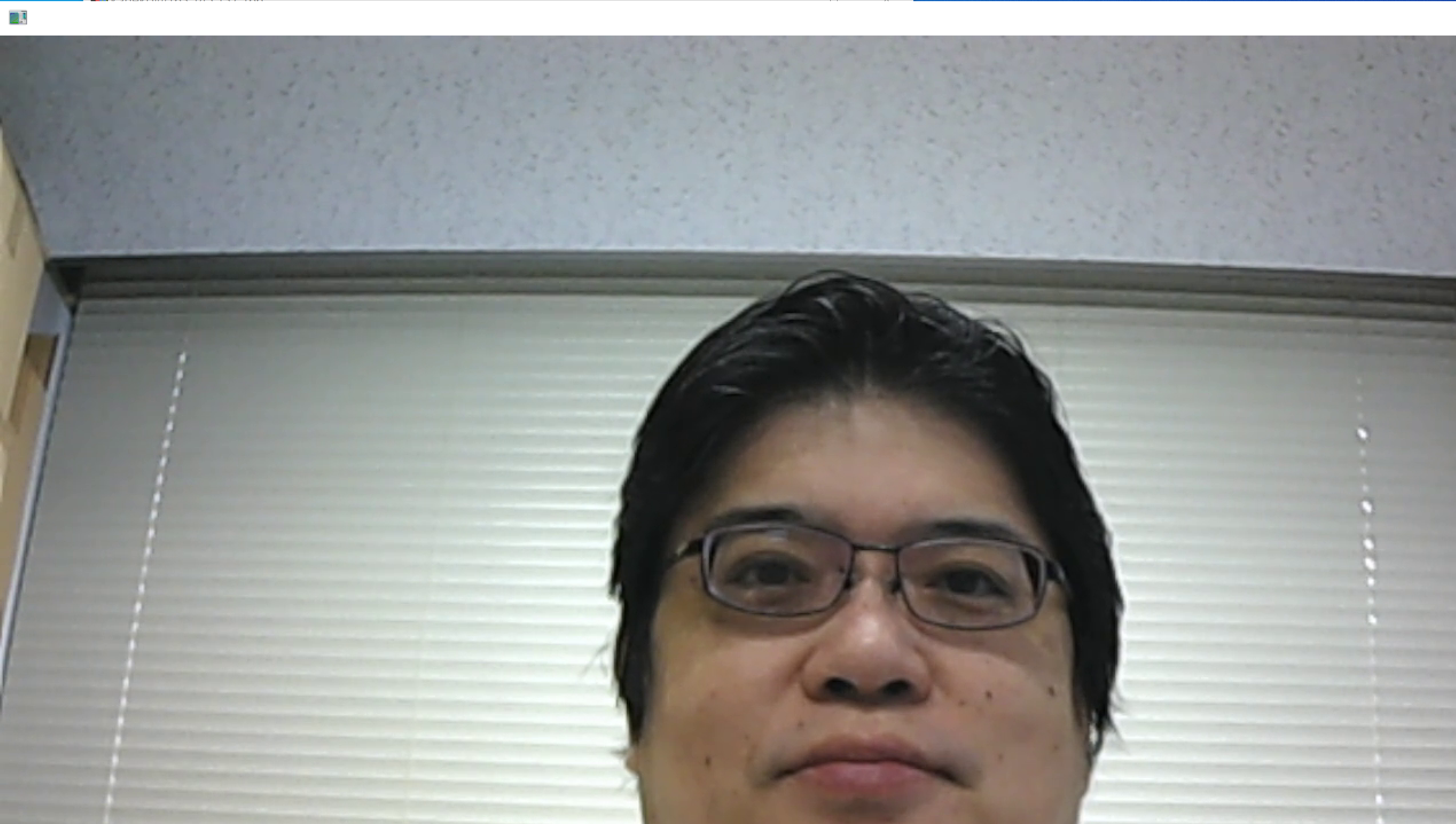

使用する動画ファイルの準備

使用する動画ファイル:sample1.mp4

ダウンロード方法:コマンドプロンプトを管理者として開き,次のコマンドを実行する.

mkdir c:\image

cd c:\image

curl -O https://www.kkaneko.jp/sample/face/sample1.mp4

上のコマンドが実行できないときは, sample1.mp4 をダウンロードし,C:/image に置く.

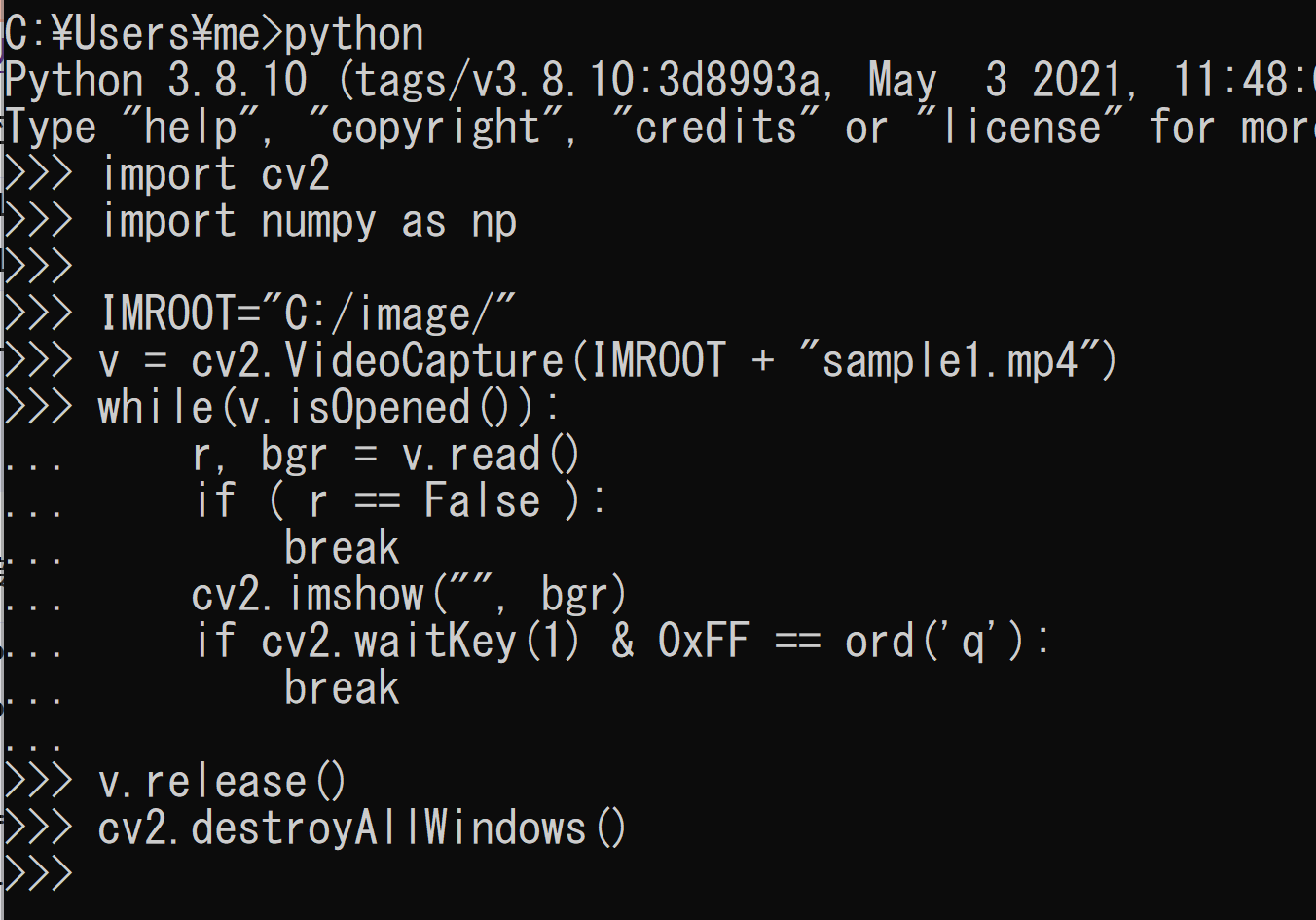

動画ファイルの表示

1フレームずつファイルから読み出して表示を繰り返す.早送りに見えるのは正常動作である.

表示を確認する.ウインドウの右上の「x」をクリックしない.画面の中をクリックしてから,「q」キーを押して閉じる.以下同様.

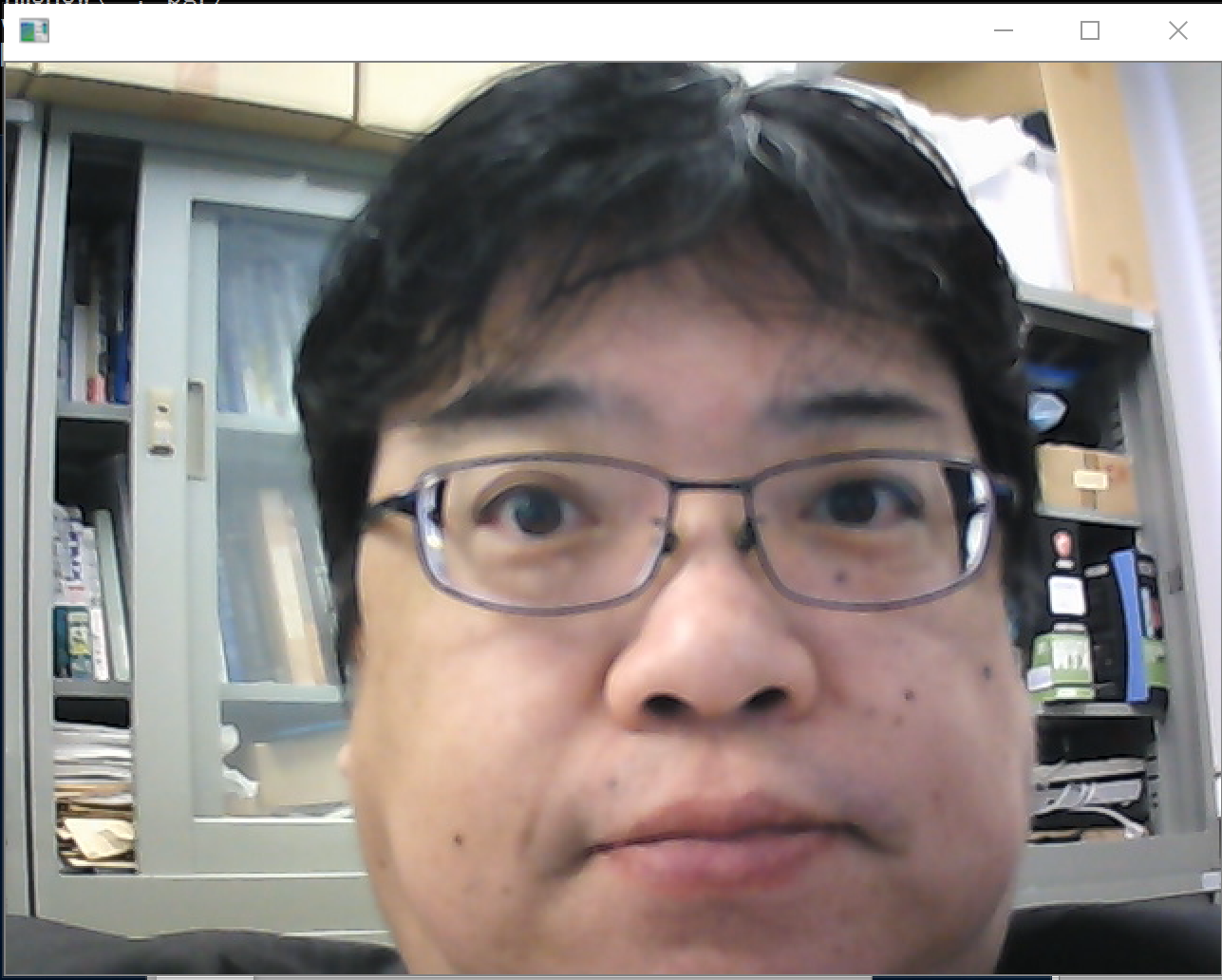

パソコン接続ビデオカメラの表示

パソコンに接続できるビデオカメラを準備し,パソコンに接続しておく.コードは「v = cv2.VideoCapture(0)」に変えただけである.

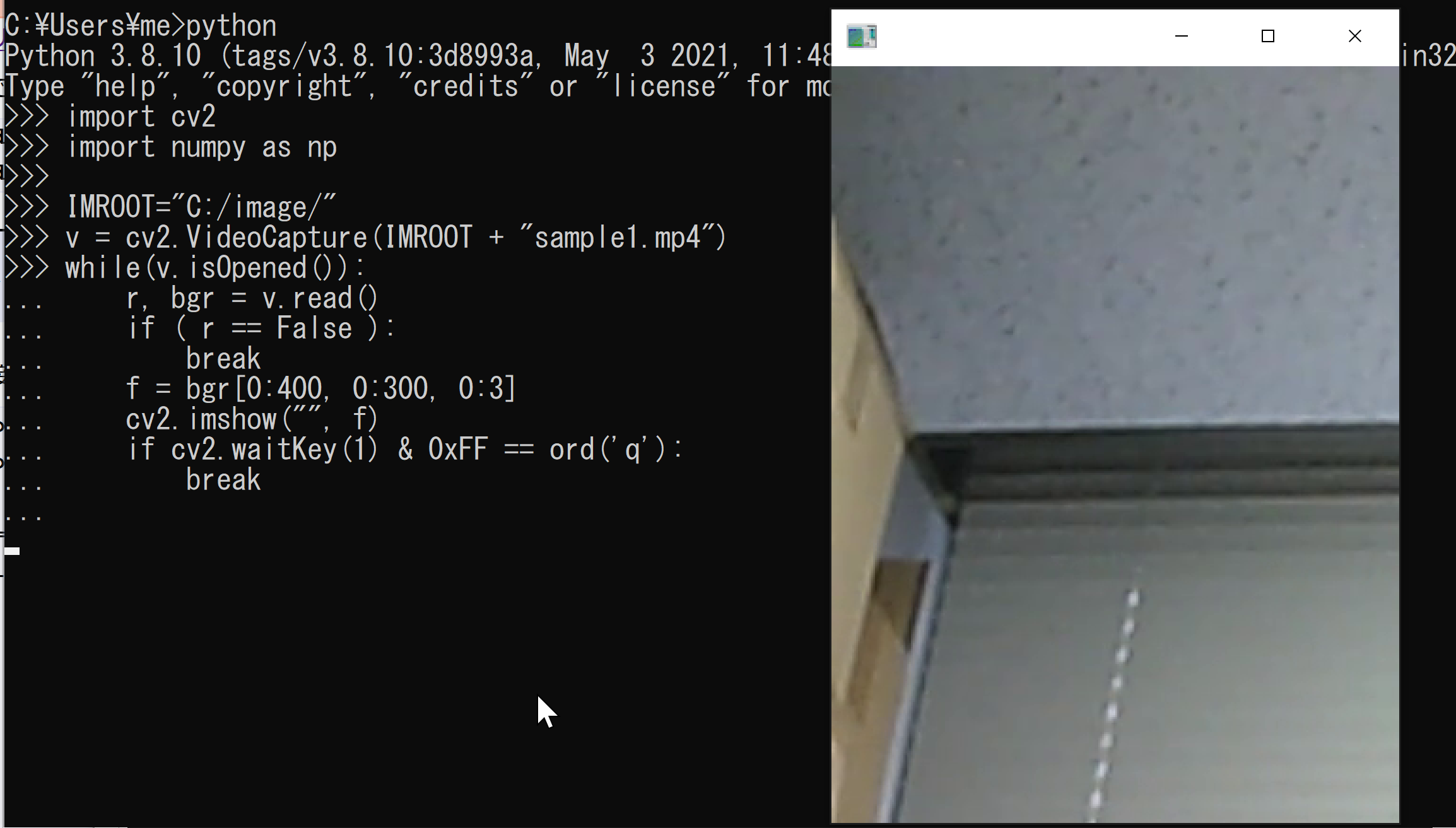

動画ファイルの表示(必要部分の切り出し)

「bgr[0:400, 0:300, 0:3]」で範囲を指定して,必要部分を切り出している.

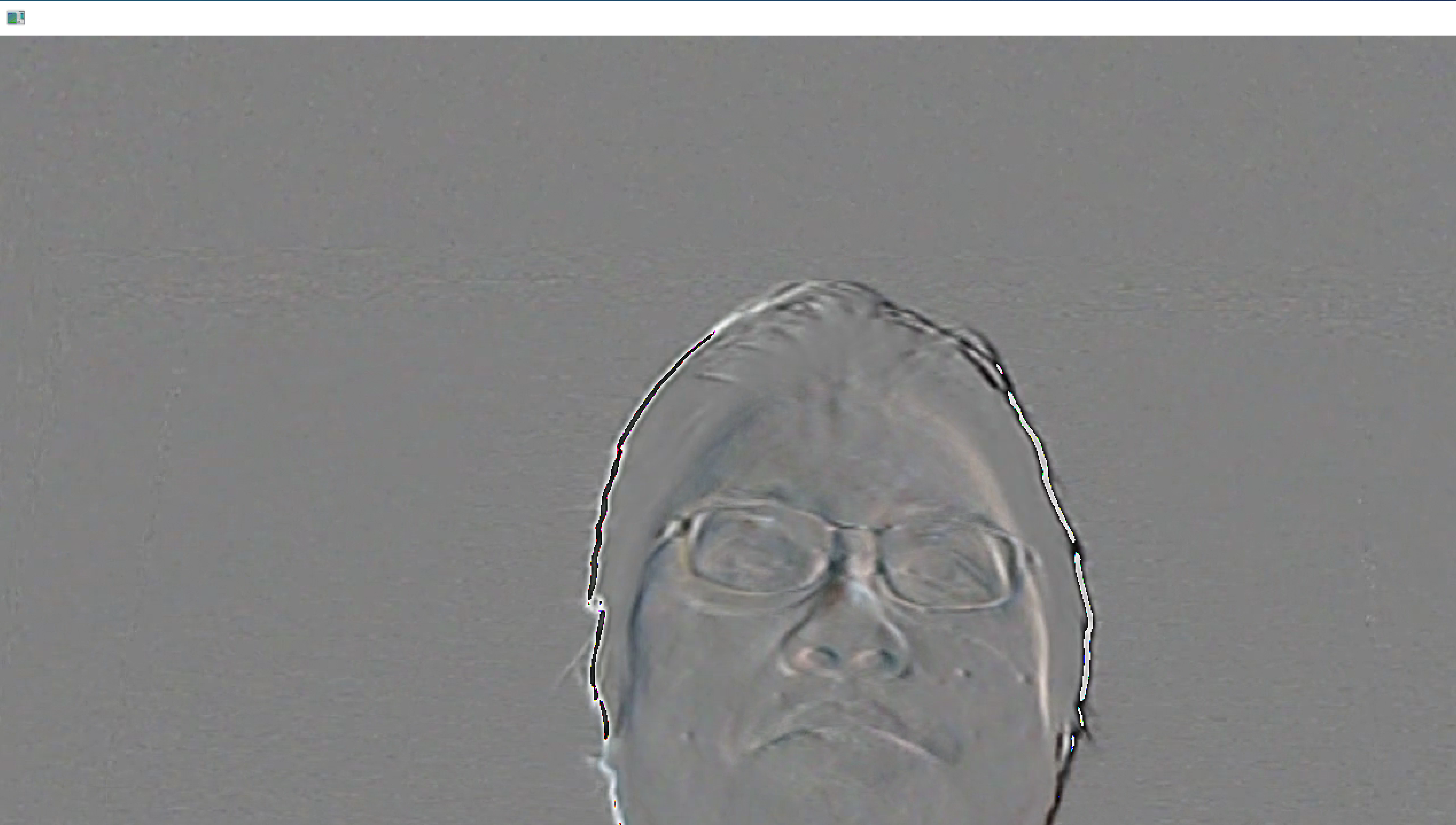

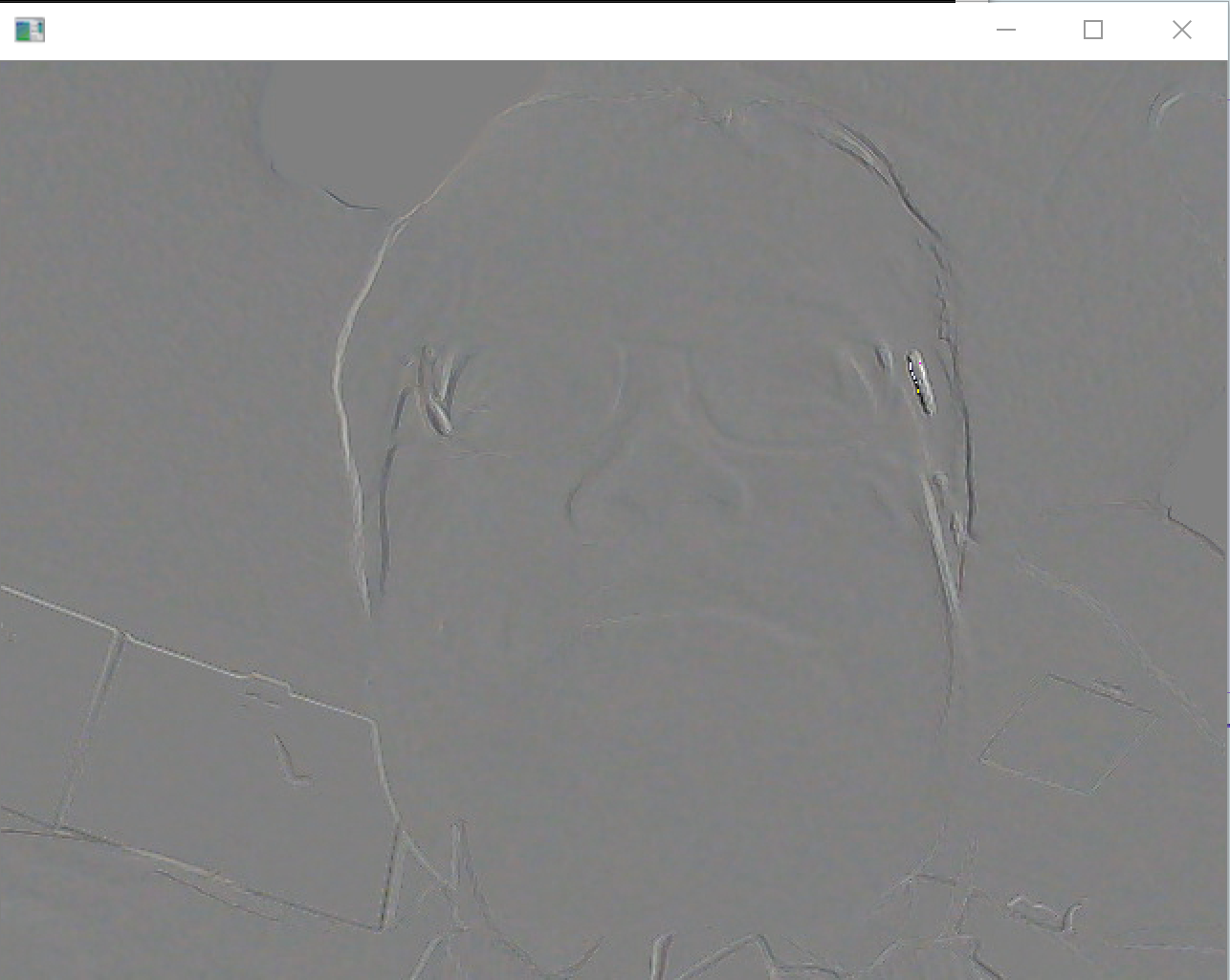

連続フレームの差分表示(フレーム間差分)

表示の一部分を以下に示す.

パソコン接続ビデオカメラ版は「v = cv2.VideoCapture(0)」に変えただけである.

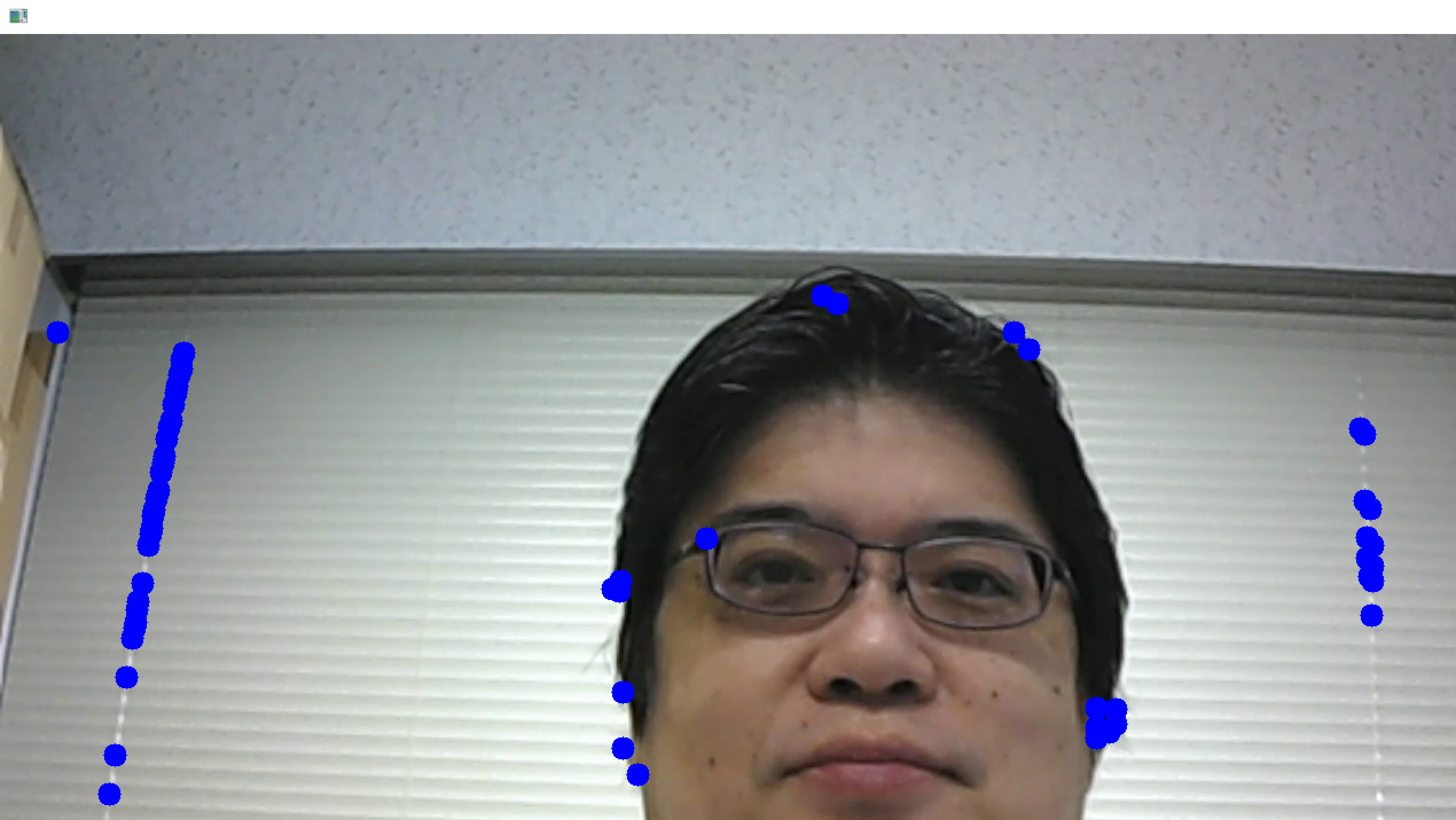

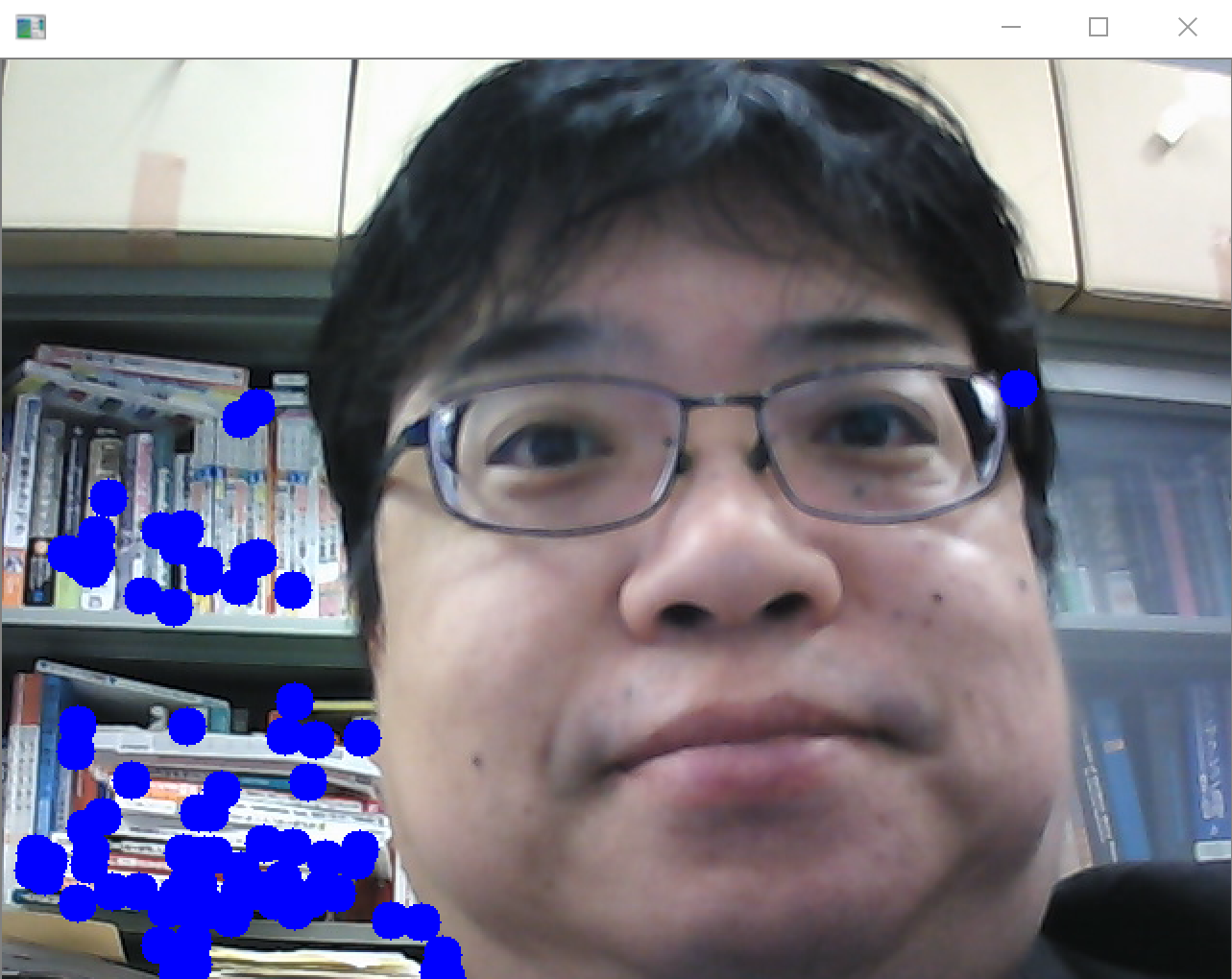

トラッキングビジョン

Shi-Tomasi の手法により,「トラッキングに適するポイント(追跡用の点)」を複数抜き出す.

パソコン接続ビデオカメラ版は「v = cv2.VideoCapture(0)」に変えただけである.

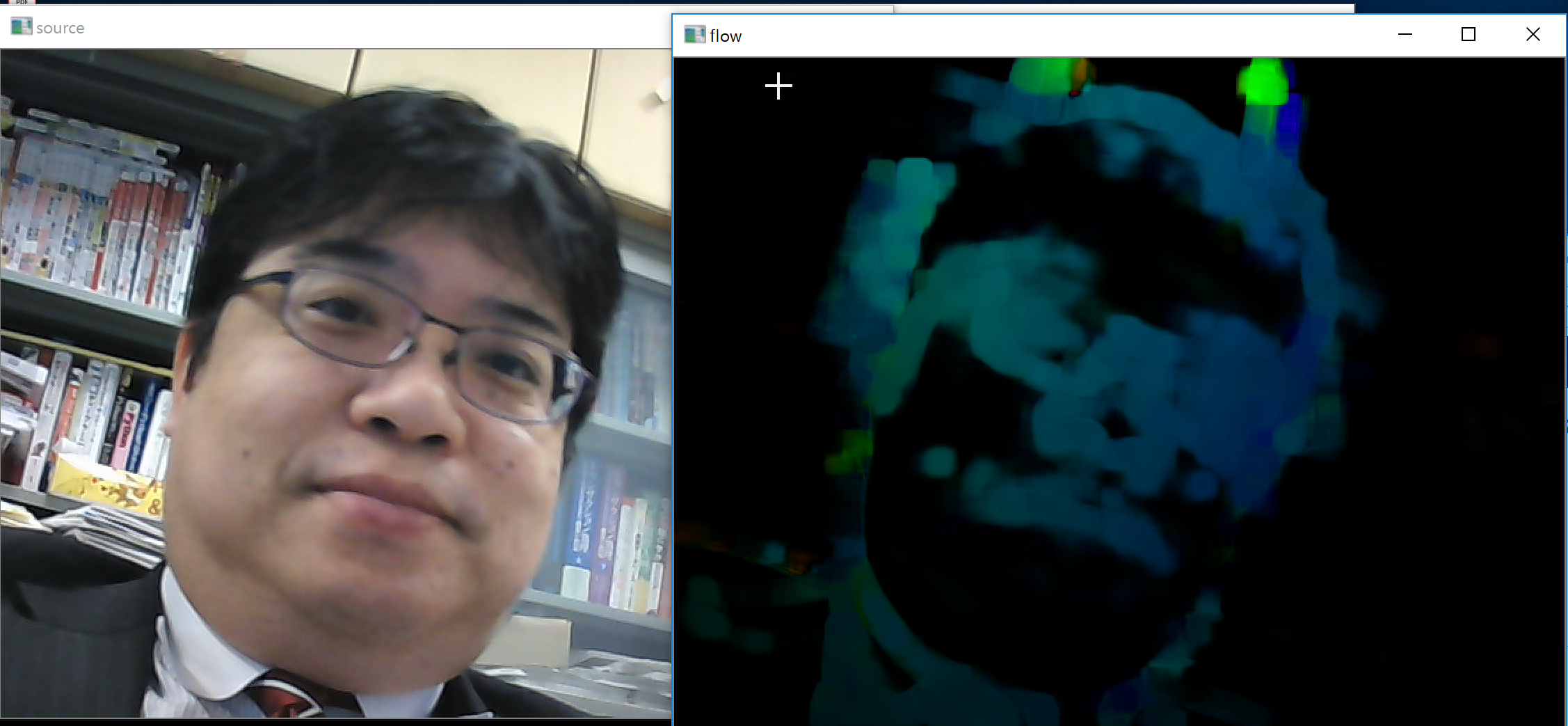

オプティカルフロー(Farneback の方法による)

オプティカルフローは,ビデオから「動きの情報」を取り出す手法である.

パソコン接続ビデオカメラ版は「v = cv2.VideoCapture(0)」に変えただけである.

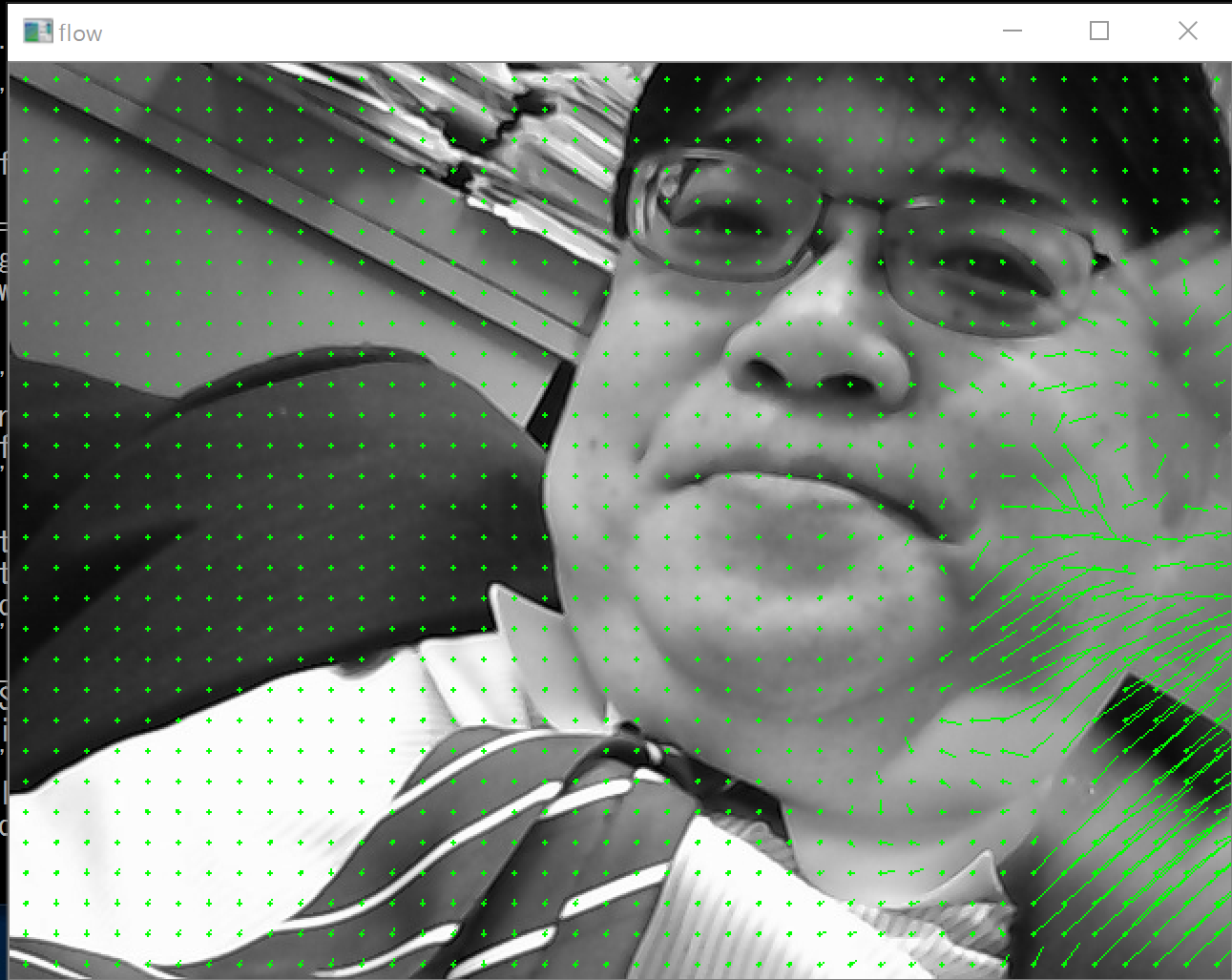

DIS optical flow

謝辞:https://github.com/opencv/opencv/blob/master/samples/python/opt_flow.py で公開されているプログラムに手を加えて使用している(video パッケージを使わず,パソコンカメラを使用).

フレーム間差分による動体検出(二値化)

フレーム間差分にしきい値処理(二値化)を適用し,動きのある領域を白,それ以外を黒として検出する.cv2.absdiff で2フレーム間の差分の絶対値を求め,cv2.threshold で二値化を行う.

パソコン接続ビデオカメラ版は「v = cv2.VideoCapture(0)」に変えただけである.

ウインドウの閉じ方

全てのプログラムにおいて,途中で止めたいとき,右上の「x」をクリックしない.画面の中をクリックしてから,「q」のキーを押して閉じる.

5. ソースコード

動画ファイルの表示

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

while v.isOpened():

r, bgr = v.read()

if not r:

break

cv2.imshow("", bgr)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

パソコン接続ビデオカメラの表示

import numpy as np

import cv2

v = cv2.VideoCapture(0)

while v.isOpened():

r, bgr = v.read()

if not r:

break

cv2.imshow("", bgr)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

動画ファイルの表示(必要部分の切り出し)

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

while v.isOpened():

r, bgr = v.read()

if not r:

break

f = bgr[0:400, 0:300, 0:3]

cv2.imshow("", f)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

連続フレームの差分表示(動画ファイル)

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

r, bgr = v.read()

while v.isOpened():

bgr2 = bgr

r, bgr = v.read()

if not r:

break

cv2.imshow("", bgr - bgr2 + 128)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

連続フレームの差分表示(パソコン接続ビデオカメラ)

import numpy as np

import cv2

v = cv2.VideoCapture(0)

r, bgr = v.read()

while v.isOpened():

bgr2 = bgr

r, bgr = v.read()

if not r:

break

cv2.imshow("", bgr - bgr2 + 128)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

トラッキングビジョン(動画ファイル)

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

while v.isOpened():

r, bgr = v.read()

if not r:

break

g = cv2.cvtColor(bgr, cv2.COLOR_BGR2GRAY)

d = cv2.goodFeaturesToTrack(g, 80, 0.01, 5, 3)

if d is not None:

for i in np.int0(d):

x, y = i.ravel()

cv2.circle(bgr, (x, y), 10, 255, -1)

cv2.imshow("", bgr)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

トラッキングビジョン(パソコン接続ビデオカメラ)

import numpy as np

import cv2

v = cv2.VideoCapture(0)

while v.isOpened():

r, bgr = v.read()

if not r:

break

g = cv2.cvtColor(bgr, cv2.COLOR_BGR2GRAY)

d = cv2.goodFeaturesToTrack(g, 80, 0.01, 5, 3)

if d is not None:

for i in np.int0(d):

x, y = i.ravel()

cv2.circle(bgr, (x, y), 10, 255, -1)

cv2.imshow("", bgr)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

v.release()

cv2.destroyAllWindows()

オプティカルフロー(Farneback の方法,動画ファイル)

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

ret, bgr1 = v.read()

prvs = cv2.cvtColor(bgr1, cv2.COLOR_BGR2GRAY)

hsv = np.zeros_like(bgr1)

hsv[..., 1] = 255

while True:

ret, bgr2 = v.read()

if not ret:

break

nxt = cv2.cvtColor(bgr2, cv2.COLOR_BGR2GRAY)

flow = cv2.calcOpticalFlowFarneback(prvs, nxt, None, 0.5, 3, 15, 3, 5, 1.2, 0)

mag, ang = cv2.cartToPolar(flow[..., 0], flow[..., 1])

hsv[..., 0] = ang * 180 / np.pi / 2

hsv[..., 2] = cv2.normalize(mag, None, 0, 255, cv2.NORM_MINMAX)

rgb = cv2.cvtColor(hsv, cv2.COLOR_HSV2BGR)

cv2.imshow('source', bgr2)

cv2.imshow('flow', rgb)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

prvs = nxt

v.release()

cv2.destroyAllWindows()

オプティカルフロー(Farneback の方法,パソコン接続ビデオカメラ)

import numpy as np

import cv2

v = cv2.VideoCapture(0)

ret, bgr1 = v.read()

prvs = cv2.cvtColor(bgr1, cv2.COLOR_BGR2GRAY)

hsv = np.zeros_like(bgr1)

hsv[..., 1] = 255

while True:

ret, bgr2 = v.read()

if not ret:

break

nxt = cv2.cvtColor(bgr2, cv2.COLOR_BGR2GRAY)

flow = cv2.calcOpticalFlowFarneback(prvs, nxt, None, 0.5, 3, 15, 3, 5, 1.2, 0)

mag, ang = cv2.cartToPolar(flow[..., 0], flow[..., 1])

hsv[..., 0] = ang * 180 / np.pi / 2

hsv[..., 2] = cv2.normalize(mag, None, 0, 255, cv2.NORM_MINMAX)

rgb = cv2.cvtColor(hsv, cv2.COLOR_HSV2BGR)

cv2.imshow('source', bgr2)

cv2.imshow('flow', rgb)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

prvs = nxt

v.release()

cv2.destroyAllWindows()

DIS optical flow

import numpy as np

import cv2 as cv

def draw_flow(img, flow, step=16):

h, w = img.shape[:2]

y, x = np.mgrid[step/2:h:step, step/2:w:step].reshape(2, -1).astype(int)

fx, fy = flow[y, x].T

lines = np.vstack([x, y, x+fx, y+fy]).T.reshape(-1, 2, 2)

lines = np.int32(lines + 0.5)

vis = cv.cvtColor(img, cv.COLOR_GRAY2BGR)

cv.polylines(vis, lines, 0, (0, 255, 0))

for (x1, y1), (_x2, _y2) in lines:

cv.circle(vis, (x1, y1), 1, (0, 255, 0), -1)

return vis

def draw_hsv(flow):

h, w = flow.shape[:2]

fx, fy = flow[:, :, 0], flow[:, :, 1]

ang = np.arctan2(fy, fx) + np.pi

v = np.sqrt(fx*fx + fy*fy)

hsv = np.zeros((h, w, 3), np.uint8)

hsv[..., 0] = ang * (180 / np.pi / 2)

hsv[..., 1] = 255

hsv[..., 2] = np.minimum(v*4, 255)

return cv.cvtColor(hsv, cv.COLOR_HSV2BGR)

def warp_flow(img, flow):

h, w = flow.shape[:2]

flow = -flow

flow[:, :, 0] += np.arange(w)

flow[:, :, 1] += np.arange(h)[:, np.newaxis]

return cv.remap(img, flow, None, cv.INTER_LINEAR)

cam = cv.VideoCapture(0)

ret, prev = cam.read()

prevgray = cv.cvtColor(prev, cv.COLOR_BGR2GRAY)

show_hsv = False

show_glitch = False

use_spatial_propagation = False

use_temporal_propagation = True

cur_glitch = prev.copy()

inst = cv.DISOpticalFlow.create(cv.DISOPTICAL_FLOW_PRESET_MEDIUM)

inst.setUseSpatialPropagation(use_spatial_propagation)

flow = None

while True:

ret, img = cam.read()

if not ret:

break

gray = cv.cvtColor(img, cv.COLOR_BGR2GRAY)

if flow is not None and use_temporal_propagation:

flow = inst.calc(prevgray, gray, warp_flow(flow, flow))

else:

flow = inst.calc(prevgray, gray, None)

prevgray = gray

cv.imshow('flow', draw_flow(gray, flow))

if show_hsv:

cv.imshow('flow HSV', draw_hsv(flow))

if show_glitch:

cur_glitch = warp_flow(cur_glitch, flow)

cv.imshow('glitch', cur_glitch)

ch = 0xFF & cv.waitKey(5)

if ch == 27:

break

if ch == ord('1'):

show_hsv = not show_hsv

if ch == ord('2'):

show_glitch = not show_glitch

if show_glitch:

cur_glitch = img.copy()

if ch == ord('3'):

use_spatial_propagation = not use_spatial_propagation

inst.setUseSpatialPropagation(use_spatial_propagation)

if ch == ord('4'):

use_temporal_propagation = not use_temporal_propagation

cam.release()

cv.destroyAllWindows()

フレーム間差分による動体検出(動画ファイル)

import os

import numpy as np

import cv2

IMROOT = os.environ['LOCALAPPDATA'] + '/'

v = cv2.VideoCapture(IMROOT + "sample1.mp4")

r, prev = v.read()

prev_gray = cv2.cvtColor(prev, cv2.COLOR_BGR2GRAY)

while v.isOpened():

r, bgr = v.read()

if not r:

break

gray = cv2.cvtColor(bgr, cv2.COLOR_BGR2GRAY)

diff = cv2.absdiff(prev_gray, gray)

_, thresh = cv2.threshold(diff, 30, 255, cv2.THRESH_BINARY)

cv2.imshow("source", bgr)

cv2.imshow("motion", thresh)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

prev_gray = gray

v.release()

cv2.destroyAllWindows()

フレーム間差分による動体検出(パソコン接続ビデオカメラ)

import numpy as np

import cv2

v = cv2.VideoCapture(0)

r, prev = v.read()

prev_gray = cv2.cvtColor(prev, cv2.COLOR_BGR2GRAY)

while v.isOpened():

r, bgr = v.read()

if not r:

break

gray = cv2.cvtColor(bgr, cv2.COLOR_BGR2GRAY)

diff = cv2.absdiff(prev_gray, gray)

_, thresh = cv2.threshold(diff, 30, 255, cv2.THRESH_BINARY)

cv2.imshow("source", bgr)

cv2.imshow("motion", thresh)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

prev_gray = gray

v.release()

cv2.destroyAllWindows()

6. まとめ

フレーム間差分

連続する2フレーム間の差分を計算し表示する手法である.差分に128を加算することで,変化のない領域をグレー,変化のある領域を明暗で表現する.

フレーム間差分による動体検出(二値化)

フレーム間差分にしきい値処理(二値化)を適用し,動きのある領域を白,それ以外を黒として検出する手法である.cv2.absdiff と cv2.threshold を使用する.

トラッキングビジョン

Shi-Tomasi の手法により,「トラッキングに適するポイント(追跡用の点)」を複数抜き出す.cv2.goodFeaturesToTrack で特徴点を検出し,各フレーム上に円で描画する.

オプティカルフロー(Farneback の方法)

ビデオから「動きの情報」を取り出す手法である.cv2.calcOpticalFlowFarneback により密なオプティカルフローを計算し,HSV色空間で動きの方向と大きさを可視化する.

DIS optical flow

cv2.DISOpticalFlow を使用したオプティカルフローの実装である.フロー表示,HSV可視化,グリッチ表示のモードを備え,空間伝搬・時間伝搬の切り替えにも対応している.

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)