CREPE のインストール,CREPE を用いた音声分析プログラム(音のピッチ推定)(Python,TensorFlow を使用)(Windows 上)

Windows環境でCREPEを用いて音声ファイルのピッチ推定を行うプログラムの説明をしています。まず、前準備としてGit、7-Zip、Python、Build Tools for Visual Studio 2022、NVIDIA関連ツール、TensorFlowのインストール方法を示しています。次に、CREPEのインストールとテスト実行の手順を説明しています。そして、Pythonプログラムのコードを提示しています。このプログラムは、選択された音声ファイルを CREPE で処理し、結果を出力フォルダに保存します。プログラムでは、音声ファイルのサンプリングレート、長さ、周波数、アクティベーションなどの情報を表示し、周波数とアクティベーションのグラフも描画します。最後に、プログラムの実行結果例を示しています。

CREPE

CREPE(Convolutional Representation for Pitch Estimation)は、深層学習を用いたモノフォニック音声のピッチ推定手法です。以下に、CREPEの特徴と性能評価について説明します。

特徴

- CREPEは、時間領域の音声波形を直接入力とし、畳み込みニューラルネットワーク(CNN)を用いて360次元のピッチアクティベーションを出力します。

- ピッチアクティベーションは、6オクターブの音域を20セント間隔で分割した360個の音高候補に対する活性度を表す数値ベクトルです。

性能評価

- RWC-synthとMDB-stem-synthの2つのデータセットを用いて、従来手法であるpYINやSWIPEとの比較が行われました。

- 評価指標として、Raw Pitch Accuracy(RPA)とRaw Chroma Accuracy(RCA)が用いられました。

- ピッチ認識の閾値を変化させた場合や、ホワイトノイズ等を加えた場合のロバスト性も評価されました。

- 実験の結果、CREPEは多様な音色やノイズに対して従来手法よりもロバスト性に優れ、高精度なピッチ推定が可能であることが示されました。

応用分野

- CREPEは、旋律抽出やイントネーション分析など、ピッチ情報を必要とする様々な音声処理タスクに応用可能です。

- 音楽情報処理における音高推定や、言語学における韻律分析などにも活用できます。

文献

CREPE: A Convolutional Representation for Pitch Estimation Jong Wook Kim, Justin Salamon, Peter Li, Juan Pablo Bello. Proceedings of the IEEE International Conference on Acoustics, Speech, and Signal Processing (ICASSP), also arXiv:1802.06182v1 [eess.AS], 2018.

https://arxiv.org/pdf/1802.06182v1

CREPE の GitHub の公式ページ: https://github.com/marl/crepe

前準備

Build Tools for Visual Studio 2026 のインストール(Windows 上) [クリックして展開]

Build Tools for Visual Studio は,Visual Studio の IDE を含まない C/C++ コンパイラ,ライブラリ,ビルドツール等のコマンドライン向け開発ツールセットである。インストール済みの場合、この手順は不要である。

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

REM VC++ ランタイム

winget install --scope machine --id Microsoft.VCRedist.2015+.x64 -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --override "/quiet /norestart"

REM Build Tools + Desktop development with C++(VCTools)+ 追加コンポーネント(一括)

winget list --id Microsoft.VisualStudio.BuildTools 2>nul | findstr /i "BuildTools" >nul 2>&1

if %ERRORLEVEL% EQU 0 (

for /f "delims=" %P in ('"C:\Program Files (x86)\Microsoft Visual Studio\Installer\vswhere.exe" -products * -property installationPath') do start /wait "" "C:\Program Files (x86)\Microsoft Visual Studio\Installer\setup.exe" modify --installPath "%P" --add Microsoft.VisualStudio.Workload.VCTools --add Microsoft.VisualStudio.Workload.MSBuildTools --add Microsoft.VisualStudio.Component.VC.CMake.Project --add Microsoft.VisualStudio.Component.VC.Llvm.Clang --add Microsoft.VisualStudio.Component.VC.Llvm.ClangToolset --add Microsoft.VisualStudio.Component.Windows11SDK.26100 --includeRecommended --quiet --norestart

) else (

winget install --scope machine --id Microsoft.VisualStudio.BuildTools -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --override "--quiet --wait --norestart --nocache --add Microsoft.VisualStudio.Workload.VCTools --includeRecommended --add Microsoft.VisualStudio.Workload.MSBuildTools --add Microsoft.VisualStudio.Component.VC.CMake.Project --add Microsoft.VisualStudio.Component.VC.Llvm.Clang --add Microsoft.VisualStudio.Component.VC.Llvm.ClangToolset --add Microsoft.VisualStudio.Component.Windows11SDK.26100"

)

REM 何らかの理由で BuildTools の動作がおかしくなった場合は,以下を実行すると,既存のインストールのファイル破損・欠損を修復し正常な状態に復元する効果がある.

REM "C:\Program Files (x86)\Microsoft Visual Studio\Installer\setup.exe" repair --installPath "C:\Program Files (x86)\Microsoft Visual Studio\18\BuildTools" --quiet --norestart

REM 以下で正常であることを確認する.パスが表示されれば正常である.

REM "C:\Program Files (x86)\Microsoft Visual Studio\Installer\vswhere.exe" -products * -requires Microsoft.VisualStudio.Workload.VCTools -property installationPath--add で追加されるコンポーネント

上記のコマンドでは,まず Build Tools 本体と Visual C++ 再頒布可能パッケージをインストールし,次に setup.exe を用いて以下のコンポーネントを追加している。

VCTools:C++ デスクトップ開発ワークロード(--includeRecommendedにより、MSVC コンパイラ、C++ AddressSanitizer、vcpkg、CMake ツール、Windows 11 SDK 等の推奨コンポーネントが含まれる)VC.Llvm.Clang:Windows 向け C++ Clang コンパイラClangCL:clang-cl ツールセットを含むコンポーネントグループ(MSBuild から Clang を使用するために必要)VC.CMake.Project:Windows 向け C++ CMake ツールWindows11SDK.26100:Windows 11 SDK(ビルド 10.0.26100)

インストール完了の確認

winget list Microsoft.VisualStudio.BuildTools上記以外の追加のコンポーネントが必要になった場合は Visual Studio Installer で個別にインストールできる。

Visual Studio の機能を必要とする場合は、追加インストールできる。

Python 3.12 のインストール(Windows 上) [クリックして展開]

以下のいずれかの方法で Python 3.12 をインストールする。Python がインストール済みの場合、この手順は不要である。

方法1:winget によるインストール

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --id Python.Python.3.12 -e --scope machine --silent --accept-source-agreements --accept-package-agreements --override "/quiet InstallAllUsers=1 PrependPath=1 Include_test=0 Include_pip=1 Include_launcher=1 InstallLauncherAllUsers=1 TargetDir=\"C:\Program Files\Python312\""

powershell -Command "$p='C:\Program Files\Python312'; $s=\"$p\Scripts\"; $m=[Environment]::GetEnvironmentVariable('Path','Machine'); if($m -notlike \"*$s*\") { [Environment]::SetEnvironmentVariable('Path', \"$p;$s;$m\", 'Machine') }"--scope machine を指定することで、システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後、コマンドプロンプトを再起動すると PATH が自動的に設定される。

方法2:インストーラーによるインストール

- Python 公式サイト(https://www.python.org/downloads/)にアクセスし、「Download Python 3.x.x」ボタンから Windows 用インストーラーをダウンロードする。

- ダウンロードしたインストーラーを実行する。

- 初期画面の下部に表示される「Add python.exe to PATH」に必ずチェックを入れてから「Customize installation」を選択する。このチェックを入れ忘れると、コマンドプロンプトから

pythonコマンドを実行できない。 - 「Install Python 3.xx for all users」にチェックを入れ、「Install」をクリックする。

インストールの確認

コマンドプロンプトで以下を実行する。

python --versionバージョン番号(例:Python 3.12.x)が表示されればインストール成功である。「'python' は、内部コマンドまたは外部コマンドとして認識されていません。」と表示される場合は、インストールが正常に完了していない。

Git のインストール(Windows 上) [クリックして展開]

管理者権限のコマンドプロンプトで以下を実行する.管理者権限は,winget の --scope machine オプションでシステム全体にインストールするために必要となる.

REM Git をシステム領域にインストール

winget install --scope machine --id Git.Git -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --override "/VERYSILENT /NORESTART /NOCANCEL /SP- /CLOSEAPPLICATIONS /RESTARTAPPLICATIONS /COMPONENTS=""icons,ext\reg\shellhere,assoc,assoc_sh"" /o:PathOption=Cmd /o:CRLFOption=CRLFCommitAsIs /o:BashTerminalOption=MinTTY /o:DefaultBranchOption=main /o:EditorOption=VIM /o:SSHOption=OpenSSH /o:UseCredentialManager=Enabled /o:PerformanceTweaksFSCache=Enabled /o:EnableSymlinks=Disabled /o:EnableFSMonitor=Disabled"

7-Zip のインストール(Windows 上) [クリックして展開]

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

REM 7-Zip をシステム領域にインストール

winget install --scope machine --id 7zip.7zip -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements

REM 7-Zip のパス設定

powershell -NoProfile -Command "$p='C:\Program Files\7-Zip'; $c=[Environment]::GetEnvironmentVariable('Path','Machine'); if((Test-Path $p) -and $c -notlike \"*$p*\"){[Environment]::SetEnvironmentVariable('Path',\"$p;$c\",'Machine')}"

Build Tools for Visual Studio 2026 のインストール(Windows 上) [クリックして展開]

Build Tools for Visual Studio は,Visual Studio の IDE を含まない C/C++ コンパイラ,ライブラリ,ビルドツール等のコマンドライン向け開発ツールセットである。インストール済みの場合、この手順は不要である。

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

REM VC++ ランタイム

winget install --scope machine --id Microsoft.VCRedist.2015+.x64 -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --override "/quiet /norestart"

REM Build Tools + Desktop development with C++(VCTools)+ 追加コンポーネント(一括)

winget list --id Microsoft.VisualStudio.BuildTools 2>nul | findstr /i "BuildTools" >nul 2>&1

if %ERRORLEVEL% EQU 0 (

for /f "delims=" %P in ('"C:\Program Files (x86)\Microsoft Visual Studio\Installer\vswhere.exe" -products * -property installationPath') do start /wait "" "C:\Program Files (x86)\Microsoft Visual Studio\Installer\setup.exe" modify --installPath "%P" --add Microsoft.VisualStudio.Workload.VCTools --add Microsoft.VisualStudio.Workload.MSBuildTools --add Microsoft.VisualStudio.Component.VC.CMake.Project --add Microsoft.VisualStudio.Component.VC.Llvm.Clang --add Microsoft.VisualStudio.Component.VC.Llvm.ClangToolset --add Microsoft.VisualStudio.Component.Windows11SDK.26100 --includeRecommended --quiet --norestart

) else (

winget install --scope machine --id Microsoft.VisualStudio.BuildTools -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --override "--quiet --wait --norestart --nocache --add Microsoft.VisualStudio.Workload.VCTools --includeRecommended --add Microsoft.VisualStudio.Workload.MSBuildTools --add Microsoft.VisualStudio.Component.VC.CMake.Project --add Microsoft.VisualStudio.Component.VC.Llvm.Clang --add Microsoft.VisualStudio.Component.VC.Llvm.ClangToolset --add Microsoft.VisualStudio.Component.Windows11SDK.26100"

)

REM 何らかの理由で BuildTools の動作がおかしくなった場合は,以下を実行すると,既存のインストールのファイル破損・欠損を修復し正常な状態に復元する効果がある.

REM "C:\Program Files (x86)\Microsoft Visual Studio\Installer\setup.exe" repair --installPath "C:\Program Files (x86)\Microsoft Visual Studio\18\BuildTools" --quiet --norestart

REM 以下で正常であることを確認する.パスが表示されれば正常である.

REM "C:\Program Files (x86)\Microsoft Visual Studio\Installer\vswhere.exe" -products * -requires Microsoft.VisualStudio.Workload.VCTools -property installationPath--add で追加されるコンポーネント

上記のコマンドでは,まず Build Tools 本体と Visual C++ 再頒布可能パッケージをインストールし,次に setup.exe を用いて以下のコンポーネントを追加している。

VCTools:C++ デスクトップ開発ワークロード(--includeRecommendedにより、MSVC コンパイラ、C++ AddressSanitizer、vcpkg、CMake ツール、Windows 11 SDK 等の推奨コンポーネントが含まれる)VC.Llvm.Clang:Windows 向け C++ Clang コンパイラClangCL:clang-cl ツールセットを含むコンポーネントグループ(MSBuild から Clang を使用するために必要)VC.CMake.Project:Windows 向け C++ CMake ツールWindows11SDK.26100:Windows 11 SDK(ビルド 10.0.26100)

インストール完了の確認

winget list Microsoft.VisualStudio.BuildTools上記以外の追加のコンポーネントが必要になった場合は Visual Studio Installer で個別にインストールできる。

Visual Studio の機能を必要とする場合は、追加インストールできる。

NVIDIA CUDA Toolkit 12.8のインストール

- 前提条件(NVIDIA CUDA Toolkit インストール前): NVIDIA GPU,NVIDIA ドライバ,および Build Tools for Visual Studio もしくは Visual Studio が必要である.

- インストール中の注意: なるべく他のウインドウはすべて閉じておくこと.

以下のコマンドを管理者権限のコマンドプロンプトで実行する

(手順:Windowsキーまたはスタートメニュー → cmd と入力 → 右クリック → 「管理者として実行」)。

REM NVIDIA CUDA Toolkit 12.8 をシステム領域にインストール

winget install --scope machine --id Nvidia.CUDA --version 12.8 -e --silent --disable-interactivity --force --uninstall-previous --accept-source-agreements --accept-package-agreements --override "-s -n"

REM 環境変数TEMP, TMPの設定(一時ファイルの保存先を短いパスに変更)

mkdir C:\TEMP

set "TEMP_PATH=C:\TEMP"

setx TEMP "%TEMP_PATH%" /M >nul

setx TMP "%TEMP_PATH%" /M >nulNVIDIA cuDNN 8.9.7 のインストール(Windows 上)

NVIDIA cuDNN

NVIDIA cuDNN は,NVIDIA CUDA ツールキット上で動作する、高性能なディープラーニング用ライブラリです.畳み込みニューラルネットワーク (CNN) やリカレントニューラルネットワーク (RNN) など,さまざまなディープラーニングモデルのトレーニングと推論を高速化します.

【cuDNN利用時の注意点: zlibwapi.dll エラー】

Windows環境でcuDNNを利用するアプリケーションを実行した際に、「Could not locate zlibwapi.dll. Please make sure it is in your library path!」というエラーが表示されることがあります。これは、cuDNNの一部の機能が圧縮ライブラリである zlib に依存しているためです。このエラーが発生した場合は、後述する手順で ZLIB DLL をインストールする必要があります。

【関連する外部ページ】

- NVIDIA cuDNN の公式ページ(ダウンロードにはDeveloper Programへの登録が必要): https://developer.nvidia.com/cudnn

NVIDIA cuDNN のインストール(Windows 上)の概要

- NVIDIA Developer Program メンバーシップへの加入: cuDNNのダウンロードには無料のメンバーシップ登録が必要です。

NVIDIA Developer Program の公式ページ: https://developer.nvidia.com/developer-program

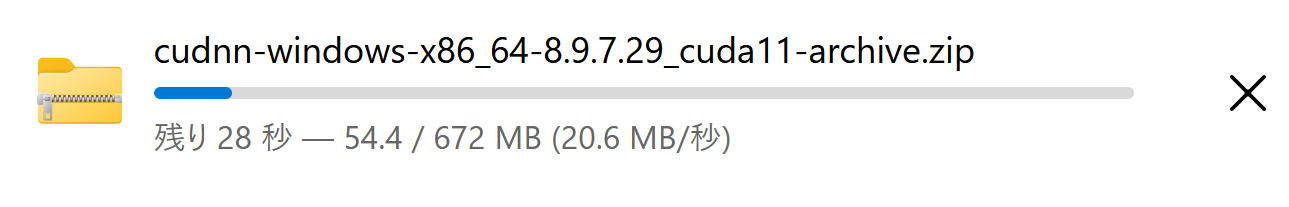

- 互換バージョンの選択とダウンロード: インストール済みのCUDAツールキットのバージョン (今回は11.x) に適合するcuDNNのバージョン (今回はv8.9.7) を選択し、Windows用のzipファイルをダウンロードします。

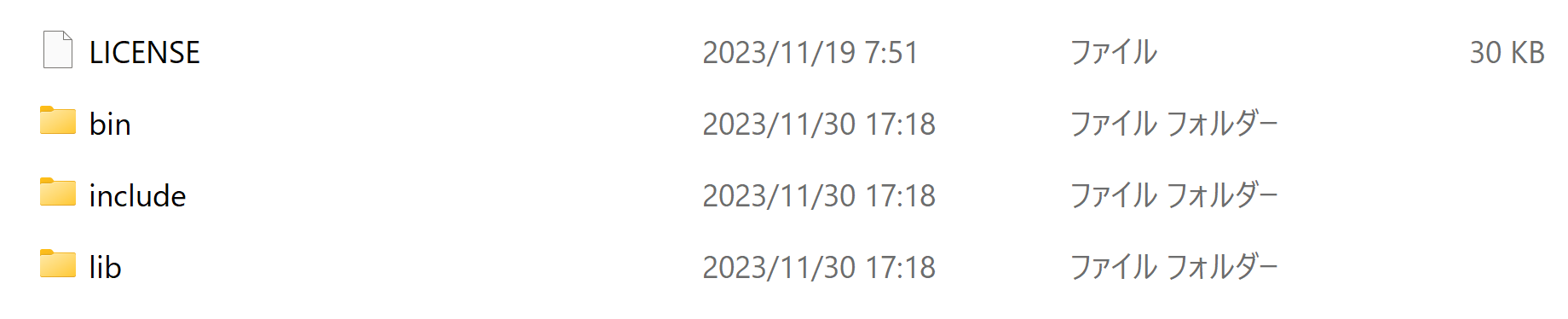

- ファイルの展開と配置: ダウンロードしたzipファイルを展開(解凍)し、中のファイル(

bin,include,libフォルダ内)を、CUDAツールキットのインストールディレクトリにコピーします。 - (オプション) 環境変数の設定: 必要に応じてシステム環境変数

CUDNN_PATHを設定します。 - (必要に応じて) ZLIB DLL のインストール:

zlibwapi.dllが見つからないエラーが発生する場合にインストールします。 - 動作確認: cuDNNライブラリ (

cudnn64_*.dll) にパスが通っているか確認します。

zlib のインストール(Windows 上)

- 次のコマンドを管理者権限のコマンドプロンプトで実行する

(手順:Windowsキーまたはスタートメニュー →

cmdと入力 → 右クリック → 「管理者として実行」)。

次のコマンドは,zlibをインストールし,パスを通すものである.

cd /d c:%HOMEPATH%

rmdir /s /q zlib

git clone https://github.com/madler/zlib

cd zlib

del CMakeCache.txt

rmdir /s /q CMakeFiles

cmake . -A x64 -T host=x64 -DCMAKE_INSTALL_PREFIX=c:/zlib

cmake --build . --config Release --target INSTALL

powershell -command "$oldpath = [System.Environment]::GetEnvironmentVariable(\"Path\", \"Machine\"); $oldpath += \";c:\zlib\bin\"; [System.Environment]::SetEnvironmentVariable(\"Path\", $oldpath, \"Machine\")"

powershell -command "[System.Environment]::SetEnvironmentVariable(\"ZLIB_HOME\", \"C:\zlib\", \"Machine\")"

【関連する外部ページ】

- zlib の公式ページ: https://www.zlib.net/

【関連項目】 zlib

NVIDIA cuDNN 8.9.7 のインストール(Windows 上)

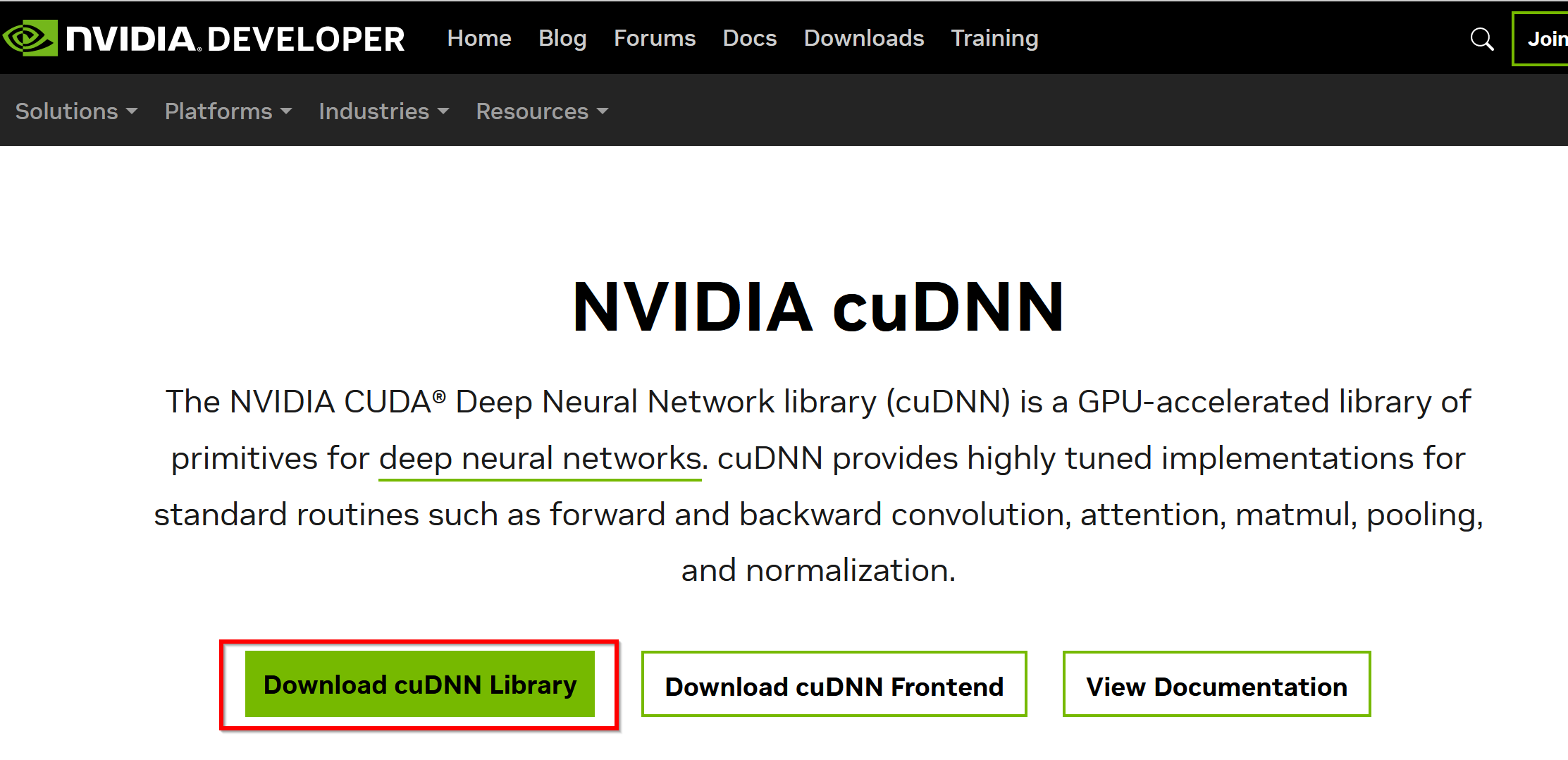

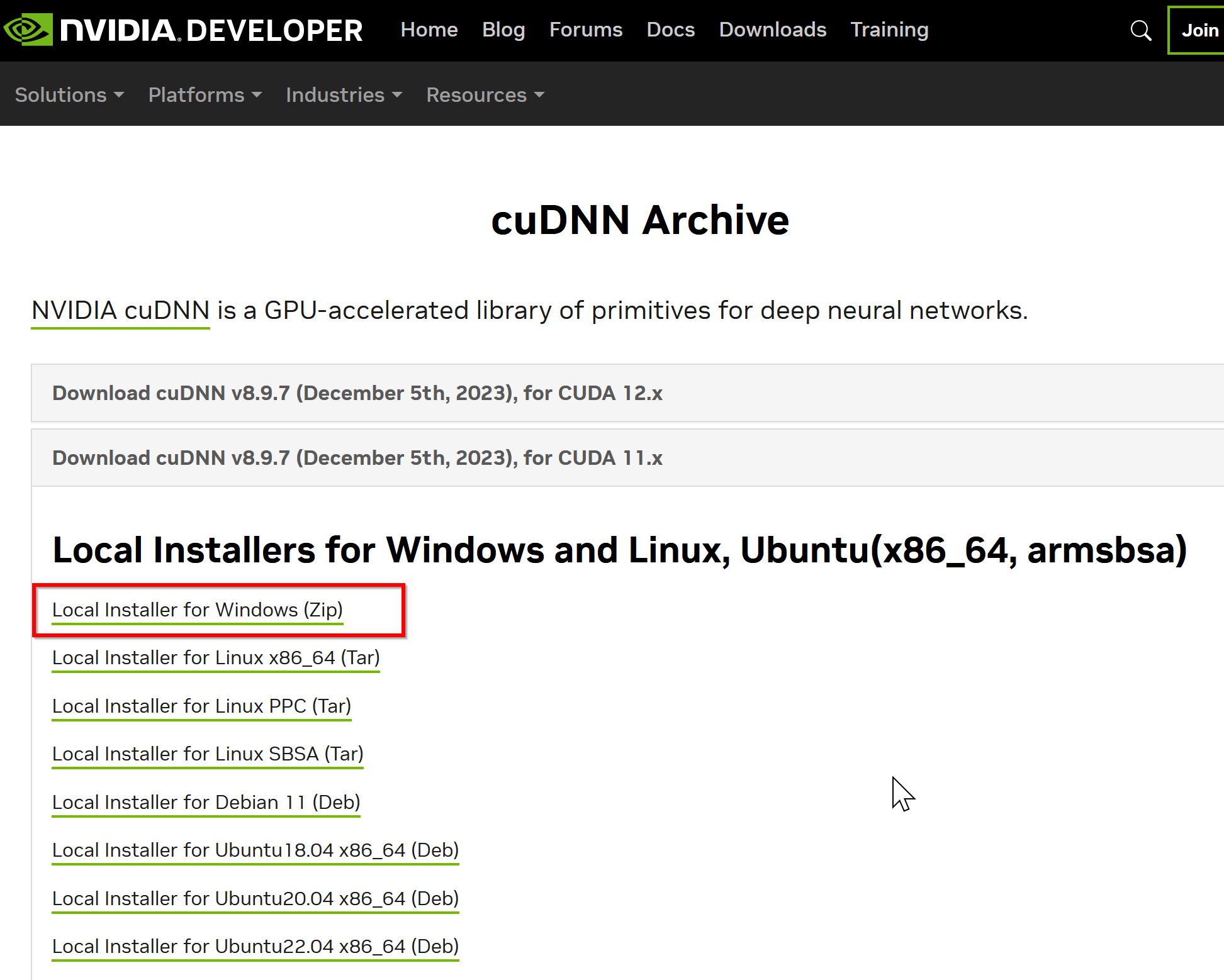

- NVIDIA cuDNN のウェブページを開く

- ダウンロードしたいので,cuDNNのところにある「Download cuDNN」をクリック.

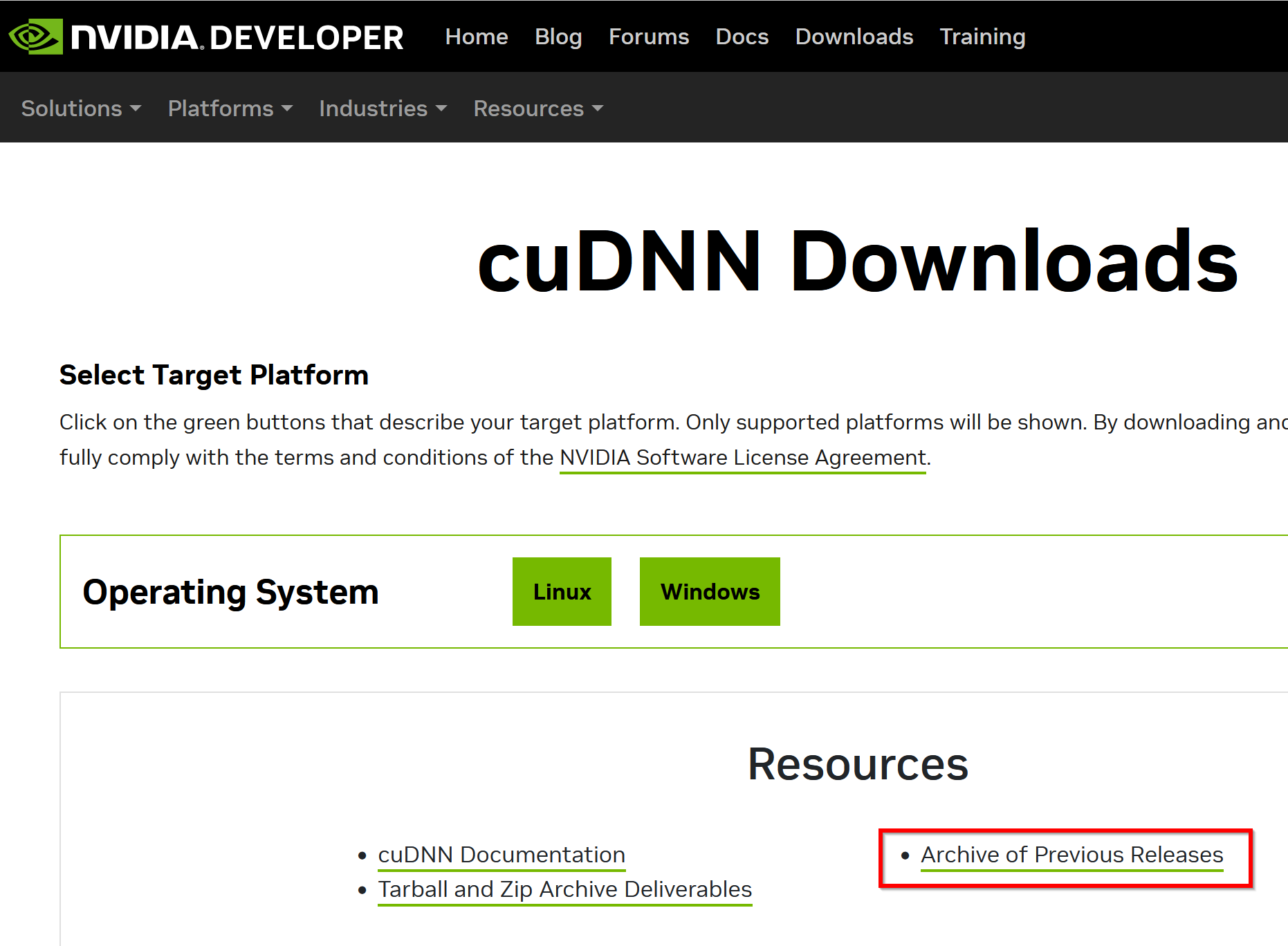

- cuDNN Downloads のページで「Archive of Previous Releases」をクリック

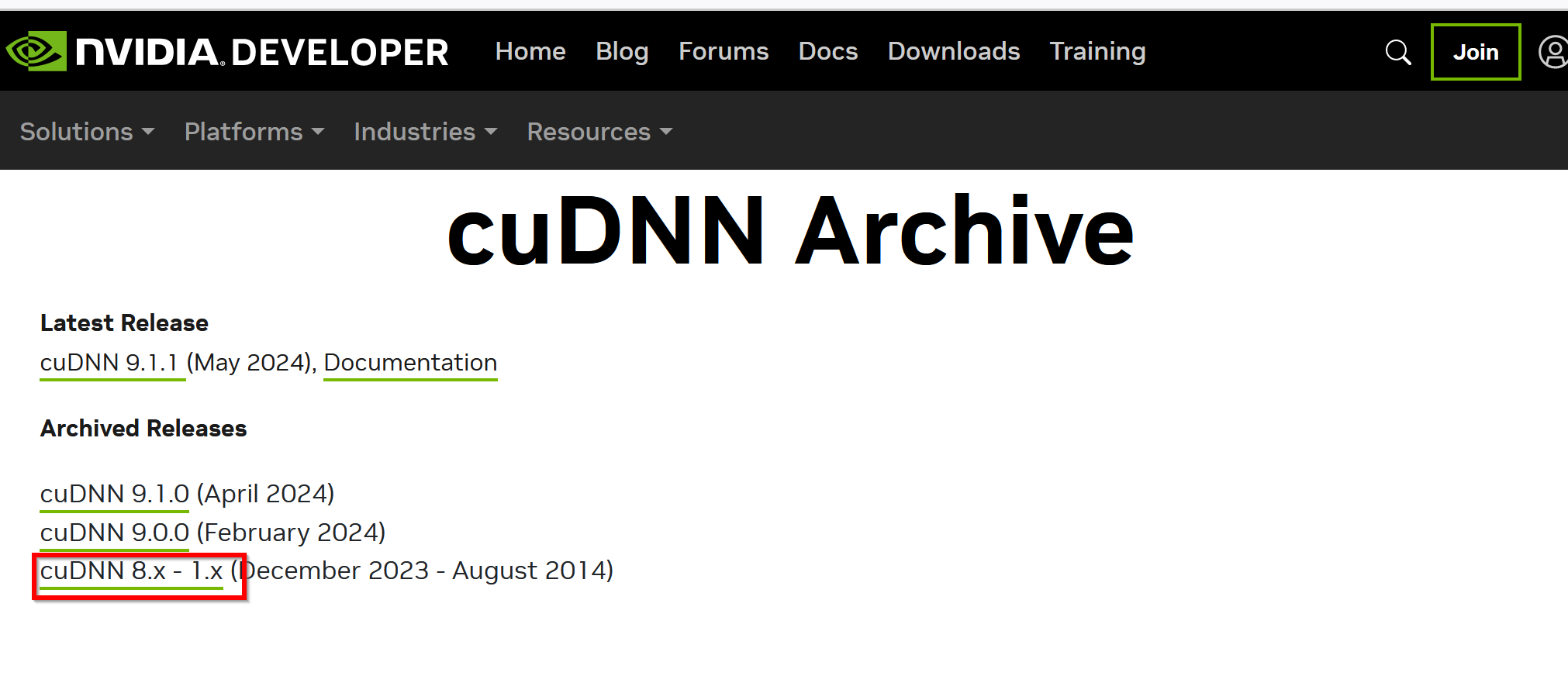

- 「cuDNN 8.x - 1.x」をクリック

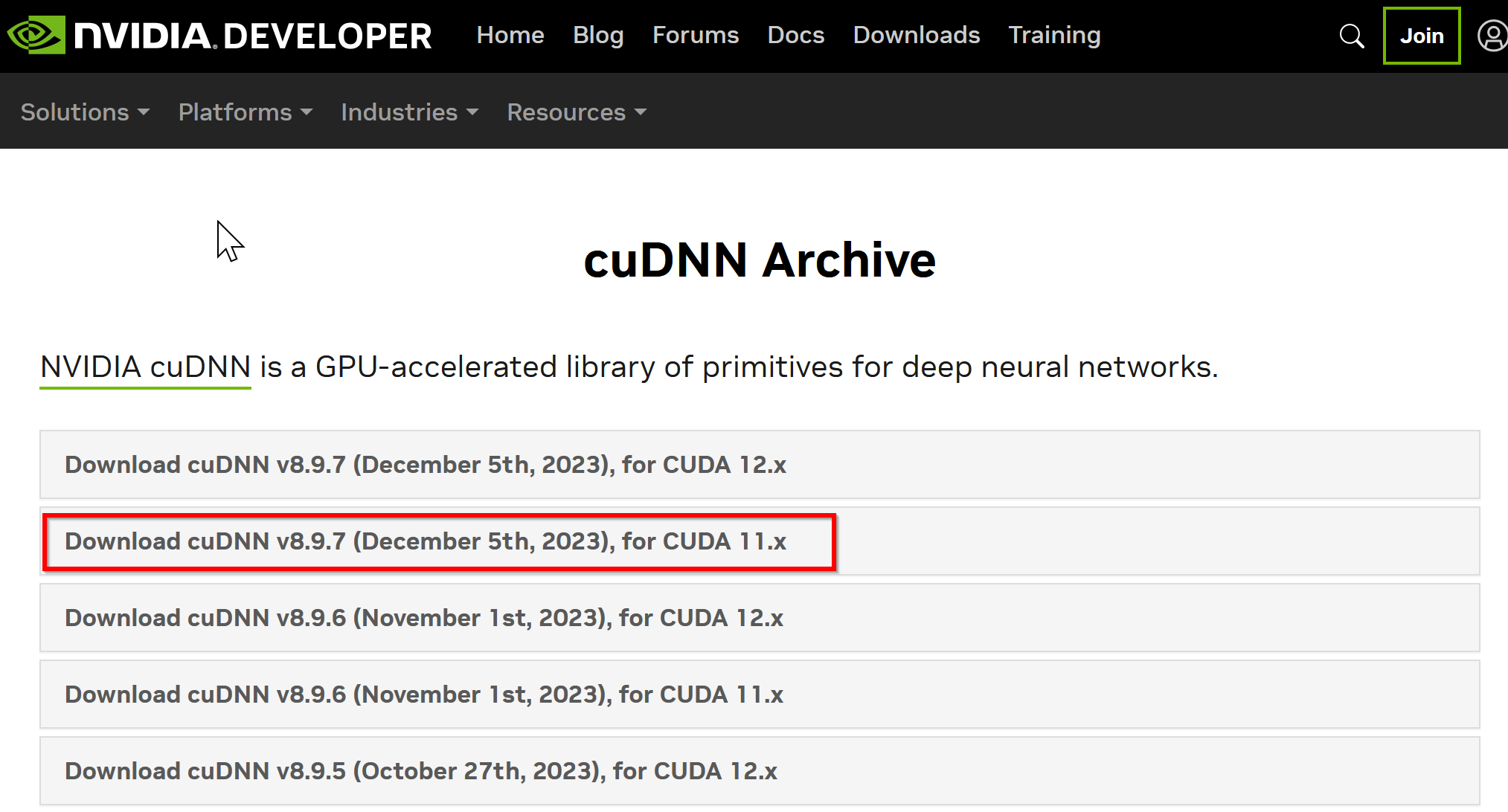

- ダウンロードしたいバージョンを選ぶ

ここでは「NVIDIA cuDNN v8.9.7 for CUDA 11.x」を選んでいる.

このとき,画面の「for CUDA ...」のところを確認し,使用するNVIDIA CUDA のバージョンに合うものを選ぶこと.

- Windows にインストールするので Windows 版を選ぶ

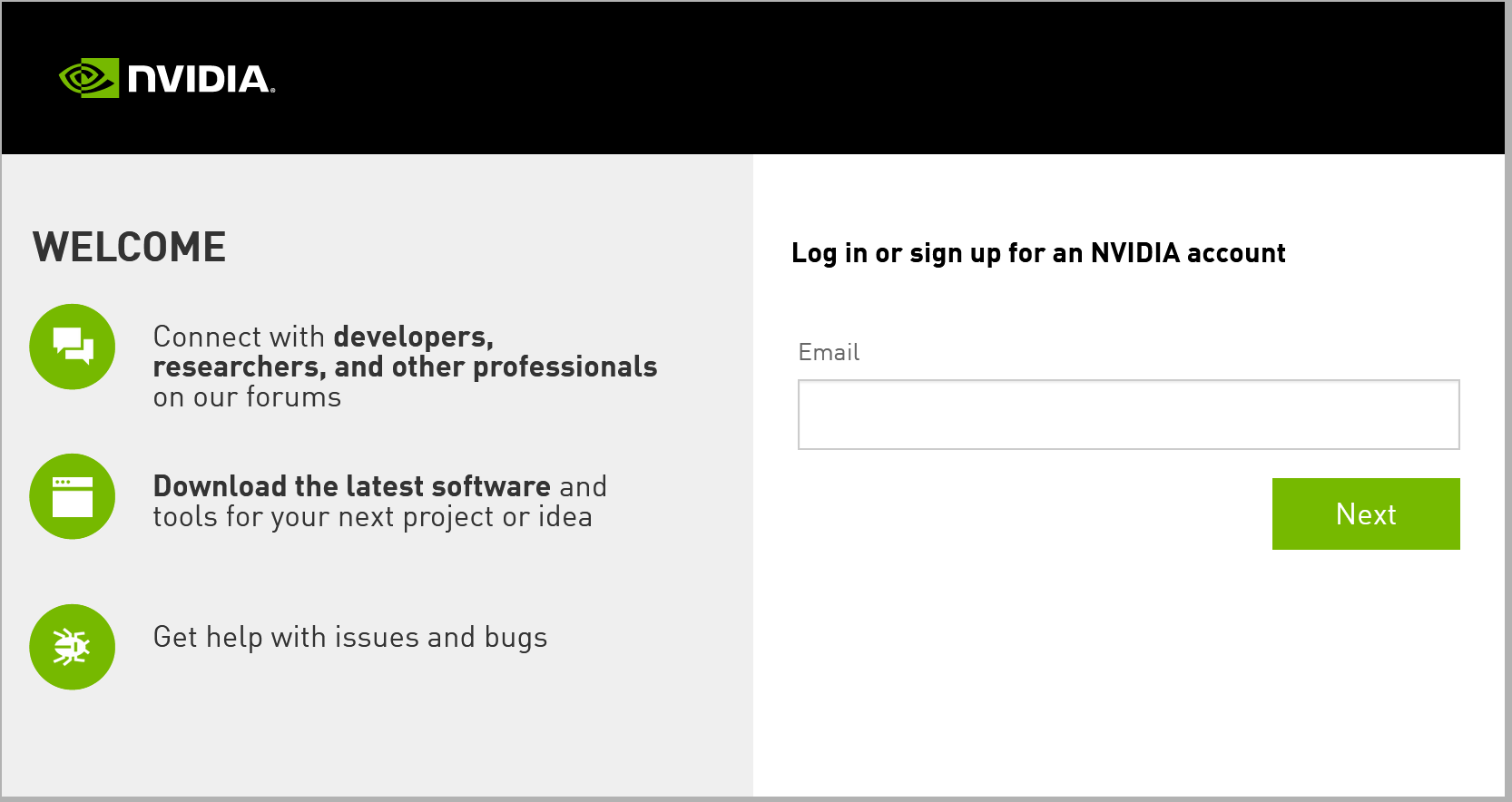

- NVIDIA Developer Program メンバーシップに入る

NVIDIA cuDNN のダウンロードのため.

「Join now」をクリック.その後,画面の指示に従う. 利用者本人が,電子メールアドレス,表示名,パスワード,生年月日を登録.利用条件等に合意.

- ログインする

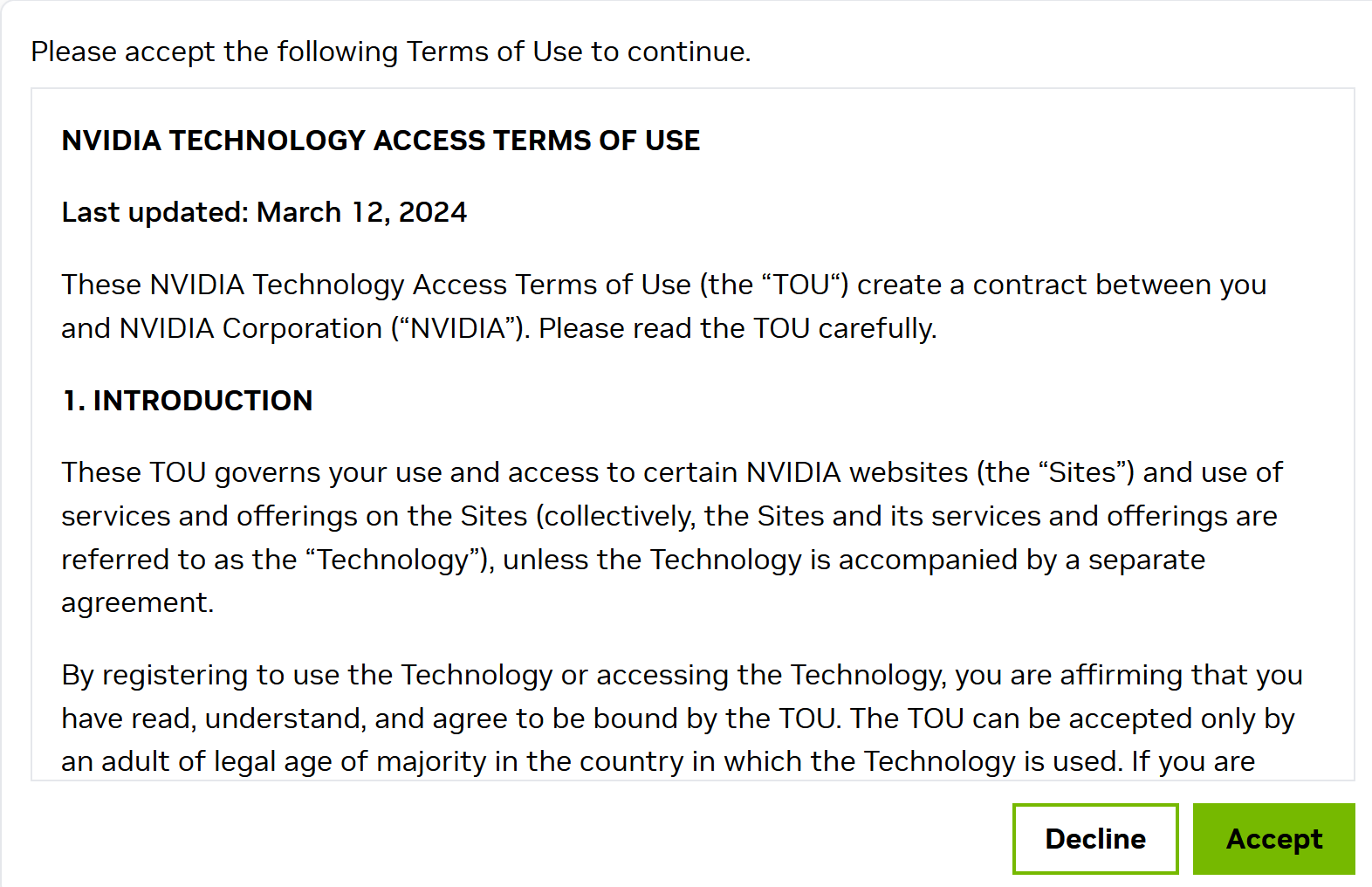

- 調査の画面が出たときは,調査に応じる

- ライセンス条項の確認

- ダウンロードが始まる.

- ダウンロードした .zip ファイルを展開(解凍)する.

その中のサブディレクトリを確認しておく.

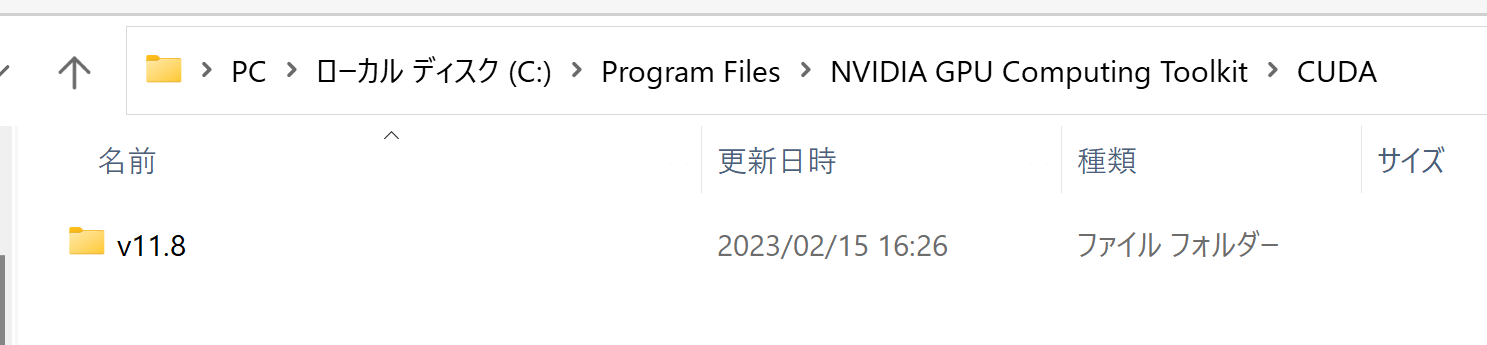

- NVIDIA CUDA ツールキットをインストールしたディレクトリを確認する.「C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8」のようになっている.

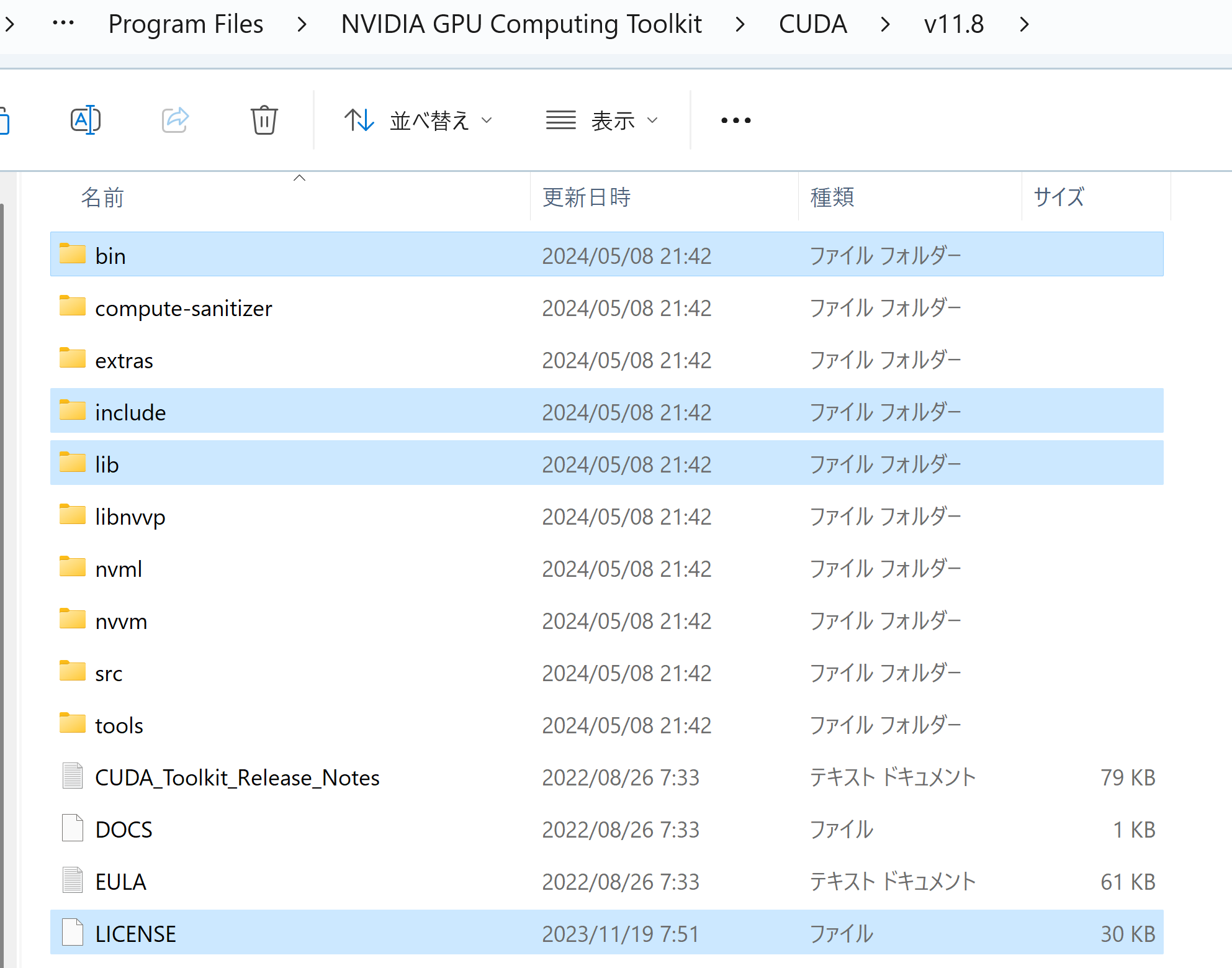

- 確認したら,

さきほど展開してできたすべてのファイルとディレクトリを,NVIDIA CUDA ツールキットをインストールしたディレクトリにコピーする

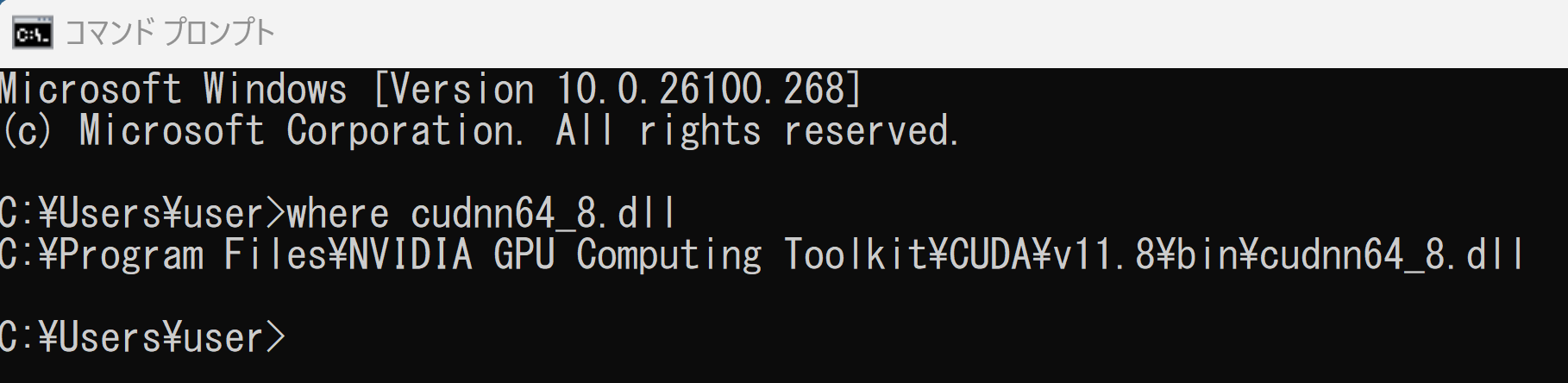

- パスが通っていることを確認.

次の操作により,cudnn64_8.dll にパスが通っていることを確認する.

Windows のコマンドプロンプトを開き,次のコマンドを実行する.エラーメッセージが出ないことを確認.

where cudnn64_8.dll

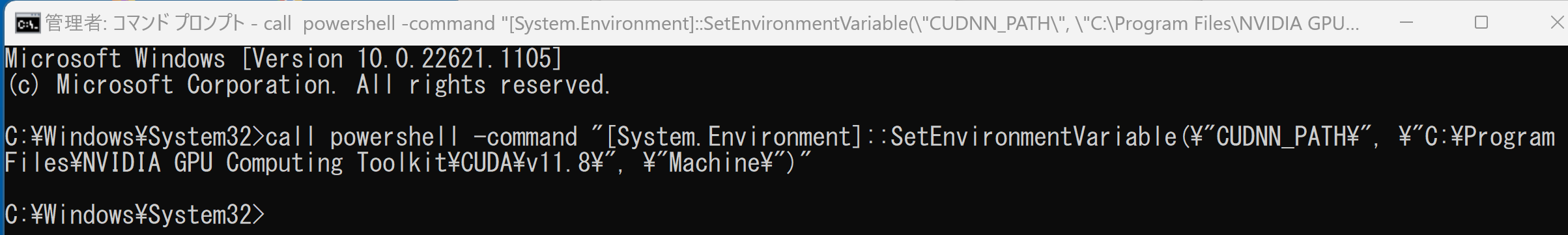

- Windows の システム環境変数 CUDNN_PATH の設定を行う.

Windows では,

コマンドプロンプトを管理者として開き,

次のコマンドを実行することにより,

システム環境変数 CUDNN_PATH の設定を行うことができる.

コマンドプロンプトを管理者として実行: 別ページ »で説明

powershell -command "[System.Environment]::SetEnvironmentVariable(\"CUDNN_PATH\", \"C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\", \"Machine\")"

TensorFlow 2.10.1 のインストール(Windows 上)

- 以下の手順を管理者権限のコマンドプロンプトで実行する

(手順:Windowsキーまたはスタートメニュー →

cmdと入力 → 右クリック → 「管理者として実行」)。 - TensorFlow 2.10.1 のインストール(Windows 上)

次のコマンドを実行することにより,TensorFlow 2.10.1 および関連パッケージ(tf_slim,tensorflow_datasets,tensorflow-hub,Keras,keras-tuner,keras-visualizer)がインストール(インストール済みのときは最新版に更新)される. そして,Pythonライブラリ(Pillow, pydot, matplotlib, seaborn, pandas, scipy, scikit-learn, scikit-learn-intelex, opencv-python, opencv-contrib-python)がインストール(インストール済みのときは最新版に更新)される.

python -m pip uninstall -y protobuf tensorflow tensorflow-cpu tensorflow-gpu tensorflow-intel tensorflow-text tensorflow-estimator tf-models-official tf_slim tensorflow_datasets tensorflow-hub keras keras-tuner keras-visualizer python -m pip install -U protobuf tensorflow==2.10.1 tf_slim tensorflow_datasets==4.8.3 tensorflow-hub tf-keras keras keras_cv keras-tuner keras-visualizer python -m pip install git+https://github.com/tensorflow/docs python -m pip install git+https://github.com/tensorflow/examples.git python -m pip install git+https://www.github.com/keras-team/keras-contrib.git python -m pip install -U pillow pydot matplotlib seaborn pandas scipy scikit-learn scikit-learn-intelex opencv-python opencv-contrib-python

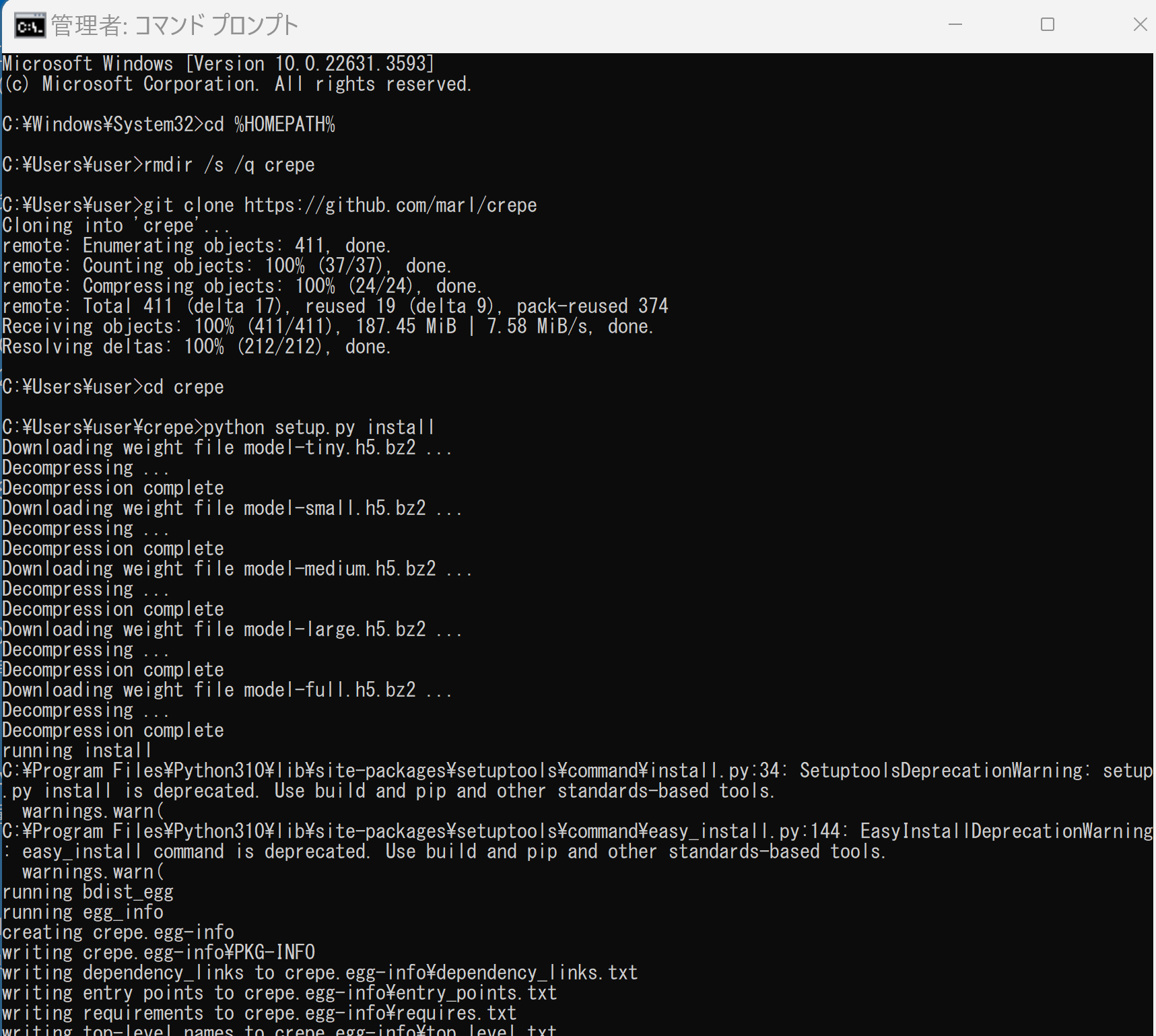

crepe のインストールとテスト実行(Windows 上)

- 以下の手順を管理者権限のコマンドプロンプトで実行する

(手順:Windowsキーまたはスタートメニュー →

cmdと入力 → 右クリック → 「管理者として実行」)。 - crepe のインストール

* 「 python -m pip install ...」は,Pythonのライブラリをインストールするためのコマンド.

cd /d c:%HOMEPATH% rmdir /s /q crepe git clone https://github.com/marl/crepe cd crepe python setup.py install

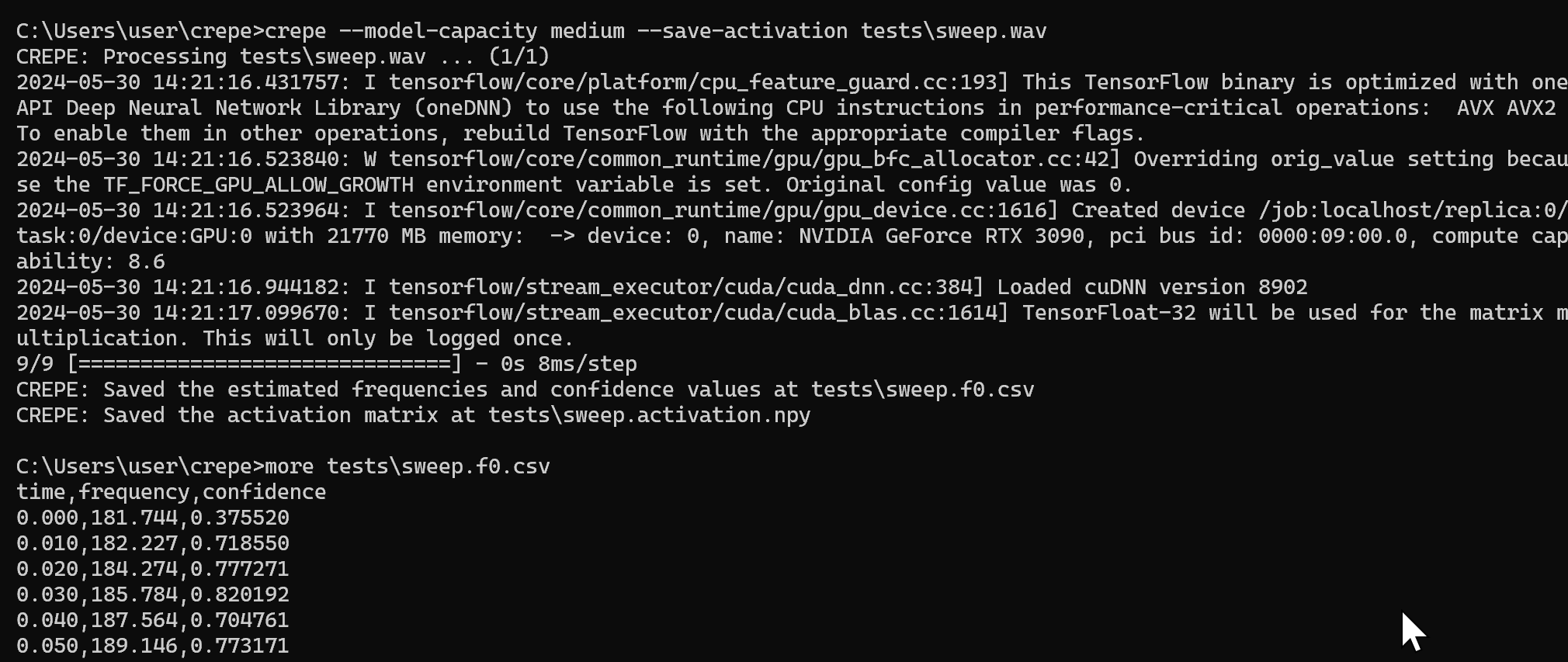

- 動作確認のため,ピッチ推定を行ってみる

crepe --model-capacity medium --save-activation tests\sweep.wav more tests\sweep.f0.csv

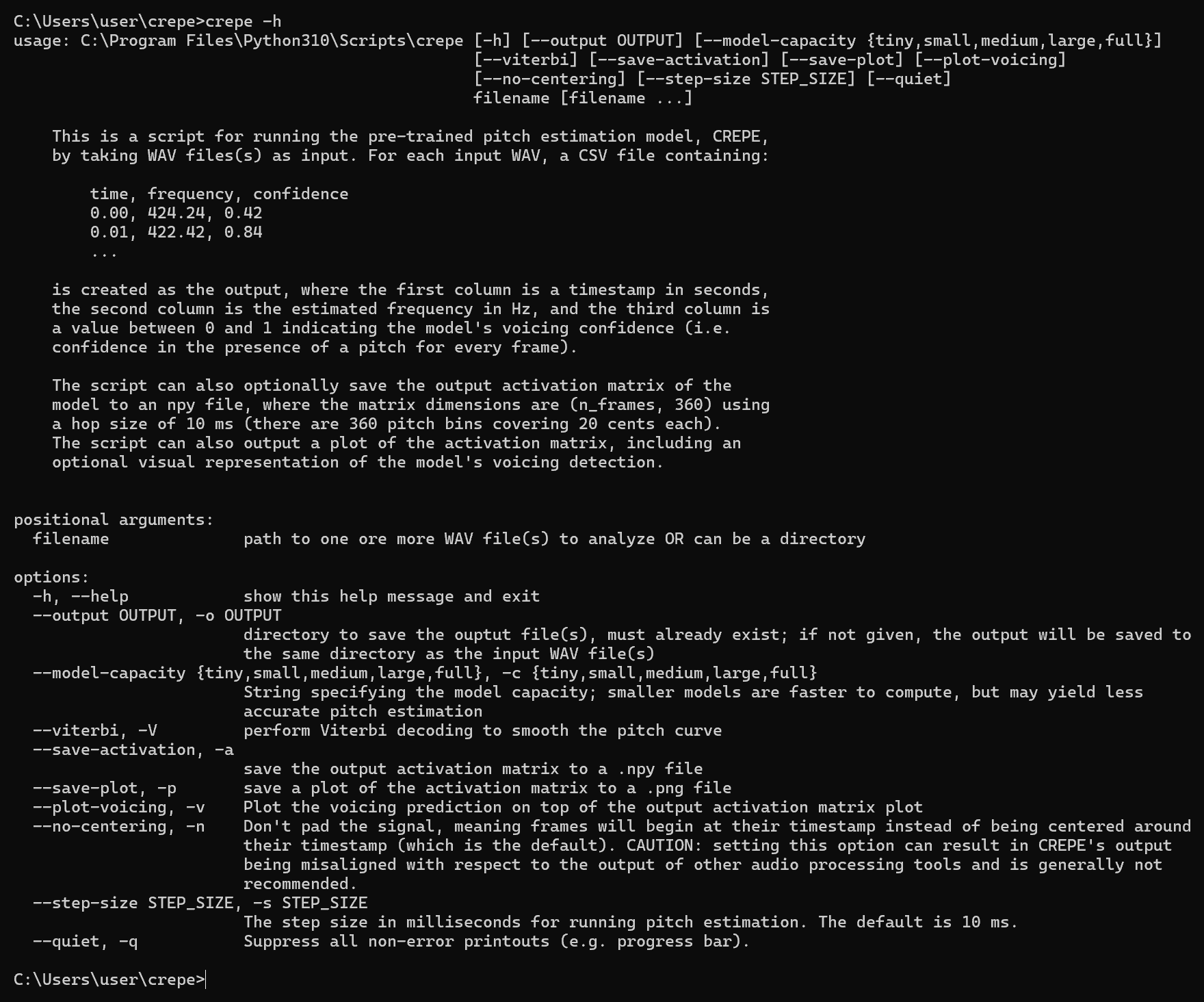

- 「crepe -h」 を実行することにより,説明が表示される.

CREPE のプログラム

プログラム1つめ

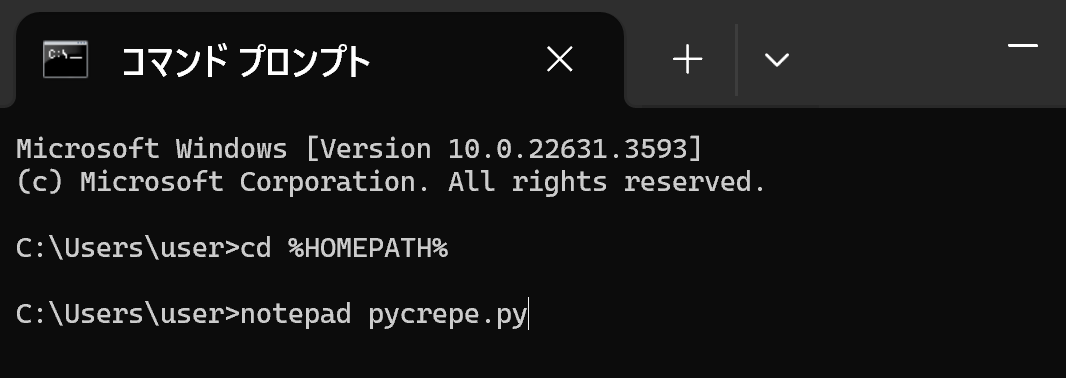

- Windows で,コマンドプロンプトを実行

- エディタを起動

cd /d c:%HOMEPATH% notepad pycrepe.py

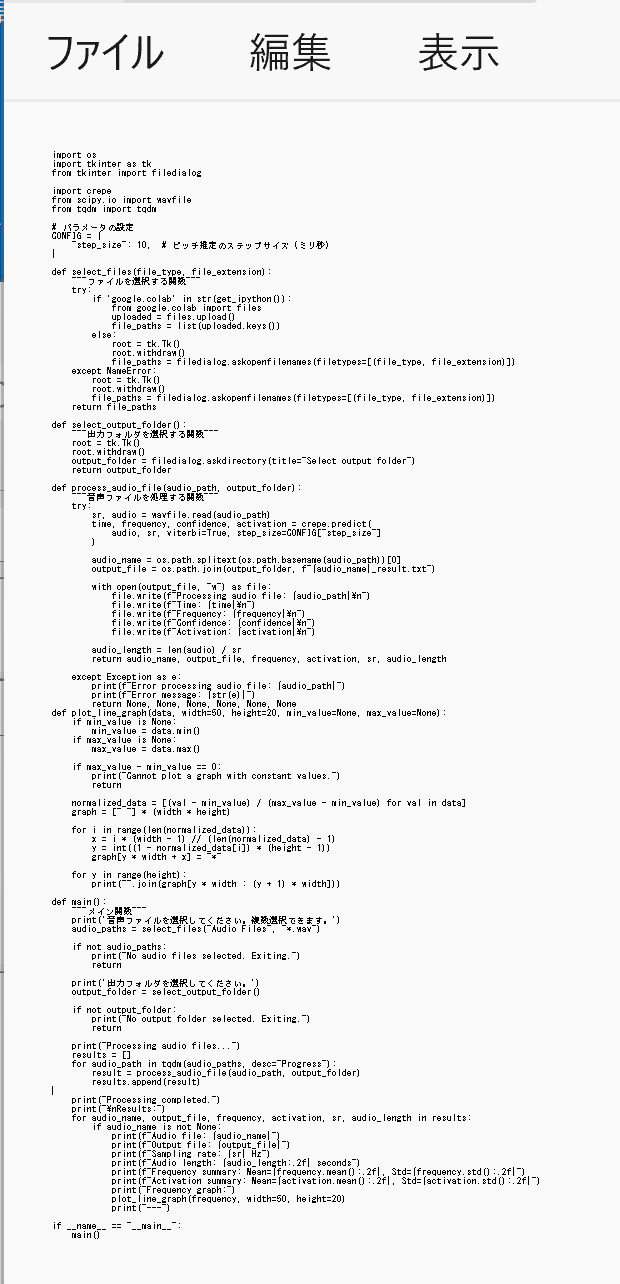

- エディタで,次のプログラムを保存

このPythonプログラムは,ユーザーが選択した音声ファイルを解析し,ピッチ情報を抽出する.結果は出力フォルダに保存され,周波数とアクティベーションの要約統計とグラフが表示される.音声処理にはオープンソースのcrepeライブラリを使用している.

【説明】

このプログラムは以下の主な機能を持っている.

- ユーザーが音声ファイル(WAV形式)を選択できる.

- 音声ファイルを処理し,ピッチ情報(時間,周波数,信頼度,アクティベーション)を抽出する.

- 抽出された情報を,指定された出力フォルダ内のテキストファイルに保存する.

- 周波数とアクティベーションの平均と標準偏差を計算し,画面に表示する.

- 周波数とアクティベーションのグラフを ASCII 文字で描画し,画面に表示する.

【使用法】

- プログラムを実行すると,「音声ファイルを選択してください.複数選択できます.」というメッセージが表示される.このとき,複数のファイルを選択することもできる.

- 「出力フォルダを選択してください.」というメッセージが表示される.結果を保存する出力フォルダを選択できる.

- 進捗状況がプログレスバーで表示される.

- 音声ファイル名,出力ファイルのパス,サンプリングレート,音声の長さ(秒),周波数の平均と標準偏差,アクティベーションの平均と標準偏差,周波数のグラフ(ASCII文字で描画)が表示される.

- 出力フォルダには,各音声ファイルの結果がテキストファイルで保存される.

import os import tkinter as tk from tkinter import filedialog import crepe from scipy.io import wavfile from tqdm import tqdm # パラメータの設定 CONFIG = { "step_size": 10, # ピッチ推定のステップサイズ(ミリ秒) } def select_files(file_type, file_extension): """ファイルを選択する関数""" try: if 'google.colab' in str(get_ipython()): from google.colab import files uploaded = files.upload() file_paths = list(uploaded.keys()) else: root = tk.Tk() root.withdraw() file_paths = filedialog.askopenfilenames(filetypes=[(file_type, file_extension)]) except NameError: root = tk.Tk() root.withdraw() file_paths = filedialog.askopenfilenames(filetypes=[(file_type, file_extension)]) return file_paths def select_output_folder(): """出力フォルダを選択する関数""" root = tk.Tk() root.withdraw() output_folder = filedialog.askdirectory(title="Select output folder") return output_folder def process_audio_file(audio_path, output_folder): """音声ファイルを処理する関数""" try: sr, audio = wavfile.read(audio_path) time, frequency, confidence, activation = crepe.predict( audio, sr, viterbi=True, step_size=CONFIG["step_size"] ) audio_name = os.path.splitext(os.path.basename(audio_path))[0] output_file = os.path.join(output_folder, f"{audio_name}_result.txt") with open(output_file, "w") as file: file.write(f"Processing audio file: {audio_path}\n") file.write(f"Time: {time}\n") file.write(f"Frequency: {frequency}\n") file.write(f"Confidence: {confidence}\n") file.write(f"Activation: {activation}\n") audio_length = len(audio) / sr return audio_name, output_file, frequency, activation, sr, audio_length except Exception as e: print(f"Error processing audio file: {audio_path}") print(f"Error message: {str(e)}") return None, None, None, None, None, None def plot_line_graph(data, width=50, height=20, min_value=None, max_value=None): if min_value is None: min_value = data.min() if max_value is None: max_value = data.max() if max_value - min_value == 0: print("Cannot plot a graph with constant values.") return normalized_data = [(val - min_value) / (max_value - min_value) for val in data] graph = [" "] * (width * height) for i in range(len(normalized_data)): x = i * (width - 1) // (len(normalized_data) - 1) y = int((1 - normalized_data[i]) * (height - 1)) graph[y * width + x] = "*" for y in range(height): print("".join(graph[y * width : (y + 1) * width])) def main(): """メイン関数""" print('音声ファイルを選択してください。複数選択できます。') audio_paths = select_files("Audio Files", "*.wav") if not audio_paths: print("No audio files selected. Exiting.") return print('出力フォルダを選択してください。') output_folder = select_output_folder() if not output_folder: print("No output folder selected. Exiting.") return print("Processing audio files...") results = [] for audio_path in tqdm(audio_paths, desc="Progress"): result = process_audio_file(audio_path, output_folder) results.append(result) print("Processing completed.") print("\nResults:") for audio_name, output_file, frequency, activation, sr, audio_length in results: if audio_name is not None: print(f"Audio file: {audio_name}") print(f"Output file: {output_file}") print(f"Sampling rate: {sr} Hz") print(f"Audio length: {audio_length:.2f} seconds") print(f"Frequency summary: Mean={frequency.mean():.2f}, Std={frequency.std():.2f}") print(f"Activation summary: Mean={activation.mean():.2f}, Std={activation.std():.2f}") print("Frequency graph:") plot_line_graph(frequency, width=50, height=20) print("---") if __name__ == "__main__": main()

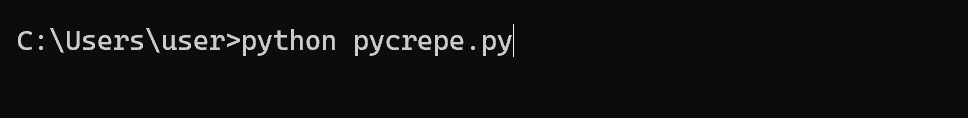

- Python プログラムの実行

プログラムを pycrepe.pyのようなファイル名で保存したので, 「python pycrepe.py」のようなコマンドで行う.

python pycrepe.py

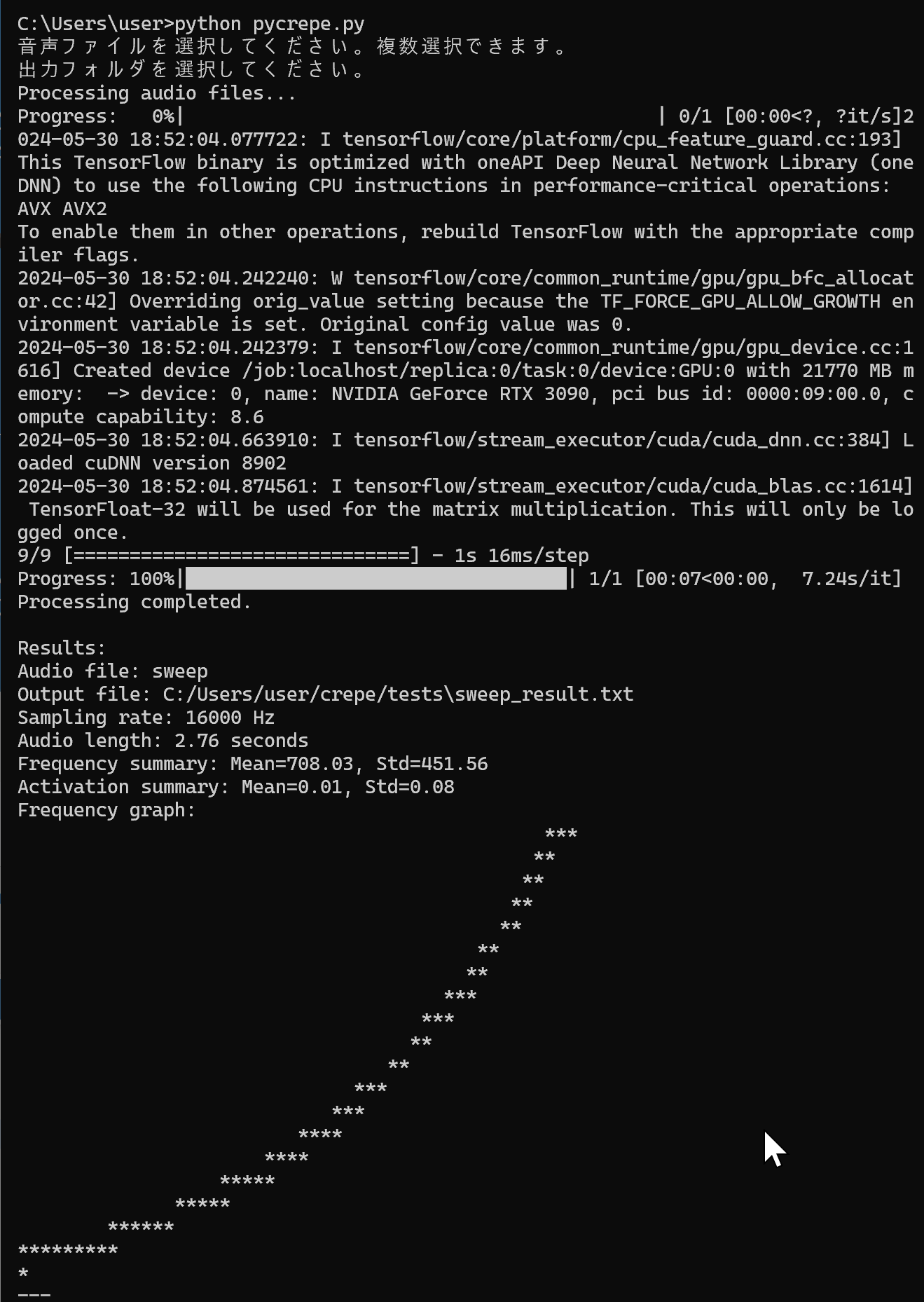

- ファイルダイアログが開くので,音声ファイルを選ぶ.

このとき,音声ファイルを複数選ぶことができる.

- 次に出力結果を保存するフォルダを選ぶ.

- 結果の確認

プログラム2つめ

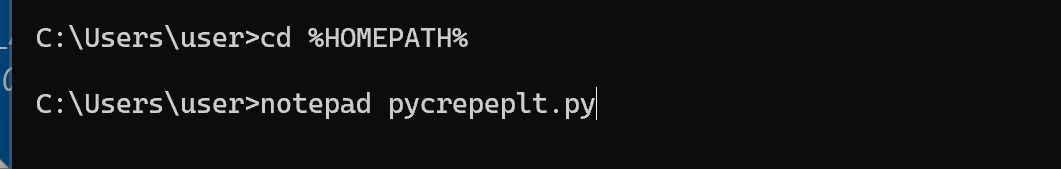

- Windows で,コマンドプロンプトを実行

- エディタを起動

cd /d c:%HOMEPATH% notepad pycrepeplt.py

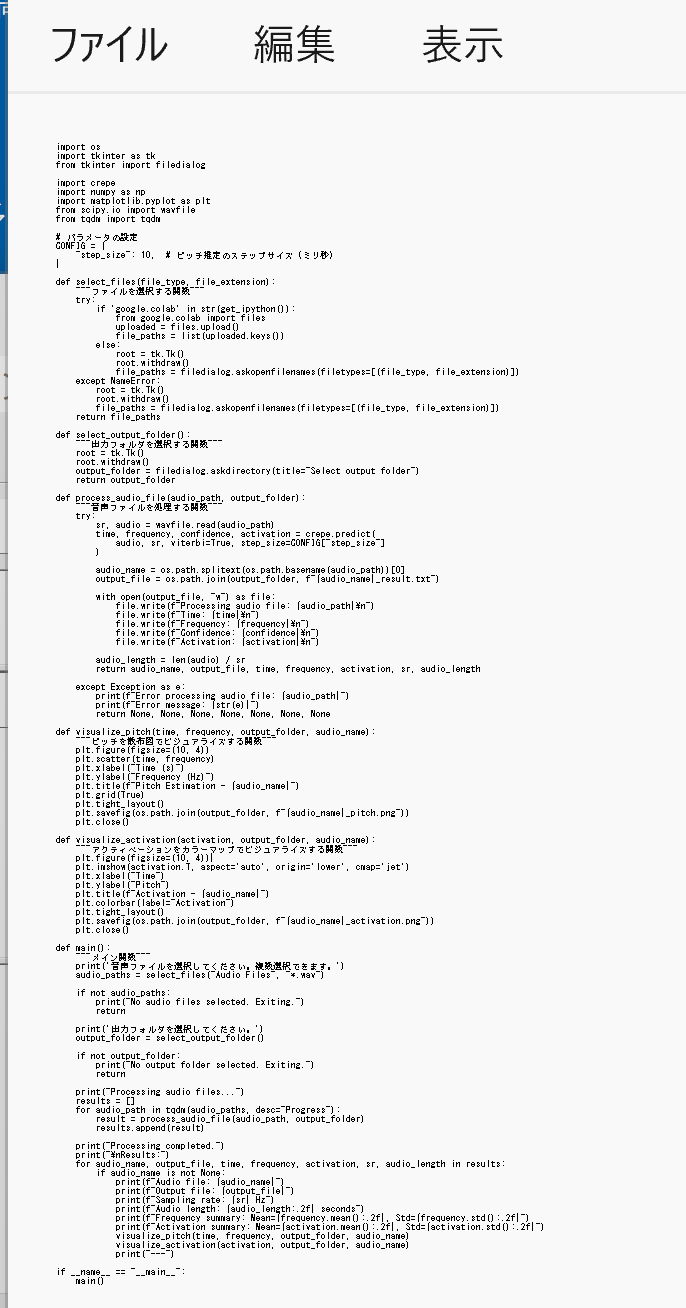

- エディタで,次のプログラムを保存

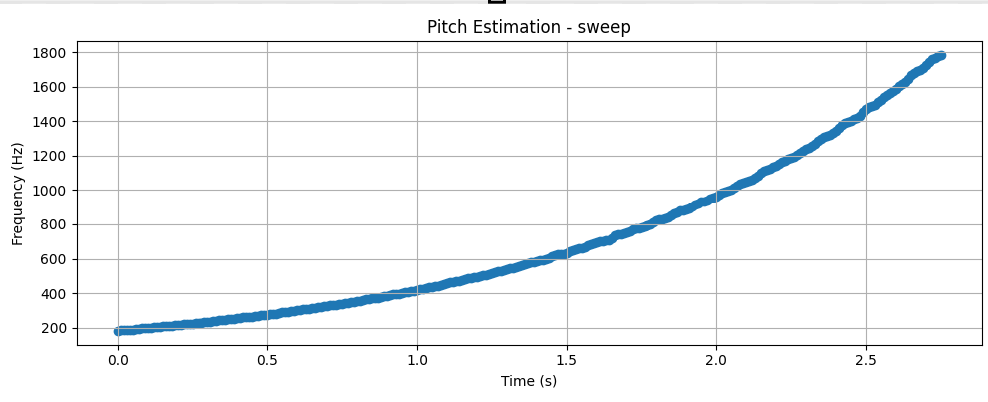

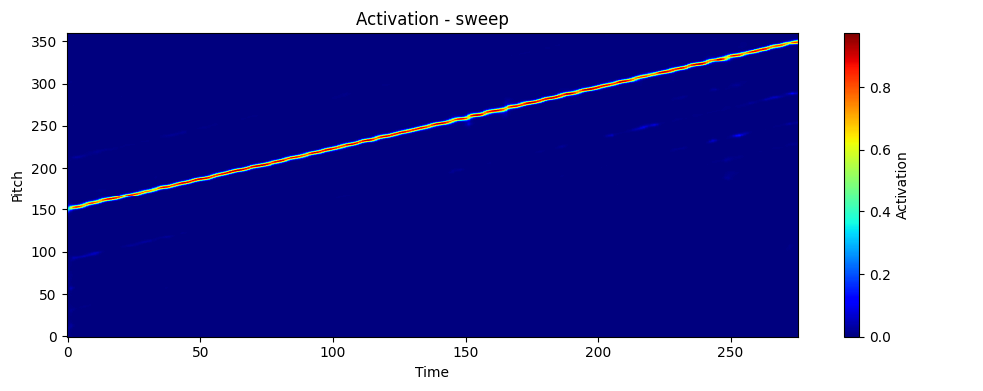

このPythonプログラムは,ユーザーが選択した音声ファイルを解析し,ピッチ情報を抽出する.結果は出力フォルダに保存され,周波数とアクティベーションの要約統計が表示される.さらに,ピッチの散布図とアクティベーションのカラーマップが生成される.音声処理にはオープンソースのcrepeライブラリを使用している.

【説明】

このプログラムは以下の主な機能を持っている.

- ユーザーが音声ファイル(WAV形式)を選択できる.

- 音声ファイルを処理し,ピッチ情報(時間,周波数,信頼度,アクティベーション)を抽出する.

- 抽出された情報を,指定された出力フォルダ内のテキストファイルに保存する.

- 周波数とアクティベーションの平均と標準偏差を計算し,画面に表示する.

- ピッチの散布図とアクティベーションのカラーマップを生成し,出力フォルダに保存する.

【使用法】

- プログラムを実行すると,「音声ファイルを選択してください.複数選択できます.」というメッセージが表示される.このとき,複数のファイルを選択することもできる.

- 「出力フォルダを選択してください.」というメッセージが表示される.結果を保存する出力フォルダを選択できる.

- 進捗状況がプログレスバーで表示される.

- 音声ファイル名,出力ファイルのパス,サンプリングレート,音声の長さ(秒),周波数の平均と標準偏差,アクティベーションの平均と標準偏差が表示される.

- 出力フォルダには,各音声ファイルの結果がテキストファイルで保存される.

- 出力フォルダには,各音声ファイルのピッチの散布図とアクティベーションのカラーマップが画像ファイルで保存される.

import os import tkinter as tk from tkinter import filedialog import crepe import numpy as np import matplotlib.pyplot as plt from scipy.io import wavfile from tqdm import tqdm # パラメータの設定 CONFIG = { "step_size": 10, # ピッチ推定のステップサイズ(ミリ秒) } def select_files(file_type, file_extension): """ファイルを選択する関数""" try: if 'google.colab' in str(get_ipython()): from google.colab import files uploaded = files.upload() file_paths = list(uploaded.keys()) else: root = tk.Tk() root.withdraw() file_paths = filedialog.askopenfilenames(filetypes=[(file_type, file_extension)]) except NameError: root = tk.Tk() root.withdraw() file_paths = filedialog.askopenfilenames(filetypes=[(file_type, file_extension)]) return file_paths def select_output_folder(): """出力フォルダを選択する関数""" root = tk.Tk() root.withdraw() output_folder = filedialog.askdirectory(title="Select output folder") return output_folder def process_audio_file(audio_path, output_folder): """音声ファイルを処理する関数""" try: sr, audio = wavfile.read(audio_path) time, frequency, confidence, activation = crepe.predict( audio, sr, viterbi=True, step_size=CONFIG["step_size"] ) audio_name = os.path.splitext(os.path.basename(audio_path))[0] output_file = os.path.join(output_folder, f"{audio_name}_result.txt") with open(output_file, "w") as file: file.write(f"Processing audio file: {audio_path}\n") file.write(f"Time: {time}\n") file.write(f"Frequency: {frequency}\n") file.write(f"Confidence: {confidence}\n") file.write(f"Activation: {activation}\n") audio_length = len(audio) / sr return audio_name, output_file, time, frequency, activation, sr, audio_length except Exception as e: print(f"Error processing audio file: {audio_path}") print(f"Error message: {str(e)}") return None, None, None, None, None, None, None def visualize_pitch(time, frequency, output_folder, audio_name): """ピッチを散布図でビジュアライズする関数""" plt.figure(figsize=(10, 4)) plt.scatter(time, frequency) plt.xlabel("Time (s)") plt.ylabel("Frequency (Hz)") plt.title(f"Pitch Estimation - {audio_name}") plt.grid(True) plt.tight_layout() plt.savefig(os.path.join(output_folder, f"{audio_name}_pitch.png")) plt.close() def visualize_activation(activation, output_folder, audio_name): """アクティベーションをカラーマップでビジュアライズする関数""" plt.figure(figsize=(10, 4)) plt.imshow(activation.T, aspect='auto', origin='lower', cmap='jet') plt.xlabel("Time") plt.ylabel("Pitch") plt.title(f"Activation - {audio_name}") plt.colorbar(label="Activation") plt.tight_layout() plt.savefig(os.path.join(output_folder, f"{audio_name}_activation.png")) plt.close() def main(): """メイン関数""" print('音声ファイルを選択してください。複数選択できます。') audio_paths = select_files("Audio Files", "*.wav") if not audio_paths: print("No audio files selected. Exiting.") return print('出力フォルダを選択してください。') output_folder = select_output_folder() if not output_folder: print("No output folder selected. Exiting.") return print("Processing audio files...") results = [] for audio_path in tqdm(audio_paths, desc="Progress"): result = process_audio_file(audio_path, output_folder) results.append(result) print("Processing completed.") print("\nResults:") for audio_name, output_file, time, frequency, activation, sr, audio_length in results: if audio_name is not None: print(f"Audio file: {audio_name}") print(f"Output file: {output_file}") print(f"Sampling rate: {sr} Hz") print(f"Audio length: {audio_length:.2f} seconds") print(f"Frequency summary: Mean={frequency.mean():.2f}, Std={frequency.std():.2f}") print(f"Activation summary: Mean={activation.mean():.2f}, Std={activation.std():.2f}") visualize_pitch(time, frequency, output_folder, audio_name) visualize_activation(activation, output_folder, audio_name) print("---") if __name__ == "__main__": main()

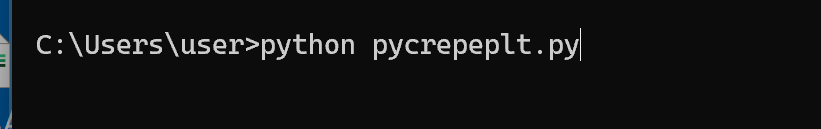

- Python プログラムの実行

プログラムを pycrepeplt.pyのようなファイル名で保存したので, 「python pycrepeplt.py」のようなコマンドで行う.

python pycrepeplt.py

- ファイルダイアログが開くので,音声ファイルを選ぶ.

このとき,音声ファイルを複数選ぶことができる.

- 次に出力結果を保存するフォルダを選ぶ.

- 結果の確認

指定した「出力結果を保存するフォルダ」に png 形式の画像ファイルができるので確認.

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)