CIFAR10, CIFAR100, MNIST, Fashion MNIST データセットの主成分分析プロット(Python, matplotlib, seaborn を使用)

1. サマリー

Keras に付属のデータセットの主成分分析を行い,第1主成分スコアと第2主成分スコアをプロットする.対象データセットは CIFAR10,CIFAR100,MNIST,Fashion MNIST の4種類である.tensorflow_datasets によるデータのロード,scikit-learn による主成分分析(PCA),seaborn および matplotlib による散布図の描画を行い,各主成分の寄与率および累積寄与率を出力する.

【関連する外部ページ】

Keras に付属のデータセットに関する Web ページ: https://keras.io/api/datasets/

Google Colaboratory のページ:

https://colab.research.google.com/drive/1Blm3l62DN_4dqUoltwhq-sdtsfr7ZaiU?usp=sharing

2. 前準備(必要ソフトウェアの入手)

ここでは、最低限の事前準備について説明する。機械学習や深層学習を行う場合は、NVIDIA CUDA、Visual Studio、Cursorなどを追加でインストールすると便利である。これらについては別ページ https://www.kkaneko.jp/cc/dev/aiassist.htmlで詳しく解説しているので、必要に応じて参照してください。

Python 3.12 のインストール(Windows 上) [クリックして展開]

以下のいずれかの方法で Python 3.12 をインストールする。Python がインストール済みの場合、この手順は不要である。

方法1:winget によるインストール

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --id Python.Python.3.12 -e --scope machine --silent --accept-source-agreements --accept-package-agreements --override "/quiet InstallAllUsers=1 PrependPath=1 Include_test=0 Include_pip=1 Include_launcher=1 InstallLauncherAllUsers=1 TargetDir=\"C:\Program Files\Python312\""

powershell -Command "$p='C:\Program Files\Python312'; $s=\"$p\Scripts\"; $m=[Environment]::GetEnvironmentVariable('Path','Machine'); if($m -notlike \"*$s*\") { [Environment]::SetEnvironmentVariable('Path', \"$p;$s;$m\", 'Machine') }"--scope machine を指定することで、システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後、コマンドプロンプトを再起動すると PATH が自動的に設定される。

方法2:インストーラーによるインストール

- Python 公式サイト(https://www.python.org/downloads/)にアクセスし、「Download Python 3.x.x」ボタンから Windows 用インストーラーをダウンロードする。

- ダウンロードしたインストーラーを実行する。

- 初期画面の下部に表示される「Add python.exe to PATH」に必ずチェックを入れてから「Customize installation」を選択する。このチェックを入れ忘れると、コマンドプロンプトから

pythonコマンドを実行できない。 - 「Install Python 3.xx for all users」にチェックを入れ、「Install」をクリックする。

インストールの確認

コマンドプロンプトで以下を実行する。

python --versionバージョン番号(例:Python 3.12.x)が表示されればインストール成功である。「'python' は、内部コマンドまたは外部コマンドとして認識されていません。」と表示される場合は、インストールが正常に完了していない。

AIエディタ Windsurf のインストール(Windows 上) [クリックして展開]

Pythonプログラムの編集・実行には、AIエディタの利用を推奨する。ここでは、Windsurfのインストールを説明する。Windsurf がインストール済みの場合、この手順は不要である。

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

winget install --scope machine --id Codeium.Windsurf -e --silent --disable-interactivity --force --accept-source-agreements --accept-package-agreements --custom "/SP- /SUPPRESSMSGBOXES /NORESTART /CLOSEAPPLICATIONS /DIR=""C:\Program Files\Windsurf"" /MERGETASKS=!runcode,addtopath,associatewithfiles,!desktopicon"

powershell -Command "$env:Path=[System.Environment]::GetEnvironmentVariable('Path','Machine')+';'+[System.Environment]::GetEnvironmentVariable('Path','User'); windsurf --install-extension MS-CEINTL.vscode-language-pack-ja --force; windsurf --install-extension ms-python.python --force; windsurf --install-extension Codeium.windsurfPyright --force"--scope machine を指定することで、システム全体(全ユーザー向け)にインストールされる。このオプションの実行には管理者権限が必要である。インストール完了後、コマンドプロンプトを再起動すると PATH が自動的に設定される。

【関連する外部ページ】

Windsurf の公式ページ: https://windsurf.com/

TensorFlow,tensorflow_datasets のインストール [クリックして展開]

Windows で pip を実行するときは,管理者権限のコマンドプロンプトを使用し,システム領域へのインストールを行う.

python -m pip uninstall -y tensorflow tensorflow-cpu tensorflow-gpu tensorflow-intel tensorflow-text tensorflow-estimator tf-models-official tf_slim tensorflow_datasets tensorflow-hub keras keras-tuner keras-visualizer

python -m pip install -U tensorflow tensorflow_datasets

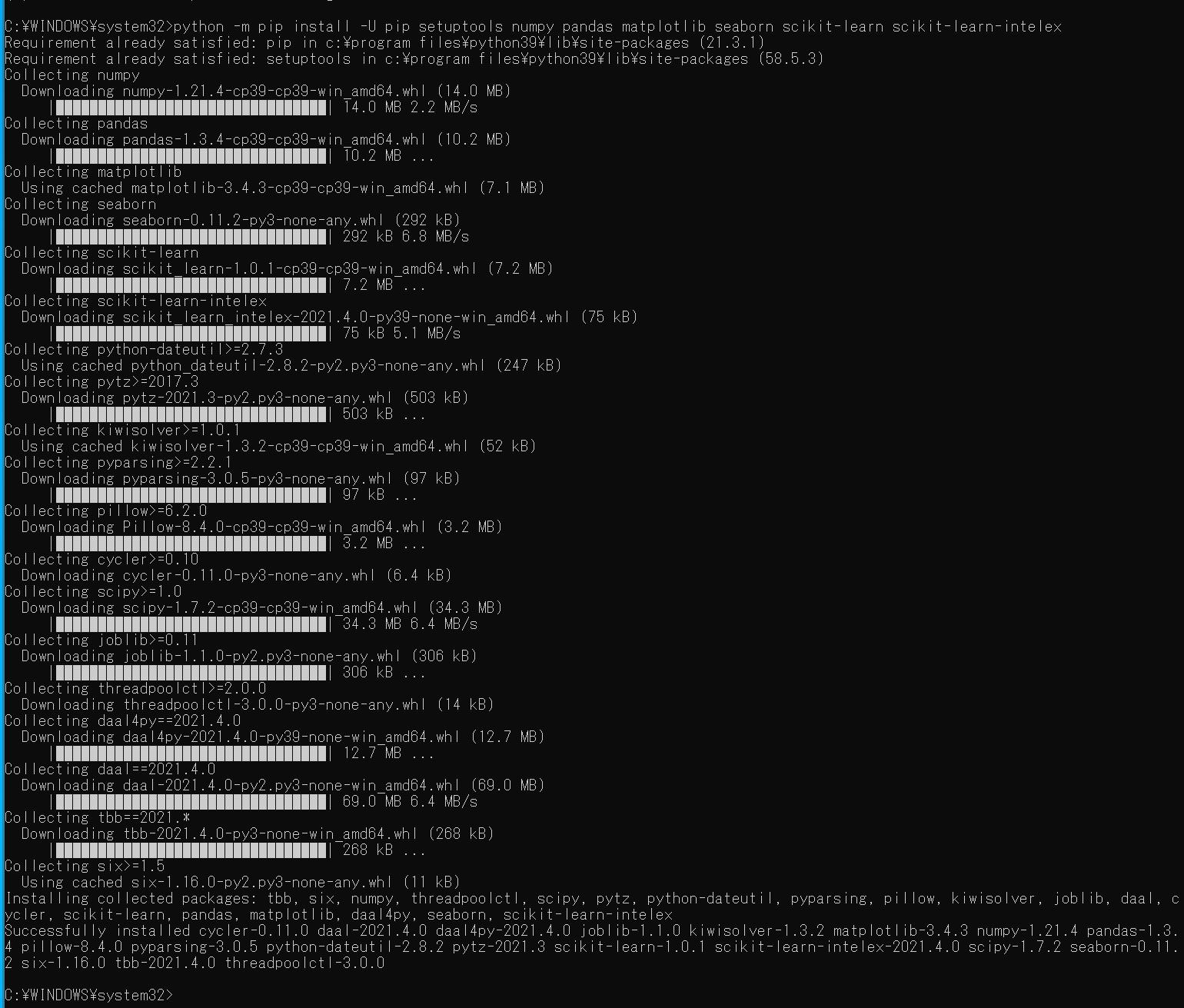

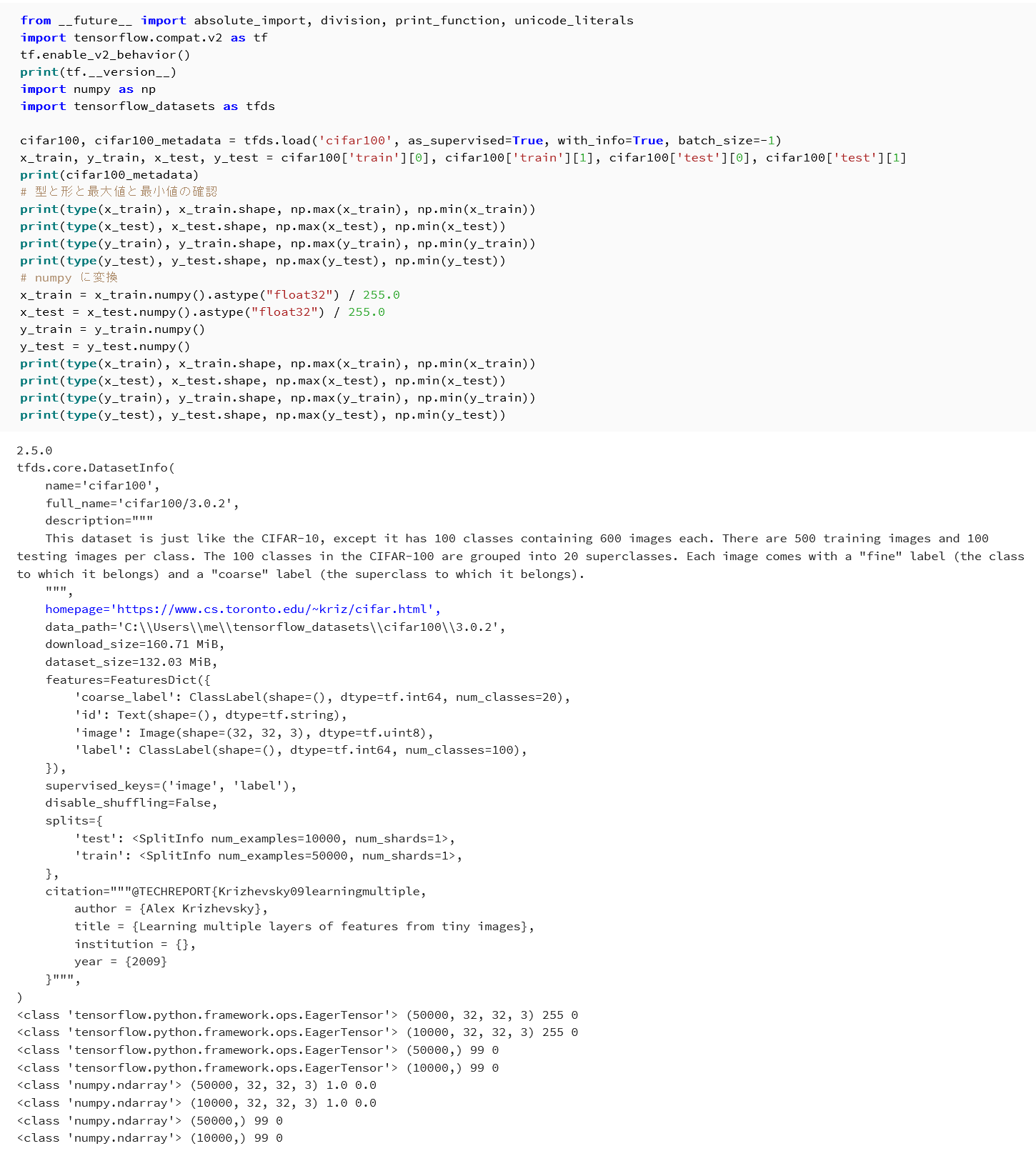

numpy, pandas, seaborn, matplotlib, scikit-learn のインストール [クリックして展開]

管理者権限のコマンドプロンプトで以下を実行する。管理者権限のコマンドプロンプトを起動するには、Windows キーまたはスタートメニューから「cmd」と入力し、表示された「コマンドプロンプト」を右クリックして「管理者として実行」を選択する。

python -m pip install -U pip setuptools numpy pandas matplotlib seaborn scikit-learn scikit-learn-intelex

3. 実行のための準備とその確認手順(Windows 前提)

3.1 プログラムファイルの準備

本記事のコードは Jupyter Notebook(.ipynb)形式での実行を前提としている.以下のいずれかの方法で準備する.

方法1:Google Colaboratory を使用する場合

第1章に掲載した Google Colaboratory のリンクからノートブックを開き,Google アカウントでログインする.

方法2:ローカル環境で Jupyter Notebook を使用する場合

第5章のソースコードを Jupyter Notebook 上で順番にセルへ入力する.または,テキストエディタ(メモ帳,Windsurf 等)で pca_plot.py として保存し(文字コード:UTF-8),%matplotlib inline の行を削除したうえで Python スクリプトとして実行する.

3.2 実行コマンド

Google Colaboratory または Jupyter Notebook を使用する場合は,各セルを上から順に Shift+Enter で実行する.

Python スクリプトとして実行する場合は,コマンドプロンプトでファイルの保存先ディレクトリに移動し,以下を実行する.

python pca_plot.py3.3 動作確認チェックリスト

| 確認項目 | 期待される結果 |

|---|---|

| 前準備セル(インポートと関数定義)の実行 | エラーなく完了し,prin,pcaplot,load_dataset の各関数が定義される |

| CIFAR10 データセットのロード | メタデータ,x_train, x_test, y_train, y_test の型・形状・最大値・最小値が表示される |

| CIFAR10 の主成分分析プロット | フラット化後の形状が表示され,10クラスの色分け散布図と寄与率が出力される |

| CIFAR100 データセットのロード | メタデータ,x_train, x_test, y_train, y_test の型・形状・最大値・最小値が表示される |

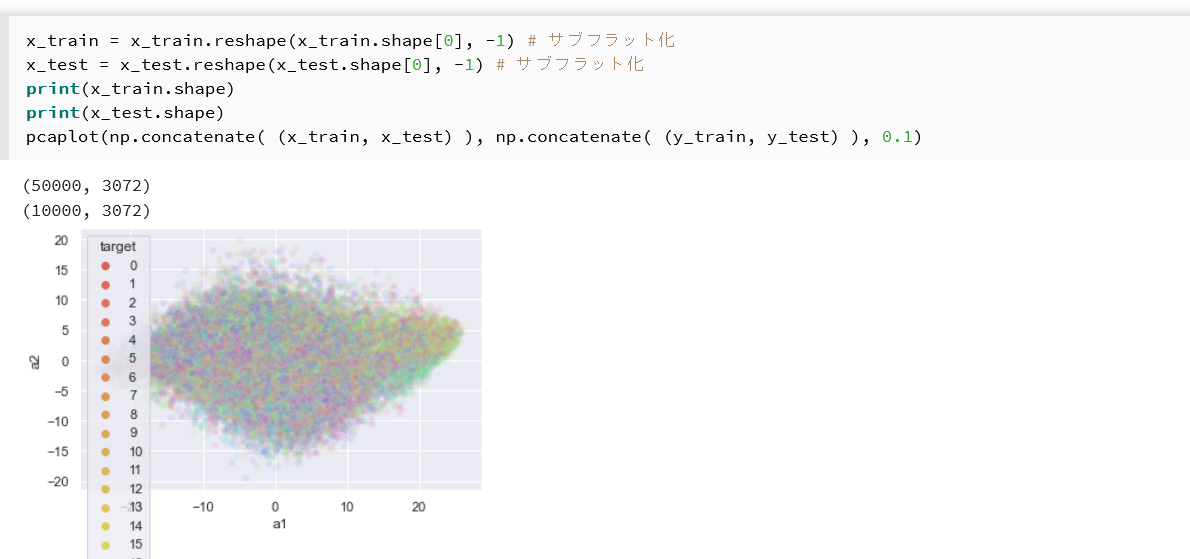

| CIFAR100 の主成分分析プロット | フラット化後の形状が表示され,100クラスの色分け散布図と寄与率が出力される |

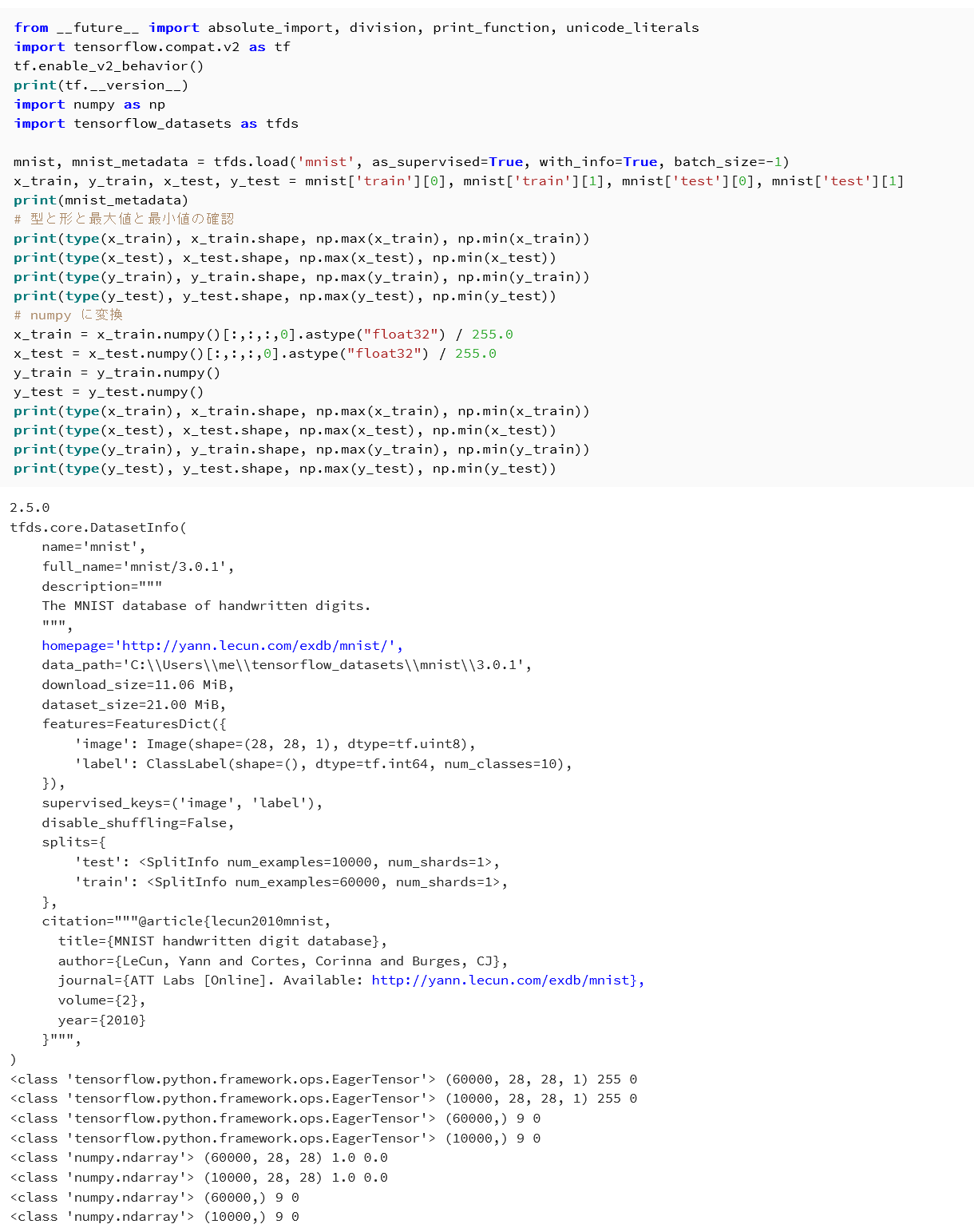

| MNIST データセットのロード | メタデータ,x_train, x_test, y_train, y_test の型・形状・最大値・最小値が表示される |

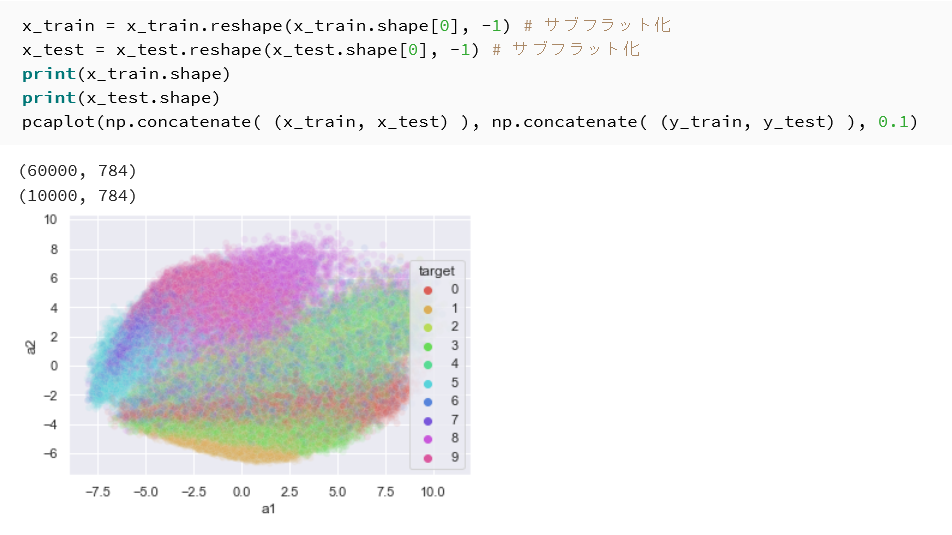

| MNIST の主成分分析プロット | フラット化後の形状が表示され,10クラスの色分け散布図と寄与率が出力される |

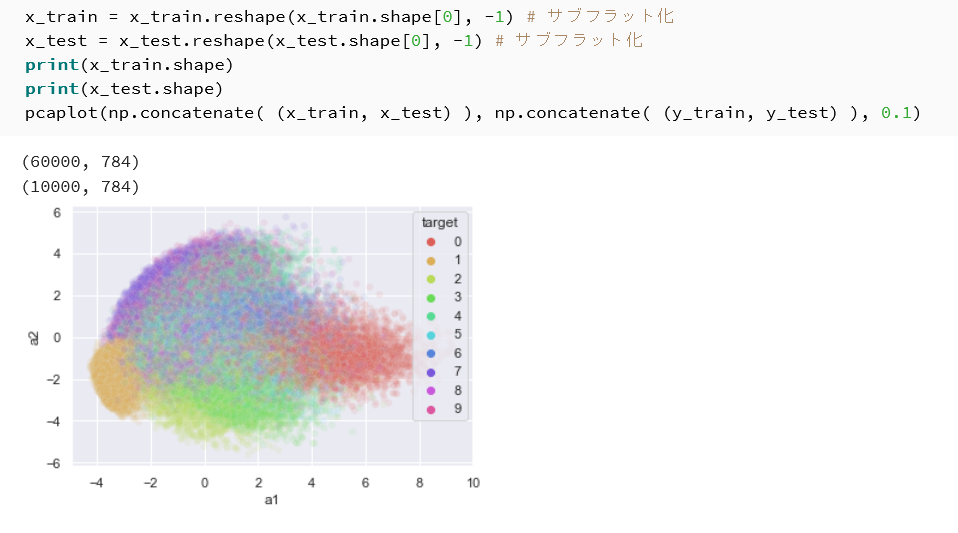

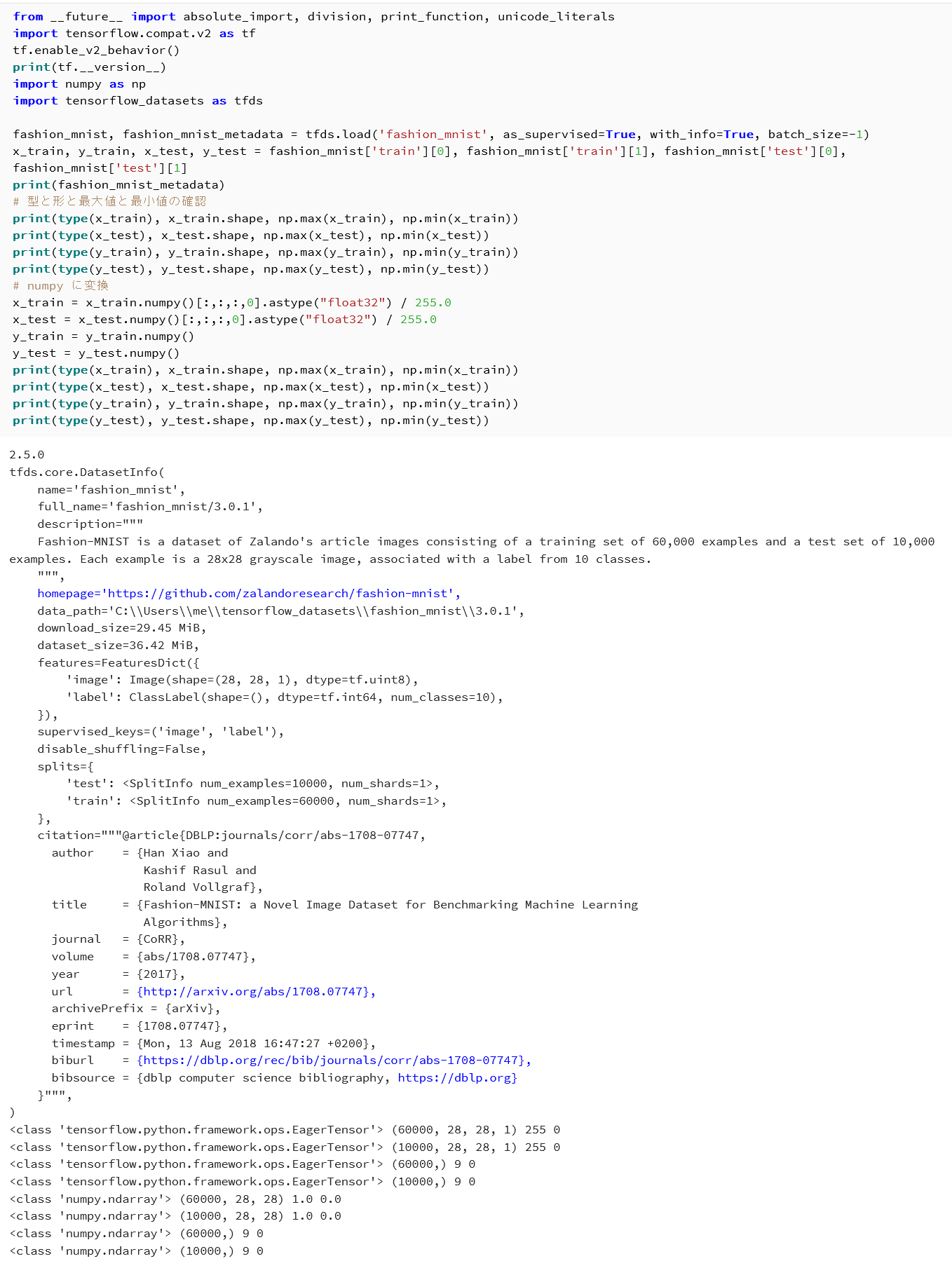

| Fashion MNIST データセットのロード | メタデータ,x_train, x_test, y_train, y_test の型・形状・最大値・最小値が表示される |

| Fashion MNIST の主成分分析プロット | フラット化後の形状が表示され,10クラスの色分け散布図と寄与率が出力される |

4. 概要・使い方・実行上の注意

データセットの概要

本記事で使用する4種類のデータセットは,いずれも Keras に付属のデータセットであり,tensorflow_datasets を通じてロードする.

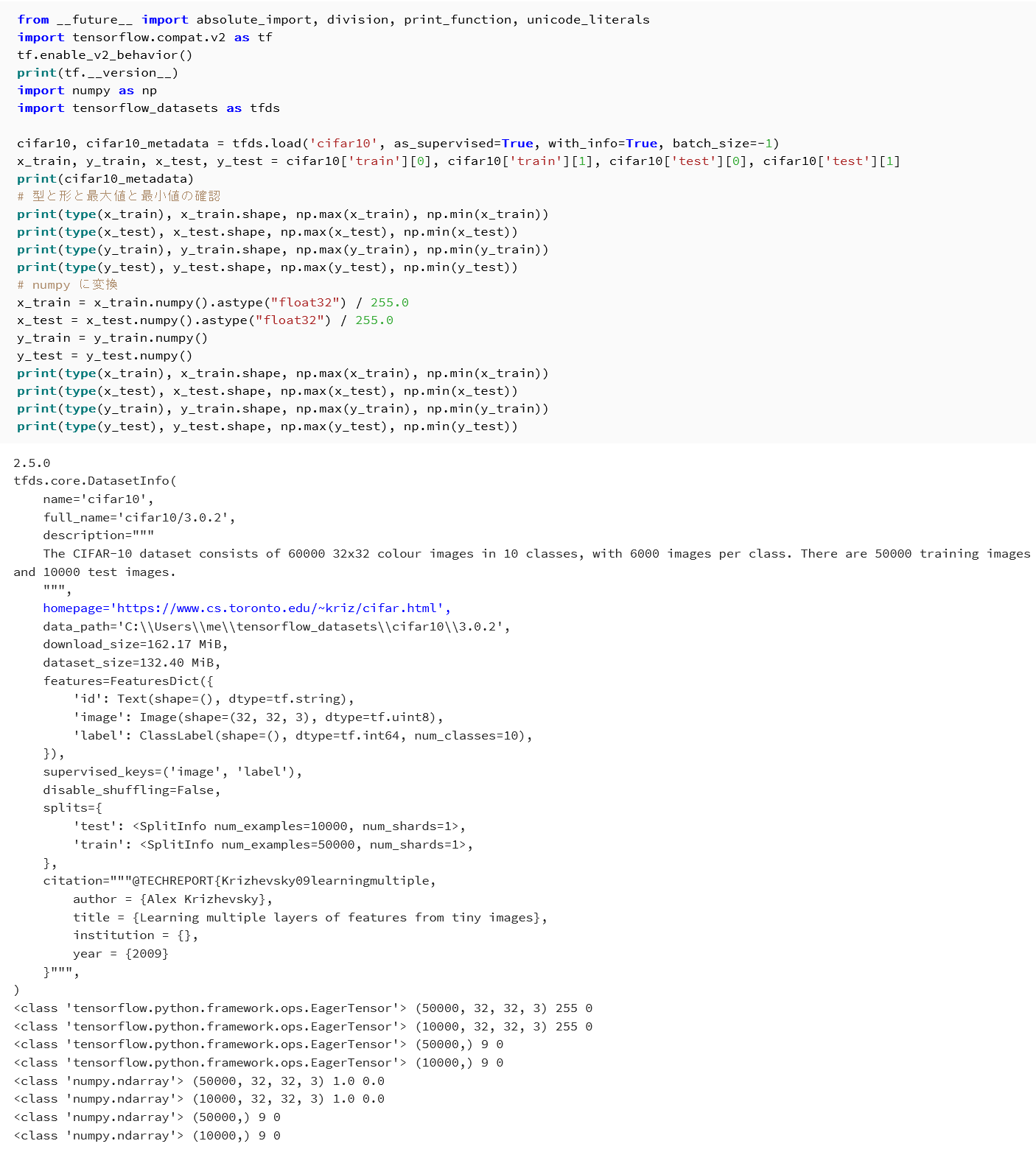

- CIFAR10 データセット:10クラスのカラー画像(32×32×3)で構成される.訓練データ50,000枚,テストデータ10,000枚を含む.

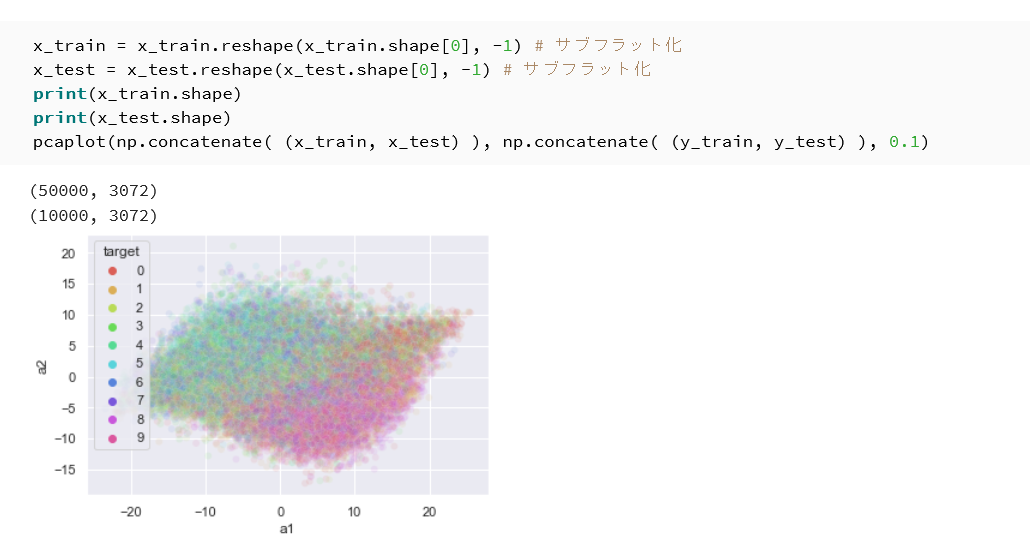

- CIFAR100 データセット:100クラスのカラー画像(32×32×3)で構成される.訓練データ50,000枚,テストデータ10,000枚を含む.

- MNIST データセット:手書き数字(0〜9)のグレースケール画像(28×28×1)で構成される.訓練データ60,000枚,テストデータ10,000枚を含む.

- Fashion MNIST データセット:衣類等10カテゴリのグレースケール画像(28×28×1)で構成される.訓練データ60,000枚,テストデータ10,000枚を含む.

処理の流れ

各データセットに対して,以下の手順で主成分分析プロットを行う.

まず,tfds.load でデータセットをロードし,訓練データおよびテストデータの画像とラベルを取得する.画像データは numpy 配列に変換し,ピクセル値を 0〜255 から 0〜1 に正規化する.

次に,多次元の画像配列を reshape でフラット化する.CIFAR10 および CIFAR100 は 32×32×3 = 3,072 次元,MNIST および Fashion MNIST は 28×28×1 = 784 次元となる.

フラット化した訓練データとテストデータを結合し,scikit-learn の PCA で2成分に次元削減する.得られた第1主成分スコアと第2主成分スコアを用いて,seaborn の scatterplot でクラスラベルごとに色分けした散布図を描画する.あわせて,第1主成分および第2主成分の寄与率(explained variance ratio,各主成分が元データの分散を説明する割合)と累積寄与率を出力する.

実行上の注意

コード中の %matplotlib inline は Jupyter Notebook 用のマジックコマンドであるため,Python スクリプトとして実行する場合は削除する.

tfds.load で batch_size = -1 を指定しているため,データセット全体が一度にメモリ上にロードされる.十分なメモリ容量が必要である.

散布図の alpha 値(透過度)は 0.1 に設定されている.データ点数が多い場合,透過度を低く設定することで密度分布を把握できる.

5. ソースコード

主成分分析プロットの前準備

import numpy as np

import pandas as pd

import seaborn as sns

import sklearn.decomposition

import matplotlib.pyplot as plt

sns.set()

%matplotlib inline

def prin(A, n):

"""主成分分析を行い,変換後の配列と寄与率を返す"""

pca = sklearn.decomposition.PCA(n_components=n)

transformed = pca.fit_transform(A)

return transformed, pca.explained_variance_ratio_

def pcaplot(A, b, alpha, title=""):

"""主成分分析で第1・第2主成分スコアを算出し,散布図をプロットする"""

M, ratio = prin(A, 2)

a12 = pd.DataFrame(M[:, 0:2], columns=['a1', 'a2'])

a12['target'] = b

sns.scatterplot(x='a1', y='a2', hue='target', data=a12, palette=sns.color_palette("hls", np.max(b) + 1), legend="full", alpha=alpha)

if title:

plt.title(title)

print(f"第1主成分の寄与率: {ratio[0]:.4f}, 第2主成分の寄与率: {ratio[1]:.4f}, 累積寄与率: {ratio[0]+ratio[1]:.4f}")

def load_dataset(name):

"""tensorflow_datasets からデータセットをロードし,numpy 配列として返す"""

import tensorflow_datasets as tfds

ds, metadata = tfds.load(name, with_info=True, shuffle_files=True, as_supervised=True, batch_size=-1)

x_train, y_train = ds['train'][0].numpy().astype("float32") / 255.0, ds['train'][1].numpy()

x_test, y_test = ds['test'][0].numpy().astype("float32") / 255.0, ds['test'][1].numpy()

print(metadata)

print(type(x_train), x_train.shape, np.max(x_train), np.min(x_train))

print(type(x_test), x_test.shape, np.max(x_test), np.min(x_test))

print(type(y_train), y_train.shape, np.max(y_train), np.min(y_train))

print(type(y_test), y_test.shape, np.max(y_test), np.min(y_test))

return x_train, y_train, x_test, y_test

CIFAR10 データセット

- CIFAR10 データセットのロード

x_train, y_train, x_test, y_test = load_dataset('cifar10')

- CIFAR10 データセットの主成分分析プロット

x_train_flat = x_train.reshape(x_train.shape[0], -1) x_test_flat = x_test.reshape(x_test.shape[0], -1) print(x_train_flat.shape) print(x_test_flat.shape) pcaplot(np.concatenate((x_train_flat, x_test_flat)), np.concatenate((y_train, y_test)), 0.1, "CIFAR10 PCA")

CIFAR100 データセット

- CIFAR100 データセットのロード

x_train, y_train, x_test, y_test = load_dataset('cifar100')

- CIFAR100 データセットの主成分分析プロット

x_train_flat = x_train.reshape(x_train.shape[0], -1) x_test_flat = x_test.reshape(x_test.shape[0], -1) print(x_train_flat.shape) print(x_test_flat.shape) pcaplot(np.concatenate((x_train_flat, x_test_flat)), np.concatenate((y_train, y_test)), 0.1, "CIFAR100 PCA")

MNIST データセット

- MNIST データセットのロード

x_train, y_train, x_test, y_test = load_dataset('mnist')

- MNIST データセットの主成分分析プロット

x_train_flat = x_train.reshape(x_train.shape[0], -1) x_test_flat = x_test.reshape(x_test.shape[0], -1) print(x_train_flat.shape) print(x_test_flat.shape) pcaplot(np.concatenate((x_train_flat, x_test_flat)), np.concatenate((y_train, y_test)), 0.1, "MNIST PCA")

Fashion MNIST データセット

- Fashion MNIST データセットのロード

x_train, y_train, x_test, y_test = load_dataset('fashion_mnist')

- Fashion MNIST データセットの主成分分析プロット

x_train_flat = x_train.reshape(x_train.shape[0], -1) x_test_flat = x_test.reshape(x_test.shape[0], -1) print(x_train_flat.shape) print(x_test_flat.shape) pcaplot(np.concatenate((x_train_flat, x_test_flat)), np.concatenate((y_train, y_test)), 0.1, "Fashion MNIST PCA")

6. まとめ

主成分分析(PCA)による次元削減

scikit-learn の PCA を用いて高次元の画像データを2次元に削減し,第1主成分スコアと第2主成分スコアで表現する.これにより,データの分布構造を2次元平面上で把握できる.

寄与率による主成分の評価

寄与率(explained variance ratio)は,各主成分が元データの分散を説明する割合を示す指標である.第1主成分および第2主成分の寄与率と累積寄与率を確認することで,2次元プロットが元データの特徴を保持する程度を定量的に評価できる.

画像データのフラット化

主成分分析を適用するために,多次元の画像配列を reshape でフラット化する.CIFAR10 および CIFAR100 は 3,072 次元,MNIST および Fashion MNIST は 784 次元のベクトルに変換する.

tensorflow_datasets によるデータセットのロード

tfds.load で CIFAR10,CIFAR100,MNIST,Fashion MNIST の各データセットをロードする.batch_size = -1 によりデータセット全体を一括取得し,numpy 配列に変換してピクセル値を 0〜1 に正規化する.

seaborn による散布図の描画

seaborn の scatterplot で,第1主成分と第2主成分のスコアをクラスラベルごとに色分けした散布図として描画する.alpha=0.1 の透過度設定により,データ点が密集する領域の密度分布を確認できる.

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)