2022年度卒業論文配属サポートページ

目次

目次

1. はじめに

自主自立。自分で考え、行動することを大切にすること。

- 勉強に楽しい気持ちを持つ。自分の成長を信じる。仲間によい影響を与える。

- チャレンジこそが大事である。チャレンジは自分の成長に重要である。

- 失敗を恐れない。仲間や指導教員の助けを借りながら「なぜうまくいかないのか」を自分で考え、解決に挑戦する。そのことで自信を深め、成長する。

- 「原理原則、基礎、ものごとの本質をとらえる」ことを常に意識する。

- 仮説 ー> 実験 ー> 実験からの考察の手順を大切にする。記録を大切にする。伝えることも大切にする。グループワーク、仲間や指導教員とともに、助け合い、ともに成長する気持ちを意識する。

研究は、「不可能だったこと、難しかったこと」を「可能にする、簡単にする」ことへのチャレンジである。卒業研究の1年間で、専門分野、研究力、基礎力の成長にチャレンジする。

主な活動:卒業論文の提出と卒業研究発表(12月の予定)、中間発表(7月の予定)、学会発表(10月、3月予定)にもチャレンジする。

2. 教員紹介

実績:

科研費多数、研究費のべ1億円以上、論文等数十、教科書3冊、授業担当のべ約20以上、学会や国レベルの委員等の実績、卒論・修論・博士論文実績数十名以上。

3. 2022年度の案内

このページは2022年1月28日に書き換えられた(内容は変えず、読みやすさ向上のため順序変更や重複削除を行った)。

3.1 2月、3月の予定(3年次)

Zoom(オンラインビデオ会議サービス)での配信(週1回)を2/2に開始予定である。

- 毎週水曜日(13:30 開始)予定。10〜20分程度。

- 最新の人工知能(人間の知的活動を模倣する技術)、データサイエンス(データから価値を引き出す学問)、3次元コンピュータグラフィックス(3Dの仮想空間や物体を計算機で生成描画する技術)の研究を紹介する。卒業研究に役立つ。

- 各自、自宅等で視聴する。カメラはオフ、マイクはオフである。

- 視聴に必要な Zoom URL は、電子メールで、開始前に伝達する。

- 資料は、このページの「活動実績」のところに掲載する。

- 不必要な欠席は望ましくないが、他の用事がある場合にはそちらを優先すること。

4月以降のスケジュールなどは、このページの「7. スケジュールと実務」で説明している。

3.2 進路、就職活動、大学院について

進路については、就職、大学院への進学などがある。

【進路の考察】

- 自分の進路:福山大学の大学院進学であれば、5〜6月ごろに推薦入試等が始まる。就職であれば、さまざまなイベント(就職課のイベント)が始まっており、各自、エントリーなどを開始する時期である。

- 自分の進路に向けた活動についても、今後、機会があれば、仲間との情報交換を心がけること。

- そのうえで、「就職までに、卒業論文で、何を学びたいのか」、「就職の準備として、情報工学の高度な学びが役に立つ」ことを各自、考察してみること。

【就職】

- 大学より、就職関係イベントの案内が行われている。ぜひ、積極的に参加、情報収集を続けること。

- セレッソの「就職情報2022(情報工学科)」のコースを使って、各自、就職状況の報告を行うこと。(そのための、セレッソでの準備ができたら、セレッソのコースニュースで案内がある。案内を待つこと。)

セレッソの「就職情報2022(情報工学科)」の URL: https://cerezo.fukuyama-u.ac.jp/ct/course_688082

- 卒論指導教員は、履歴書の書き方などの相談をいつでも受け付ける。

【福山大学大学院の情報処理工学専攻】

福山大学にも大学院がある。大学院はさまざまな専攻があり、その一つに「情報処理工学専攻」がある。

- コンピュータ等に関する進んだ内容の授業がある。

- 研究も重視している。

- 入学試験は、4年生の間に、2回受験できる。筆記試験である。

金子邦彦研究室では、大学院においては、企業とも連携した実製作、学会発表などでの体験や他大学学生との交流も重視するなど、有意義な活動ができる。金子邦彦は、他大学での指導歴を含め、修士学生50名以上、博士学生数名の指導経験があり、指導には自信がある。学生諸君には、楽しく学び成長できる場を与える。

3.3 コロナ感染対策

コロナ禍においても、皆さんが、安全に、効率よく、最大限学べるように工夫したいと考えている。

感染拡大防止は、極めて重要である。次のように行う。

- 全員が、健康状況調査に回答する。

- 登校時は、マスク着用を忘れない。

- レベル3では、卒業研究のための登校を禁止する。

- 3年生の2月〜3月は Zoom での配信を行う。(資料は、このページの「活動実績」のところに掲載する。)

4. 卒業研究の理念

金子邦彦研究室での、卒業研究の理念について説明する。

情報工学科のことについては、セレッソの「卒業研究2022」のコース(2022年4月開設予定)で各自確認すること。

4.1 全体の理念

自主自立。自分で考え、行動することを大切にすること。そして、仲間との助け合い、仲間を尊敬し、さまざまな価値観を受け入れることも大切にすること。

4.2 卒業研究で何を学ぶのか

- 専門分野と研究力:人工知能、データサイエンス、3次元コンピュータグラフィックス

- 基礎力:基礎力は、論理的思考力、批判的思考力、考察力、先行研究などの調査力、緻密な記録を取る習慣、失敗を恐れない態度、柔軟な思考、課題発見力、失敗から課題を発見し解決に導く能力、考察には根拠を付ける習慣(データなどの根拠をもとに考察する能力)、レポート作成、プレゼンテーション、研究倫理、自主性、積極性である。

4.3 基礎力の成長のために

基礎力の向上のため、次をアドバイスとする。

- 広く深い専門分野の知識を持つ。

- 実験、考察、結論を自力で行い、そこから課題を発見することにチャレンジすることは、基礎力の向上につながる。

- 実験を数多く行い、考察を深めることにチャレンジする。

- モチベーションと集中力は自己管理する。まず行動を開始してみると、やる気が出てくることもある。

- 仲間との助け合い、仲間を尊敬し、さまざまな価値観を受け入れることも大切にする。

- 仲間と体験をシェアする。

- 仲間や指導教員との質問、教えあい、シェアを積極的に行う。

- 論理的思考力、考察には根拠を付ける習慣(データなどの根拠をもとに考察する能力)を重視する。

5. 研究の進め方

5.1 専門分野を実践的に学ぶために

今まで自分が知らなかった最新の技術や手法を自主的に調べ、自分で、実際に動かし実験することを重視する。

- 最新の技術や手法の学びである。

- そのとき、本質を大切にする。そのためには、常に、自分が使っている技術や手法の中身、長所を確認・把握する。

- 自分で実際に動かすなどの実験を行いながら、実践的に学ぶ。

- チャレンジ精神を大切にする。最新の技術を使ったからといって、すぐに成功するとは限らない。(失敗は成長につながるものと考える)。

- 実験からの考察が極めて大切である。他の技術を使えばうまく行く場合がある。やり方や設定を変えればうまく行く場合がある。ちょっとしたプログラムを補うとうまく行く場合がある。「どうすればうまく行くのか」の探求はとても楽しいものである。

- そのために、Python の使い方や、パソコン類の操作の基本も、自主的に、積極的に学び、試す。

- 何よりも、楽しむ。そのために、自主的な調査、実験がとても大切である。

専門分野を学ぶためのヒント、きっかけとして、指導教員は、皆さんに専門分野についての最新の技術や手法を紹介し、教授し続ける予定である。(Zoom配信、週1回〜3回の予定。対面に変わる場合もある)。資料は、このページの「活動実績」のところに掲載する。すべてを指導教員に教わるということではなく、自分で調べ、自分で、実際に動かし実験する、計画も自分で立てる、仲間と分かち合える部分は積極的に分かち合うことがとても大切である。

5.2 研究力の向上のために

卒論生各自に気をつけて欲しい大切なことである。

- 研究は、仮説、実験、実験からの考察の繰り返しである。

- 実験データは各自で保存する。

- 必ず、実験手順の記録を残す。そのとき、実験風景の写真や、画面のスクリーンショットなども一緒に残す。

- 考察には必ず根拠がある。根拠も記録に残し、後で、いつでも自分で確認できるようにしておく。

- 良いやり方を調べ尽くす(指導教員に相談できる)。

- 自主、自立:取り組みたいことは自分で決める。

- 一度、実験が終わったから大丈夫ということはない。何度も実験を繰り返す覚悟を持つ。失敗を恐れない。

- 研究では、失敗から学ぶことも大切である。自分の成長を意識する。

- うまく行かないとき、やり方を変える、別の技術を調べて試す、目標を変えることはよくある。問題が必ずすぐに解決できるわけではない。

- 研究倫理はとても大切である。

5.3 実験からの考察で行うこと

卒業研究では、実験からの考察が極めて大切である。実験からの考察には次のようなものがある。

- 成功したか失敗したか

- 調査や実験手順に不備はなかったか、間違いはなかったか

- 実験データの誤差

- データが少なすぎないか

- もう一度実験や調査をやり直すとしたら

- データのとり方や実験方法に偏りがないか

- 実験してみて分かったこと、予期せぬ発見や気づきなど

- 「できなかったこと」は何だったか(予想外のことがあれば発見である)

- 「難しいこと」は何だったか(予想外のことがあれば発見である)

- 「遅すぎて役に立たなかったこと」は何だったか(予想外のことがあれば発見である)

- 自分で解決できそうな課題はあるか。(解決では、他の技術を使えばうまく行く場合がある。やり方や設定を変えればうまく行く場合がある。ちょっとしたプログラムを補うとうまく行く場合がある)

考察には根拠があるはずである。根拠は記録しておき、後でいつでも確認できるようにしておくという習慣がとても大切である。そのために、実験のデータはとても大切なので、保存しておく。そして、実験手順も必ず記録しておく。(卒業論文では、実験手順の説明、データなどの根拠をもとにした結論の説明がとても大切である)。このことで、考察という「知」を他の人と分かち合うことになる。

6. 卒業論文のテーマ

6.1 卒業論文のテーマは、自主的に決定する

- 卒業論文のテーマは、卒論生本人と、指導教員が相談の上、自主的に決定する。

- 指導教員が得意とする、次の卒業論文の分野でテーマを設定することを基本とする。

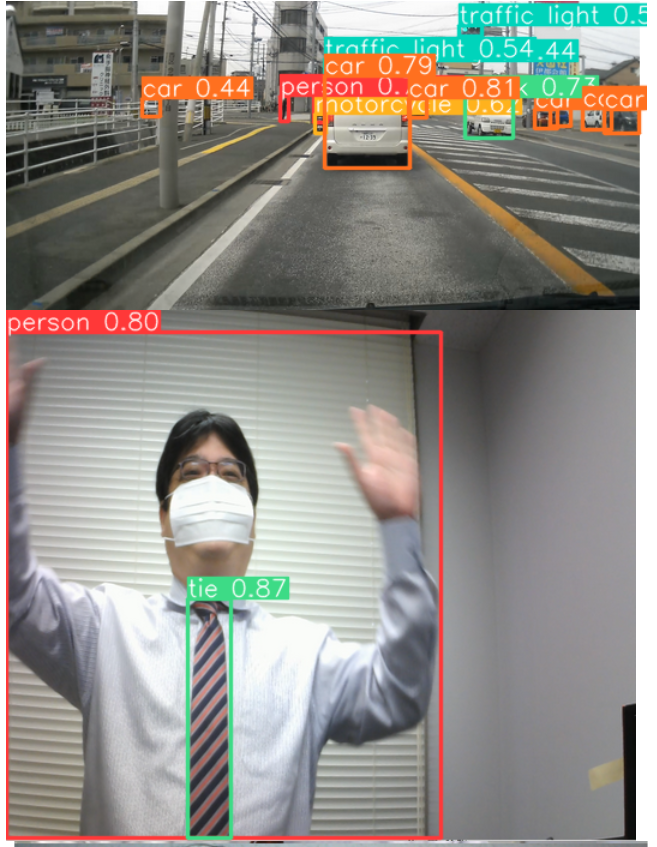

人工知能応用(実世界のデジタル化、実世界のシミュレーション、人流や交通流や集団の挙動の把握、航空写真やドライブレコーダーからの実世界把握、人物や車両のデジタル化)、センサー応用(3次元形状、テクスチャ、運動、挙動等のリアルタイム把握)、データベース応用、地図データベースに関する分野

「私が研究したいと思っている分野はちょっと違っているか?」と思ったとしても、実際には、卒業論文の分野に当てはまっている場合が多いので安心して欲しい(本当に違っている場合は、本人と相談の上、指導教員が勉強する、本人のテーマを調整するなどで対処する)。

- 複数名が類似のテーマを行うことがあり得る。そのとき、使用している技術や手法が同じだったとしても、当然、実験手順、結果、実験からの考察は異なる。そして、各自で、考察をもとに、さらなる発展を行うものである。

6.2 卒業論文のテーマを決めるために、各自で行って欲しいこと

テーマを、自分自身で探求することはとても楽しいことである。

まず、「何を行いたいか」を考え抜いてほしい。指導教員自身が、自分で行いたいと思っている活動を、参考のために掲載しておく。これらの中から選んでもよいし、自分で新しく考えてもよい。

- 3次元の実世界(屋外、屋内)をコンピュータに再現し、コンピュータの中でシミュレーションできる技術

- 大量のデータ(広大な屋外、緻密な屋内)を扱える技術

- 車両、人物を観測し、集計し、集団行動や様態を分析できる技術

研究テーマは、各自が、実験や調査での体験をもとに、自主的に見出すことにチャレンジする。指導教員は最大限支援する。次をアドバイスとする。

- 「面白そうなこと」、「やってみたいこと」を仮に決める。

- まず、実験し、実験から考察し、結論を出してみる。そのとき失敗は構わない。考察には根拠があるはずである。根拠は記録しておき、後でいつでも確認できるようにしておく。

- 「えっ。実験」と思ったかもしれない。3年生の時点から、情報工学応用演習IIと情報工学応用演習IIIにより、「最新の技術や手法で何ができるのか、そして、動かし方はどうなのか」という学びと、各自の演習や考察や追加調査により、実験の準備は開始している。

- 自分で、実験の目的、計画や手順も考えてみるというチャレンジは楽しいものである。そのとき、実験の目的、計画や手順を、他の人にすべて教えてもらうことはあり得ない。自主・自立の精神を持ち、主体的に行動し「仲間や指導教員に大いに助けてもらう、アドバイスをもらう、元気をもらう」という気持ちを持つ。

- 実験のとき、どういう技術を使うかについて。自主的に調査し理解することも大切であるし、仲間に助けてもらうか、指導教員に教わることも大切である。常に、自分が使っている技術や手法の中身、長所を確認・把握する。

- 実験では、「何を実験したかを忘れてしまう。記録が無い」ことによる失敗はもったいない。必ず、実験手順の記録を残す。そのとき、実験風景の写真や、画面のスクリーンショットなども一緒に残す。記録は、実験の改善、研究の効率向上、正しい研究の実施に極めて重要である。

- 実験からの考察により、「できなかったこと」、「難しいこと」、「とても面倒だったこと」、「遅すぎて役に立たなかったこと」、「それでも挑戦してみたいこと」などをリストアップし、その中から研究テーマを発見する。

テーマが決まった後も、テーマを変更、充実することはよくある。そして、テーマは難しすぎないこと(自分で解決できるもの)、解決に完璧を追い求めないことにも気をつけて欲しい。

7. スケジュールと実務

7.1 全体スケジュール

- 2月〜3月:Zoom配信、週1回、水曜日13時30分。

人工知能、データサイエンス、3次元コンピュータグラフィックスについての Zoom 配信である。各自のカメラとマイクはオフである。Zoom の URL は電子メールで伝達する。

不必要な欠席は望ましくないが、他の用事がある場合にはそちらを優先すること。資料は、このページの「活動実績」のところに掲載する。

- 4月以降:次を同時に行う。

- Zoom配信、週1回〜3回

内容は、最新の国内外の研究紹介であり、曜日日時を決めて配信する(曜日日時は、前もって学生諸君と相談する)。各自のカメラとマイクはオフである。Zoom の URL は電子メールで伝達する。

後で、このページで確認し、復習などできるようにする予定である。

- 各自からの配信(Zoomの予定)、最大で月に1回程度

内容は、各自が得た実験データの紹介、あるいは、調査結果の紹介である(曜日日時は、前もって学生諸君と相談する)。

気軽な気持ちでチャレンジし、楽しむこと。

- 各自、自宅や大学等で、研究を行う。やる気が出たとき、締切が近いときなどは、毎日行うという場合もあるが、その際も、無理のないように、各自で計画を立てて、自主、自立の精神で行う。

- その他の活動:対面授業でのSA。研究室卒業写真撮影(12月)。研究倫理について学ぶ(6月)。

Zoom 配信などは、不必要な欠席は望ましくない。他の用事がある場合にはそちらを優先することになるが、このページで各自学び、復習するなどで補っておくこと。

- Zoom配信、週1回〜3回

7.2 行事、マイルストーン

卒業研究の完成へ向けて、次の手順を踏んでいく。

- 4月(3年生): 情報工学応用演習II

- 9月(3年生):仮配属

情報工学応用演習III、進路指導

- 4月:仮テーマ決め、研究活動開始

卒業論文テーマは、学生と指導教員で相談して決定する。卒業論文テーマの仮テーマを決めたら行動開始である。各自で、パソコン等を用いて、実験を始める。実験では、実験データの保存、実験手順の記録がとても大切である(詳細は「5. 研究の進め方」で説明している)。

卒業論文のテーマの決め方は、このページの「6.1 卒業論文のテーマは、自主的に決定する」と「6.2 卒業論文のテーマを決めるために、各自で行って欲しいこと」で説明している。

卒業論文の進め方は、このページの「5.1 専門分野を実践的に学ぶために」と「5.2 研究力の向上のために」で説明している。

- 6月:研究倫理について学ぶ(講習会)

- 7月:中間発表(ポスター)

ポスター形式である。

内容:仮テーマ。目標。現在までに自分が行ったこと(実験や調査など)。既存の技術での調査と、既存の技術で何が足りないかの考察。実験で自分が用いた技術の説明。実験手順。実験結果。実験からの考察。結論。12月までの具体的な予定。グラフや図も付けること。

詳細(日時、ルール、ワードやパワーポイントファイルの書式)については、セレッソの「卒業研究2022」のコース(2022年4月開設予定)で案内があるので、待つこと。

- 8月:中間発表結果通知

中間発表の後も、研究を自主的に発展充実することに時間を使う。

- 8月:学会発表原稿

A4で1枚である。

内容:中間発表の内容に加え、追加調査、追加実験を行い、そのことについても記載する。

- 10月:学会発表(パワーポイント)

各自、パワーポイントで、学会発表を行う。発表のルール、マナーも学ぶ。特に時間厳守が大切である。

- 12月:卒業論文、卒業論文プレゼンテーション

卒業論文(ワード)の提出、概要(約200文字)の提出、パワーポイントの作成と、各自プレゼンテーションの実施。

卒業論文の書き方は、このページの「7.5 卒業論文の書き方」で説明している。

卒業論文の詳細(日時、ルール、ワードやパワーポイントファイルの書式)については、セレッソの「卒業研究」のコース(2022年4月開設予定)で案内があるので、待つこと。

- 12月:学会発表申し込み

- 12月:実験データ集め

各自、実験データを保存しておくこと。12月にいったん集める。

- 1月:学会発表原稿

- 3月:学会発表

各自、パワーポイントで、学会発表を行う。

7.3 研究室活動での注意事項

- 指導教員との連絡:電子メール、Zoom 配信の途中でチャットを利用できる。

- その他の相談:4月からは副指導教員を置く(予定)。情報工学科の先生、就職課、学生課、教務課などで適宜相談する。

- 感染対策のため、登校については適宜相談する。

レベル3においては登校不可である。

- 中間発表、学会発表、卒業論文のファイルは、各自、指導教員に事前に提出し確認を受ける。(その際、書き直しなどが行われる場合がある。)

- 卒業研究のため、各自がパソコンを使う。コロナ禍では、自宅での活動が主になる。

- 研究室内のパソコン等は、学生の自由利用とする。

7.4 卒業論文の分野

人工知能応用(実世界のデジタル化、実世界のシミュレーション、人流や交通流や集団の挙動の把握、航空写真やドライブレコーダーからの実世界把握、人物や車両のデジタル化)、センサー応用(3次元形状、テクスチャ、運動、挙動等のリアルタイム把握)、データベース応用、地図データベースに関する分野である。

【サイト内の関連ページ】

- 最新の技術や手法の記事

- Python(汎用の高水準プログラミング言語)の使い方の記事

- パソコン類の操作の基本についての記事

7.5 卒業論文の書き方

楽しんで書くこと。

卒業論文や学会発表に時間をかけることは、基礎力の向上のためにも極めて重要である。

卒業論文は、次のことに気をつけて、余裕を持って進めること。

- 次のことを、論理的に書く。実験手順の説明、結果の説明、データなどの根拠をもとにした考察の説明がとても大切である。

- 目的

- 全体の基礎: 基礎知識、国内外の動向などをまとめる。

- 実験での仮説、実験で使用した技術、実験手順、実験結果

実験手順や調査手順の説明はとても大切である。良いやり方を数多く調べ尽くしておくこと。

実験のときに、必ず、実験手順の記録を残す。そのとき、実験風景の写真や、画面のスクリーンショットなども一緒に残す。

- 実験からの考察、根拠(実験データ、結果)、結論

根拠をもとに考察し、結論を導く。

実験からの考察については、このページの「5.3 実験からの考察で行うこと」で説明している。

- ネットの記事(Wikipediaなど)や他の人の論文などをコピーして、自分の論文の中に使うことはあり得ない。記事や論文などを紹介、批評したい場合などは、必ず「X を行いたい。私は Y だと考えている。文献 AAA によれば BBB になっている。そして、CCC については、DDD である」のような書き方になる。(ネットの記事や他の人の論文などは紹介にとどまり、自分の考察等が主になる)。

- 卒業論文のページ数は、最大20ページ程度にまとめる。

- 図や写真や表を付ける。

- 参考文献については、次のような書き方になる。

FairFace: Face Attribute Dataset for Balanced Race, Gender, and Age for Bias Measurement and Mitigation, Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision, pp. 1548-1558, 2021 ECCV 2020.

卒業論文や中間発表の日時、ルール、ワードやパワーポイントファイルの書式については、セレッソの「卒業研究2022」のコース(2022年4月開設予定)で案内があるので、待つこと。

8. 活動実績

8.1 4月〜8月:情報工学応用演習II(3年生)

- ニューラルネットワーク(脳の神経回路網を模した数理モデル)

- ニューラルネットワークによる画像分類、学習曲線(機械学習モデルの性能評価指標)、学習不足、過学習(訓練データに過剰適合する現象)

- 顔識別(特定個人の顔を識別する技術)、顔認証(顔情報で本人確認する技術)

Google Colaboratory(ブラウザ上でPythonを実行できる環境)のページ: https://colab.research.google.com/drive/13fXJ4f2dF-53YI_6i_rAJl17cuYuLE91#scrollTo=PAJ9H2QqRadE

8.2 9月〜1月:情報工学応用演習III(3年生)

【Python の使い方】

- Google アカウントの作成: https://www.youtube.com/watch?v=Wx04o8U1w7c

- Google Colaboratory の利用(入門者向け) https://www.kkaneko.jp/pro/colab/index.html

- Python のインストール手順: https://www.kkaneko.jp/tools/win/python.html

- Python プログラムの実行方法: YouTube 動画: https://www.youtube.com/watch?v=L2qltJxvcgI, ドクセル のURL: https://www.docswell.com/s/6674398749/ZD2EDZ-2022-01-25-101937

【第2回から第14回の内容】

- 9/22、画像の取り扱い、MNISTデータセット(手書き数字画像の大規模データセット)、CIFAR-10データセット(10クラスのカラー画像データセット)、画像データの次元、畳み込みニューラルネットワーク (Convolutional Neural Network, CNN)(画像認識に特化したニューラルネットワーク)の体験、正規化、畳み込みニューラルネットワークを用いた画像分類の体験、Residual ネットワーク, ResNet v2(深い層でも学習可能なCNN構造)を用いた画像分類の体験

Google Colaboratory のページ: https://colab.research.google.com/drive/1O9V9UwlWS-kJTQau42kIIcxyOpJQr5-G?usp=sharing

- 10/5、畳み込み、カーネル、CNN (畳み込みニューラルネットワーク)

「畳み込み」について説明動画: https://www.youtube.com/watch?v=AKQKrBrhxk8

CNN Explainer (ジョージア工科大学 Polo Club による), 畳み込み層などの仕組みをビジュアルに学ぶことができるサイト: https://poloclub.github.io/cnn-explainer/

- 10/12, 人工知能による画像の生成、フェイク、GAN (generative adversarial network)(敵対的生成ネットワーク、データ生成モデル)、GAN の学習、DCGAN (deep convolutional GAN)(CNNを用いたGANの一種)

Google Colaboratory のページ: https://colab.research.google.com/drive/1hymsnPNkc0Ra3HfklhNEcSDWGbafQEx7?usp=sharing

- 10/19、時系列データ(時間的順序を持つデータ)、時系列データとニューラルネットワーク、フィードフォワード、リカレントニューラルネットワーク(RNN)(時系列データ処理に適したNN)、LSTM 層 (Long Short Term Memory layer)(時系列データ処理に長けたRNNの一種)

Google Colaboratory のページ: https://colab.research.google.com/drive/1qxh5l0iEPUm-QRTuEBSqBLd3V9KvqItK?usp=sharing

- 11/2、自然言語処理(NLP)(人間の言語を計算機で扱う技術)、ベクトル、ベクトルの長さ、ベクトルの距離、単語の特徴ベクトル、単語の類似度、類似検索、Word2vec(単語をベクトル表現する手法)

Google Colaboratory のページ: https://colab.research.google.com/drive/1E86OSq90AyI1z-ULE6hNoVmpCJ_7fCR8?usp=sharing

- 11/9、オートエンコーダ (auto encoder)(データの潜在特徴を学習するNN)

Google Colaboratory のページ: https://colab.research.google.com/drive/1HQ8pmFVJFq5uhBEfkBhRvsXaDUXssoo9?usp=sharing

- 11/18、プログラミングの基本事項(式、変数、データ型、条件分岐、リスト、繰り返し、関数)、Python のプログラムの書き方(コロン、字下げのことを含む)

6つの資料(pf-1 から pf-6),Python の基礎: https://www.kkaneko.jp/pro/pf/index.html

Google Colaboratory のページ: https://colab.research.google.com

- 11/30、データマネジメント、CSVファイル(カンマ区切りテキストファイル形式)、表形式のデータと CSV ファイル、Pandas(Pythonのデータ解析支援ライブラリ)とデータフレーム(Pandasで使われる表形式データ構造)、外れ値、学習データと検証データ

https://colab.research.google.com/drive/1oUtNxZsm81Bwm2dxblRF2a51bhkElFNz?usp=sharing

- 12/7、データサイエンス、ニューラルネットワークの入力、データの種類、正規化、Zスコア(平均からの標準偏差単位のズレ)、one hotコーディング(カテゴリ変数を0/1ベクトル化する手法)

Google Colaboratory のページ: https://colab.research.google.com/drive/1mnRH7AKLhUryqK2ar7XgAffW-dHj7R-N?usp=sharing

- 12/21、顔情報処理、顔検出、顔検証、顔識別、顔認識、顔ランドマーク、顔の 68 ランドマーク、顔のアラインメント、顔のコード化、Dlib(C++の機械学習ライブラリ)、Dlib を用いた顔情報処理、face_recognition(Pythonの顔認識ライブラリ)

Google Colaboratory のページ: https://colab.research.google.com/drive/1S55yEFiQpdIRdjWbdH0zzEYD5VAfklHd?usp=sharing

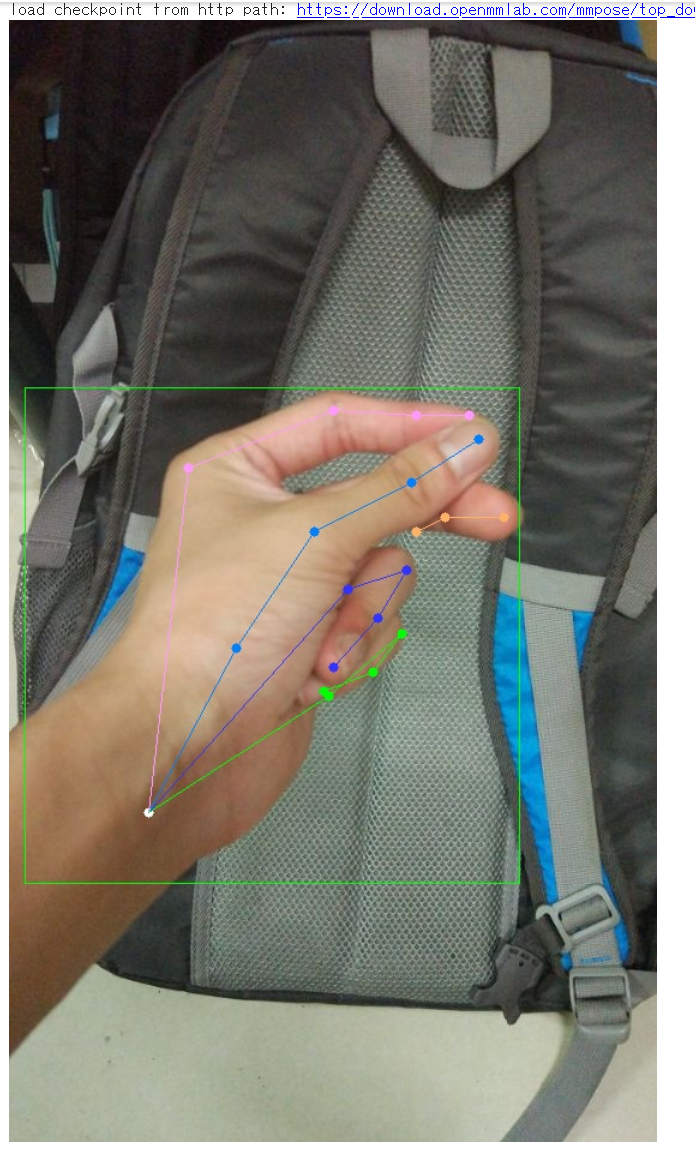

- 1/15、姿勢推定(画像から人体の姿勢を特定する技術)

Google Colaboratory のページ: https://colab.research.google.com/drive/1T2ApSH2l8n448mmebwXgH8334sgrV6KK?usp=sharing#scrollTo=ZOQWNywHdAPU

8.3 2月〜3月:人工知能、データサイエンス、3次元コンピュータグラフィックスの基礎と応用(3年生)

最新技術について、Zoom での配信を予定している。配信は週1回の予定である。資料は準備中である。

- 2/2 複数写真からの3次元再構成(複数画像から3Dモデルを生成する技術)

動画: https://www.youtube.com/embed/h4q0ote54M0 (過去の情報工学応用演習IIの動画)

- 2/9 3次元ゲームエンジン

次の内容を予定している。

3次元のゲームエンジン Unreal Engine(高性能なリアルタイム3D制作プラットフォーム)には、3次元コンピュータグラフィックスなど、ゲームのための基本機能が組み込まれている。レベルブループリント(UEのビジュアルスクリプト機能)などを使い、簡単な操作で、ゲームを作ることができる。

- サード・パーソン

https://www.kkaneko.jp/db/ue/ue-10.pdf

Unreal Engine 4 ① Unreal Engine の起動 EPIC ゲームランチャーを起動. 「Unreal Engine」を選ぶ. 「ライブラリ」を選ぶ. 「起動」をクリックして起動する. ② プロジェクトの作成(テンプレートは「サードパーソン」を選ぶ) 「ゲーム」を選ぶ. 「Next」をクリック. 「サードパーソン」を選ぶ. 「Next」をクリック. 次の設定画面は,既定(デフォルト)のままでよい. 「プロジェクトの作成」をクリック. ③画面での基本操作 右ボタンを押しながらマウスを動かす.左ボタンを押しながらマウスを動かす:視点の移動,回転など オブジェクトのクリック: オブジェクトの選択 オブジェクトをクリックし,マウスを動かす: オブジェクトの移動 ④ プレイに関する操作 「プレイ」をクリック: プレイが始まる W, A, S, D キー:ゲームのキャラクタを動かす スペースキー:ゲームのキャラクタのジャンプ ESC キー: プレイの終了

- レベルブループリント

自分のパソコンで試したい人のために、Unreal Engine のインストール手順を次の資料で説明している。(実演の範囲外。興味のある人は参照すること)。

インストールには、ディスク等の空き容量が 50G バイト以上必要ですので、注意すること。

- サード・パーソン

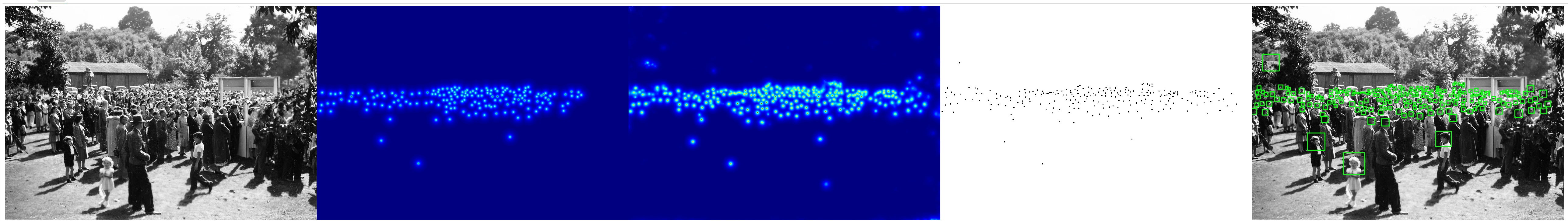

- 3/2 群衆の数のカウントと位置の把握 (crowd counting)(群衆の人数を計測する技術) (FIDTM を使用)

- YouTube 動画

- Google Colaboratory のページ

このページでは、FIDTM(高精度なcrowd counting手法)の作者による公式のプログラムおよび学習済みモデルを使用して、群衆の数のカウントと位置の把握 (crowd counting) を行う手順を示している。

- crowd counting (群衆の数のカウントと位置の把握)

画像内の人数を数えることである。監視等に役立つ。さまざま状況において、さまざまな大きさで画像内にある人物を数えることが課題であり、画像からの物体検出とは研究課題が異なる。

- FIDTM

FIDTM(Focal Inverse Distance Transform Map) は、crowd counting の一手法である。2021年発表。

従来の density maps での課題を解決し、従来法よりも精度が上回るとされる。FIDT map を用いて頭部を得る LMDS もあわせて提案されている。

文献

Focal Inverse Distance Transform Maps for Crowd Localization and Counting in Dense Crowd, Liang, Dingkang and Xu, Wei and Zhu, Yingying and Zhou, Yu, arXiv preprint arXiv:2102.07925, 2021.

PDF: https://arxiv.org/pdf/2102.07925.pdf

FIDTM の公式のソースコード

実行結果の例

- 3/9 セマンティック・セグメンテーション(画素毎に意味ラベルを付与する技術)

- Google Colaboratory のページ

https://colab.research.google.com/drive/1NKmQfbDG0XCR0bO6vcFP304gy4iqeD7L?usp=sharing

このページでは、MMSegmentation(セグメンテーション用オープンソースツール)の作者による公式のプログラムおよびCityscapesデータセット(都市景観画像とアノテーションのデータセット)で学習済みのDeepLabv3モデル(高精度なセマンティックセグメンテーションモデル)を使用して、セマンティック・セグメンテーション (semantic segmentation) を行う手順を示している。

- セマンティック・セグメンテーション (semantic segmentation)

セマンティック・セグメンテーション (semantic segmentation)では、画像内に人物 (person) がいるような場合、人物の領域に person というラベルを付ける。このとき、人物は複数いても問題ない。

学習のときには、'road', 'slidewalk', 'building' のようなクラスについての学習を行う。学習データでは、画像の画素に、'road', 'slidewalk', 'building' のようなクラス名(あるいはクラス番号)がラベルとして付いている。学習済みデータで推論を行うと、画素に 'road', 'slidewalk', 'building' のようなラベルが付く。

- MMSegmentation

MMSegmentation は、 OpenMMLab の構成物で、セグメンテーションの機能を提供する。

- OpenMMLab の URL: https://openmmlab.com/

- 文献

MMSegmentation Contributors, MMSegmentation: OpenMMLab Semantic Segmentation Toolbox and Benchmark, https://github.com/open-mmlab/mmsegmentation, 2020.

- MMSegmentation の公式ドキュメント: https://mmsegmentation.readthedocs.io

- MMSegmentation の訓練、検証、推論の公式チュートリアル: https://github.com/open-mmlab/mmsegmentation/blob/master/demo/MMSegmentation_Tutorial.ipynb

- MMSegmentation の公式の学習済みモデル: https://mmsegmentation.readthedocs.io/en/latest/model_zoo.html

実行結果の例

- Google Colaboratory のページ

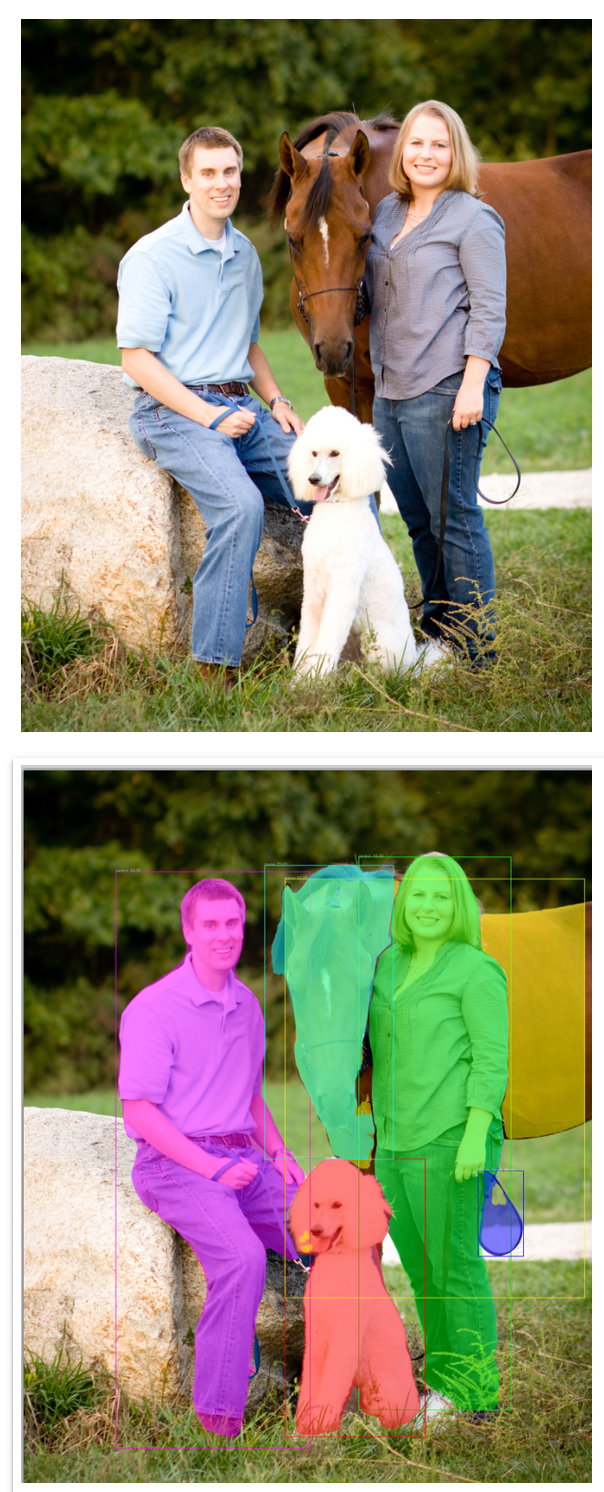

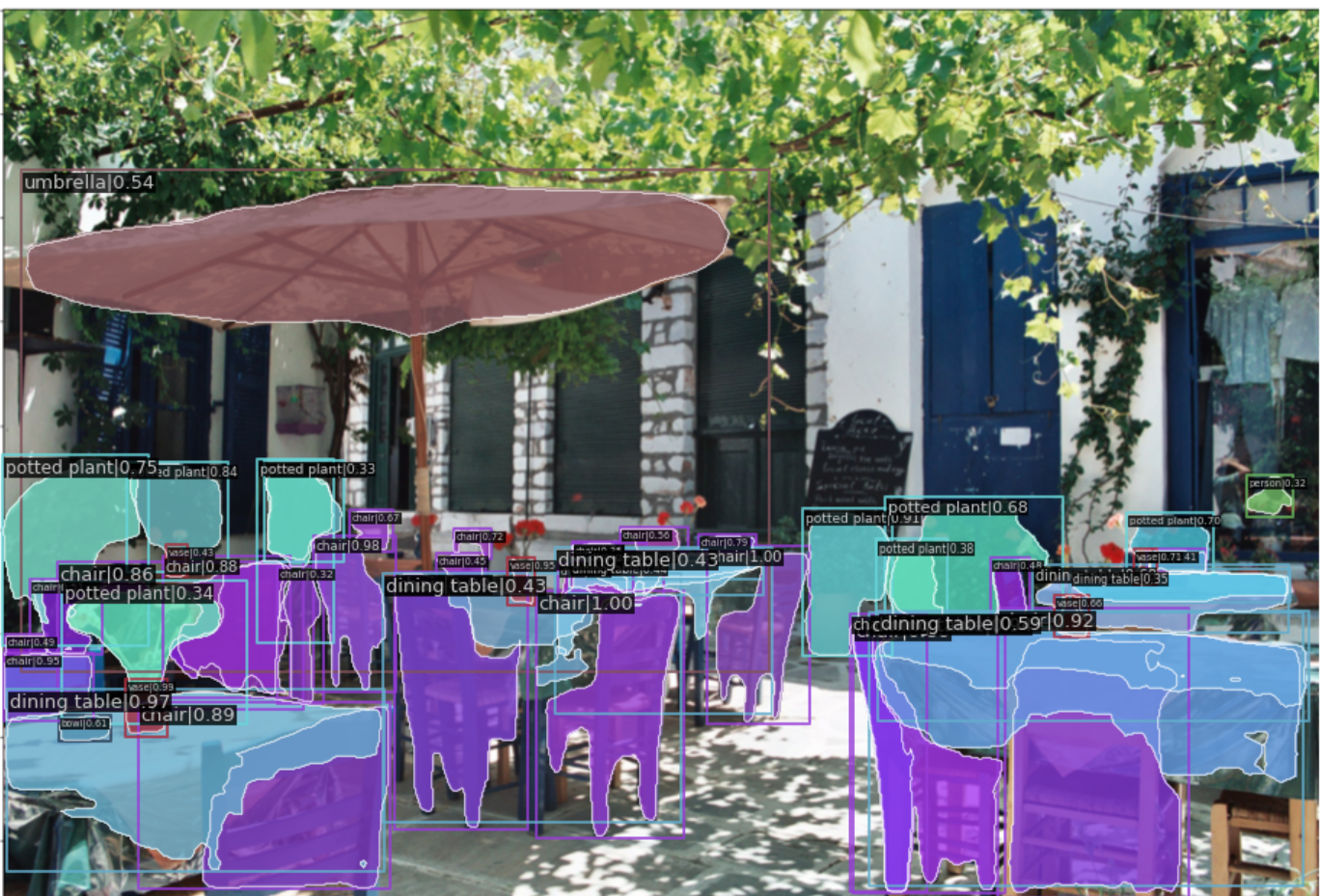

- 3/16 インスタンス・セグメンテーション(個々の物体領域を識別・分割する技術)

- Google Colaboratory のページ

https://colab.research.google.com/drive/1Ri1v_O4A5vXRSSEBgt4umKC1l3SoWp9U?usp=sharing

- YouTube 動画:

実行結果の例

- Google Colaboratory のページ

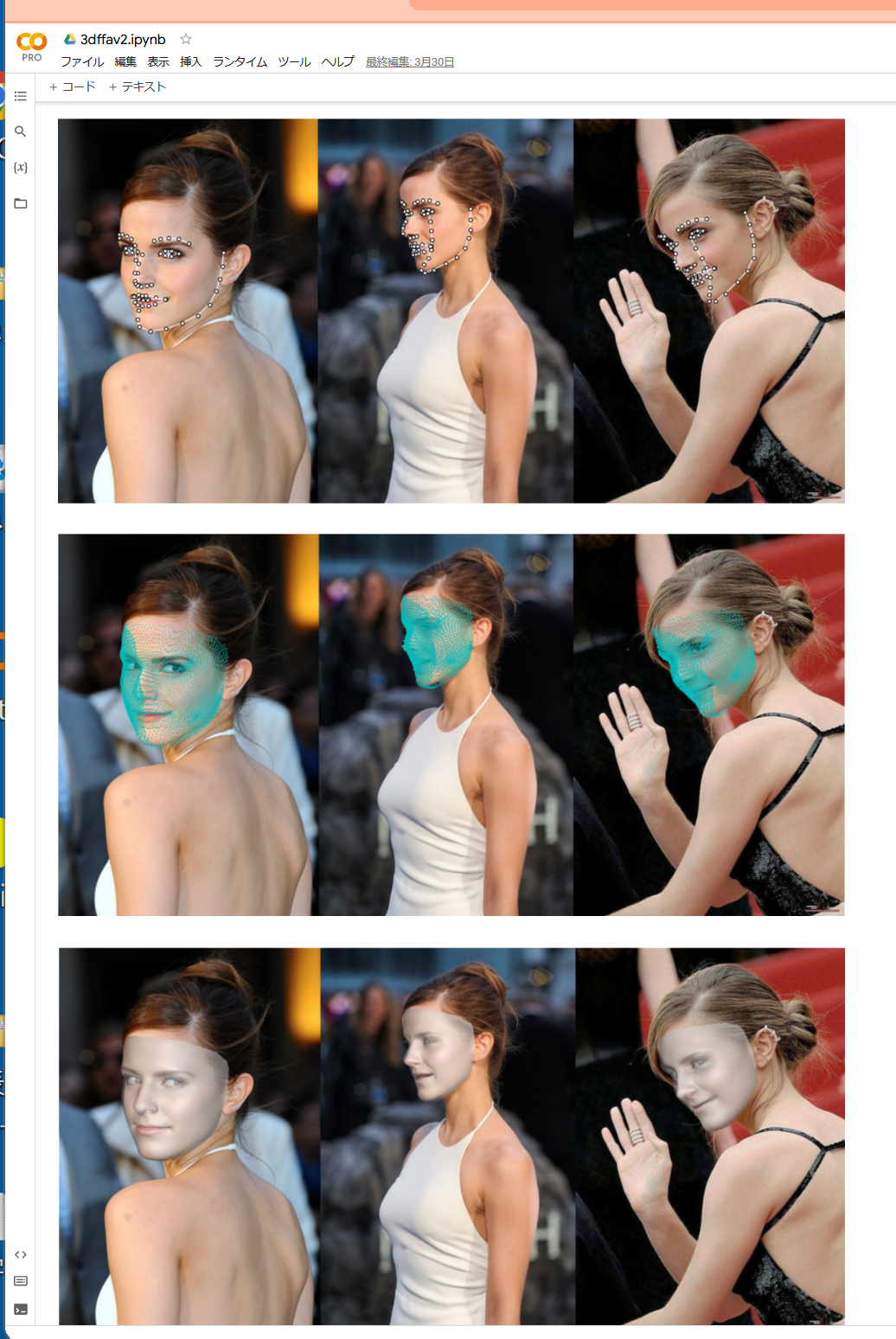

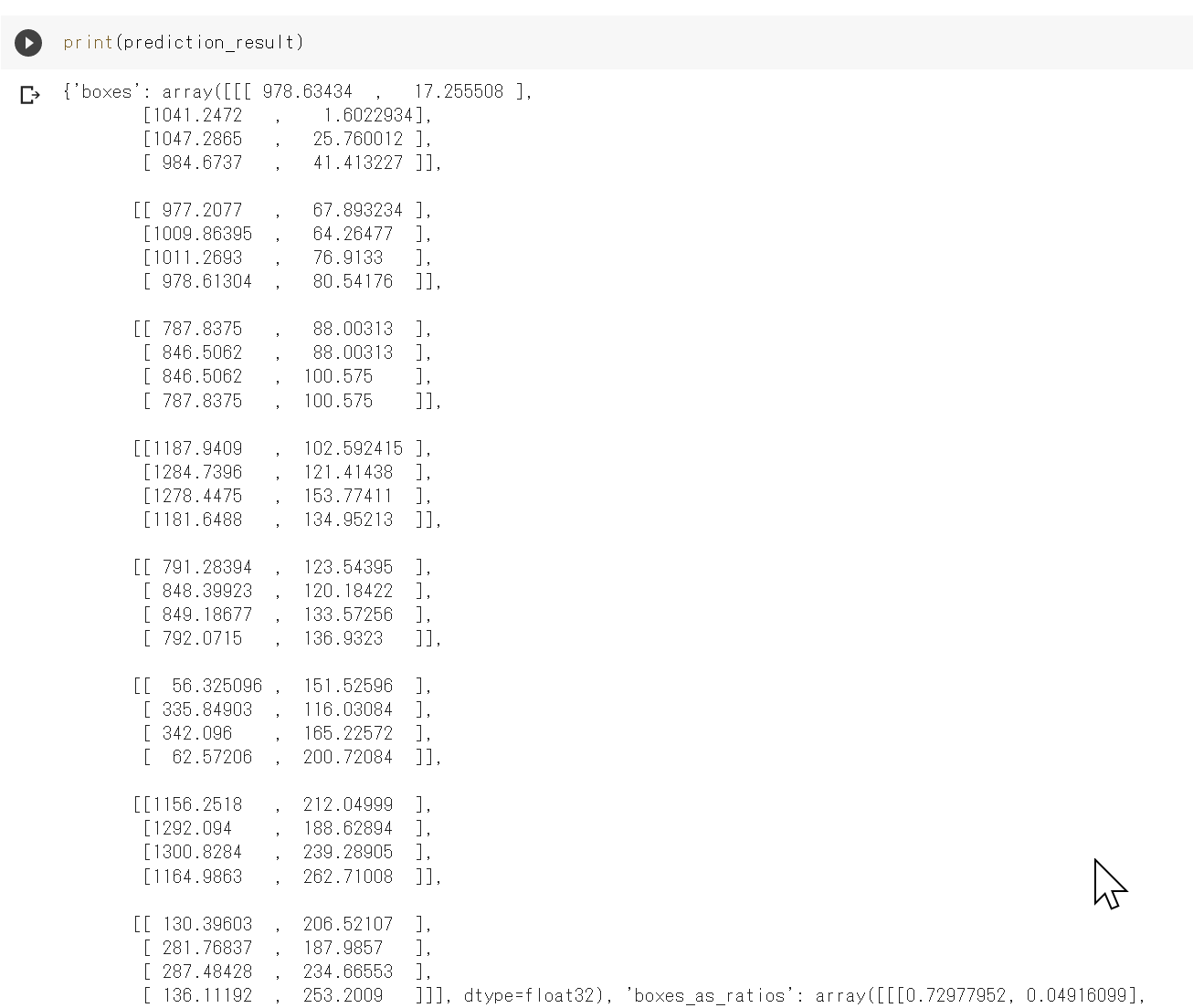

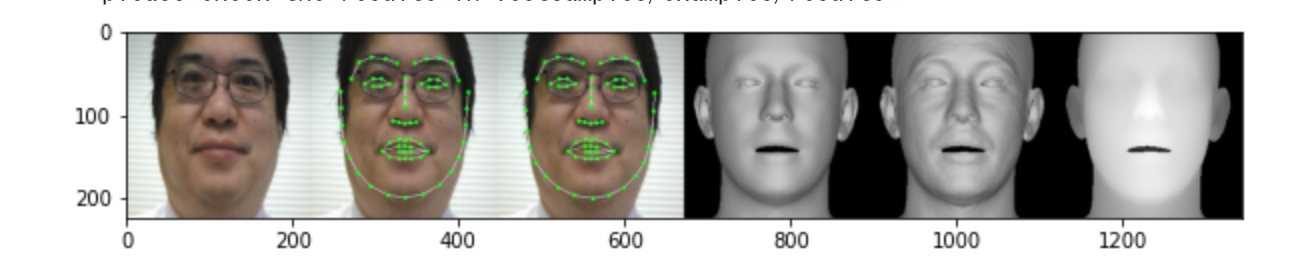

- 3/23 顔写真からの3次元再構成(3DFFA(顔写真から3D顔モデルを生成する手法)を使用)

- Google Colaboratory のページ

https://colab.research.google.com/drive/1Ja_eTAJaIOdXOWXS6Nqz5Gw9_2QL9MNy?usp=sharing

- Google Colaboratory のページ

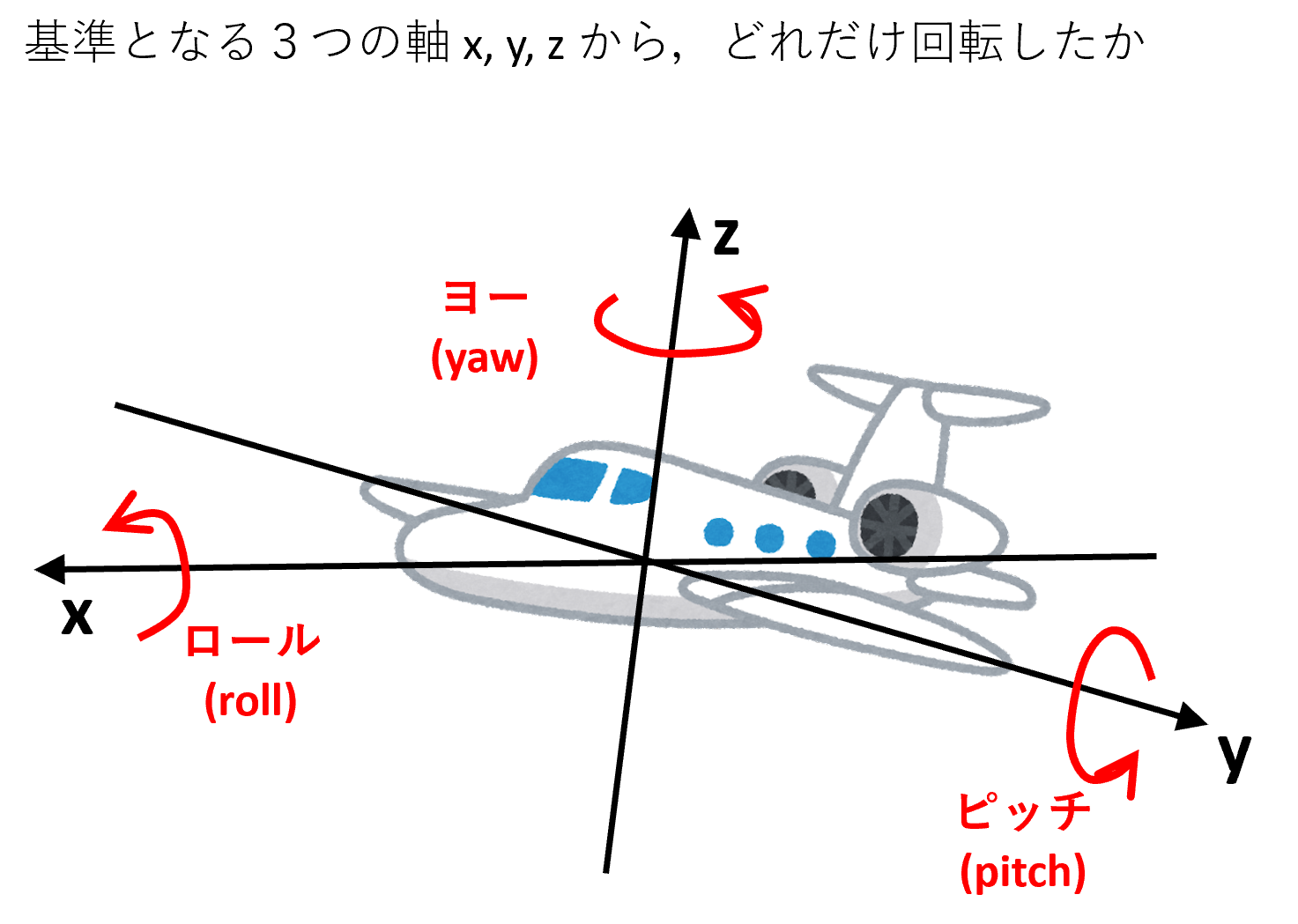

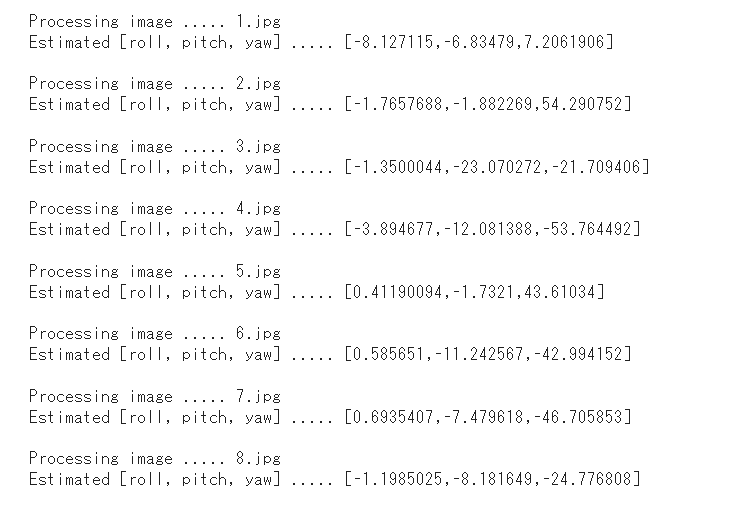

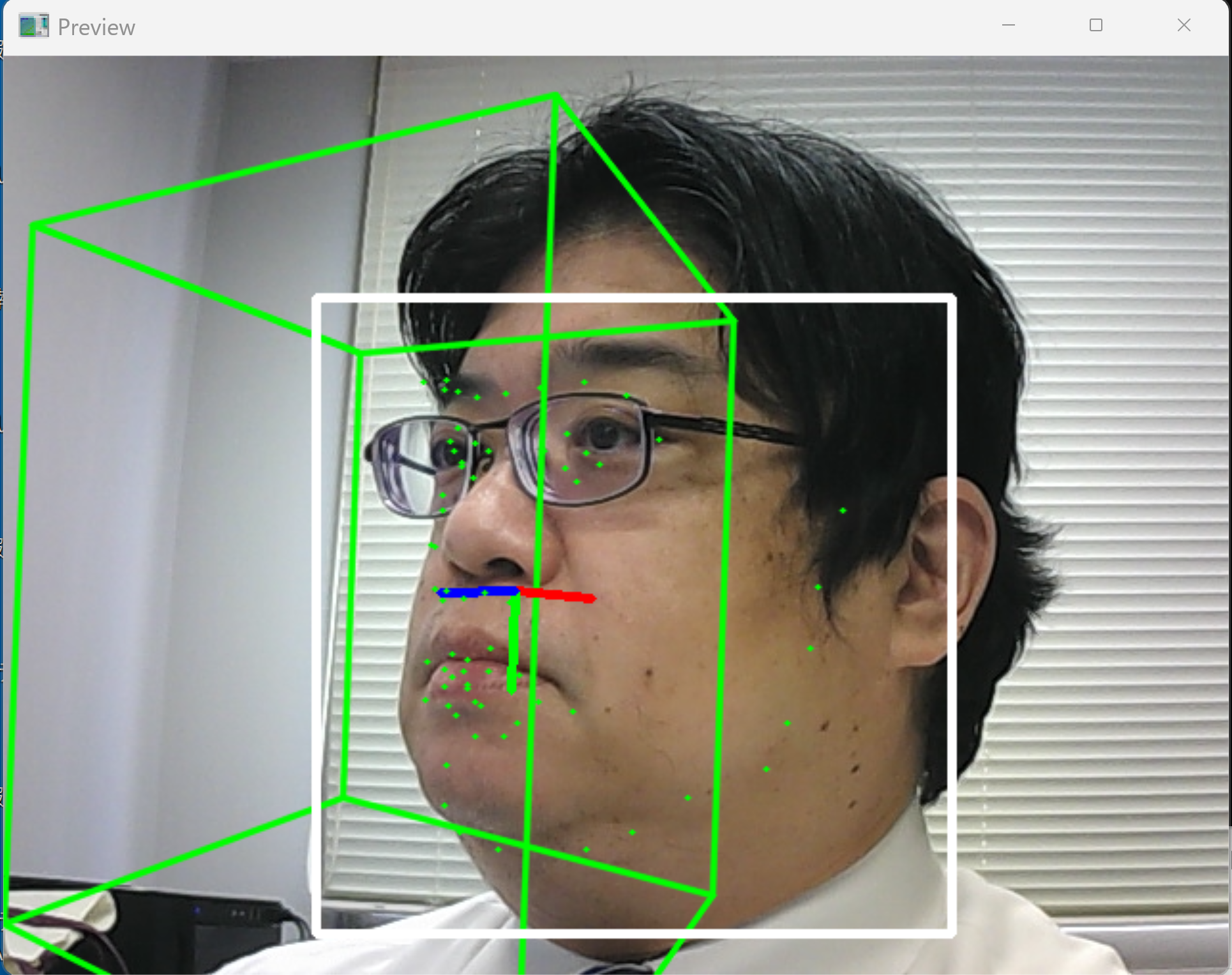

- 3/30 頭部のポーズの推定

DeepGaze(視線推定や頭部ポーズ推定ライブラリ)を使用。

DeepGaze のページ(GitHub): https://github.com/mpatacchiola/deepgaze

- 写真から、人体の頭部を検出

- 検出されたポーズについて、3次元的な向きを推定する(頭部がどの向きにどれだけ回転しているかの情報が3次元的に得られる)

顔の向きは、上向き下向き、右向き左向き、そして、斜めの3種類

- Google Colaboratory のページ

https://colab.research.google.com/drive/1dDTdZU8jaCEXHV3UUok05s-sDSgi-tb8?usp=sharing

8.4 4月以降の活動

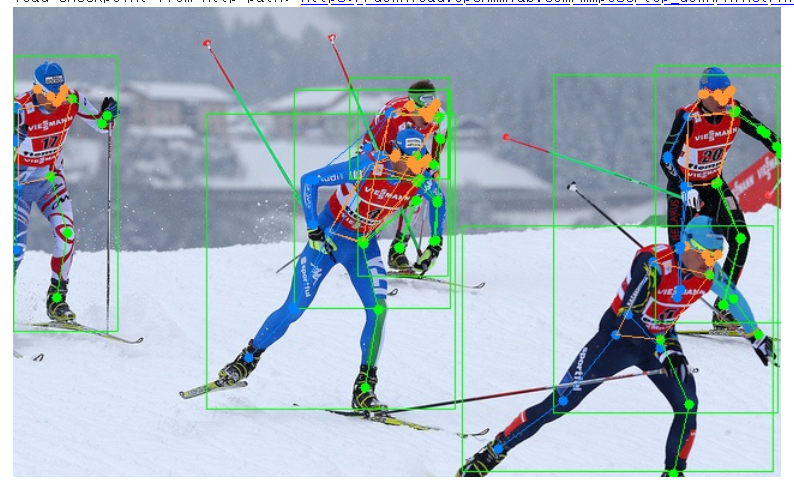

- 4/6 人体の姿勢推定

MMPose(姿勢推定用オープンソースツール)を使用

- 写真から、人体の骨格を、2次元、あるいは、3次元的に推定

- Google Colaboratory のページ

https://colab.research.google.com/drive/1qzEYs38mF8CbaeOwX6zjsZPOrSv6uFy1?usp=sharing

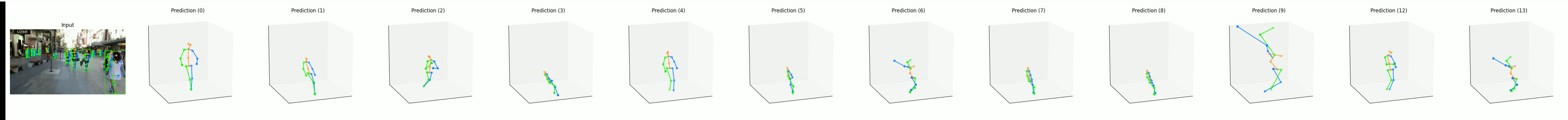

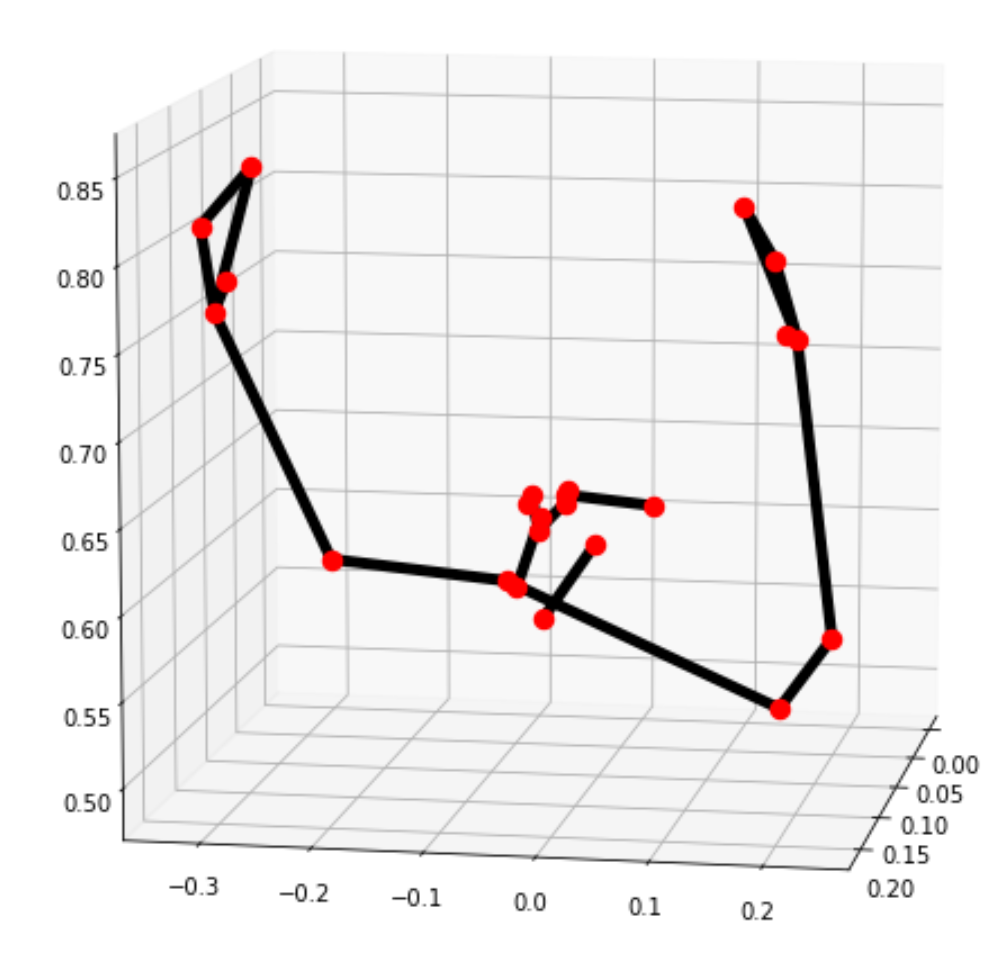

- 4/13 人体の姿勢推定(3次元)

MMPose を使用

- ビデオから、3次元的に人体の姿勢推定を行う(前回のソースコードを一部変更)

- 複数名が登場していても問題ない

- 転倒転落を監視したり(支援が必要になることが多い)、ジェスチャやしぐさの情報を得たり(人間の意思や意図を読み取る)、ダンスや体操などの動きを分析したりする。

- Google Colaboratory のページ(前回と同じ)

https://colab.research.google.com/drive/1qzEYs38mF8CbaeOwX6zjsZPOrSv6uFy1?usp=sharing

授業開始である。よろしくお願いする。皆さんへの宿題を相談する。

- このページの「話題」を一通り復習すること

- 興味を持てそうなものを、いくつか好きに選び、実際に自分なりに動かすこと

- (うまく動かないときは、金子あてメールで依頼すること。時間がかかるかもしれないが対処する)

- 「自分の興味/関心を自分で育てる」ことにチャレンジしていただく

- 既存の技術を使うとき、「既存の技術の利点や良さをどう活用できるか」も考えてほしい(既存の技術の欠点を気にしすぎるのはやめておくこと)。既存の技術について、自分なりに、深く調べてみることも考えること。

- 「自分で動かしてみての考察」へのチャレンジである。

感想。どれが面白かったか。より詳しく仕組みを調べてみたいもの(興味のあるもの)。新しい発見。もし、この技術をなにかの役に立てるなら、何ができそうか。その根拠。

- さて、プログラムを少し書き換えて、「自分で準備したファイルで動くようにする」ことにも興味を持ってほしい。動かすだけだとすぐだが、プログラムの書き換えは少し時間がかかるようなことに気づくと思う。そうした体験は、プログラミングのスキルアップ、研究能力の向上と、前向きに受け止めて欲しい。(各自で、自主的に、週1〜3回程度以上、チャレンジしていただければと望む)

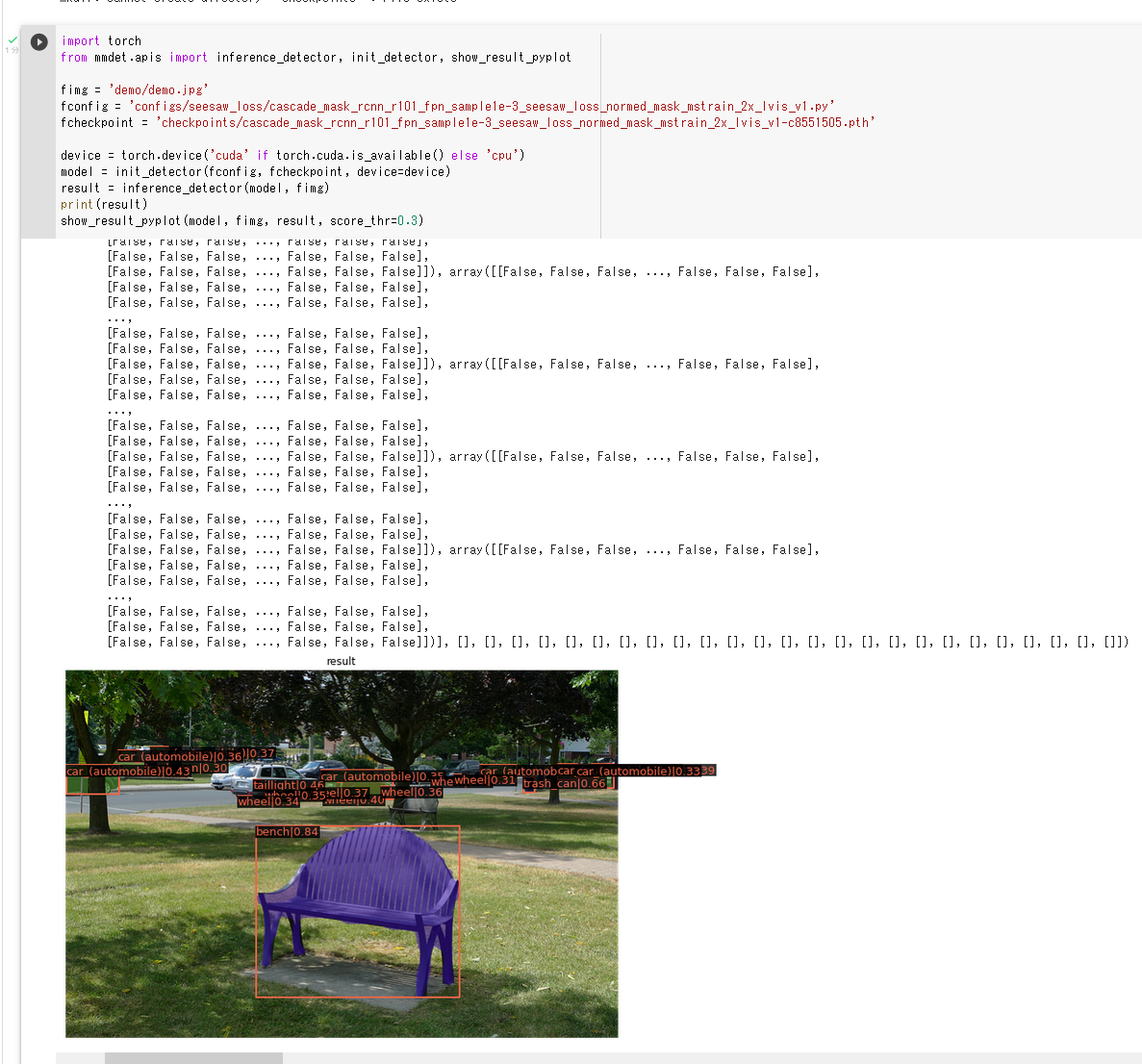

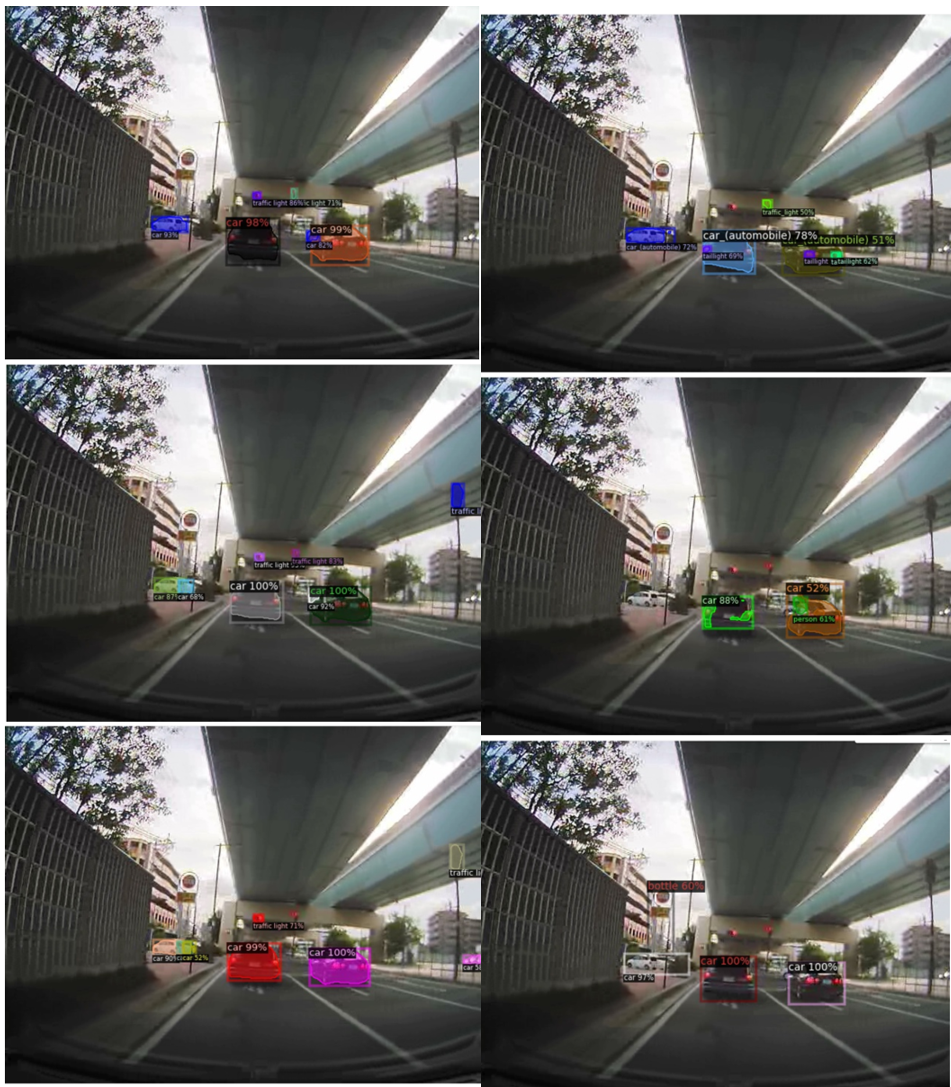

- 4/20 物体検出と画像のセグメンテーション

SeeSaw Loss(物体検出における損失関数の一つ) (2021年発表)を用いた物体検出と画像のセグメンテーション。

MMDetection(物体検出用オープンソースツール), COCOデータセット(大規模な物体検出・セグメンテーション用データセット)で学習済みのSeeSaw Lossを使用。

- Google Colaboratory のページ(前回と同じ)

https://colab.research.google.com/drive/10Suuj4wdnFVNJBg82BihdqeO1wLrBIVt?usp=sharing

- Google Colaboratory のページ(前回と同じ)

- 4/27: 13:30-

- 感染対策

- 黙食、常にマスク着用(登下校でも常にマスク着用)、しっかり手洗い、手指消毒

- 発熱や風邪症状があるときは登校しない

- (マスクを正しく着用していないときなどは、授業中でも注意を受けることがある)。

- 健康状況調査を提出しなさい

福山大学のトップページで、「健康管理と行動調査への回答」をクリック https://forms.office.com/r/6Z6Je8ERNs

- 感染対策のため出欠を取る(出欠簿にチェック)

- 不必要な欠席は避ける

- 他の必要な用事がある場合には登校しない

用事のある人はそちらを優先すること。用事には、就職活動などがある。家族との約束や友達との約束などは、できる限り、水曜の 12:00 - 16:00 ごろは避けること。

- 年間スケジュール(予定)の説明

6月 研究室内発表 目的、実験、結果、調査、考察の発表 6月 研究倫理教育 7月 ポスター発表(情報工学科全体で) 8月,10月 学会発表 8月に原稿、10月に発表を予定 12月 卒業論文、卒業者対象のアンケート

- 実験のために Google Colaboratory のノートブックを使う、Google アカウントも説明する

それで足りなくなったら、相談すること。(センサー類、カメラ類、高性能パソコンを使うような実験ということである)

- 研究室のパソコンは好きに使ってよい。

但し、2名以上集まるときは、出欠をとる。

- 全員集合するのは、毎週水曜日13:30でいいか? 学生どうしで相談して変えてもいい。

- 連休明けから ZOOM配信を再開したい(全員集合とは別の日ということである)

- 進路報告

内定、大学院合格などを各自で記入

セレッソの「就職情報2022(情報工学科)」のコースのレポート

https://cerezo.fukuyama-u.ac.jp/ct/course_688082_rptadmpreview_1049515

毎週、水曜日10時30分に集合となった。

ZOOM 配信は、金曜日15時になった。

- 5/13 15:00, 超解像(低解像度画像から高解像度画像を生成する技術)

Google Colaboratory のページ

https://colab.research.google.com/drive/1oT69ts_qzr1xrPYguSepcl24QaQv5AYq#scrollTo=mlVW1_628s0G

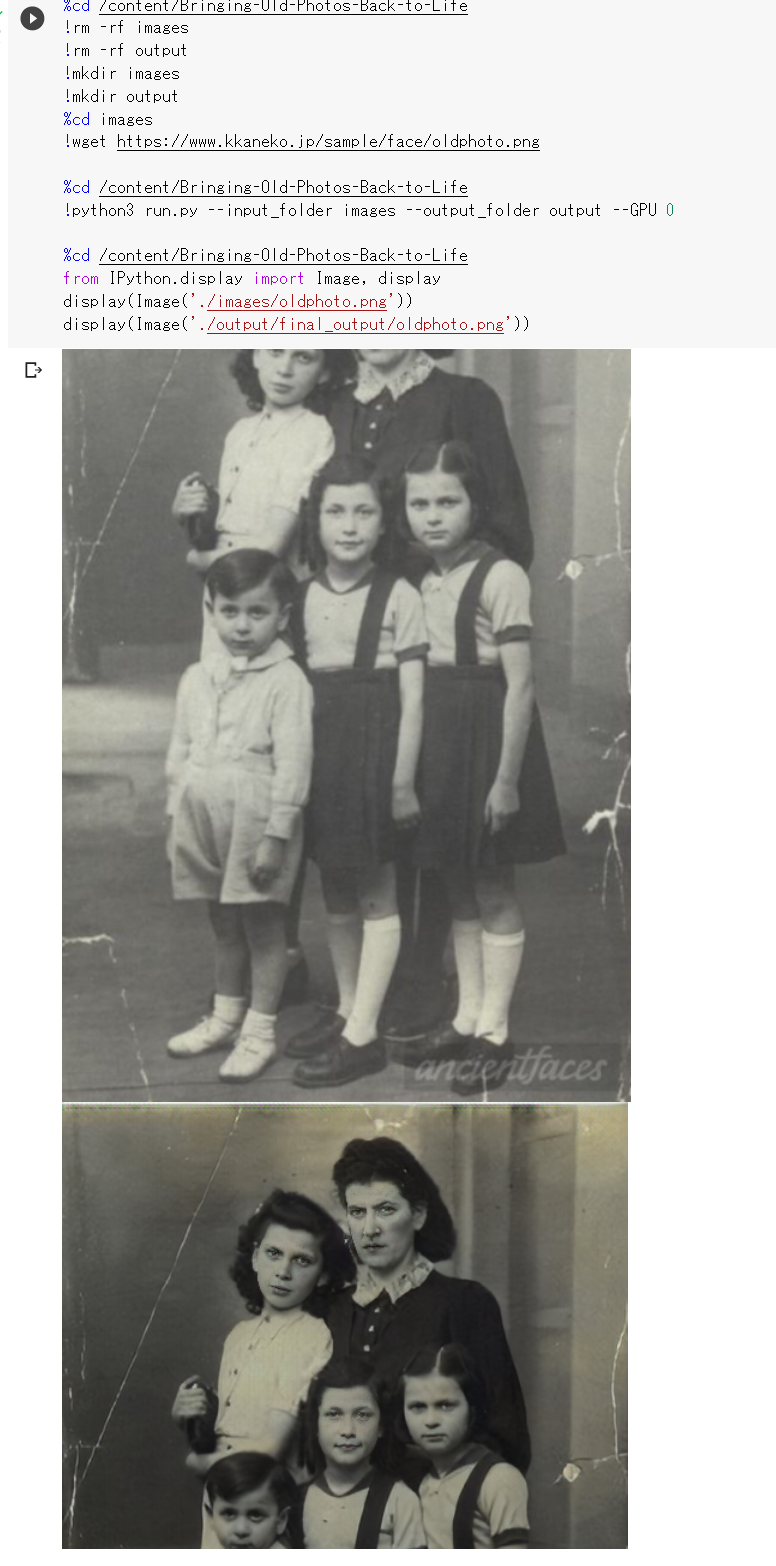

- 5/20 15:00, 画像復元

Google Colaboratory のページ

https://colab.research.google.com/drive/1iXDAruObWanXwNq0ZPRmazRC_XuFSp3X#scrollTo=VLG5Fnvq2ZyS

- 5/27 15:00, Windows の標準機能を利用した音声合成

- Python をインストール: https://www.python.org

- Windows で、コマンドプロンプトを管理者として実行する。そして、次のコマンドを実行する。

python -m pip install -U wheel pywin32

- 次の Pythonプログラムを実行

import win32com.client speech = win32com.client.Dispatch("Sapi.SpVoice") speech.Speak("こんにちは.今日は晴れです.明日も晴れると思います.") speech.Speak("Hello, World!") exit()

- 6/3 16:30, 音源分離(混合音声から個々の音源を分離する技術)

プログラム

https://colab.research.google.com/drive/1KeKWclVD8OHkmusEIUolErIasyJZi7mR?usp=sharing

次のページで公開されているサウンドデータを使用

https://mirg.city.ac.uk/codeapps/vocal-source-separation-ismir2017

音源分離

- 6/10 15:00 インスタンス・セグメンテーションとセマンティック・セグメンテーション

資料: [PDF]

Google Colaboratory のページ: https://colab.research.google.com/drive/1QpShUUrOdWHAjkbb-BBuwg8iXmHXv3ff?usp=sharing

- 6/17 15:00 パノプティック・セグメンテーション(セマンティックとインスタンスの統合)

パノプティック・セグメンテーションは、インスタンス・セグメンテーションとセマンティック・セグメンテーションの両立である。

Google Colaboratory のページ: https://colab.research.google.com/drive/1xWaQuJt50LqYwyw9ohsYERZ_Ix1gy1rN?usp=sharing

- 6/22 までの宿題

1.各自,実験計画(複数可)を決める.6月22日まで ・次のページなどを参考に https://www.kkaneko.jp/a/2022.html ・興味のあるテーマ(2,3個が良い)を選ぶ ・うち1つ以上について,次を自分なりに考察する.失敗を恐れないこと.間違いがあっても構わない 実験に使用するデータ, 期待する結論(どうなれば成功か), 実験で何に気をつけないといけないか,途中で手間取りそうと分かったら,何を省けるか. ・気を付けること. 自力で実行を開始できるもの.結果がデータとして得られるもの(データは何でもよい) 2.電子メールで提出,または,金曜日のZOOM会議のときに発言(6月25日) (後日,全員分を金子がまとめて,全員で良いところをシェアする) 3.その後,各自,実験開始にチャレンジ 4.WEBページの記事(金子作成)は,前もって言っていただければ,話題の追加等ができる可能性がある 仲間や先生に頼ることも大切

- 6/24: 中間発表準備、今後について

① レポートありがとうございました. 評価:よく考察しています.個性があります.独自性があります.情報発信ができています. 偉いです.皆さんの成長を確信しています. ・差し替えたい人は受け付けます. ・(遅れ,未提出などの減点はありません) 他の人のレポートも読み,素直な気持ちで受け止めてください.さらなる成長のきっかけです

- 7/5 情報提供

人工知能のプログラム(実際に実行して確認できるもの)。次のページにまとめているところである。

- 7/8 15:00 画像からの影の除去

- 7/15 15:00 テキストエリアの検出

https://colab.research.google.com/drive/16G5wGAHg_SKJ2FdM2SaIiVLinW2tTgkc?usp=sharing

- 7/22 15:00 顔の3次元化

1枚の顔写真を3次元化するものである。

右側で、濃淡画像が表示されている。これは、奥行きの情報を濃淡で示したもの(奥行きの情報が推定できている)である。

DECA/TestSamples/examples/results の下に 「**_detail.obj」などのファイルができる。丸ごとダウンロードの後、Blender(オープンソースの統合3DCGソフトウェア)でインポートできる。

Google Colaboratory のページ: https://colab.research.google.com/drive/1bBbyL_nxvKD6ihz_xnYd5B2ql2YlGhI_?usp=sharing

(謝辞:https://colab.research.google.com/github/cedro3/DECA/blob/master/DECA_demo.ipynb#scrollTo=-McMXFAJNPki で公開されているプログラムをほぼそのまま使用している。python-opencv のバージョンの調整。手元にある jpg 画像ファイルをアップロードして実行するプログラムの追加を行っている)

- 7/29 Improved Adaptive Gamma Correction

画像の画質改善の一手法である。

https://colab.research.google.com/drive/1QaXkXvwNMF_6VuaSI23vRwVDguX0Qb1-?usp=sharing

- 中間発表

https://cerezo.fukuyama-u.ac.jp/ct/course_261991_news_1104091

中間発表準備で,気を付けて欲しいこと ・論理的か? 根拠があること.実験を行ったときは,実験手順,実験データは,各自で記録すること.スクリーンショット(あるいはスマホ写真)等で十分という場合が多い. ・「失敗」を正しく受け止める 〇単純なミスならやり直す. 〇動かない場合,精度がイマイチな場合があると思っても,失敗したとは決めつけずに, 「うまく動いた範囲」で,発見する. あるいは,「どう役に立つか」を考える. このとき,「どういう場合であれば,正しく,精度良く動くのかを確認し,データを取り,安心する」という作業を 自ら行うことが極めて重要 〇失敗の原因の考察が大事. 顔情報処理,顔の3次元化,セグメンテーション,物体検出,ポーズ推定 ・・・ では, 複数の技術があるということを意識しておく. ある技術では失敗しても,別の技術ではうまく行くという発見も,今後ありえる

- 学会発表用の原稿作成

7月末〜8月上旬: 学会発表用の原稿作成、必要な追加実験

- 感染対策

8.5 9月以降の活動

9月以降の予定

- 毎週の配信を聴講

- 週1〜3回の集合

9月は、週1回、水曜日10:30集合 (金子は水曜日2時限は授業である)

- 各自、研究をより広く、深く行う。

- 実験を継続

- テーマを増やすのもよい

- 実験結果について、分布を取る、平均を見る、傾向を見るなどを継続

- 実験手順の記録を残し、説明することは重要である

- 考察を経て、新しい実験、新しいプログラム作成、新しい調査などに各自、取り組んでいただく

- 毎月1回(9月、10月、11月)に、パソコンを使って、各自の成果発表(実験手順、実験結果、考察、使用したデータ、自分で作成したプログラムなど)

- 10月22日(土曜日): 学会発表

- 12月下旬(予定): 卒論提出、卒論発表(プレゼンテーション)

- 人工知能とデータ分析の入門

各自、余裕のあるときに、確認自習いただく

引き続き気をつけてほしいことである。

- 仲間と先生とともに高めあう。

次をアドバイスとする。

(1)倫理を正しく理解 ・他の人の意見や研究などを参考に,考察を深めるのは良いこと. (例)ある人は「SGDs が大切」と言っていた.私も同感だ. ・複数名が,同じ研究テーマということはありえる.当たり前のことです. ・実験の実施,考察は個々人のものです.卒業研究では,同じ研究テーマであっても,実施する実験は違う,ということにしてください. ・他の人が書いた実験結果,他の人が書いた考察を丸写しということはありえません. ・実験の準備での共同(例えば,学習や検証などに使う画像や音声のデータをシェアする)ということは積極的に行ってください. (2)必要な知識の学習,必要な調査は各自で行う.助け合う. (3)データや調査結果をもとに情報発信することを意識する (4)失敗を気にしない.失敗で発見できるということもある (5)「やりたいこと」,「どうなれば成功かを,どうやって確かめるか」,「失敗して,やり直すとき,何を省略できるか」は自分で考える.ことは大切.

- 12月まで、実験は連続する。強い心をもって楽しむ。

「うまくいかない」、「頑張りたい」と心配なとき

(1)実は、他の方向を使うと簡単に解決できる

(2)実は、困難な問題で、とても1年間や2年間では解決できない

(3)卒論のトピックスとして自分でチャレンジしてみる、失敗を恐れない。

(1)や(2)や(3)のどれになるか、を、各自で意識していただく。(1)や(2)については、仲間や先生に聞いて教えてもらえることもよくある。

- 「今後は、プログラミングに挑戦したい」という気持ちが芽生えた人はAIで出てきた結果を、Pythonやエクセルやデータベースシステムで処理してみることも具体的に計画してみる。

- 仲間や先生に質問する。

話題提供

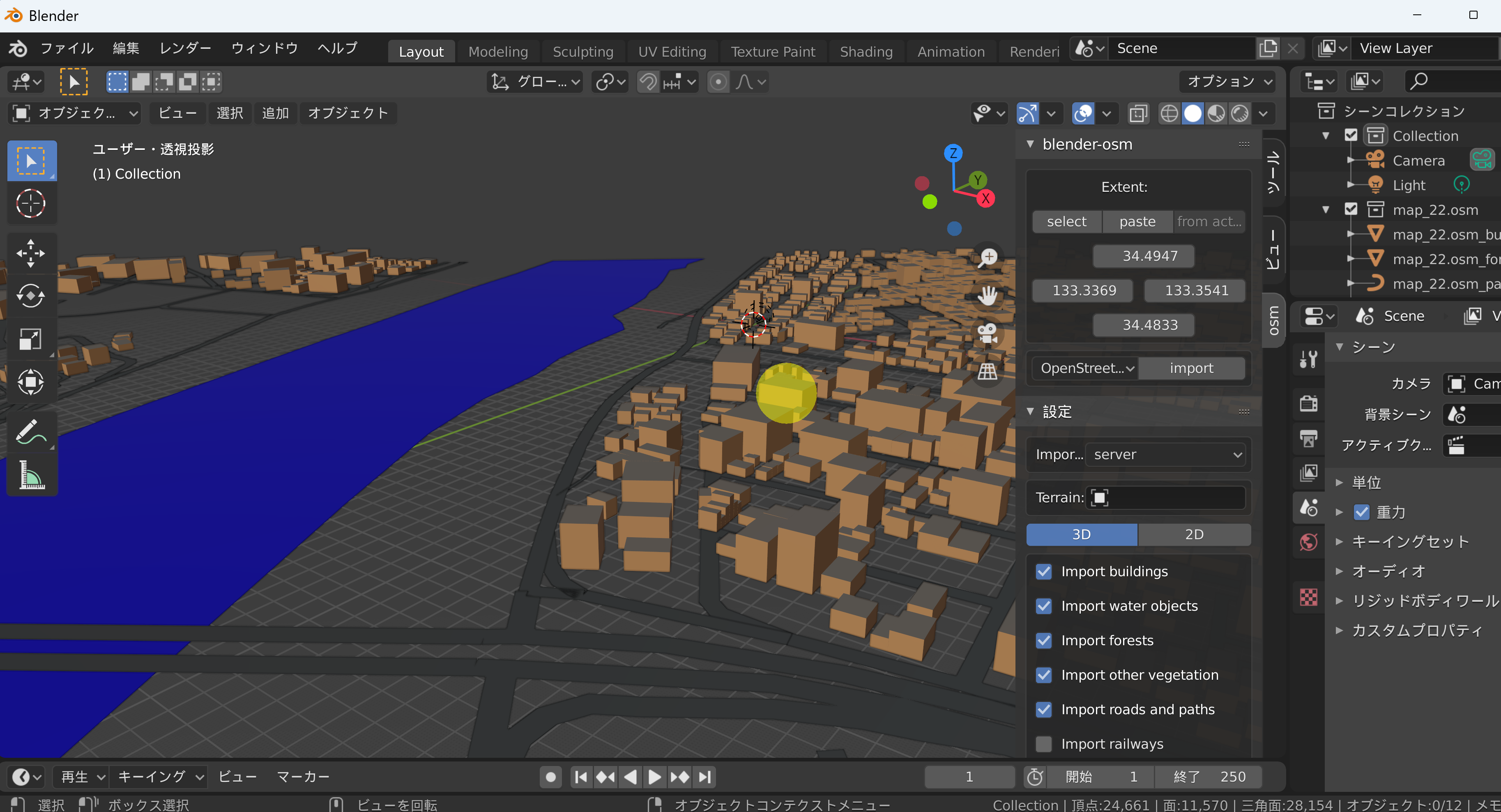

- 9/2: OpenStreetMap(共同編集型の自由な世界地図)と Blender (Blender に 地図データをインポート)

- Blender 2.83

Microsoft Store で入手できる

- blender-osm

blosm.zip を入手(展開はしなくてよい)

https://github.com/vvoovv/blender-osm/#blender-osm-openstreetmap-and-terrain-for-blender

- Blender で、アドオンの設定。blosm を使用。

- シェルフの「osm」を展開。緯度経度の範囲を指定して「import」をクリック。

- Blender 2.83

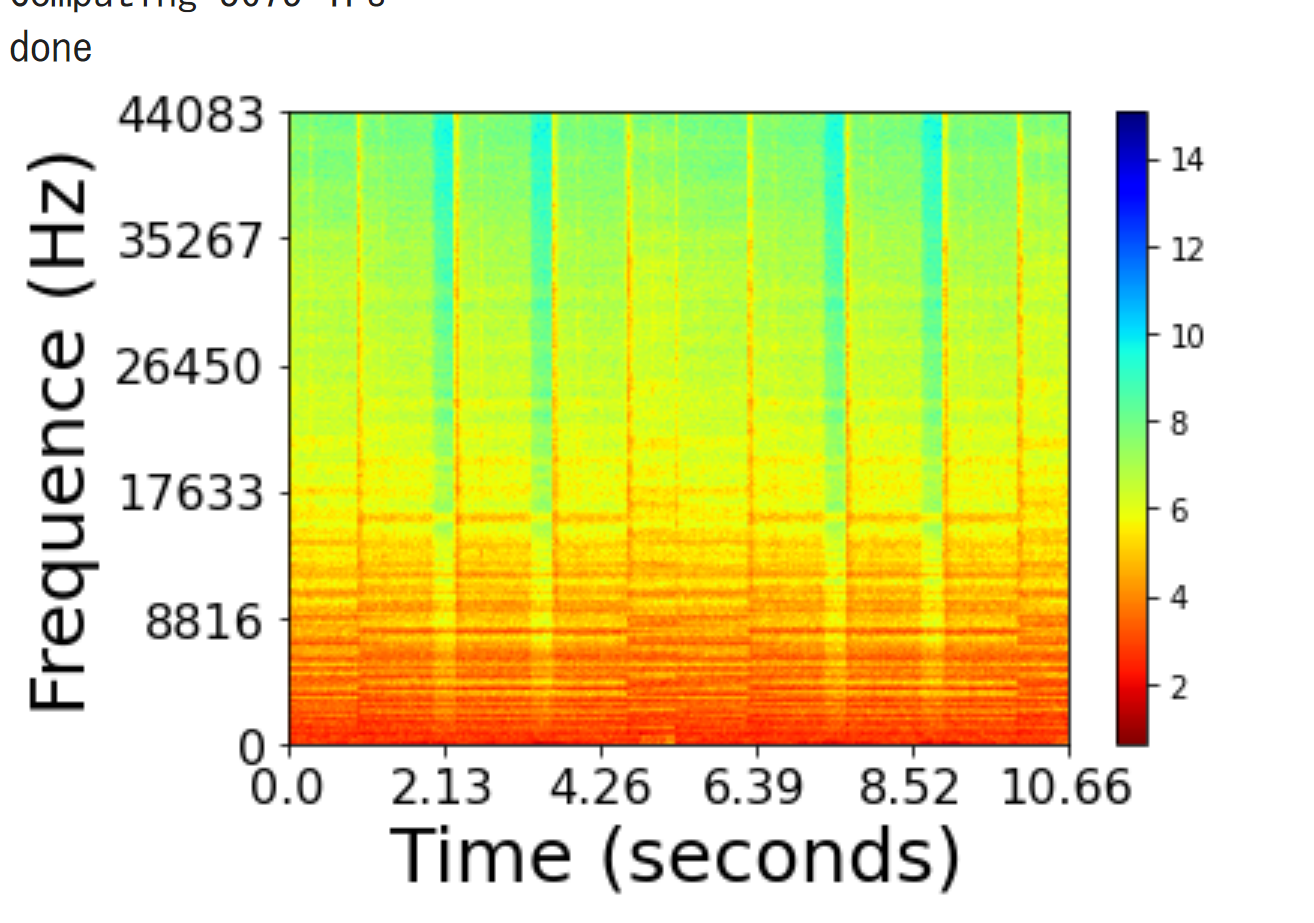

- 9/9 スペクトログラム (spectrogram)(音声を周波数成分で可視化した図)

音のデータを処理してグラフ化。

スペクトログラムは、横軸、縦軸が時間と周波数。音全体が1枚のグラフである。

スペクトログラムを作成する Python プログラム。

https://colab.research.google.com/drive/1H4W4mZKMXDfA9tbCcrzvyBpfVyREs8Wr?usp=sharing

次で公開されている音のデータ(.wav 形式ファイル)について、スペクトログラムを作成

- 9/16 頭部の位置推定 (head pose estimation)

頭部の位置推定 (head pose estimation) については 3/30 にも説明した。そちらの資料も参考にすること(別手法である)。

Google Colaboratory のページ

https://colab.research.google.com/drive/1-Fn90KL1IAAA58CW3yAr_Nj1FyvH9Oyd?usp=sharing

- 10/6 Box Landmark

画像やビデオから 3次元の Box Landmark 検出を行う。

MediaPipe Objectron(3D物体検出ライブラリ)を使用

【関係する外部ページ】

- MediaPipe Objectron のページ

https://github.com/google-ai-edge/mediapipe/tree/master/mediapipe/modules/objectron

- MediaPipe の公式 GitHub ページ

- Objectron Dataset のページ

Google Colaboratory のページ

https://colab.research.google.com/drive/1bakykeEVwdwfZlRuWdgBgPW6iU8MNO3z?usp=sharing

- MediaPipe Objectron のページ

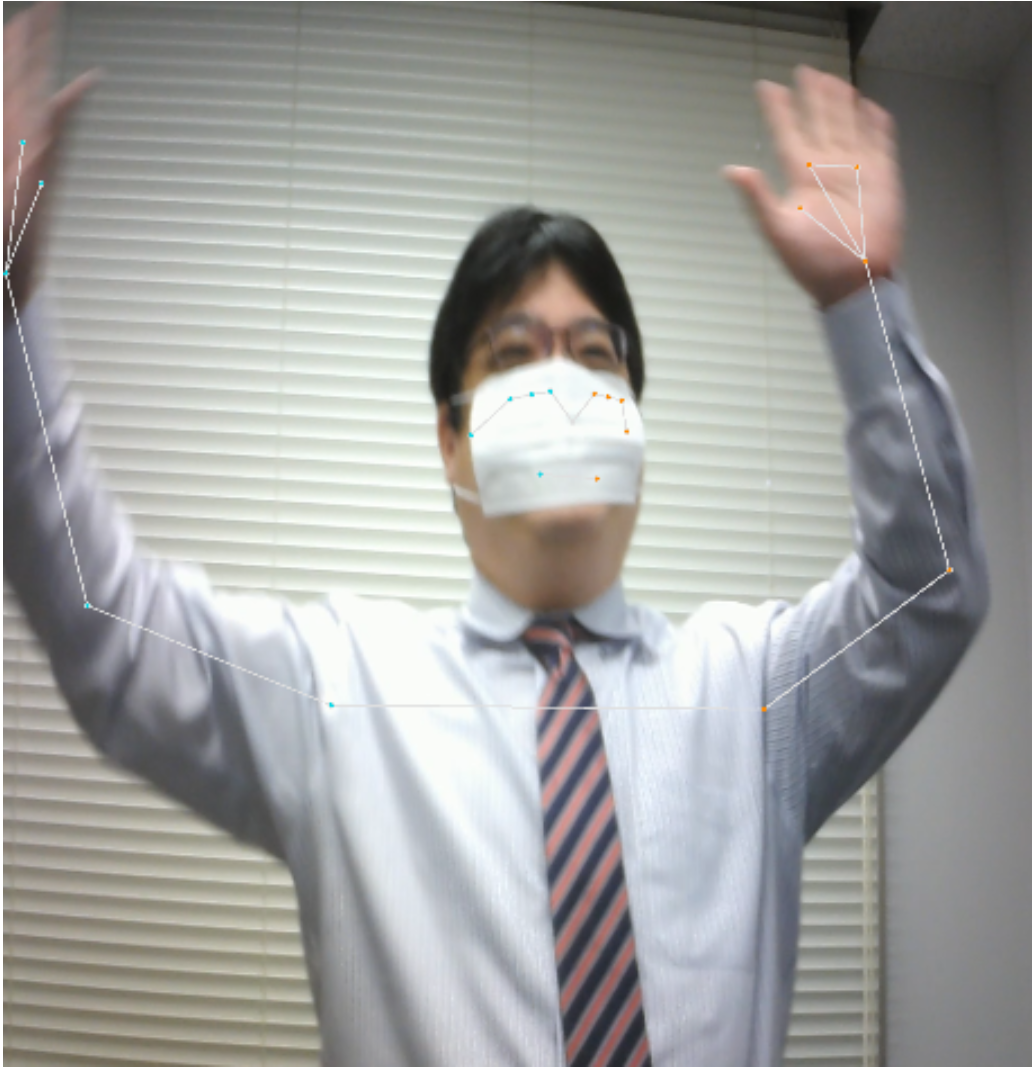

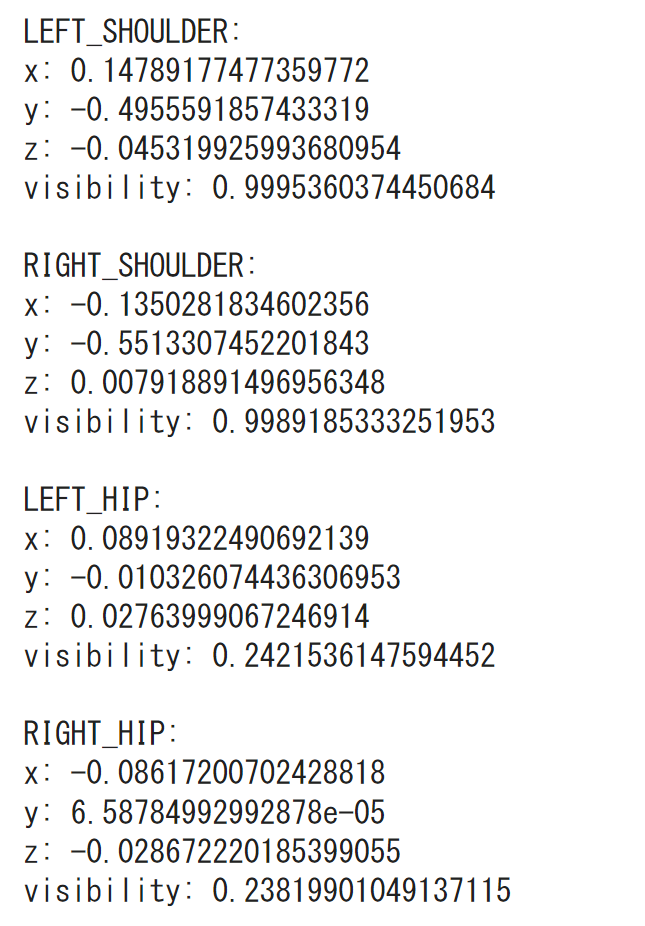

- 10/13 人体の3次元ランドマーク、3次元姿勢推定、セグメンテーション(MediaPipe Pose(3D人体姿勢推定ライブラリ)を使用)

MediaPipe Pose を使用して、画像から、人体の3次元ランドマーク検出、人体の3次元姿勢推定、人体のセグメンテーションを行う。

- MediaPipe の公式 GitHub ページ

- BlazeFace GHUM 3D の arXiv のページ

- MediaPipe Pose のデモプログラム(Google Colaboratory)

https://colab.research.google.com/drive/13nOMSW0Dzx_LjN9XEG99jtvgMACl4m9V#scrollTo=qVuMcBVQ4CtX

Google Colaboratory のページ

https://colab.research.google.com/drive/13nOMSW0Dzx_LjN9XEG99jtvgMACl4m9V#scrollTo=qVuMcBVQ4CtX で公開されているプログラムを一部書き換えて使用。

https://colab.research.google.com/drive/13nOMSW0Dzx_LjN9XEG99jtvgMACl4m9V

- 10/27 人体や物体の検出、人体や物体のインスタンス・セグメンテーション、人体の姿勢推定、人体のパーツの切り出し(頭部、胴体、腕、足)

https://colab.research.google.com/drive/1R5v675dfX92tNCfXy9sWUa5UQdxQsfpM?usp=sharing

- 11/10 物体検出(YOLOv5(高速・高精度な物体検出アルゴリズム)を使用)

https://colab.research.google.com/drive/1RsxKuJLQ7hHmHOr0p7QK7igI2AFkb608?usp=sharing

- 11/17, インスタンス・セグメンテーション (Detectron2(物体検出・セグメンテーション用ライブラリ)を使用)

Detectron2 を使用。さまざまなモデルでインスタンス・セグメンテーションを実行。

- Mask R-CNN R50 FPN, COCO データセットで学習済み

- Mask R-CNN X101 FPN, COCO データセットで学習済み

- Mask R-CNN X152 FPN, COCO データセットで学習済み

- Mask R-CNN X101 FPN, LVISデータセット(大規模語彙インスタンスセグメンテーションデータセット)で学習済み

- Mask R-CNN R50 FPN, Cityscapes データセットで学習済み

- Faster R-CNN R50 C4, PASCAL VOCデータセット(物体クラス認識チャレンジ用データセット)で学習済み

Detectron2 の github のページ:

https://github.com/facebookresearch/detectron2

Google Colaboratory のページ

https://colab.research.google.com/drive/1ikWanuaLMM-dqCnS2SBRsPG1YW0UNzMR?usp=sharing

11/24(木曜日) 14:30 から、卒業研究論文に関する個別面談を予定したい

データマネジメント、データ分析、グラフ作成(Python による自動化を含む):棒グラフ、円グラフ、散布図、ヒストグラム(データの度数分布を示すグラフ)、線形近似、カーネル密度推定(データ分布を滑らかに推定する手法)、自動分類(クラスタリング(データを類似性に基づいてグループ化する手法))

動画: https://www.youtube.com/embed/rcAP-p6r4Xw

Google Colaboratory のページ: https://colab.research.google.com/drive/1hY4O7yUV0zqcmHypRst1RnX2mt8_zatE?hl=ja#scrollTo=gIuquwzlcOck

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)