人工知能,データサイエンス,統計,コンピュータビジョンの用語集

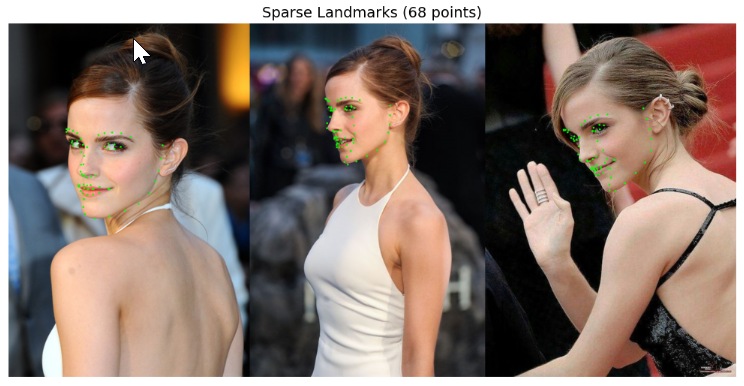

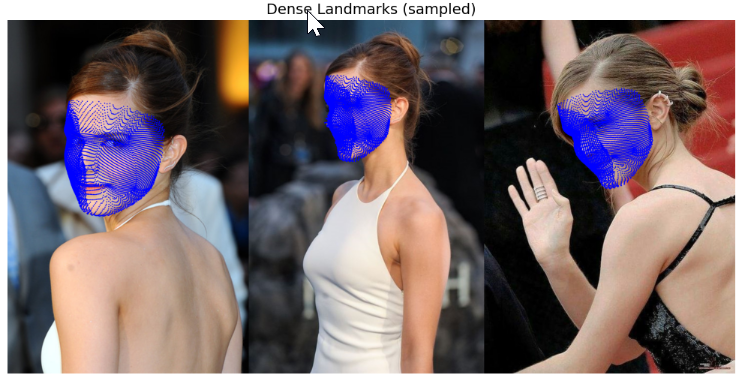

300W (300 Faces-In-The_Wild) データセット

顔のデータベース、顔の 68 ランドマークが付いている。

【文献】

C. Sagonas, G. Tzimiropoulos, S. Zafeiriou and M. Pantic, "300 Faces in-the-Wild Challenge: The First Facial Landmark Localization Challenge," 2013 IEEE International Conference on Computer Vision Workshops, 2013, pp. 397-403, doi: 10.1109/ICCVW.2013.59.

https://ibug.doc.ic.ac.uk/media/uploads/documents/sagonas_2016_imavis.pdf

【関連する外部ページ】

- 300 Faces In-The-Wild Challenge のページ: https://ibug.doc.ic.ac.uk/resources/300-W/

- OpenMMLab の 300W データセット: https://github.com/open-mmlab/mmpose/blob/master/docs/en/tasks/2d_face_keypoint.md#300w-dataset

【関連項目】 HELEN データセット, iBUG 300-W データセット, face alignment, 顔ランドマーク (facial landmark)の検出, 3次元の顔の再構成 (3D face reconstruction), OpenMMLab, 顔の 68 ランドマーク, 顔のデータベース

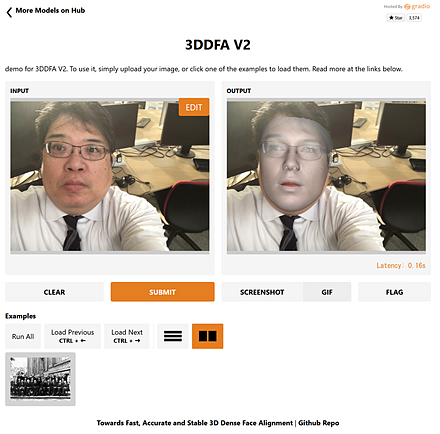

3DDFA_V2

3DDFA_V2 は、 3次元の顔の再構成 (3D face reconstruction) のうち dense vertices regression を行う一手法。論文は、2020年発表。

【文献】

Jianzhu Guo, Xiangyu Zhu, Yang Yang, Fan Yang, Zhen Lei, Stan Z. Li, Towards Fast, Accurate and Stable 3D Dense Face Alignment, ECCV 2020.

https://arxiv.org/pdf/2009.09960v2.pdf

【関連する外部ページ】

- GitHub のページ: https://github.com/cleardusk/3DDFA_V2

-

Hugging Face での 3DDFA_V2 のオンライン実行

URL: https://huggingface.co/spaces/PKUWilliamYang/3DDFA_V2

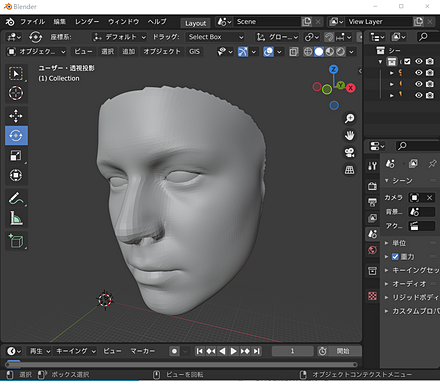

作成された3次元モデルを Blender にインポートした画面。

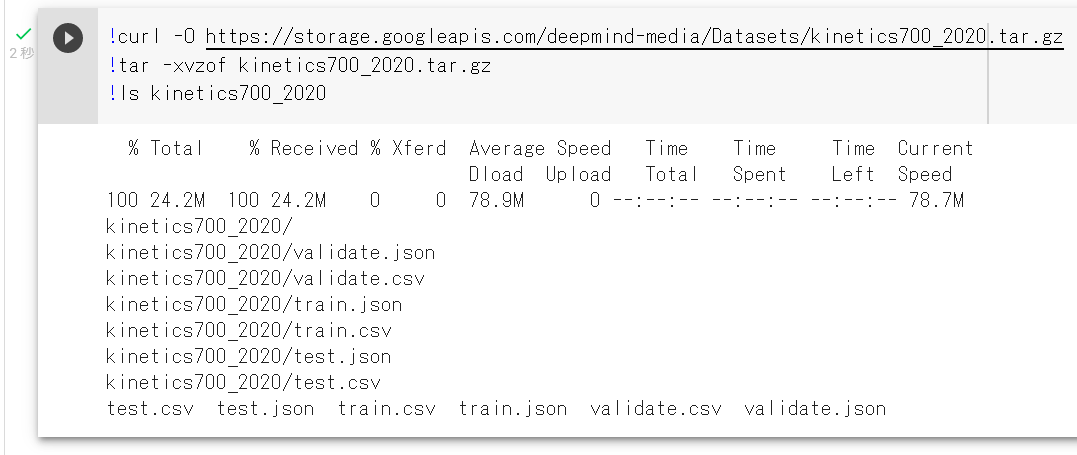

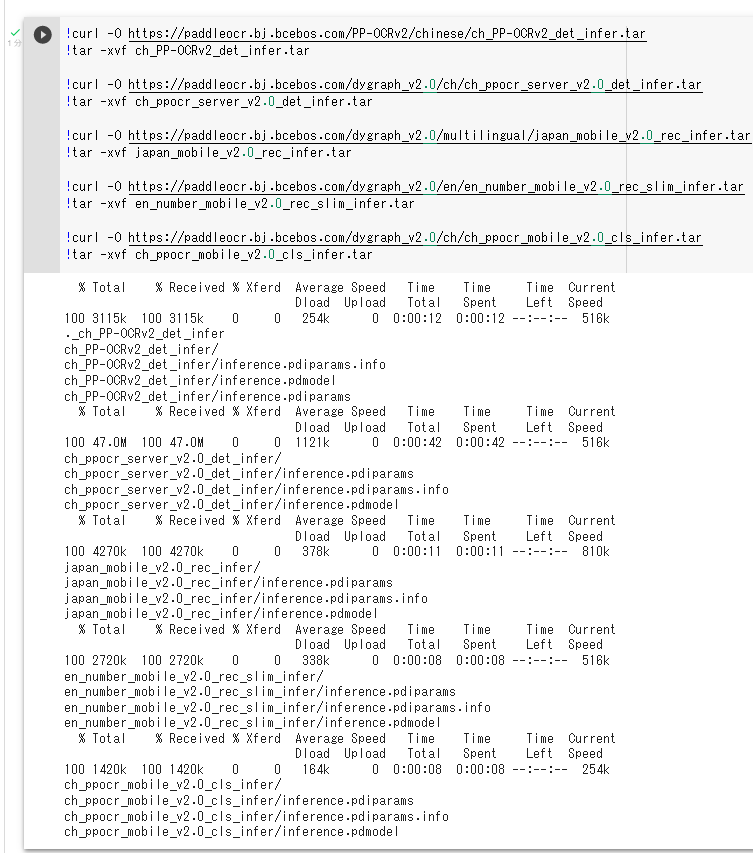

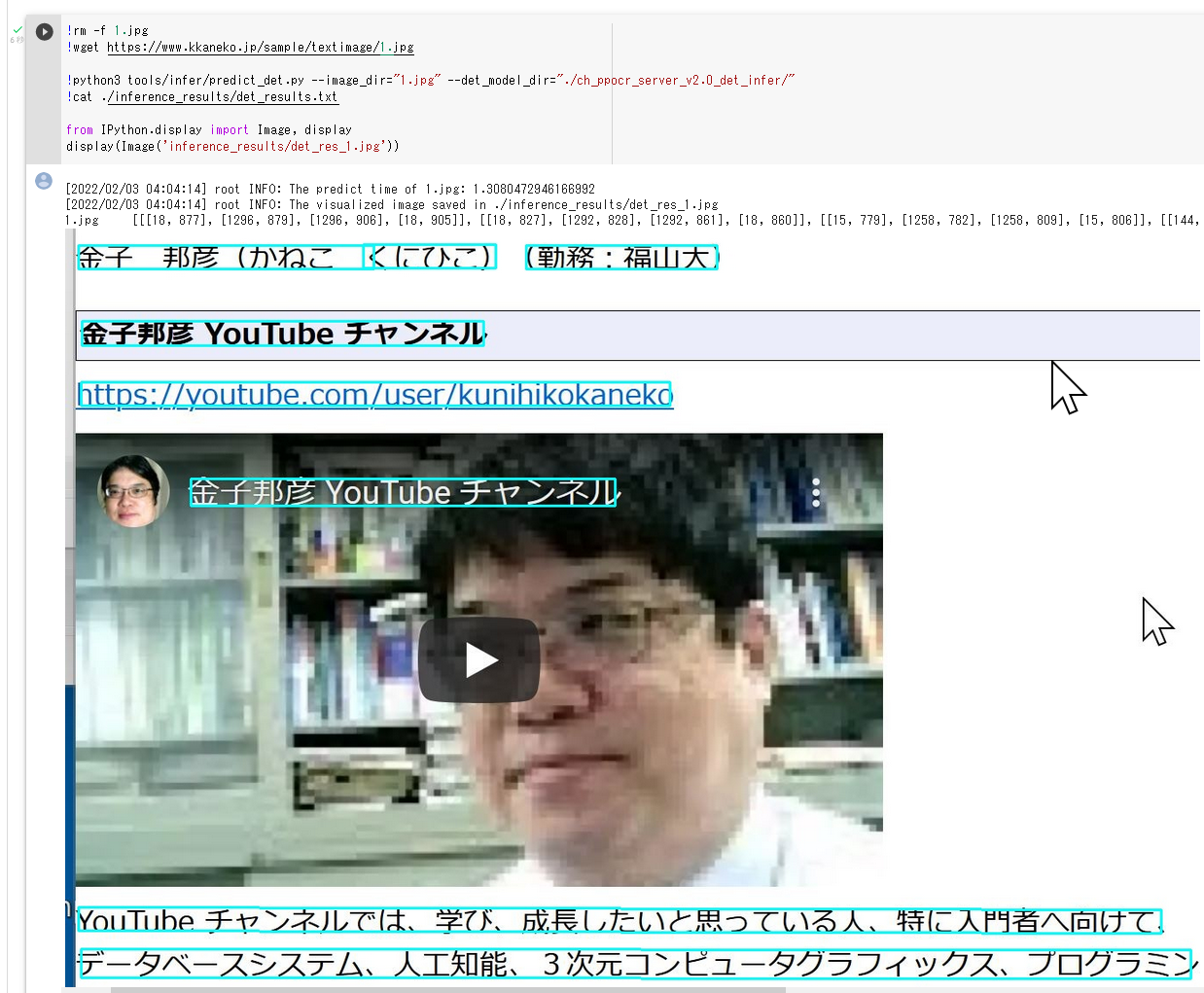

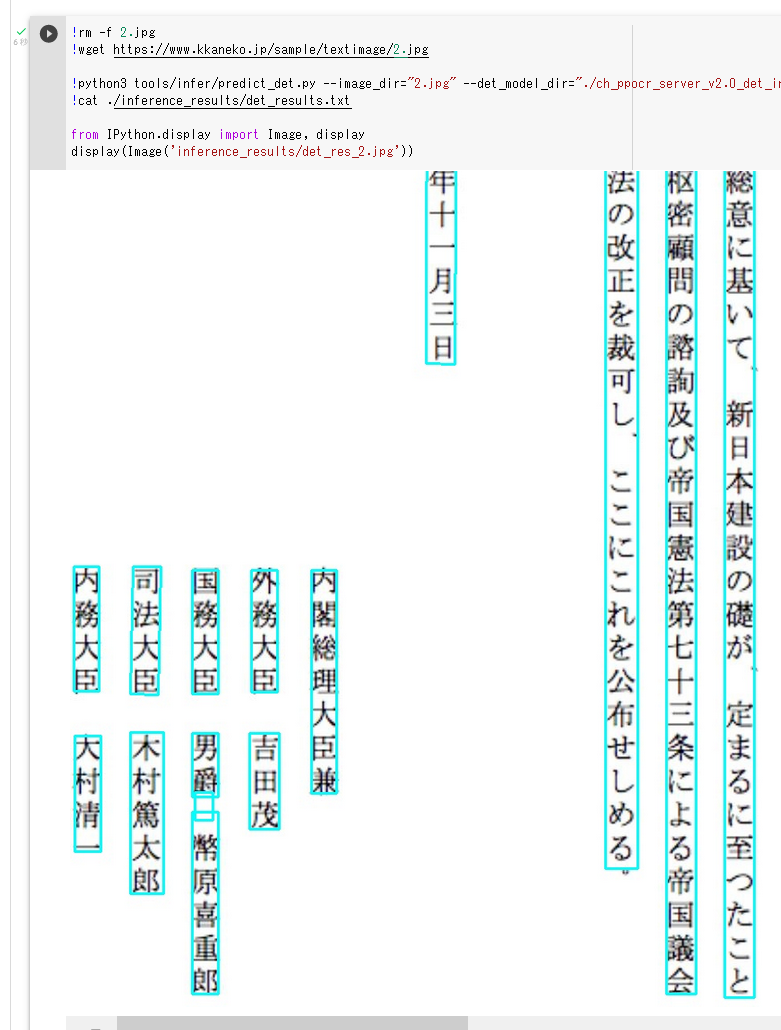

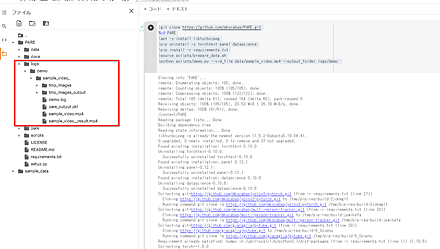

Google Colaboratory での 3DDFA_V2 のオンライン実行

次のページでは、Google Colaboratory で実行できるプログラムコード、プログラム利用ガイド、プログラムコードの説明など示している。

URL: https://www.kkaneko.jp/ai/intro/3ddfav2.html

【概要】本記事では、3DDFA_V2フレームワークを用いた3次元顔モデル生成プログラムについて解説する。単一の顔画像から3次元形状を復元し、OBJ/PLY形式で出力する技術をGoogle Colab環境で提供する。

Colabのページ(ソースコードと説明): https://colab.research.google.com/drive/1fNfAdCRxnxxcxj9mH7lFVsP-uz4DAWoV?usp=sharing

3次元姿勢推定 (3D pose estimation)

画像から、物体検出を行うとともに、その3次元の向きの推定も行う。

【関連項目】 Objectron

3次元の顔の再構成 (3D face reconstruction)

3次元の顔の再構成 (3D face reconstruction) は、 顔の写った画像から、元の顔の3次元の形を構成すること。

3次元の顔の再構成は、次の2つの種類がある。

- 3次元の変形可能な顔のモデル (3D Morphable Model) について、そのパラメータを、画像を使って推定すること。 FaceRig などが有名である。

- dense vertices regression: dense は「密な」、vertices は「頂点」、regression は「回帰」。画像から、顔の3次元データであるポリゴンメッシュを推定する

3次元再構成 (3D reconstruction)

3次元再構成 (3D reconstruction) の機能をもつソフトウェアとしては、 colmap、 Meshroom がある。

【関連項目】 colmap, Meshroom, Multi View Stereo, OpenMVG, OpenMVS, Structure from Motion

AdaDelta 法

M.Zeiler の AdaDelta 法は、学習率をダイナミックに変化させる技術。 学習率をダイナミックに変化させる技術は、その他 Adam 法なども知られる。

確率的勾配降下法 (SGD 法) をベースとしているが、 確率的勾配降下法が良いのか、Adadelta 法が良いのかは、一概には言えない。

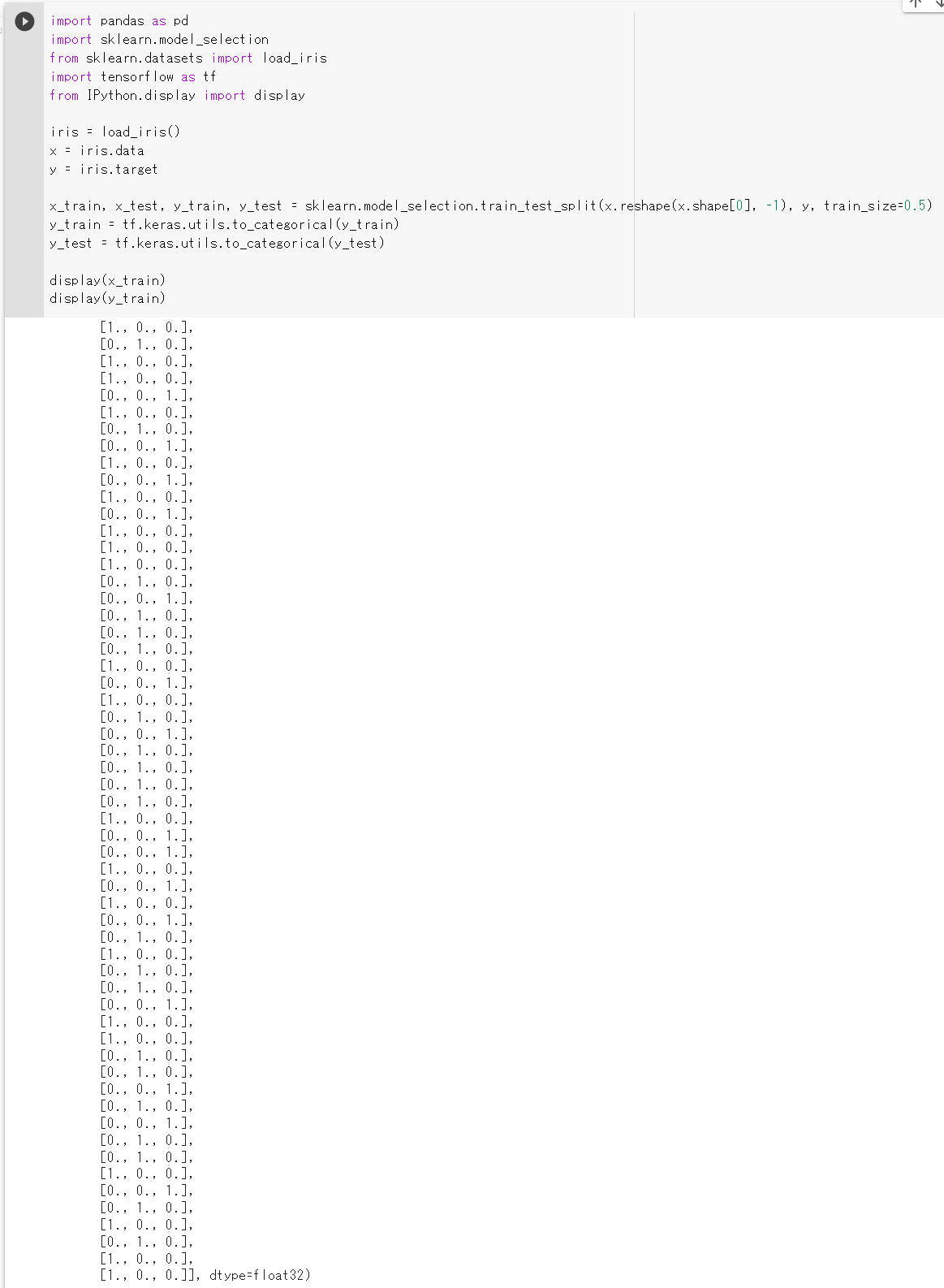

from tensorflow.keras.optimizers import Adadelta

optimizer = Adadelta(rho=0.95)

M. Zeiler, Adadelta An adaptive learning rate method, 2012.

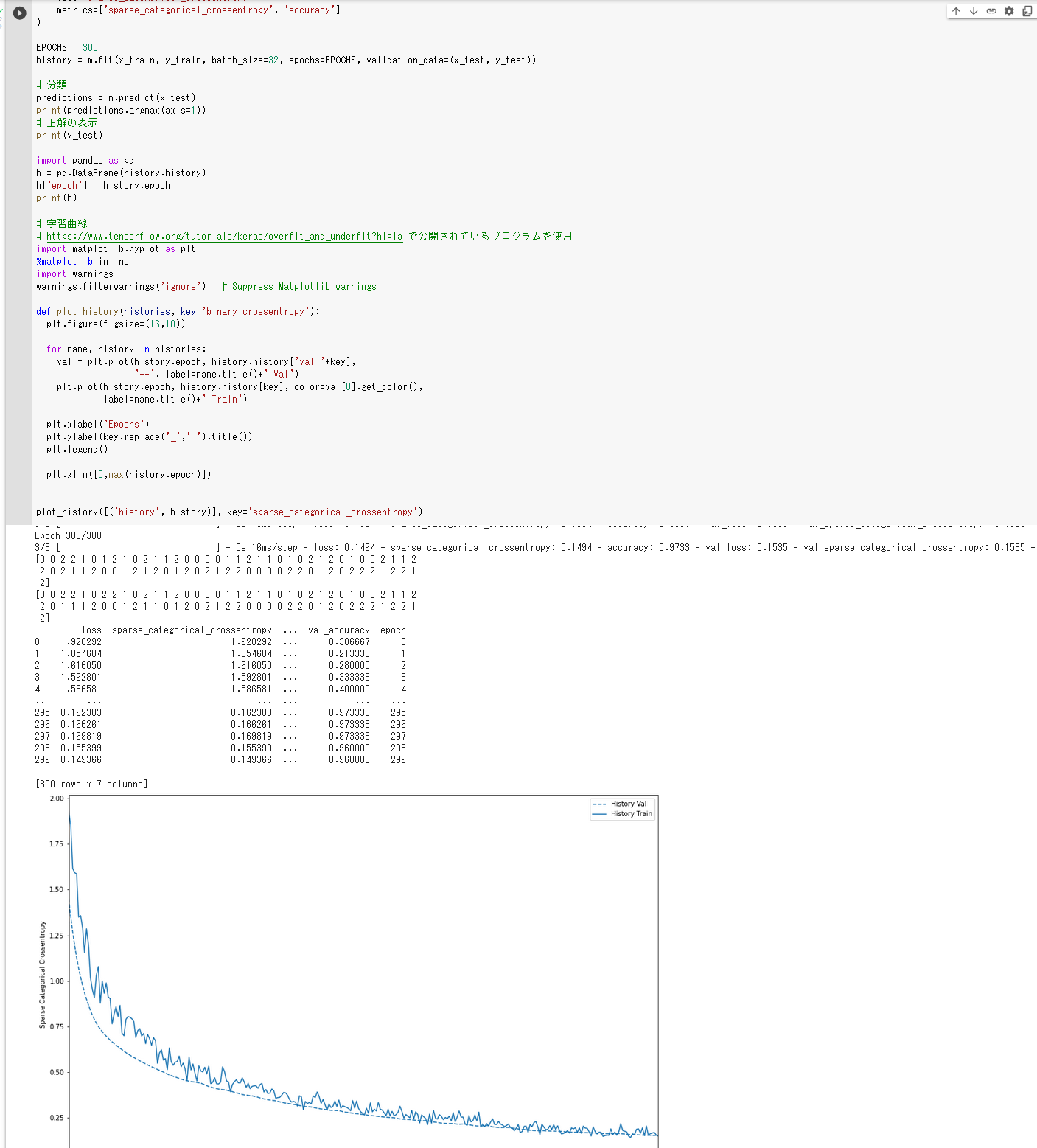

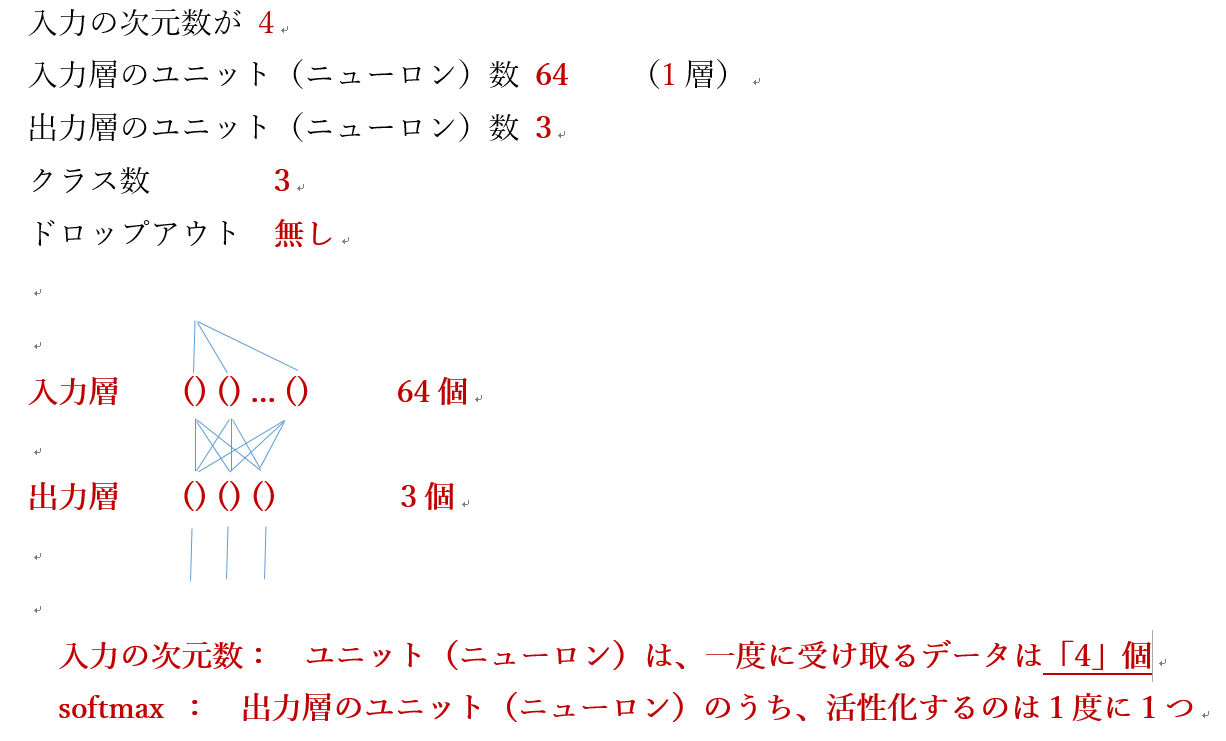

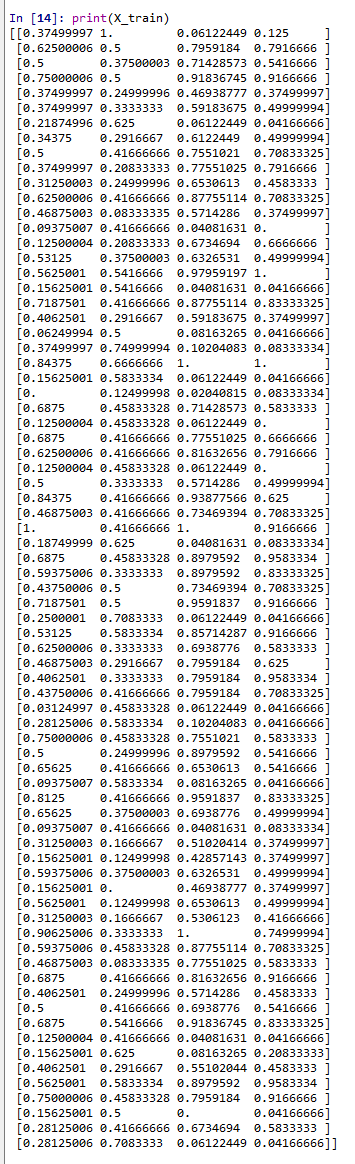

Adam 法

Adam 法は、学習率をダイナミックに変化させる技術。 学習率をダイナミックに変化させる技術は、その他 AdaDelta 法なども知られる。 Adam 法を使うプログラム例は次の通り。

m.compile(

optimizer=tf.keras.optimizers.Adam(learning_rate=0.001),

loss='sparse_categorical_crossentropy',

metrics=['sparse_categorical_crossentropy', 'accuracy']

)

Diederik Kingma and Jimmy Ba, Adam: A Method for Stochastic Optimization, 2014, CoRR, abs/1412.6980

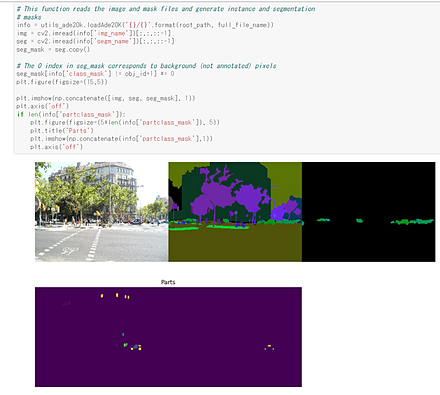

ADE20K データセット

ADE20K データセット は、 セマンティック・セグメンテーション、シーン解析(scene parsing)、 インスタンス・セグメンテーション (instance segmentation)についてのアノテーション済みの画像データセットである。

次の特色がある

- データの多様性

- 画素単位でのアノテーション

- オブジェクト(car や person など) も、背景領域も(grass, sky など) アノテーションされている。

- 腕や足などの、オブジェクトのパーツ (object parts) もアノテーションされている。

画像数、オブジェクト数などは次の通り。

- 画像数: 30,574 枚

うち学習用: 25,574 枚、 うち検証用: 2,000 枚、 うちテスト用: 3,000 枚。

- オブジェクト数: 707,868

- オブジェクトのカテゴリ数: 3,688

- アノテーションされたオブジェクトのパーツ (object parts) : 193,238

利用には、次の URL で登録が必要。

ADE20K データセットの URL: http://groups.csail.mit.edu/vision/datasets/ADE20K/

【文献】

- Bolei Zhou, Hang Zhao, Xavier Puig, Sanja Fidler, Adela Barriuso, Antonio Torralba, Scene Parsing Through ADE20K Dataset, CVPR 2017, also CoRR, abs/1608.05442, 2017.

- Bolei Zhou, Hang Zhao, Xavier Puig, Tete Xiao, Sanja Fidler, Adela Barrieso and Antonio Torralba, Semantic Understanding of Scenes through ADE20K Dataset, International Journal on Computer Vision (IJCV), also CoRR, abs/1608.05442v2, 2016.

【関連する外部ページ】

- ADE20K データセットの URL: http://groups.csail.mit.edu/vision/datasets/ADE20K/

- CSAILVision の ADE20K のページ (GitHub のページ): https://github.com/CSAILVision/ADE20K

- CSAILVision の ADE20K スターターコード のページ (GitHub のページ):

https://github.com/CSAILVision/ADE20K/blob/main/notebooks/ade20k_starter.ipynb

このスターターコードは、画像1枚について元画像とアノテーションを表示するもの

- Papers With Code の ADE20K データセットのページ: https://paperswithcode.com/dataset/ade20k

【関連項目】 セマンティック・セグメンテーション (semantic segmentation), シーン解析(scene parsing), インスタンス・セグメンテーション (instance segmentation), Detectron2, CSAILVision, MIT Scene Parsing Benchmark, 物体検出

AFLW (Annotated Facial Landmarks in the Wild) データセット

AFLW (Annotated Facial Landmarks in the Wild) データセットは、 Flickr から収集された24,386枚の顔画像である。 さまざまな表情、民族、年齢、性別、撮影条件、環境条件の顔が収集されている。 それぞれの顔には、最大21個の顔ランドマークが付けられている。

- 24,386枚の画像。うち、59%が女性、41%が男性である。複数の顔を含む画像もある。 ほとんどの画像がカラーだが、中には、濃淡画像もある。

- 約380,000 の顔について、顔ごとに 21 個の顔ランドマークが付いている。

- 顔で、左耳たぶが見えてないような場合、左耳たぶの顔ランドマークはアノテーションされていない(見えない場合はアノテーションされない)

次の URL で公開されているデータセット(オープンデータ)である。

URL: https://www.tugraz.at/institute/icg/research/team-bischof/lrs-group/downloads

【文献】

M. Köstinger, P. Wohlhart, P. M. Roth and H. Bischof, "Annotated Facial Landmarks in the Wild: A large-scale, real-world database for facial landmark localization," 2011 IEEE International Conference on Computer Vision Workshops (ICCV Workshops), 2011, pp. 2144-2151, doi: 10.1109/ICCVW.2011.6130513.

【関連する外部ページ】

- Papers With Code の AFLW データセットのページ: https://paperswithcode.com/dataset/aflw

- open-mmlab での記事

https://github.com/open-mmlab/mmpose/blob/master/docs/en/tasks/2d_face_keypoint.md#aflw-dataset

AgeDB データセット

手作業で収集された、「in-the-wild」の顔と年齢のデータベース。 年号まで正確に記録された顔画像が含まれている。

次の URL で公開されているデータセット(オープンデータ)である。

https://ibug.doc.ic.ac.uk/resources/agedb/

【文献】

S. Moschoglou, A. Papaioannou, C. Sagonas, J. Deng, I. Kotsia and S. Zafeiriou, "AgeDB: The First Manually Collected, In-the-Wild Age Database," 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops (CVPRW), 2017, pp. 1997-2005, doi: 10.1109/CVPRW.2017.250.

https://ibug.doc.ic.ac.uk/media/uploads/documents/agedb.pdf

【関連する外部ページ】

【関連項目】 顔認識 (face recognition), 顔のデータベース

AIM-500 (Automatic Image Matting-500) データセット

イメージ・マッティング (image matting) のデータセット。 3種類の前景(Salient Opaque, Salient Transparent/Meticulous, Non-Salient)を含む 500枚の画像について、元画像と alpha matte と Trimap のデータセットである。

次の URL で公開されているデータセット(オープンデータ)である。

URL: https://drive.google.com/drive/folders/1IyPiYJUp-KtOoa-Hsm922VU3aCcidjjz

【文献】

Jizhizi Li, Jing Zhang, DaCheng Tao, Deep Automatic Natural Image Matting, CoRR, abs/2107.07235v1, 2021.

https://arxiv.org/pdf/2107.07235v1.pdf

【関連する外部ページ】

- 公式ページ の URL: https://github.com/JizhiziLi/AIM

- Papers with Code のページ: https://paperswithcode.com/dataset/aim-500

【関連項目】 イメージ・マッティング (image matting), オープンデータ (open data)

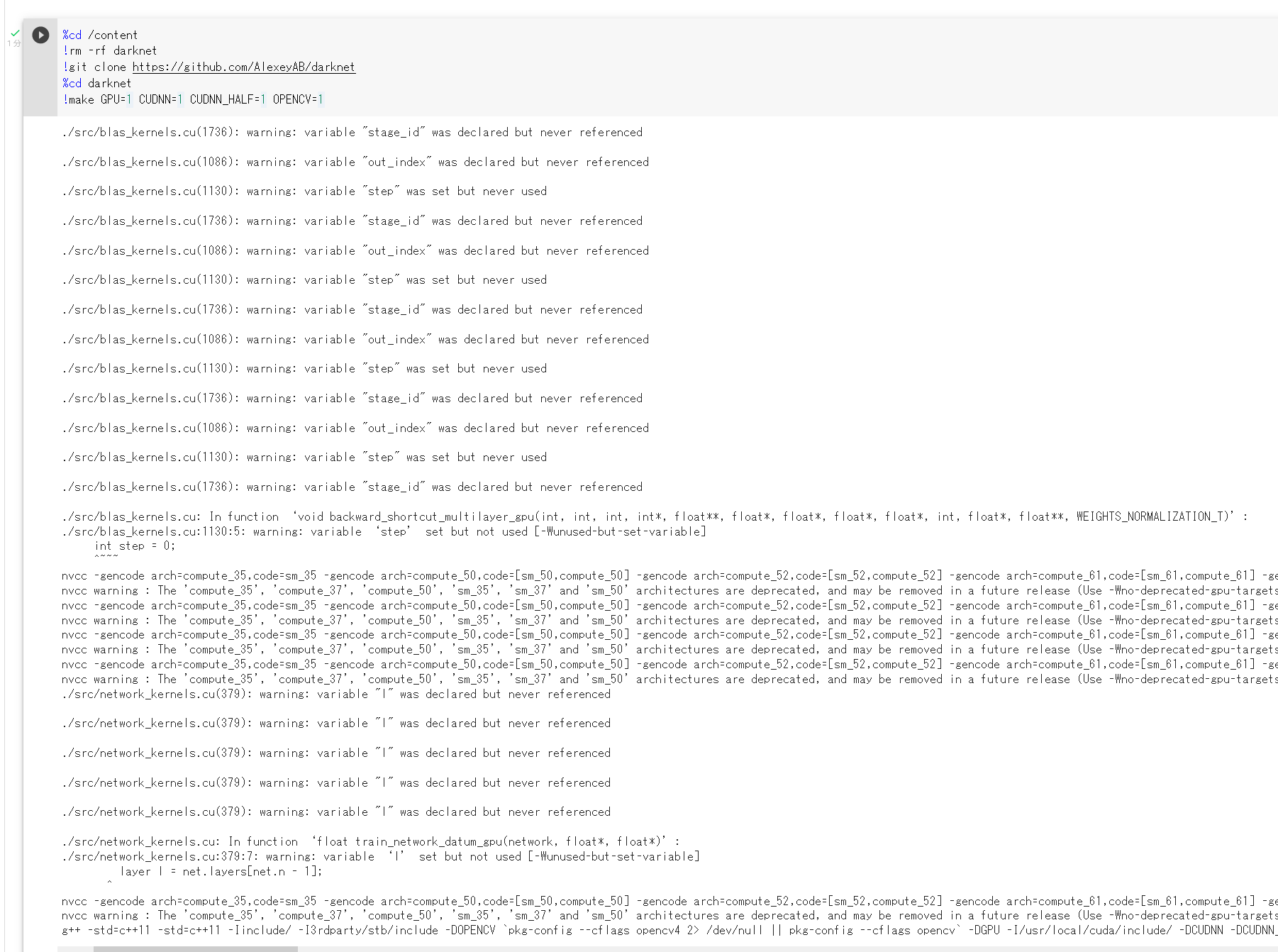

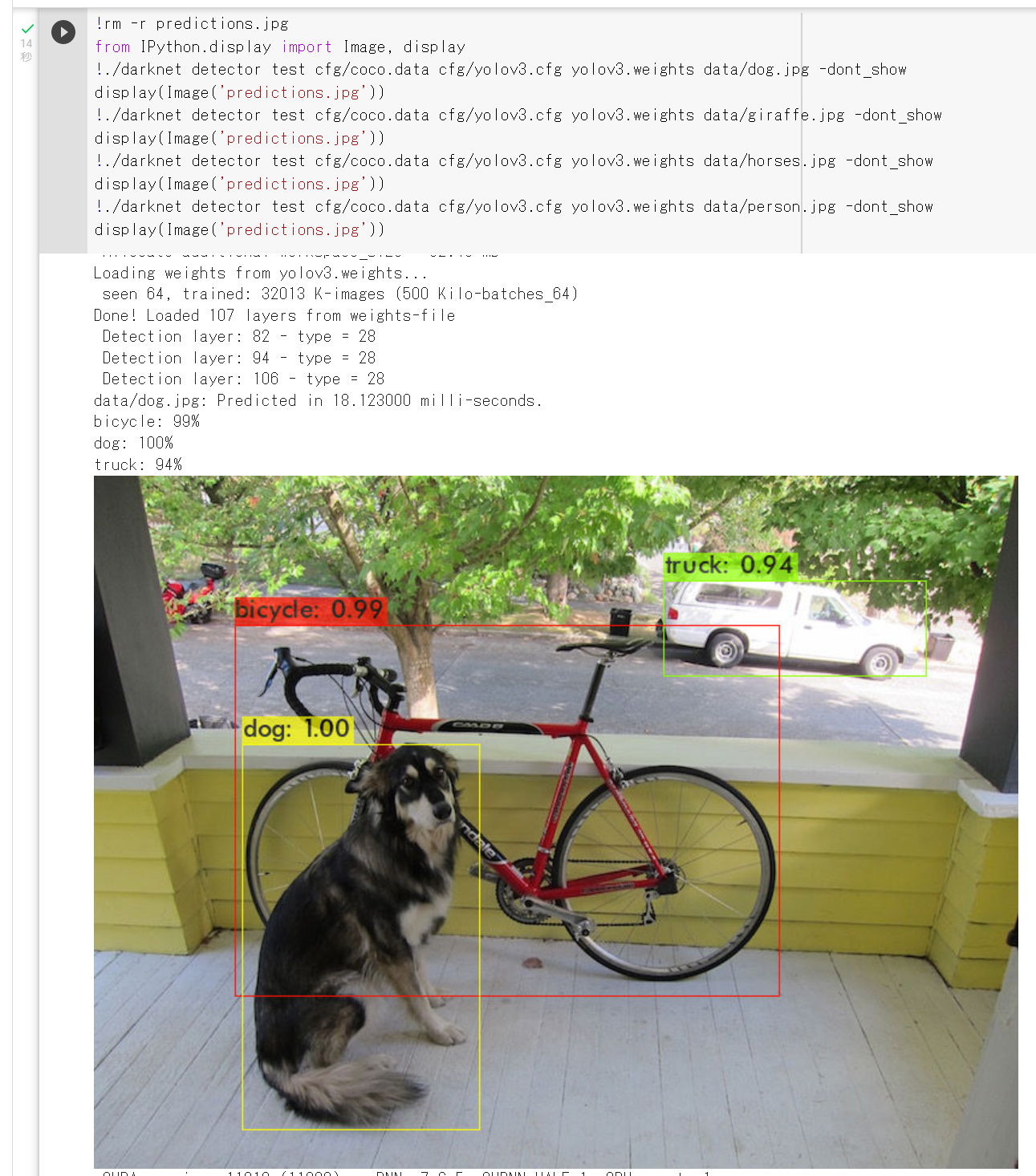

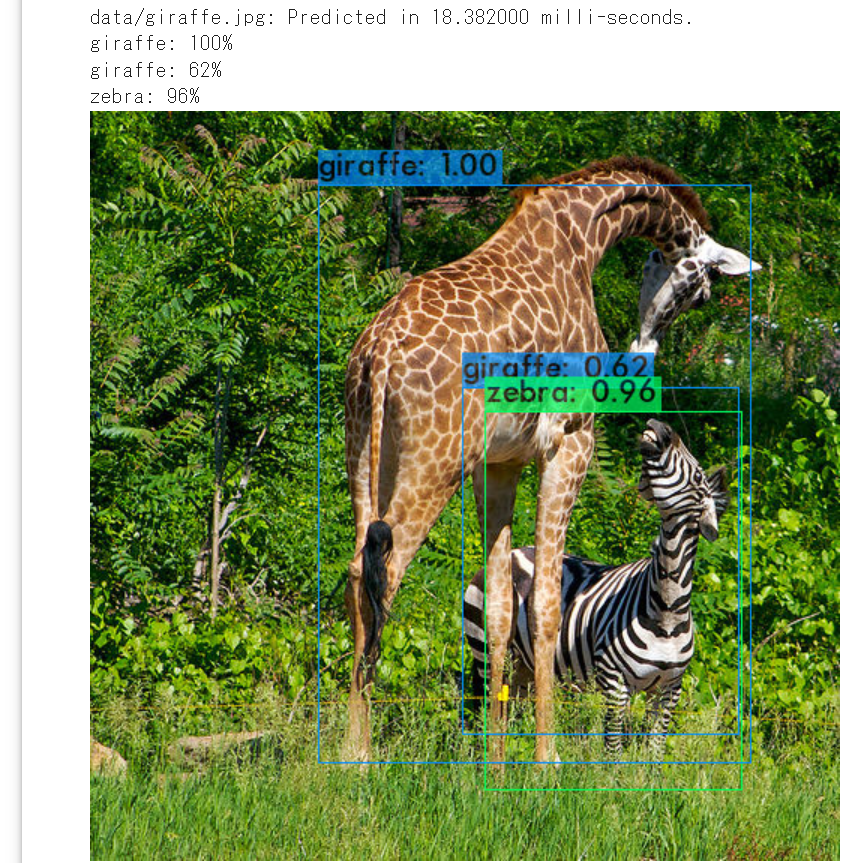

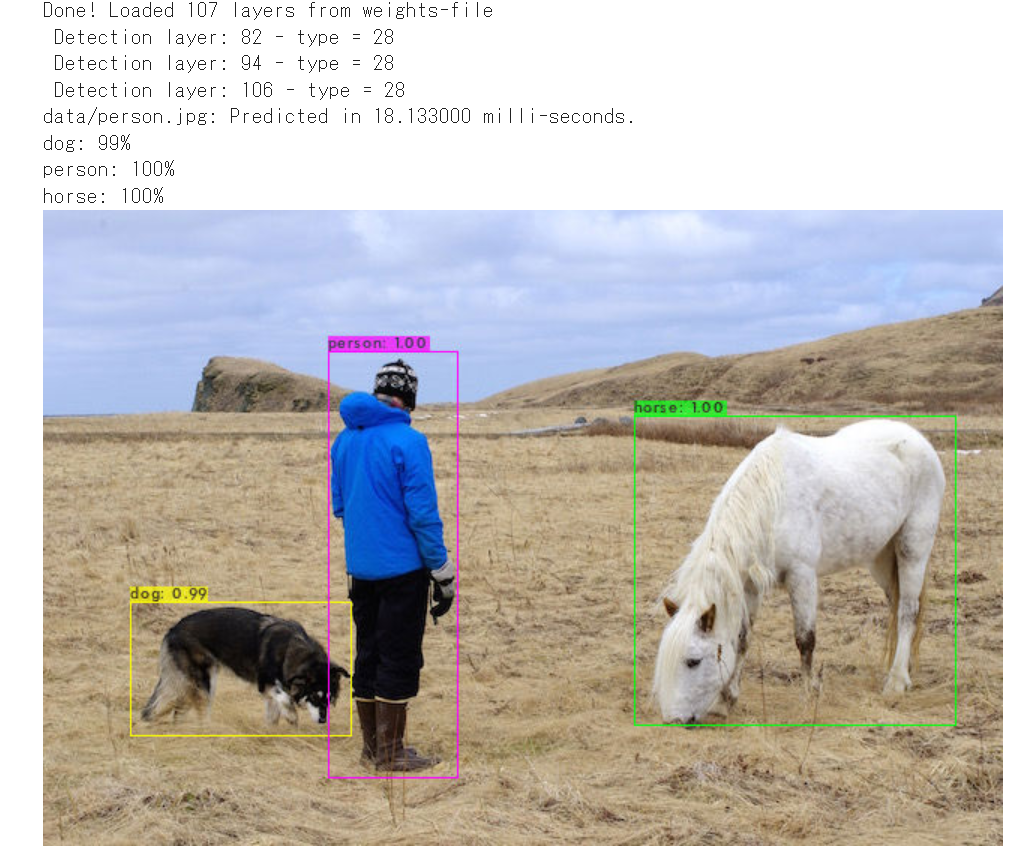

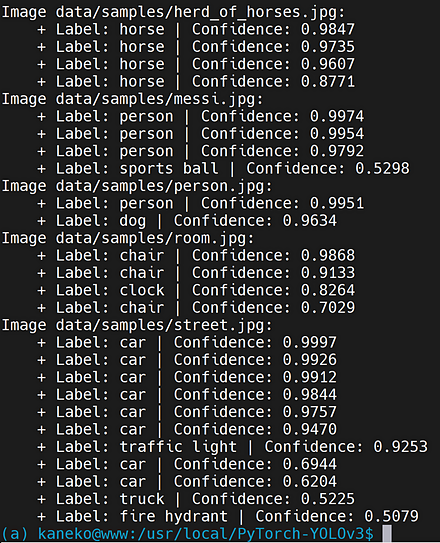

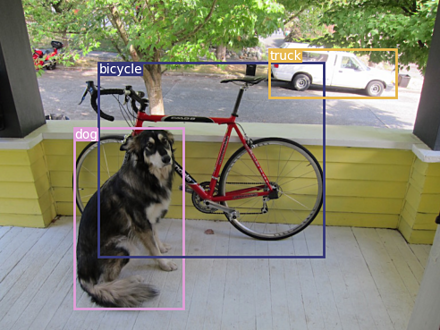

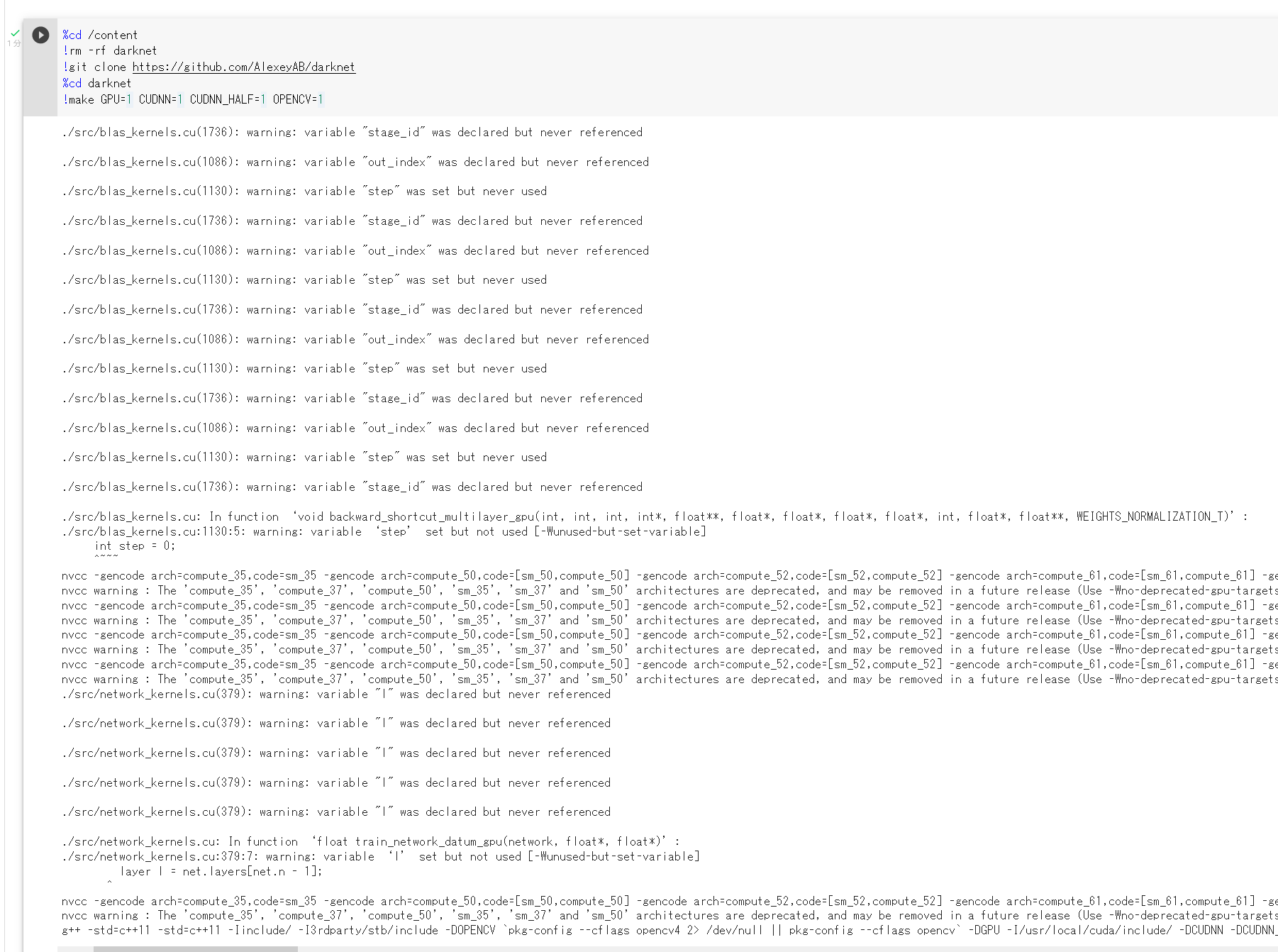

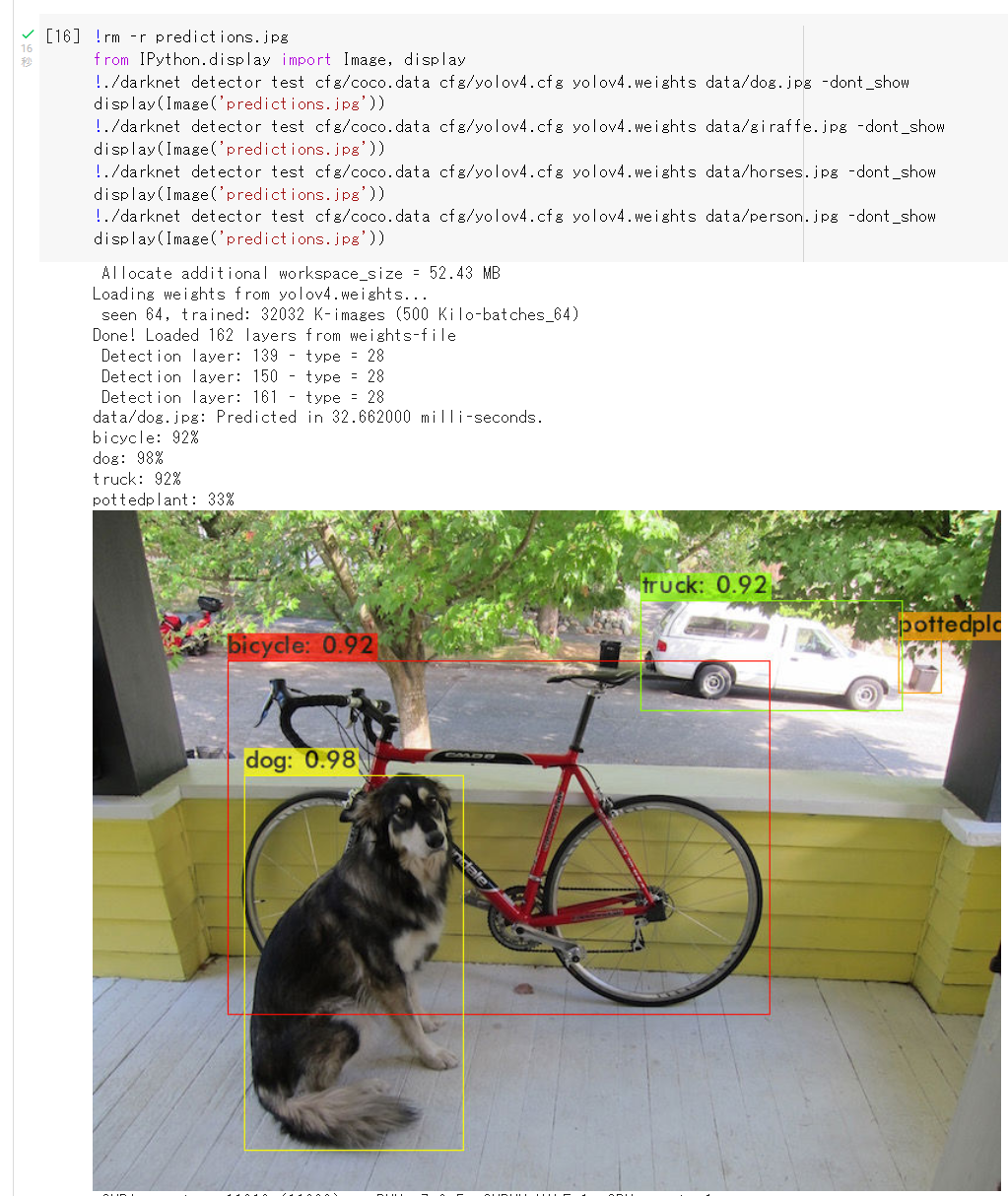

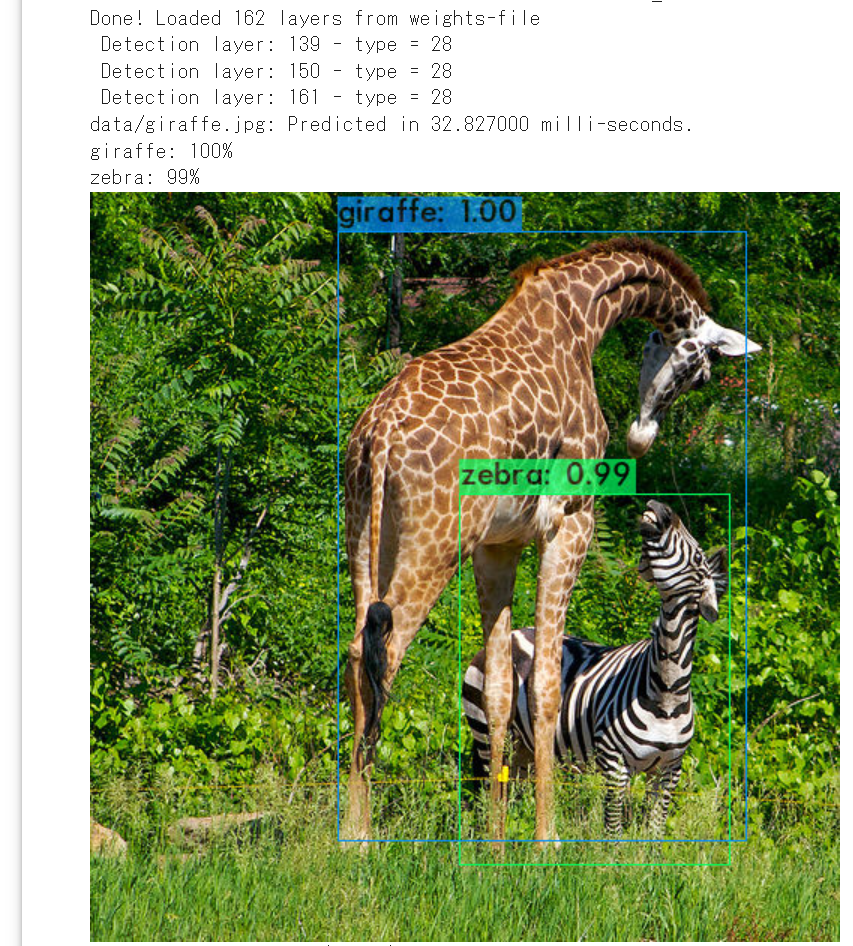

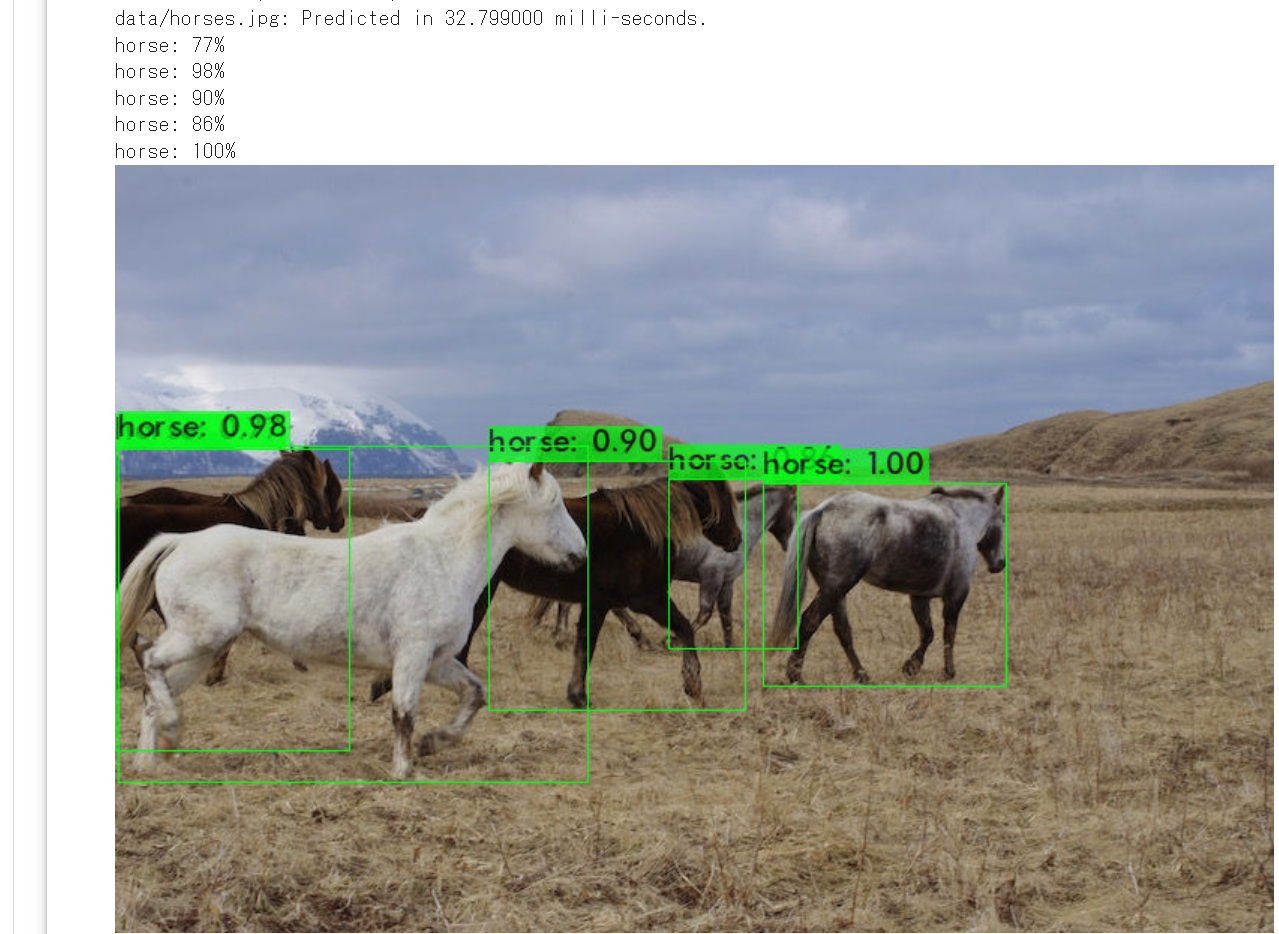

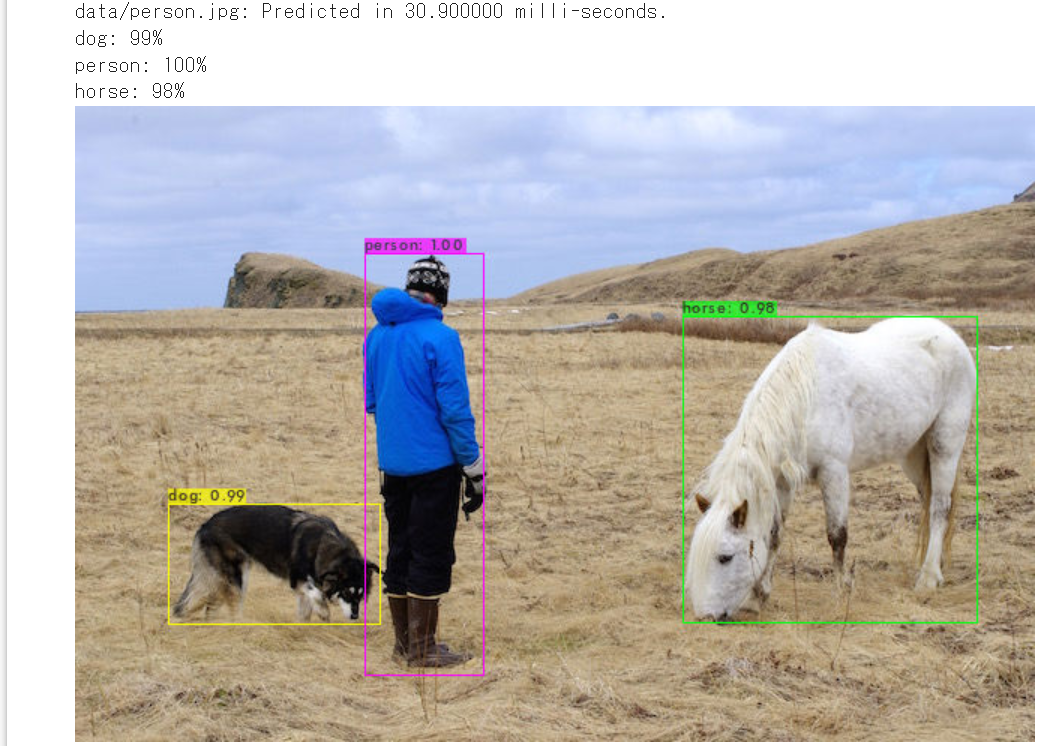

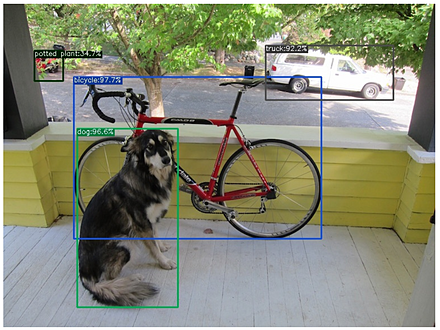

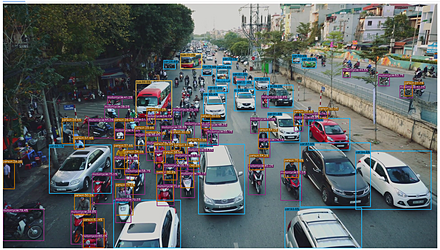

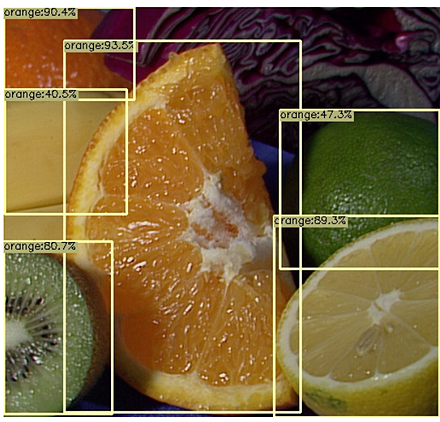

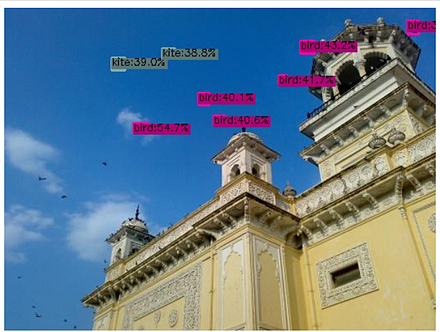

AlexeyAB darknet

AlexeyAB darknet は、YOLOv2, YOLOv3, YOLOv4 の機能などを持つ。

【文献】

Chien-Yao Wang, Alexey Bochkovskiy, Hong-Yuan Mark Liao, Scaled-YOLOv4: Scaling Cross Stage Partial Network, Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) 2021, pp. 13029-13038, also CoRR, Scaled-YOLOv4: Scaling Cross Stage Partial Network, 2021.

https://arxiv.org/pdf/2011.08036v2.pdf

【サイト内の関連ページ】 AlexeyAB/darknet のインストールと動作確認(Scaled YOLO v4 による物体検出)(Windows 上)

【関連する外部ページ】

- Alexey による darknet の実装(GitHub)ページ: https://github.com/AlexeyAB/darknet

- COCO データセットで事前学習済みモデルの重みのデータの URL: https://github.com/AlexeyAB/darknet

【関連項目】 YOLOv3, YOLOv4, RetinaNet, 物体検出

Alexnet

AlexNet の場合

input 3@224x224 conv 11x11 96@55x55 pooling conv 5x5 256@27x27 pooling 16@5x5 conv 3x3 384@13x13 conv 3x3 384@13xx13 conv 3x3 256@13x13 affine 4096 affine 4096 1000

参考文献: ch08/deep_convnet.py

AltCLIP

AltCLIP の特徴は、 CLIP のテキストエンコーダ (text encoder) を 学習済みの多言語のテキストエンコーダ XLM-R で置き換えたこと。

【文献】

Zhongzhi Chen, Guang Liu, Bo-Wen Zhang, Fulong Ye, Qinghong Yang, Ledell Wu, AltCLIP: Altering the Language Encoder in CLIP for Extended Language Capabilities, arXiv:2211.06679, 2022.

【関連項目】 CLIP

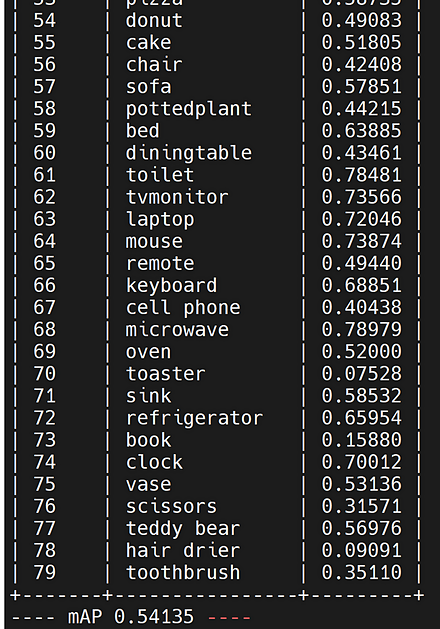

AP

機械学習による物体検出では、 「AP」は、「average precision」の意味である。

Applications of Deep Neural Networks

「Applications of Deep Neural Networks」は、ディープラーニングに関するテキスト。 ニューラルネットワーク、 CNN (convolutional neural network), LSTM (Long Short-Term Memory), GRU (Gated Recurrent Neural Networks), GAN (Generative Adversarial Network), 強化学習とその応用について学ぶことができる。 Python, TensorFlow, Keras を使用している。

【関連する外部ページ】

- Papers with Code のページ: https://paperswithcode.com/paper/applications-of-deep-neural-networks

- PDF ファイル: https://arxiv.org/pdf/2009.05673v3.pdf

【関連項目】 CNN (convolutional neural network), GAN (Generative Adversarial Network), GRU (Gated Recurrent Neural Networks), Keras, LSTM (Long Short-Term Memory), TensorFlow, ディープラーニング ニューラルネットワーク、 強化学習

ArcFace 法

距離学習の1手法である。 分類モデルが特徴ベクトルを生成するための複数の層と、最終層の softmax から構成されているとき、 その分類モデルでの、特徴ベクトルを生成するための複数の層の出力に対して、 L2 正規化の処理と、Angular Magin Penalty 層による処理を追加し、softmax 層につなげる。

deepface, InsightFace などで実装されている。

【文献】

Jiankang Deng, Jia Guo, Niannan Xue, Stefanos Zafeiriou, ArcFace: Additive Angular Margin Loss for Deep Face Recognition, CVPR 2019, also CoRR, abs/1801.07698v3, 2019.

https://arxiv.org/pdf/1801.07698v3.pdf

【関連する外部ページ】

- Papers with Code のページ: https://paperswithcode.com/method/arcface

【関連項目】 deepface, InsightFace, 顔検証 (face verification), 顔識別 (face identification), 顔認識 (face recognition), 顔に関する処理

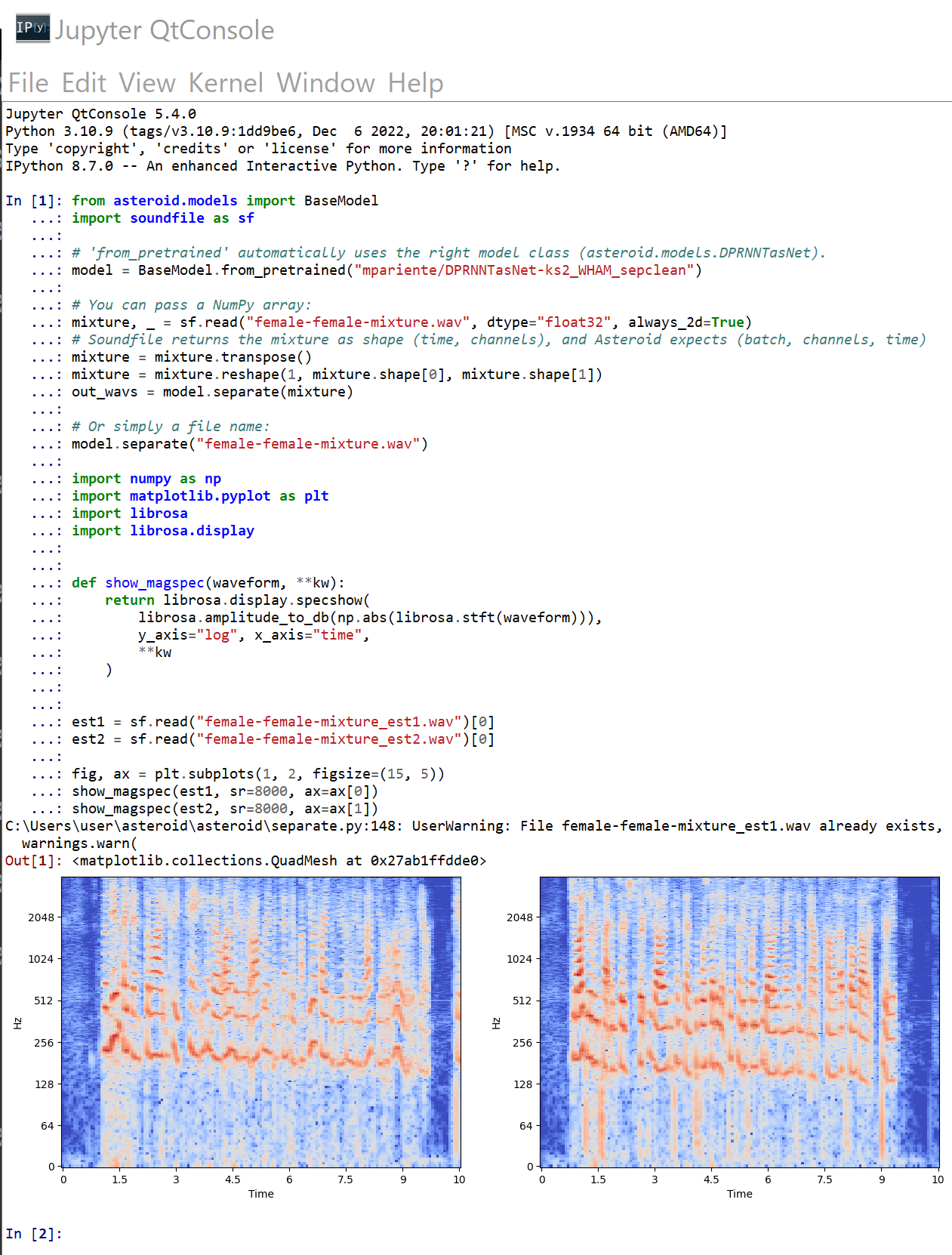

asteroid

asteroid は、音源分離(audio source separation)のツールキット。

【文献】

Ryosuke Sawata, Stefan Uhlich, Shusuke Takahashi, Yuki Mitsufuji, All for One and One for All: Improving Music Separation by Bridging Networks, CoRR, abs/2010.04228v4, 2021.

PDF: https://arxiv.org/pdf/2010.04228v4.pdf

【関連する外部ページ】

- GitHub のページ: https://github.com/asteroid-team/asteroid

- Papers with Code のページ: https://paperswithcode.com/paper/all-for-one-and-one-for-all-improving-music

【関連項目】 audio source separation, music source separation, speech enhancement

Windows での asteroid のインストールと動作確認(音源分離)

asteroid のインストールと動作確認(音源分離)(Python、PyTorch を使用)(Windows 上): 別ページ »で説明

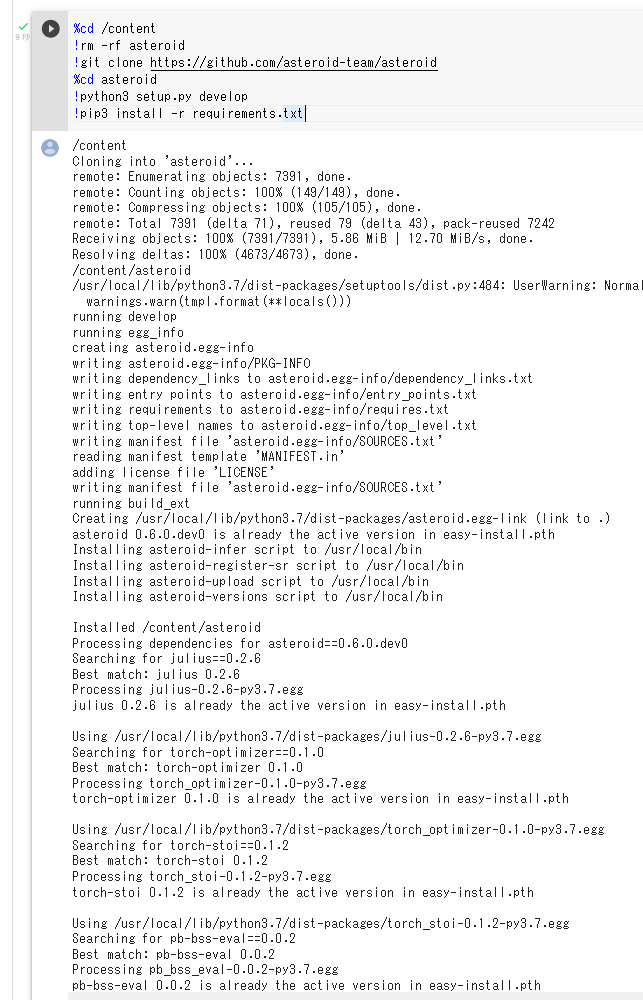

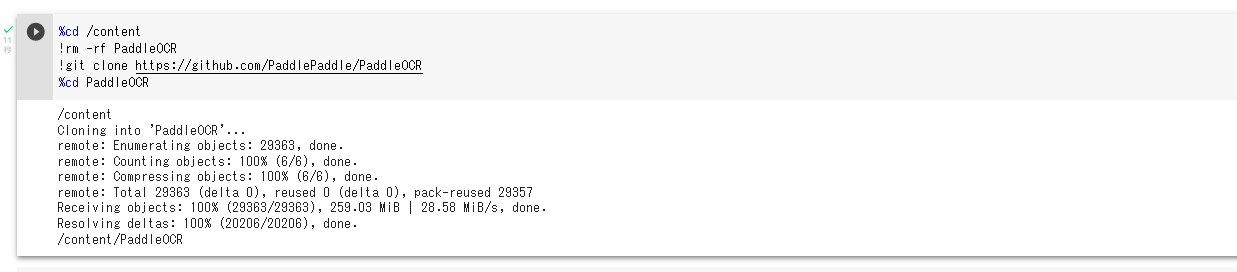

Google Colaboratory での asteroid のインストール

公式の手順 https://github.com/asteroid-team/asteroid による。

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り、実行する)。

%cd /content

!rm -rf asteroid

!git clone https://github.com/asteroid-team/asteroid

%cd asteroid

!python3 setup.py develop

!pip3 install -r requirements.txt

AVA

Spatio-Temporal Action Recognition の一手法。2016年発表

- 文献

Gu, Chunhui and Sun, Chen and Ross, David A and Vondrick, Carl and Pantofaru, Caroline and Li, Yeqing and Vijayanarasimhan, Sudheendra and Toderici, George and Ricco, Susanna and Sukthankar, Rahul and others, Ava: A video dataset of spatio-temporally localized atomic visual actions, Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pp. 6047--6056, 2018.

- MMAction2 の AVA の説明ページ: https://github.com/open-mmlab/mmaction2/blob/master/configs/detection/ava/README.md

【関連項目】 MMAction2, Spatio-Temporal Action Recognition, 動作認識 (action recognition)

Bark

Bark は Transformer ベースの音声合成の技術。多言語に対応。

【サイト内の関連ページ】

- 多言語の音声合成(Bark、Python、PyTorch を使用)(Windows 上): 別ページ »で説明

【関連する外部ページ】

- Bark の公式の GitHub のページ : https://github.com/suno-ai/bark

- Bark の Paper with Code のページ: https://paperswithcode.com/paper/neural-codec-language-models-are-zero-shot

【関連項目】 VALL-E X

BASNet (Boundary-Aware Salient object detection)

BASNet は、 ディープラーニングにより、Salient Object Detection (顕著オブジェクトの検出)を行う一手法。2019年発表。

BASNet は次の2つのモジュールから構成される。

- Predict Module:

入力画像から saliency map を生成する。 U-Net に類似の構造を持つ、教師有りの Encoder-Decoder ネットワークである。 この段階での saliency map は、粗い (coarse) ものである。

- Residual Refinement Module:

Predict Module が生成した saliency map をリファイン (refine) する。 Residual Refinement Module は Predict Module が生成した saliency map と、正解 (ground truth) との残差 (residuals) を学習する。

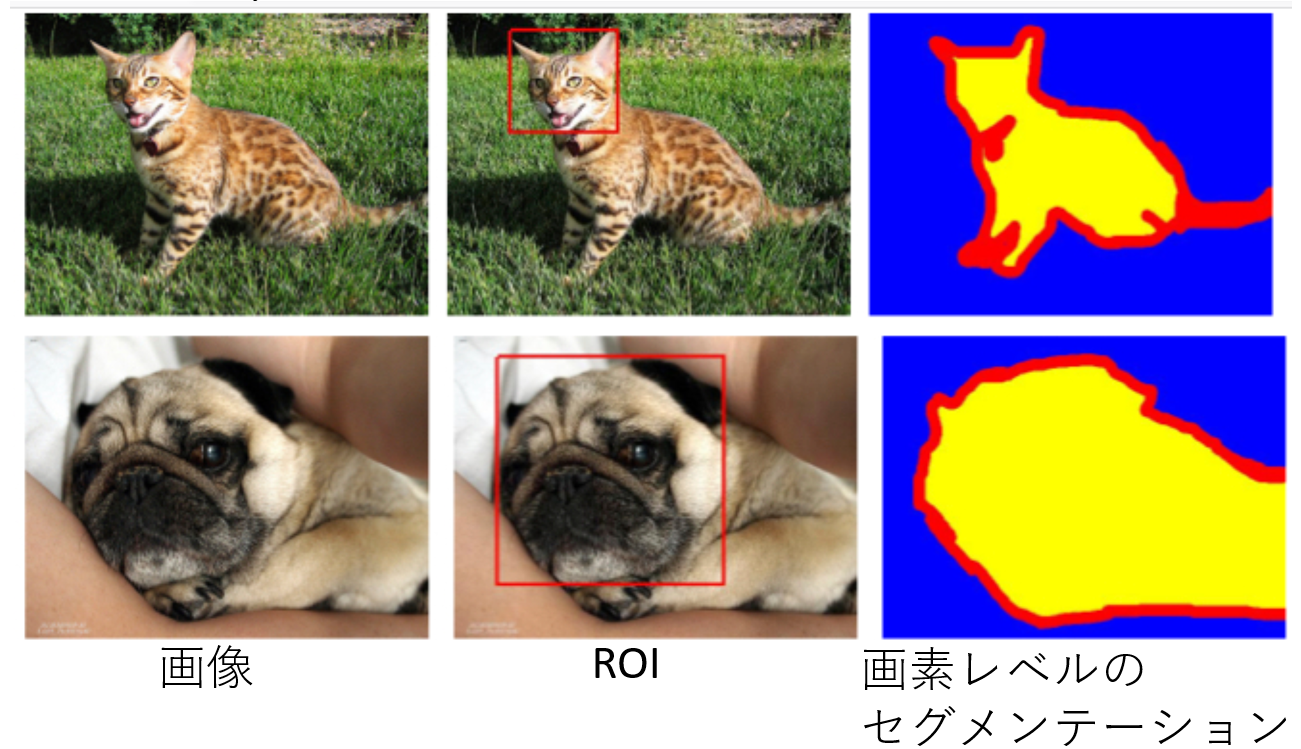

Salient Object Detection は、 視覚特性の異なるオブジェクトを、画素単位で切り出す。 前景と背景の分離に役立つ場合がある。人間がマスクの指定や塗り分け(Trimap など)を行うことなく実行される。

【文献】

Qin, Xuebin and Zhang, Zichen and Huang, Chenyang and Gao, Chao and Dehghan, Masood and Jagersand, Martin, BASNet: Boundary-Aware Salient Object Detection, The IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2019

【関連する外部ページ】

- 公式の GitHub のページ: https://github.com/xuebinqin/BASNet

- Papers With Code のページ: https://paperswithcode.com/paper/basnet-boundary-aware-salient-object

【関連項目】 U-Net, U2-Net, salient object detection, セマンティック・セグメンテーション (semantic segmentation)

Windows での BASNet のインストールとテスト実行(顕著オブジェクトの検出)

BASNet のインストールとテスト実行(顕著オブジェクトの検出)(Python、PyTorch を使用)(Windows 上): 別ページ »で説明

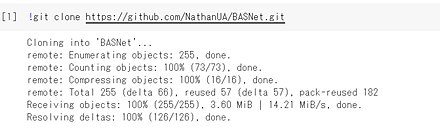

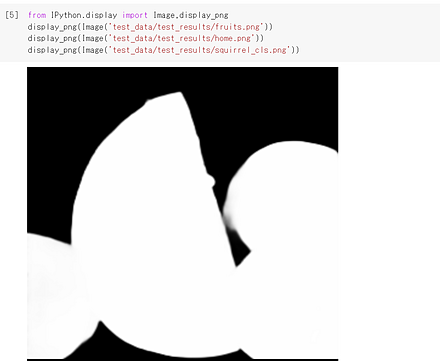

Google Colaboratory での BASNet のインストールとオンライン実行

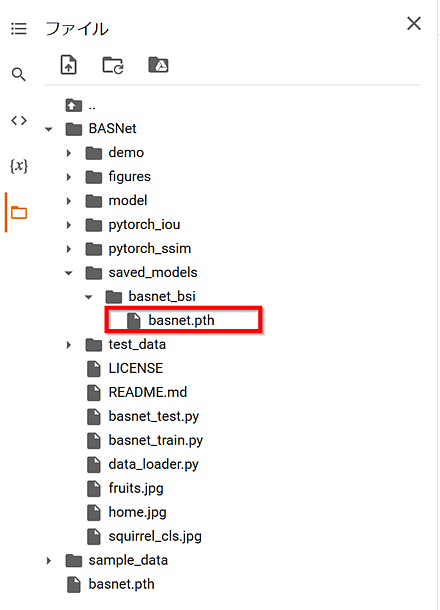

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り、実行する)。

BASNet のテストプログラムのオンライン実行を行うまでの手順を示す。

- BASNet プログラムなどのダウンロード

!git clone https://github.com/NathanUA/BASNet.git

- 学習済みモデルのダウンロード

公式ページ https://github.com/xuebinqin/BASNet の指示による。 学習済みモデル(ファイル名 basenet.pth)は、次で公開されている。 ダウンロードし、saved_models/basnet_bsi の下に置く

https://drive.google.com/open?id=1s52ek_4YTDRt_EOkx1FS53u-vJa0c4nu

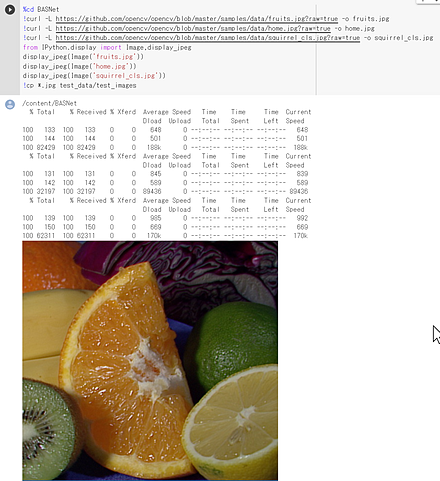

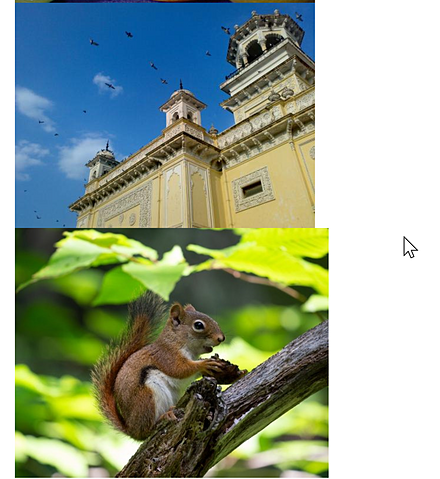

- テスト用の画像のダウンロードと確認表示

%cd BASNet !curl -L https://github.com/opencv/opencv/blob/master/samples/data/fruits.jpg?raw=true -o fruits.jpg !curl -L https://github.com/opencv/opencv/blob/master/samples/data/home.jpg?raw=true -o home.jpg !curl -L https://github.com/opencv/opencv/blob/master/samples/data/squirrel_cls.jpg?raw=true -o squirrel_cls.jpg from PIL import Image Image.open('fruits.jpg').show() Image.open('home.jpg').show() Image.open('squirrel_cls.jpg').show()

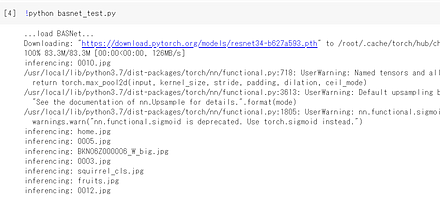

- BASNet の実行

%cd BASNet !python basnet_test.py

- 結果の表示

BDD100K

物体検出, instance segmentation, multi object tracking, segmentation tracking, セマンティック・セグメンテーション (semantic segmentation), lane marking, pose estimation 等の用途を想定したデータセット

- 文献 Yu, Fisher and Chen, Haofeng and Wang, Xin and Xian, Wenqi and Chen, Yingying and Liu, Fangchen and Madhavan, Vashisht and Darrell, Trevor, BDD100K: A Diverse Driving Dataset for Heterogeneous Multitask Learning, The IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2020.

- 公式ページ: https://www.vis.xyz/bdd100k/

- 公式のドキュメント: https://doc.bdd100k.com/usage.html

- BDD100K のダウンロードの公式ページ: https://doc.bdd100k.com/download.html

- 公式の Model Zoo: https://github.com/SysCV/bdd100k-models/

- Papers with Code のページ: https://paperswithcode.com/dataset/bdd100k

【関連項目】 物体検出, instance segmentation, multi object tracking, segmentation tracking, セマンティック・セグメンテーション (semantic segmentation), lane marking, pose estimation

Big Tranfer ResNetV2

【関連項目】 Residual Networks (ResNets)

BioID 顔データベース (BioID Face Database)

BioID 顔データベースは、23名, 1521枚のモノクロの画像。解像度は 384x286 である。目の位置に関するデータを含む。

BioID 顔データベースは次の URL で公開されているデータセット(オープンデータ)である。

BM3D image denosing

BM3D image denosing の公式ソースコード(GitHub のページ): https://github.com/gfacciol/bm3d

【関連項目】 image denosing

Boston housing price 回帰データセット

Boston housing price 回帰データセットは、次のプログラムでロードできる。

from tensorflow.keras.datasets import boston_housing

(x_train, y_train), (x_test, y_test) = boston_housing.load_data()

【関連項目】 Keras に付属のデータセット

Box Annotation

ディープラーニングによる物体検出のための学習と検証では、 アノテーションとして、物体のバウンディングボックスが広く用いられている。

ディープラーニングによるインスタンス・セグメンテーション (instance segmentation)でも、 Tian らの BoxInst (2021年発表) のように、画素単位でのアノテーションでなく、 バウンディングボックスを用いる手法が登場している。

- 文献, Zhi Tian, Chunhua Shen, Xinlong Wang and Hao Chen, BoxInst: High-Performance Instance Segmentation with Box Annotations, CVPR 2021, also CoRR, abs/2012.02310, 2021.

【関連項目】 インスタンス・セグメンテーション (instance segmentation), バウンディングボックス, 物体検出,

cabani の MaskedFace-Net データセット

正しくマスクが装着された状態の顔の写真 (CMFD) と、 正しくマスクが装着されていない状態の顔の写真 (IMFD) のデータセット。

- CMDD: 67,049 枚, 1024x1024

- IMFD: 66,734 枚, 1024x1024

文献

Adnane Cabani and Karim Hammoudi and Halim Benhabiles and Mahmoud Melkemi, MaskedFace-Net -- A Dataset of Correctly/Incorrectly Masked Face Images in the Context of COVID-19, Smart Health, 2020.

Science Direct: https://www.sciencedirect.com/science/article/pii/S2352648320300362

【サイト内の関連ページ】

chandrikadeb7 / Face-Mask-Detection のインストールと動作確認(マスク有り顔、マスクなし顔の検出)(Python、TensorFlow を使用)(Windows 上): 別ページ »で説明

【関連する外部ページ】

公式 URL: https://github.com/cabani/MaskedFace-Net

【関連項目】 顔のデータベース, 顔検出 (face detection)

Caffe

- Caffe の URL: http://caffe.berkeleyvision.org/

Caffe2

【関連する外部ページ】

- URL: https://caffe2.ai

- github: https://github.com/caffe2/caffe2

- モデル zoo: https://caffe2.ai/docs/zoo.html https://github.com/caffe2/models

Caltech Pedestrian データセット (Caltech Pedestrian Dataset)

Caltech Pedestrian データセット は、都市部を走行中の車両から撮影したデータ。 機械学習による物体検出 の学習や検証に利用できるデータセットである。

- 640x480 30Hzのビデオ

- 約10時間分(約25万フレーム、約1分間のセグメントが137個)

- バウンディングボックス: 約35万個、約 2300人の歩行者がアノテーションされている。

- アノテーションは、バウンディングボックスの時間的な対応関係、オクルージョンラベルを含む

Caltech Pedestrian データセットは次の URL で公開されているデータセット(オープンデータ)である。

URL: http://www.vision.caltech.edu/datasets/

【関連情報】

- Papers With Code の Caltech Pedestrian データセットのページ: https://paperswithcode.com/dataset/caltech-pedestrian-dataset

- PyTorch の Caltech Pedestrian データセット: https://pytorch.org/vision/stable/datasets.html#caltech

CSAILVision

CSAILVisionは、Places365データセットを用いた事前学習済みモデルと、それを利用した画像分類、image tagging、Class Activation Mapping (CAM) のプログラムを提供している。

- CSAILVision の Places365

Places365 データセットを用いた事前学習済みモデルと、 それを利用した、画像分類、image tagging、Class Activation Mapping (CAM) のプログラムが公開されている。

【関連項目】 画像分類、 Class Activation Mapping (CAM)、 image tagging

CelebA (Large-scale CelebFaces Attributes) データセットのダウンロード

Large-scale CelebFaces Attributes (CelebA) データセットは、顔画像とアノテーションのデータである。 機械学習による顔検出、顔ランドマーク (facial landmark)、顔認識、顔の生成などの学習や検証に利用できるデータセットである。

- 20万人以上の有名人の画像に、40の属性アノテーションを付けたもの

- 人数: 10,177

- 顔画像: サイズ 178×218 で、202,599枚

- 5つの顔ランドマーク

- 40の属性アノテーション(髪の色、性別、年齢などの顔属性)

Large-scale CelebFaces Attributes (CelebA) データセットは次の URL で公開されているデータセット(オープンデータ)である。

URL: https://mmlab.ie.cuhk.edu.hk/projects/CelebA.html

【関連情報】

- 文献

Deep Learning Face Attributes in the Wild, Ziwei Liu, Ping Luo, Xiaogang Wang, Xiaoou Tang, ICCV 2015.

- Papers With Code の CelebA データセットのページ: https://paperswithcode.com/dataset/celeba

- PyTorch の CelebA データセット: https://pytorch.org/vision/stable/datasets.html#torchvision.datasets.CelebA

- TensorFlow データセット の CelebA データセット: https://www.tensorflow.org/datasets/catalog/celeb_a

【関連項目】 顔のデータベース、顔ランドマーク (facial landmark)

Chain of Thought

マルチモーダル名前付きエンティティ認識(Multimodal Named Entity Recognition; MNER)およびマルチモーダル関係抽出(Multimodal Relation Extraction; MRE)の改善に注力し、これらの分野における精度向上を目指している。この目的のために、Chain of Thought(CoT)プロンプトを活用し、大規模言語モデル(LLM)から reasoning を抽出している。論文の手法は、名詞、文、マルチモーダルの観点からの多粒度の推論と、スタイル、エンティティ、画像を含むデータ拡張を網羅している。これにより、LLMからの reasoning をより効果的に抽出している。MNERの有効性を評価するために、Twitter2015、Twitter2017、SNAP、WikiDiverseという様々なデータセットを使用し、提案方法の効果を検証している。

【文献】

Feng Chen, Yujian Feng, Chain-of-Thought Prompt Distillation for Multimodal Named Entity Recognition and Multimodal Relation Extraction, arXiv:2306.14122v3, 2023.

https://arxiv.org/pdf/2306.14122v3.pdf

【関連する外部ページ】

- LangChain の GitHub のページ: https://github.com/langchain-ai/langchain

- LangChain の公式ドキュメント: https://python.langchain.com/v0.2/docs/introduction/

- LangChain の Paper with Code のページ: https://paperswithcode.com/paper/chain-of-thought-prompt-distillation-for

Chandrika Deb の顔マスク検出 (Chandrika Deb's Face Mask Detection) および顔のデータセット

写真やビデオから、マスクありの顔と、マスク無しの顔を検出する技術およびソフトウェアである。顔検出、マスク有りの顔とマスク無しの顔の分類を同時に行っている。MobileNetV2(ディープニューラルネットワーク)を使用している。

ソースコードは公開されており、画像を追加して学習をやり直すことも可能である。

Bing Search API、Kaggle dataset、RMDF dataset から収集された顔のデータセット(マスクあり: 2165 枚、マスクなし 1930 枚)が同封されている。

【関連する外部ページ】

- GitHub のページ: Chandrika Deb, https://github.com/chandrikadeb7/Face-Mask-Detection

- 正しくマスクをつけた顔と、正しくマスクをつけていない顔のデータセット: https://github.com/cabani/MaskedFace-Net

【関連項目】 cabani の MaskedFace-Net データセット、 Face Mask Detection、 マスク付き顔の処理、 顔検出 (face detection)

Chaudhury らの画像補正 (image rectification)

画像補正は、画像を射影変換することにより、斜め方向からの撮影画像を正面画像に変換する技術である。 意図しないカメラ回転(ロール、ピッチ、ヨー)を含む画像を正面画像に補正できる。

また、AIの事前学習は、通常、正面画像で行われることが多く、画像補正を使うことで、AIの推論をより精度よく行うことができると期待できる。

【文献】

Chaudhury, Krishnendu, Stephen DiVerdi, and Sergey Ioffe. "Auto-rectification of user photos." 2014 IEEE International Conference on Image Processing (ICIP). IEEE, 2014.

【資料】 PDFファイル、パワーポイントファイル

【サイト内の関連ページ】

【関連する外部ページ】

GitHub のページ: https://github.com/chsasank/Image-Rectification

CIFAR-10 データセット

CIFAR-10 データセット(Canadian Institute for Advanced Research, 10 classes)は、公開されているデータセット(オープンデータ)である。

CIFAR-10 データセット(Canadian Institute for Advanced Research, 10 classes) は、クラス数 10 の カラー画像と、各画像に付いたラベルから構成されるデータセットである。 機械学習での画像分類の学習や検証に利用できる。

CIFAR-100 データセット

Cityscapes データセット

Class Activation Mapping (CAM)

Class Activation Mapping (CAM) は、 Bolei Zhou により、2016年に提案された。

- Bolei Zhou らの文献

Bolei Zhou Aditya Khosla Agata Lapedriza Aude Oliva Antonio Torralba, Learning Deep Features for Discriminative Localization, CVPR 2016, also CoRR, https://arxiv.org/abs/1512.04150v1, 2016.

- Bolei Zhou によるソースコードとモデル: https://github.com/zhoubolei/CAM

- Papers with Code のページ: https://paperswithcode.com/paper/learning-deep-features-for-discriminative

【関連項目】 CSAILVision

CRAFT

CRAFT は、文字検出の一手法。

【文献】 Youngmin Baek, Bado Lee, Dongyoon Han, Sangdoo Yun, and Hwalsuk Lee, Character Region Awareness for Text Detection, Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pp. 9365--9374, 2019.

【関連する外部ページ】

GitHub のページ: https://github.com/clovaai/CRAFT-pytorch

【関連項目】 EasyOCR

CREPE

CREPE(Convolutional Representation for Pitch Estimation)は、深層学習を用いたモノフォニック音声のピッチ推定手法である。以下に、CREPEの特徴と性能評価について説明する。

特徴

- CREPEは、時間領域の音声波形を直接入力とし、畳み込みニューラルネットワーク(CNN)を用いて360次元のピッチアクティベーションを出力する。

- ピッチアクティベーションは、6オクターブの音域を20セント間隔で分割した360個の音高候補に対する活性度を表す数値ベクトルである。

性能評価

- RWC-synthとMDB-stem-synthの2つのデータセットを用いて、従来手法であるpYINやSWIPEとの比較が行われた。

- 評価指標として、Raw Pitch Accuracy(RPA)とRaw Chroma Accuracy(RCA)が用いられた。

- ピッチ認識の閾値を変化させた場合や、ホワイトノイズ等を加えた場合のロバスト性も評価された。

- 実験の結果、CREPEは多様な音色やノイズに対して従来手法よりもロバスト性に優れ、高精度なピッチ推定が可能であることが示された。

応用分野

- CREPEは、旋律抽出やイントネーション分析など、ピッチ情報を必要とする様々な音声処理タスクに応用可能である。

- 音楽情報処理における音高推定や、言語学における韻律分析などにも活用できる。

文献

CREPE: A Convolutional Representation for Pitch Estimation Jong Wook Kim, Justin Salamon, Peter Li, Juan Pablo Bello. Proceedings of the IEEE International Conference on Acoustics, Speech, and Signal Processing (ICASSP), also arXiv:1802.06182v1 [eess.AS], 2018.

https://arxiv.org/pdf/1802.06182v1

CREPE の GitHub の公式ページ: https://github.com/marl/crepe

【サイト内の関連ページ】 CREPE のインストール、CREPE を用いた音声分析プログラム(音のピッチ推定)(Python、TensorFlow を使用)(Windows 上)

crowd counting (群衆の数のカウントと位置の把握)

crowd countingは、 画像内の人数を数えること。 監視等に役立つ。 さまざま状況において、 さまざまな大きさで画像内にある人物を数えることが課題であり、 画像からの物体検出とは研究課題が異なる。

【関連項目】 FIDTM, JHU-CROWD++ データセット, NWPU-Crowd データセット, ShanghaiTech データセット, UCF-QNRF データセット

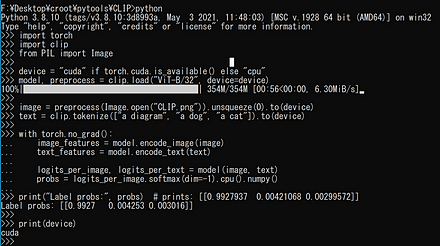

CLIP

CLIP(Contrastive Language-Image Pre-Training)では、 テキスト画像のペアを用いて学習が行われる。 GPT-2、GPT-3 のゼロショット学習 (zero-shot learning) のゼロショットと同様に、 画像に対して、テキストが結果として求まる。 CLIP は、ImageNet データセット のゼロショットに対して、 ResNet50と同等の性能があるとされる。

CLIP の GitHub のページ: https://github.com/openai/CLIP

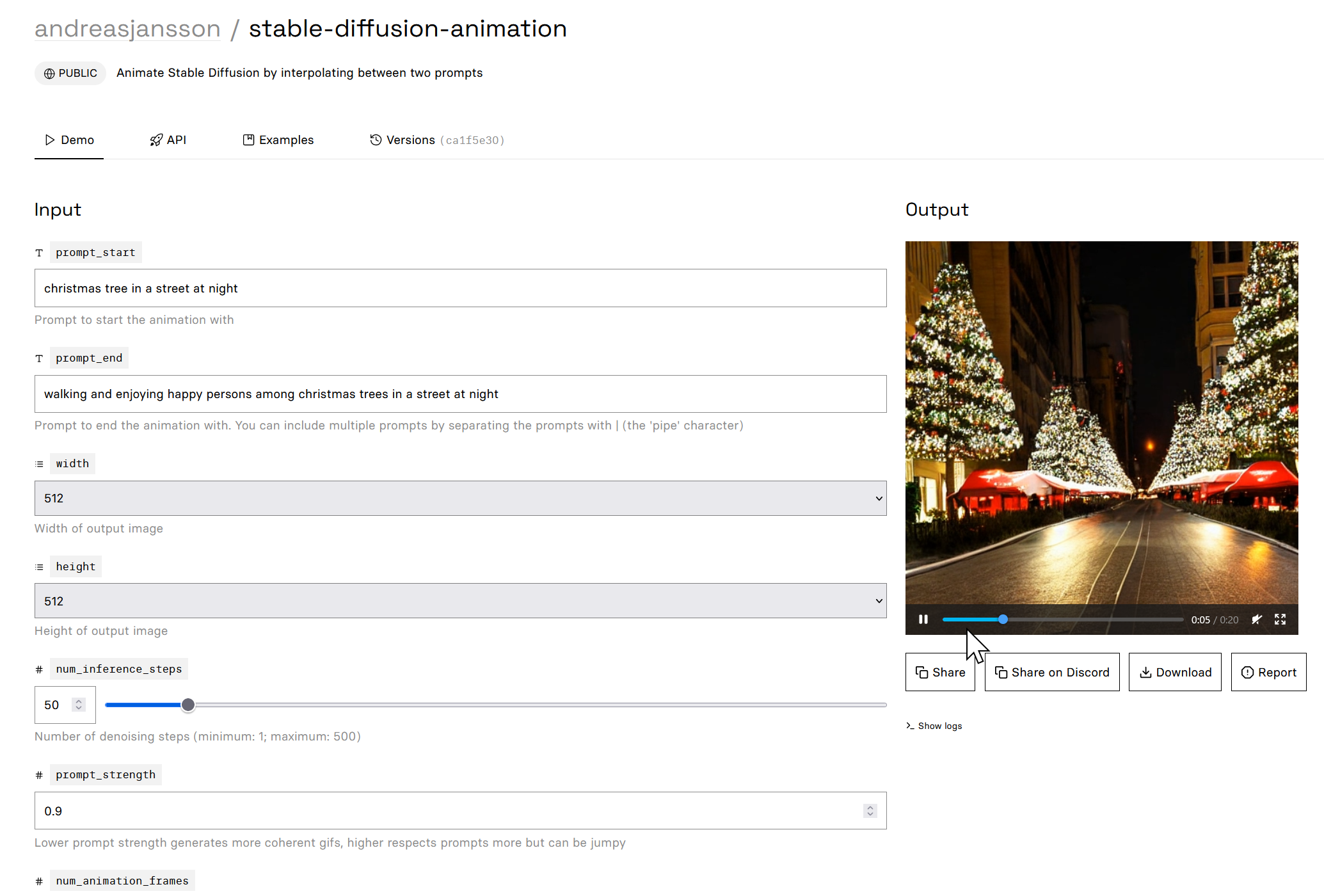

CLIP のサンプルプログラムの実行結果は次の通り。

【関連項目】 AltCLIP

C-MS-Celeb Cleaned データセット

C-MS-Celeb Cleaned データセット は、 MS-Celeb-1M データセット を整えたもの。間違いの修正など。

人物数は 94,682 (94,682 identities), 画像数は 6,464,018 枚 (6,464,018 images)

次の URL で公開されているデータセット(オープンデータ)である。

https://github.com/EB-Dodo/C-MS-Celeb

- 文献

Chi Jin, Ruochun Jin, Kai Chen, and Yong Dou, "A Community Detection Approach to Cleaning Extremely Large Face Database," Computational Intelligence and Neuroscience, vol. 2018, Article ID 4512473, 10 pages, 2018. doi:10.1155/2018/4512473

【関連項目】 顔のデータベース, MS-Celeb-1M データセット, 顔検出 (face detection)

CNN

CNN (convolutional neural network) は畳み込みニューラルネットワークのこと。

CNTK

- Web ページ:

https://github.com/microsoft/CNTK - github: https://github.com/Microsoft/CNTK

- チュートリアル: http://research.microsoft.com/en-us/um/people/dongyu/CNTK-Tutorial-NIPS2015.pdf

- ドキュメント: http://research.microsoft.com/apps/pubs/?id=226641

- ChainerCV について: https://github.com/chainer/chainercv

- Python について: https://github.com/stitchfix/Algorithms-Notebooks

COCO (Common Object in Context) データセット

COCO の Keypoints 2014/2017 アノテーション

URL: https://cocodataset.org/#keypoints-2017

COCO の Keypoints 2014/2017 アノテーションは、次からダウンロードできる。

- https://drive.google.com/file/d/1jrxis4ujrLlkwoD2GOdv3PGzygpQ04k7/view

- https://drive.google.com/file/d/1YuzpScAfzemwZqUuZBrbBZdoplXEqUse/view

COLMAP

COLMAP は 3次元再構成の機能を持ったソフトウェア。

【文献】

Johannes L. Schonberger, Jan-Michael Frahm, Structure-From-Motion Revisited, CVPR 2016, 2016

【サイト内の関連ページ】

- COLMAP 3.8 のインストールと3次元再構成の実行(COLMAP 3.8 を使用)(Windows 上): 別ページ »で説明

- COLMAP のインストールと3次元再構成の実行(COLMAP のソースコード、vcpkgm, Visual Studio Community 2019 を使用)(Windows 上): 別ページ »で説明

【関連する外部ページ】

- Papers with Code の colmap のページ: https://paperswithcode.com/paper/structure-from-motion-revisited

- COLMAP の公式ページ(公式リリース、Vocabulary tree, データセットへのリンクなど): https://demuc.de/colmap

- COLMAP の公式の説明: https://colmap.github.io

- COLMAP を公開している公式ページ: https://github.com/colmap/colmap/releases

- Gerrard Hall, Craham Hall, Person Hall, South Building データセット: https://colmap.github.io/datasets.html

Coqui TTS

Coqui TTS は、音声合成および音声変換(Voice Changer)の研究プロジェクトならびに成果物。

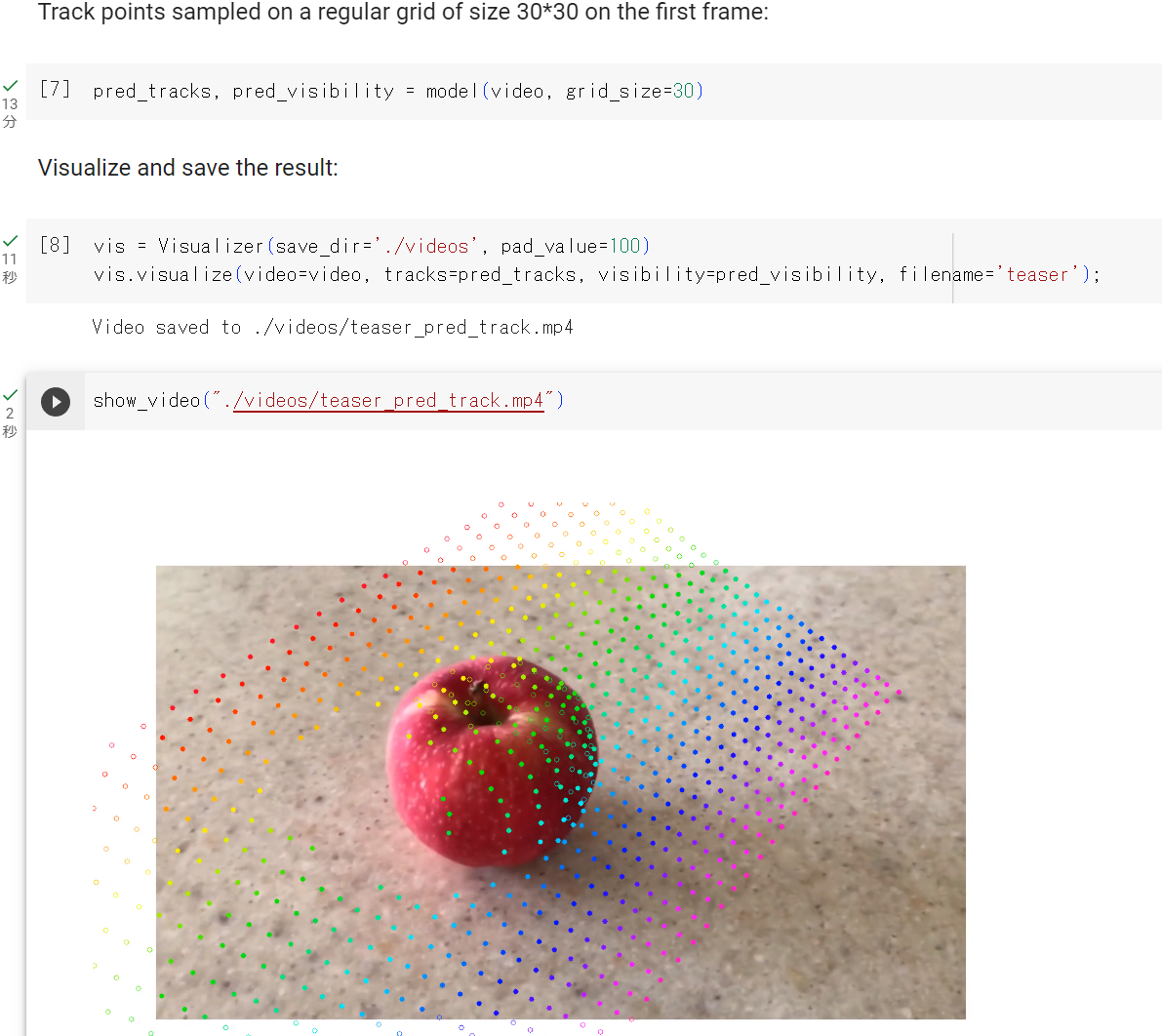

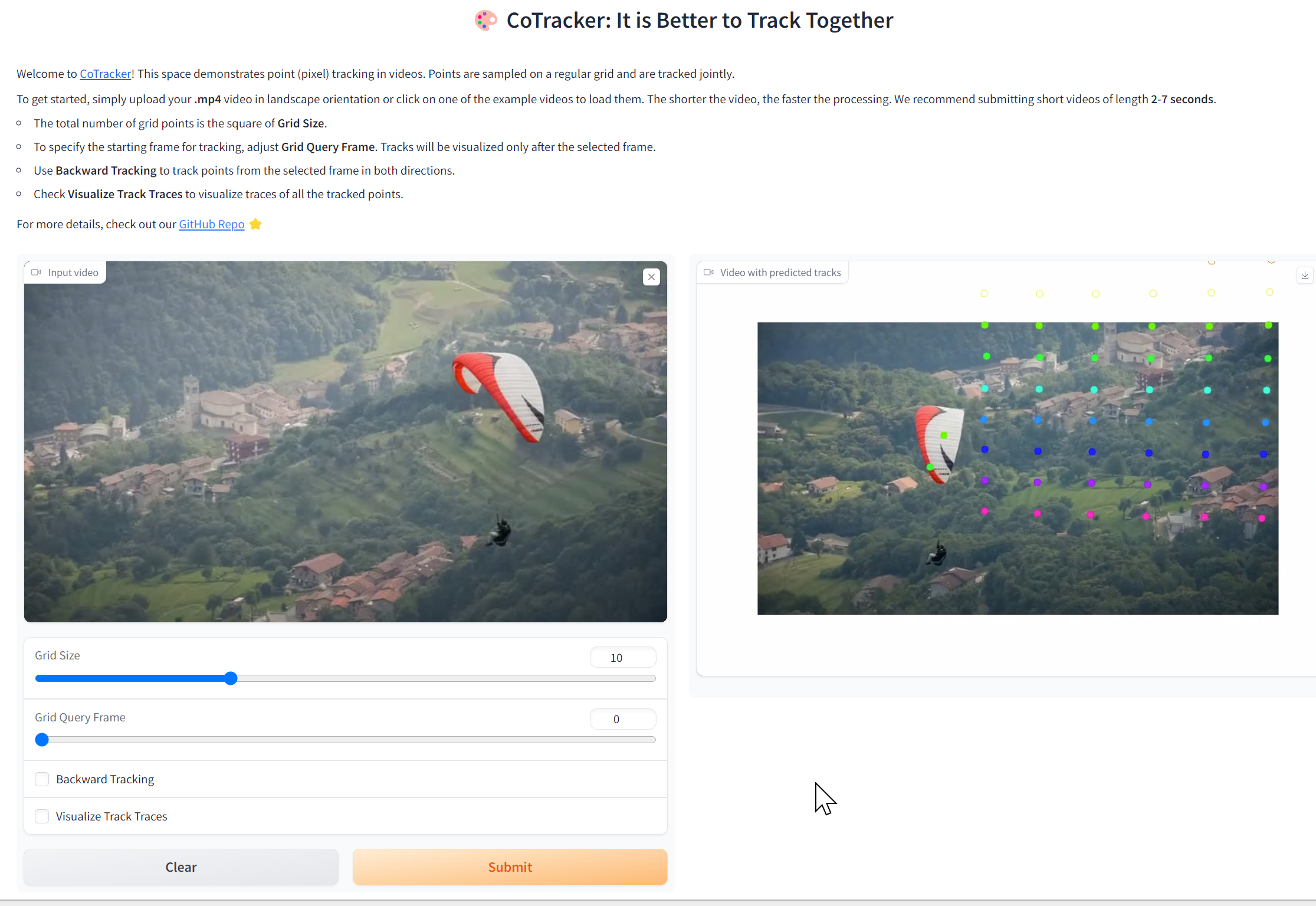

CoTracker

CoTracker は、動画のポイントトラッキングの一手法である。 この手法は、長期間の追跡やオクルージョン(遮蔽)の取り扱いの難しさに対処するために開発された。 CoTracker では、ポイントをグループとして追跡する方法、つまりグループベースのアプローチを採用しており、ポイント間の相互関係を活用する。さらに、時間的なスライディングウィンドウメカニズムを使用して、長期間にわたる追跡を行う。実験結果からは、co-trackingが既存の手法に比べて、オクルージョンや長期間のビデオに対する追跡の安定性が向上したことが示されている。

【文献】

Nikita Karaev, Ignacio Rocco, Benjamin Graham, Natalia Neverova, Andrea Vedaldi, Christian Rupprecht, CoTracker: It is Better to Track Together, arXiv:2307.07635v1, 2023.

https://arxiv.org/pdf/2307.07635v1.pdf

【関連する外部ページ】

- CoTracker のデモ(Google Colaboratory)

- CoTracker の Hugging Face のデモ

https://huggingface.co/spaces/facebook/cotracker

- GitHub のページ: https://github.com/facebookresearch/co-tracker

- Paper with Code のページ: https://paperswithcode.com/paper/cotracker-it-is-better-to-track-together

CSPNet (Cross Stage Parital Network)

CSPNet は、ステージの最初の特徴マップ (feature map) と最後の特徴マップ (feature map) を統合することを特徴とする手法。

CSPNet は、 ResNet, ResNeXt, DenseNet などに適用でき、 ImageNet データセットを用いた画像分類の実験では、計算コスト、メモリ使用量、推論の速度、推論の精度の向上ができるとされている。 その結果として、物体検出 についても改善ができるとされている。

CSPNet の公式の実装 (GitHub) のページでは、 画像分類として、 CSPDarkNet-53、 CSPResNet50、 CSPResNeXt-50, 物体検出として、 CSPDarknet53-PANet-SPP, CSPResNet50-PANet-SPP, CSPResNeXt50-PANet-SPP 等の実装が公開されている。

Scaled YOLO v4 では、CSPNet の技術が使われている。

- 文献

Chien-Yao Wang, Hong-Yuan Mark Liao, I-Hau Yeh, Yueh-Hua Wu, Ping-Yang Chen, Jun-Wei Hsieh, CSPNet: A New Backbone that can Enhance Learning Capability of CNN, CoRR, abs/1911.11929v1, 2019.

- CSPNet の公式の実装 (GitHub) のページ: https://github.com/WongKinYiu/CrossStagePartialNetworks

- Ross Wightman の pytorch-image-models (GitHub) のページ: https://github.com/rwightman/pytorch-image-models

【関連項目】 AlexeyAB darknet, 画像分類, 物体検出, Scaled YOLO v4, pytorchimagemodels

CSAILVision

CSAILVision の公式デモ(GitHub のページ): https://colab.research.google.com/github/CSAILVision/semantic-segmentation-pytorch/blob/master/notebooks/DemoSegmenter.ipynb

【関連項目】 セマンティックセグメンテーション (semantic segmentation)

CuPy

CuPy は NumPyのGPU実装であり、CUDA対応GPUで高速な数値計算を行うためのPythonライブラリである。

【関連する外部ページ】

- CuPy の公式ページ: https://cupy.chainer.org/

- CuPy の公式のインストールページ: https://docs.cupy.dev/en/stable/install.html

【サイト内の関連ページ】

- CuPy 13.2 のインストール、CuPy のプログラム例(Windows 上): 別ページ »で説明

【関連項目】 NVIDIA CUDA

CuRRET データベース (Columbia-Utrecht Reflectance and Texture Database)

反射率とテクスチャに関するデータベース

- BRDF データベース: 60 以上のサンプルについて、反射率を計測したもの。

- BRDF パラメータデータベース: BRDF モデル(the Oren-Nayar model とthe Koenderink et al. representation の2つ)のフィッティングパラメータ (fitting parameter) を含む。

- BTF データベース: 60 以上のサンプルについての画像テクスチャに関する計測値

CuRRET データベース (Columbia-Utrecht Reflectance and Texture Database)は次の URL で公開されているデータセット(オープンデータ)である。

URL: https://www.cs.columbia.edu/CAVE/software/curet/html/about.php

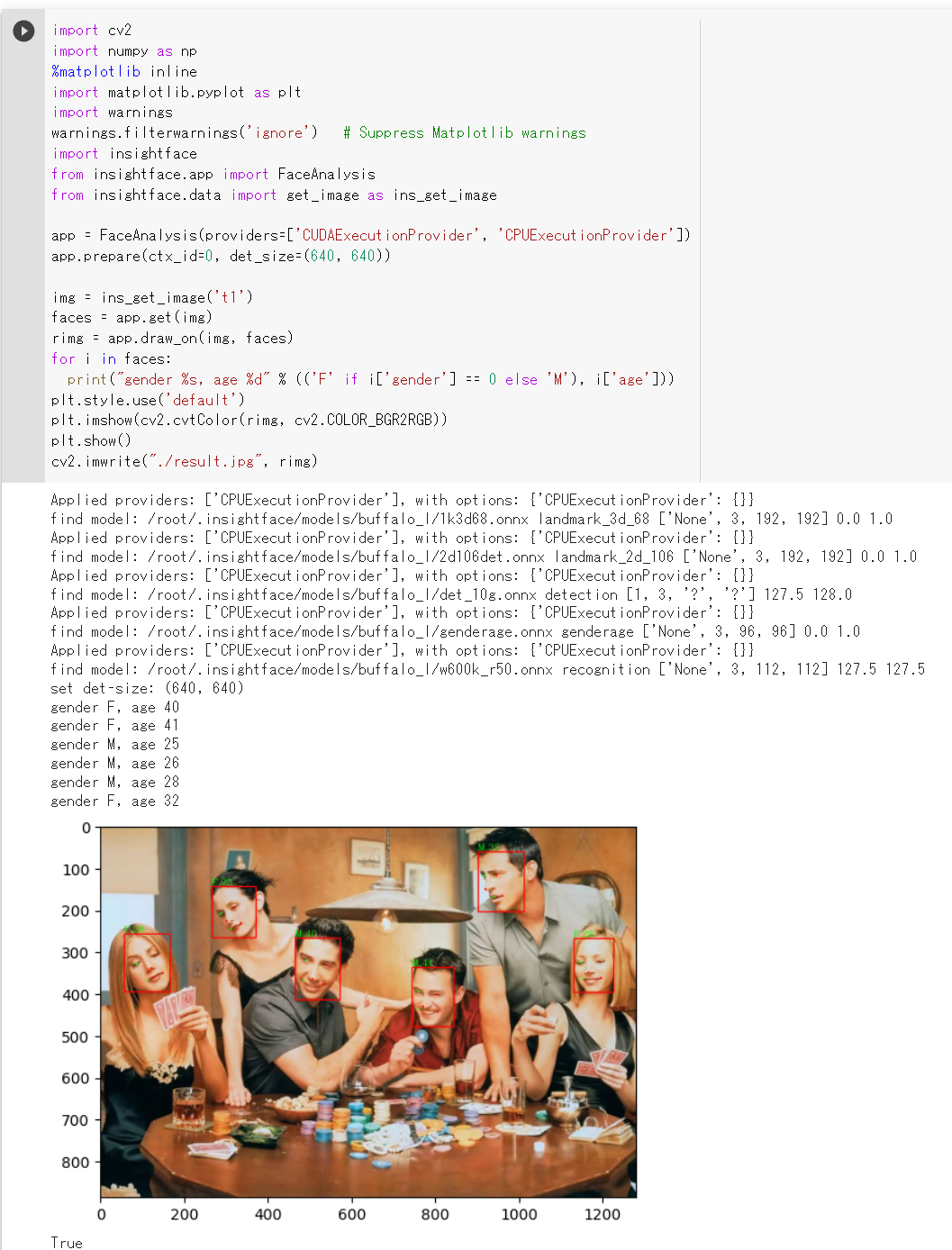

DeepFace

DeepFace は、ArcFace 法による顔識別の機能や、顔検出、年齢や性別や表情の推定の機能などを持つ。

ArcFace 法は、距離学習の技術の1つである。 画像分類において、種類が不定個であるような画像分類に使うことができる技術である。 顔のみで動くということではないし、 顔の特徴を捉えて工夫されているということもない。

DeepFace の URL: https://github.com/serengil/deepface

ArcFace 法の概要は次の通り

- 顔のコード化:顔画像を、数値ベクトル(数値の並び)に変換する。

- 顔のコードについて、同一人物の顔のコードは近くになるように、違う人物の顔のコードは遠くなるように、顔のコードを作り直す。そのときディープラーニングを使う。これを「距離学習」という。

- 距離学習の学習済みモデルを使う。距離学習がなかったときと比べて、顔認識の精度の向上が期待できる。

【関連項目】 ArcFace 法, 顔検出, 顔識別 (face identification), 顔認識, 顔に関する処理

DeepForge

DeepForge は,ディープラーニングのソフトウェア一式である.Webサーバも付属しており,Webブラウザからディープラーニングのソフトウェアの作成,実行,保存が簡単にできる.ソフトウェアの作成は,Webブラウザ上でのエディタでも,Webブラウザ上でのビジュアルなエディタでもできる.ディープラーニングでのニューラルネットワークの構造が図で簡単に確認できて便利である.

【サイト内の関連ページ】

- Windows での DeepForge のインストールとテスト実行: 別ページで説明している.

【関連する外部ページ】

- DeepForge の公式ページ: https://deepforge.org/

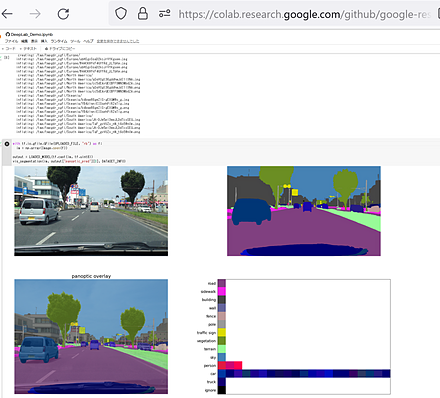

DeepLab2

DeepLab2 は,セグメンテーションの機能を持つ TensorFlow のライブラリである. DeepLab, Panoptic-DeepLab, Axial-DeepLab, Max-DeepLab, Motion-DeepLab, ViP-DeepLab を含む.

DeepLab2 の公式のデモ(Google Colaboratory のページ)の実行により,下図のように panoptic segmentation の結果が表示される.

そのデモのページの URL: https://colab.research.google.com/github/google-research/deeplab2/blob/main/DeepLab_Demo.ipynb#scrollTo=6552FXlAOHnX

【文献】

Mark Weber, Huiyu Wang, Siyuan Qiao, Jun Xie, Maxwell D. Collins, Yukun Zhu, Liangzhe Yuan, Dahun Kim, Qihang Yu, Daniel Cremers, Laura Leal-Taixe, Alan L. Yuille, Florian Schroff, Hartwig Adam, Liang-Chieh Chen, DeepLab2: A TensorFlow Library for Deep Labeling, CoRR, abs/2106.09748v1, 2021.

【サイト内の関連ページ】

Windows で動く人工知能関係 Pythonアプリケーション,オープンソースソフトウエア: 別ページ »で説明している.

【関連する外部ページ】

- https://arxiv.org/pdf/2106.09748v1.pdf

- DeepLab2 の GitHub のページ: https://github.com/google-research/deeplab2

- DeepLab2 の Google Colaboratory のページ: https://colab.research.google.com/github/google-research/deeplab2/blob/main/DeepLab_Demo.ipynb

【関連項目】 セマンティック・セグメンテーション (semantic segmentation), panoptic segmentation, depth estimation

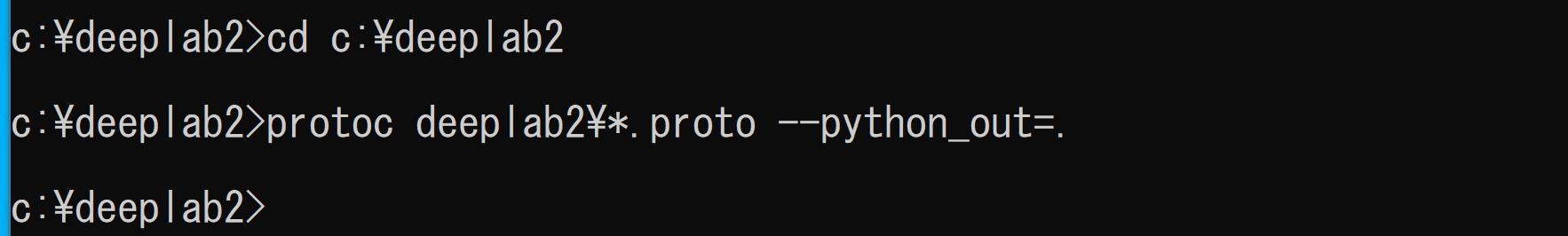

DeepLab2 のインストール(Windows 上)

- プロトコル・バッファ・コンパイラ (protocol buffer compiler) のインストールを行っておく.

- コマンドプロンプトを管理者として開く.

- DeepLab2 のダウンロード,前提ソフトウエアのインストール

DeepLab2 を動かすため,protobuf==3.19.6 を指定する.

cd c:\ rmdir /s /q c:\deeplab2 mkdir c:\deeplab2 cd c:\deeplab2 git clone https://github.com/google-research/deeplab2.git python -m pip install -U tensorflow==2.10.1 protobuf==3.19.6 - protoc を用いてコンパイル

cd c:\deeplab2 protoc deeplab2\*.proto --python_out=.

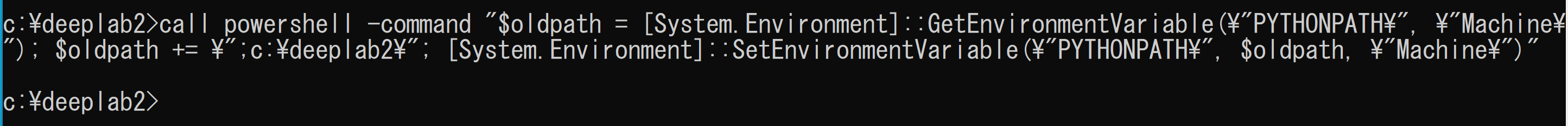

- Windows の システム環境変数 PYTHONPATHに,c:\deeplab2 を追加することにより,パスを通す.

Windows で,管理者権限でコマンドプロンプトを起動(手順:Windowsキーまたはスタートメニュー >

cmdと入力 > 右クリック > 「管理者として実行」).powershell -command "$oldpath = [System.Environment]::GetEnvironmentVariable(\"PYTHONPATH\", \"Machine\"); $oldpath += \";c:\deeplab2\"; [System.Environment]::SetEnvironmentVariable(\"PYTHONPATH\", $oldpath, \"Machine\")"

- 新しくコマンドプロンプトを開き,動作確認

cd c:\deeplab2\deeplab2\model python deeplab_test.py

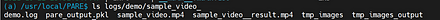

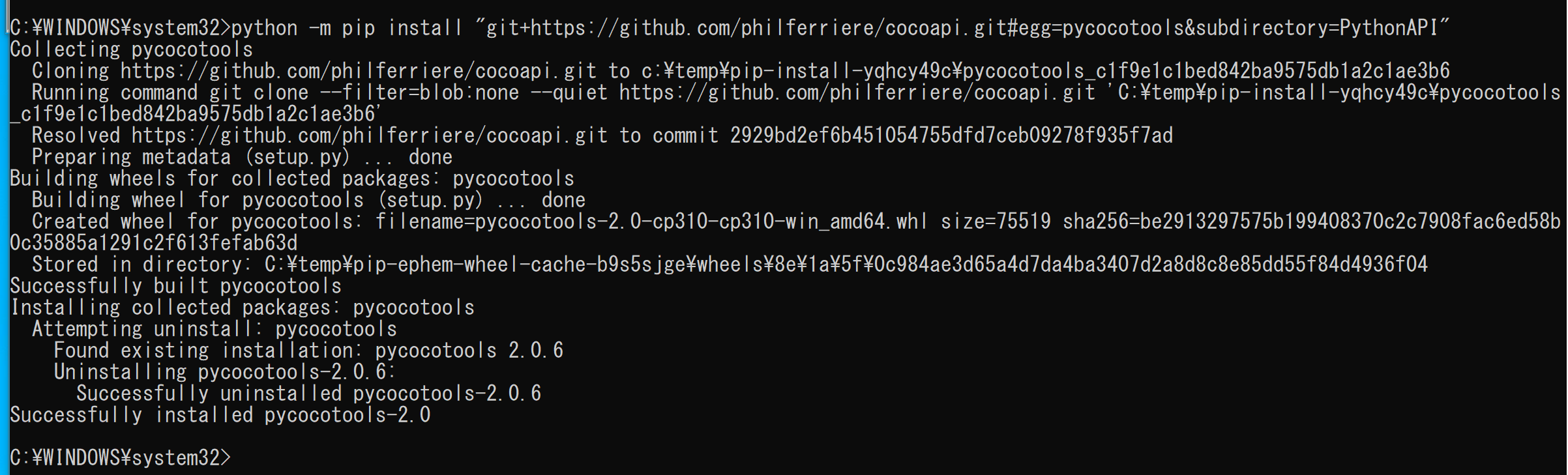

DeepLab2 のインストール(Ubuntu 上)

https://github.com/google-research/deeplab2/blob/main/g3doc/setup/installation.md の記載による.

- protoc のインストール

# パッケージリストの情報を更新 sudo apt update sudo apt -y install libprotobuf-dev protobuf-compiler protobuf-c-compiler python3-protobuf - pycocotools のインストール

sudo pip3 install tensorflow tf-models-official pillow matplotlib cython sudo pip3 install "git+https://github.com/philferriere/cocoapi.git#egg=pycocotools&subdirectory=PythonAPI" # install pycocotools cd /usr/local sudo git clone https://github.com/cocodataset/cocoapi.git sudo chown -R $USER cocoapi cd ./cocoapi/PythonAPI make echo 'export PYTHONPATH=$PYTHONPATH:/usr/local/cocoapi/PythonAPI' >> ~/.bashrc - DeepLab2 のインストール

cd /usr/local sudo rm -rf deeplab2 sudo git clone https://github.com/google-research/deeplab2.git sudo chown -R $USER deeplab2 cd /usr/local protoc deeplab2/*.proto --python_out=. cd /usr/local bash deeplab2/compile.sh echo 'export PYTHONPATH=$PYTHONPATH:/usr/local' >> ~/.bashrc echo 'export PYTHONPATH=$PYTHONPATH:/usr/local/deeplab2' >> ~/.bashrc - TensorFlow モデルのインストール

cd /usr/local sudo rm -rf models sudo git clone https://github.com/tensorflow/models.git sudo chown -R $USER models cd /usr/local/models/research protoc object_detection/protos/*.proto --python_out=. protoc lstm_object_detection/protos/*.proto --python_out=. cd /usr/local/models/research/delf protoc delf/protos/*.proto --python_out=. echo 'export PYTHONPATH=$PYTHONPATH:/usr/local/models' >> ~/.bashrc - DeepLab2 の動作確認

source ~/.bashrc cd /usr/local # Model training test (test for custom ops, protobuf) python deeplab2/model/deeplab_test.py # Model evaluator test (test for other packages such as orbit, cocoapi, etc) python deeplab2/trainer/evaluator_test.py

DeepLabv3

セマンティック・セグメンテーションのモデルである. 2017年発表.

- 文献

Liang-Chieh Chen, George Papandreou, Florian Schroff, Hartwig Adam, Rethinking Atrous Convolution for Semantic Image Segmentation

- 公式のソースコード: https://github.com/tensorflow/models/tree/master/research/deeplab

- MMSegmentation の DeepLabv3 のページ: https://github.com/open-mmlab/mmsegmentation/tree/master/configs/deeplabv3

【関連項目】 Residual Networks (ResNets) , モデル, セマンティック・セグメンテーション

DeepLabv3+

セマンティック・セグメンテーションのモデルである. 2018年発表.

- 文献

Liang-Chieh Chen and Yukun Zhu and George Papandreou and Florian Schroff and Hartwig Adam, Encoder-Decoder with Atrous Separable Convolution for Semantic Image Segmentation, ECCV, 2018.

- 公式のソースコード: https://github.com/tensorflow/models/tree/master/research/deeplab

- MMSegmentation の DeepLabv3+ のページ: https://github.com/open-mmlab/mmsegmentation/tree/master/configs/deeplabv3plus

【関連項目】 Residual Networks (ResNets) , モデル, セマンティック・セグメンテーション

DeepXi

- 文献

Nicolson Aaron, Paliwal Kuldip K., Deep Xi as a Front-End for Robust Automatic Speech Recognition, 2020.

- GitHub のページ: https://github.com/anicolson/DeepXi

- Papers with Code のページ: https://paperswithcode.com/paper/deep-xi-as-a-front-end-for-robust-automatic

【関連項目】 speech enhancement, speech recognition

Google Colaboratory での DeepXi のインストール

公式の手順 https://github.com/anicolson/DeepXi による.

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

%cd /content

!rm -rf DeepXi

!git clone https://github.com/anicolson/DeepXi.git

%cd DeepXi

!pip3 install -r requirements.txt

Deformable DETR

物体検出の一手法.2021 年発表.

- 文献

Xizhou Zhu and Weijie Su and Lewei Lu and Bin Li and Xiaogang Wang and Jifeng Dai, Deformable DETR: Deformable Transformers for End-to-End Object Detection, International Conference on Learning Representations, also CoRR, abs/2010.04159v4, 2021.

- 公式の URL: https://openreview.net/forum?id=gZ9hCDWe6ke

- 公式のソースコード (GitHub): https://github.com/fundamentalvision/Deformable-DETR

- Papers with Code のページ: https://paperswithcode.com/paper/deformable-detr-deformable-transformers-for-1

- MMDetection のモデル: https://github.com/open-mmlab/mmdetection/blob/master/configs/deformable_detr/README.md

【関連項目】 DETR, MMDetection, 物体検出

Demucs

音源分離(music source separation)を行う一手法.2019年発表.2021年に hybrid version が発表された. 音声と楽器音の混合から,音声や楽器音を分離できる.

- 文献

Hybrid Spectrogram and Waveform Source Separation, Alexandre Défossez, Proceedings of the ISMIR 2021 Workshop on Music Source Separation, also CoRR, abs/2111.03600v1, 2021.

- 公式のページ (GitHub): https://github.com/facebookresearch/demucs

- 公式のオンラインデモ (Google Colaboratory): https://colab.research.google.com/drive/1dC9nVxk3V_VPjUADsnFu8EiT-xnU1tGH?usp=sharing

- 公式のオンラインデモ (HuggingFace 内): https://huggingface.co/spaces/akhaliq/demucs

【関連項目】 audio source separation, music source separation

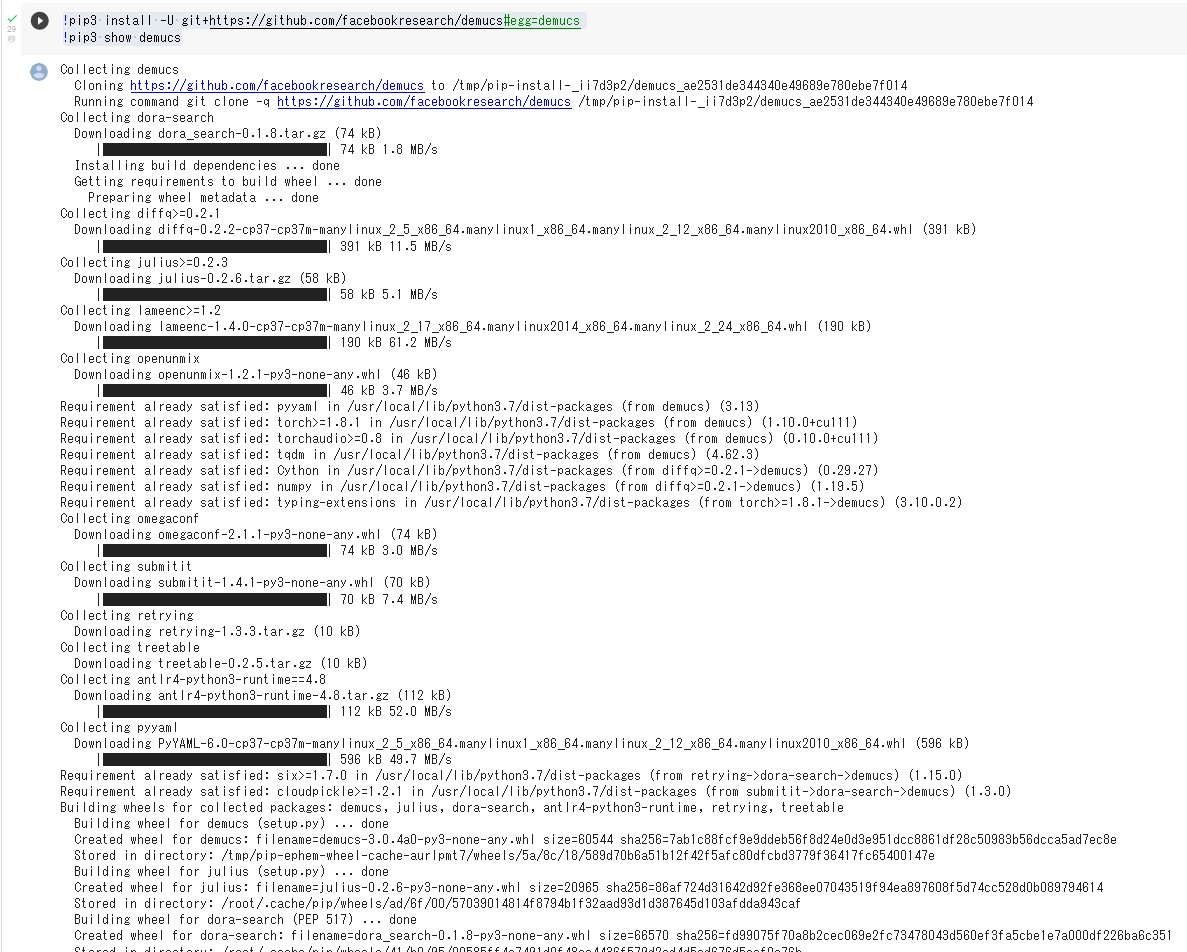

Google Colaboratory で,音声,楽曲の分離 (Demucs を使用)

公式の手順 https://github.com/facebookresearch/demucs による.

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- Demucs のインストール

!pip3 install -U git+https://github.com/facebookresearch/demucs#egg=demucs !pip3 show demucs

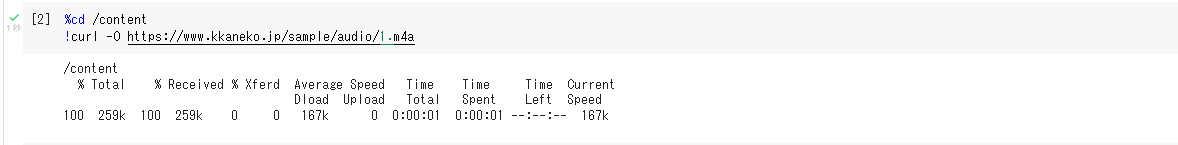

- 処理したいサウンドファイルの準備

ここでは,1.m4a をダウンロードしている.

%cd /content !curl -O https://www.kkaneko.jp/sample/audio/1.m4a

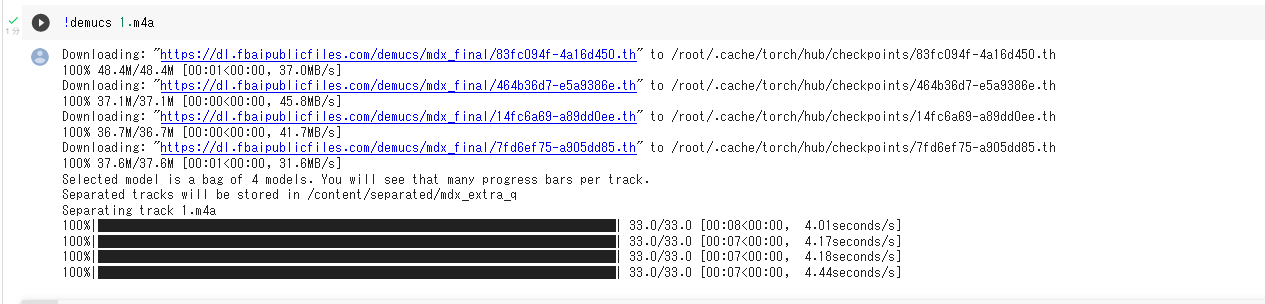

- Demucs の実行

!demucs 1.m4a

- 処理結果のダウンロード

「1」のところは,処理したサウンドファイルのファイル名にあわせること.

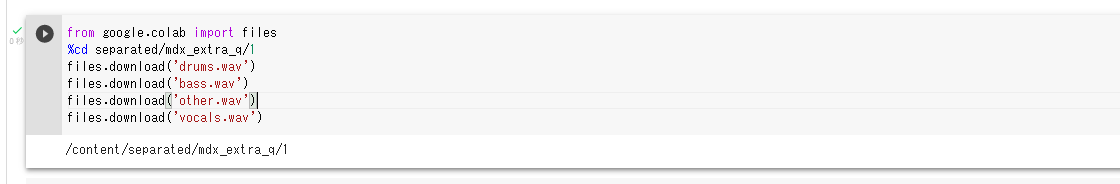

from google.colab import files %cd separated/mdx_extra_q/1 files.download('drums.wav') files.download('bass.wav') files.download('other.wav') files.download('vocals.wav')

DenseNet121, DenseNet169

CoRR, abs/1608.06993

Keras の DenseNet121 を用いて DenseNet121 を作成するプログラムは次のようになる. 「weights=None」を指定することにより,最初,重みをランダムに設定する.

m = tf.keras.applications.densenet.DenseNet121(input_shape=INPUT_SHAPE, weights=None, classes=NUM_CLASSES)

Keras の DenseNet169 を用いて DenseNet169 を作成するプログラムは次のようになる. 「weights=None」を指定することにより,最初,重みをランダムに設定する.

m = tf.keras.applications.densenet.DenseNet169(input_shape=INPUT_SHAPE, weights=None, classes=NUM_CLASSES)

Keras の応用のページ: https://keras.io/api/applications/

PyTorch, torchvision の DenseNet121 学習済みモデルのロード,画像分類のテスト実行

Google Colab あるいはパソコン(Windows あるいは Linux)を使用.

- 前準備

前準備として,Python のインストール(別項目で説明している), PyTorch のインストール を行う.

Google Colaboratory では, Python, PyTorch はインストール済みなので,インストール操作は不要である.次に,pip を用いて,pillow のインストールを行う.

pip install -U pillow - ImageNet データセット で学習済みのDenseNet121 モデルのロード

PyTorch, torchvision のモデルについては: https://pytorch.org/vision/stable/models.html に説明がある.

import torch import torchvision.models as models device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') m = models.densenet121(pretrained=True).to(device) - 画像分類したい画像ファイルのダウンロードとロードと確認表示

from PIL import Image import requests # ダウンロードとロード url = 'https://github.com/pytorch/hub/raw/master/images/dog.jpg' response = requests.get(url) img = Image.open(requests.get(url, stream=True).raw) # 確認表示 display(img)

- 画像の前処理.PyTorch で扱えるようにするため.

from PIL import Image from torchvision import transforms img = Image.open(filename) preprocess = transforms.Compose([ transforms.Resize(256), transforms.CenterCrop(224), transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), ]) input_tensor = preprocess(img) input_batch = input_tensor.unsqueeze(0) - 推論 (inference) の実行

「m.eval()」は,推論を行うときのためのものである.これを行わないと訓練(学習)が行われる.

import torch if torch.cuda.is_available(): input_batch = input_batch.to('cuda') m.eval() with torch.no_grad(): output = m(input_batch) - 結果の表示

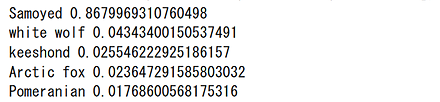

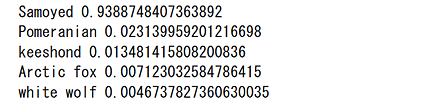

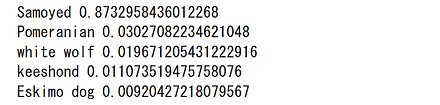

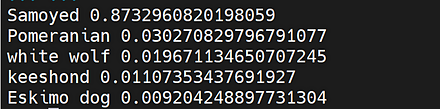

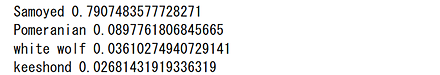

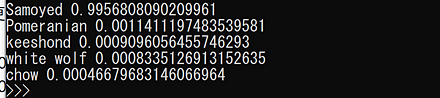

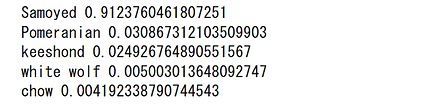

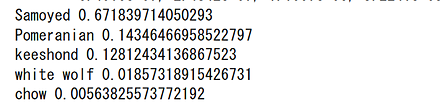

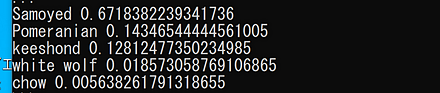

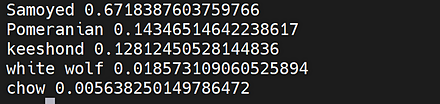

import urllib url, filename = ("https://raw.githubusercontent.com/pytorch/hub/master/imagenet_classes.txt", "imagenet_classes.txt") try: urllib.URLopener().retrieve(url, filename) except: urllib.request.urlretrieve(url, filename) with open("imagenet_classes.txt", "r") as f: categories = [s.strip() for s in f.readlines()] # The output has unnormalized scores. To get probabilities, you can run a softmax on it. probabilities = torch.nn.functional.softmax(output[0], dim=0) print(probabilities) top5_prob, top5_catid = torch.topk(probabilities, 5) for i in range(top5_prob.size(0)): print(categories[top5_catid[i]], top5_prob[i].item())Google Colaboratory での結果

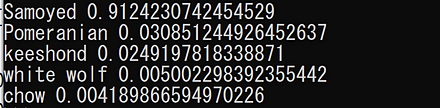

Windows での結果

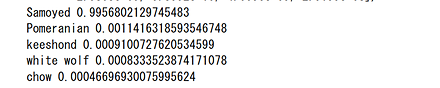

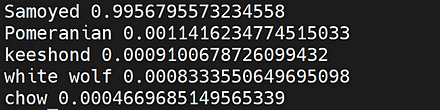

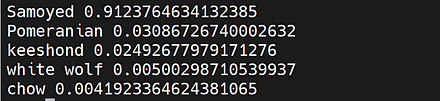

Linux での結果

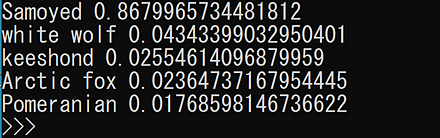

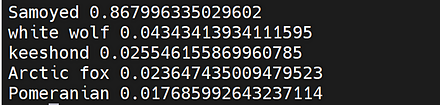

PyTorch, torchvision の DenseNet169 学習済みモデルのロード,画像分類のテスト実行

Google Colab あるいはパソコン(Windows あるいは Linux)を使用.

- 前準備

前準備として,Python のインストール(別項目で説明している), PyTorch のインストール を行う.

Google Colaboratory では, Python, PyTorch はインストール済みなので,インストール操作は不要である.次に,pip を用いて,pillow のインストールを行う.

pip install -U pillow - ImageNet データセット で学習済みのDenseNet169 モデルのロード

PyTorch, torchvision のモデルについては: https://pytorch.org/vision/stable/models.html に説明がある.

import torch import torchvision.models as models device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') m = models.densenet169(pretrained=True).to(device) - 画像分類したい画像ファイルのダウンロードとロードと確認表示

from PIL import Image import requests from IPython.display import display # ダウンロードとロード url = 'https://github.com/pytorch/hub/raw/master/images/dog.jpg' response = requests.get(url) img = Image.open(requests.get(url, stream=True).raw) # 確認表示 display(img)

- 画像の前処理.PyTorch で扱えるようにするため.

from PIL import Image from torchvision import transforms img = Image.open(filename) preprocess = transforms.Compose([ transforms.Resize(256), transforms.CenterCrop(224), transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), ]) input_tensor = preprocess(img) input_batch = input_tensor.unsqueeze(0) - 推論 (inference) の実行

「m.eval()」は,推論を行うときのためのものである.これを行わないと訓練(学習)が行われる.

import torch if torch.cuda.is_available(): input_batch = input_batch.to('cuda') m.eval() with torch.no_grad(): output = m(input_batch) - 結果の表示

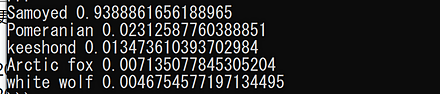

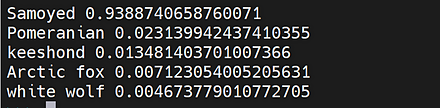

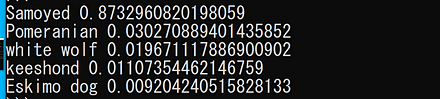

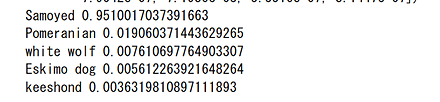

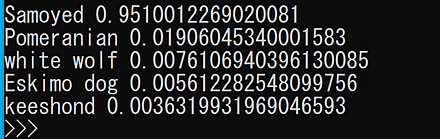

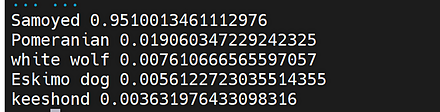

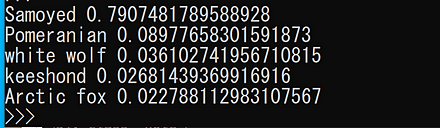

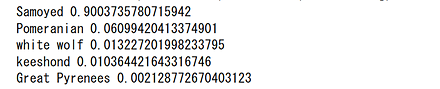

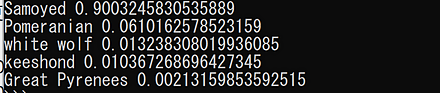

import urllib url, filename = ("https://raw.githubusercontent.com/pytorch/hub/master/imagenet_classes.txt", "imagenet_classes.txt") try: urllib.URLopener().retrieve(url, filename) except: urllib.request.urlretrieve(url, filename) with open("imagenet_classes.txt", "r") as f: categories = [s.strip() for s in f.readlines()] # The output has unnormalized scores. To get probabilities, you can run a softmax on it. probabilities = torch.nn.functional.softmax(output[0], dim=0) print(probabilities) top5_prob, top5_catid = torch.topk(probabilities, 5) for i in range(top5_prob.size(0)): print(categories[top5_catid[i]], top5_prob[i].item())Google Colaboratory での結果

Windows での結果

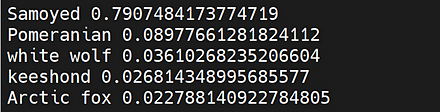

Linux での結果

depth image

depth image は遠近である depth を示す画像である. 画素ごとの色や明るさで depth を表示する.

画像からの depth image の推定は,ステレオカメラや動画から視差を得る方法が主流である.

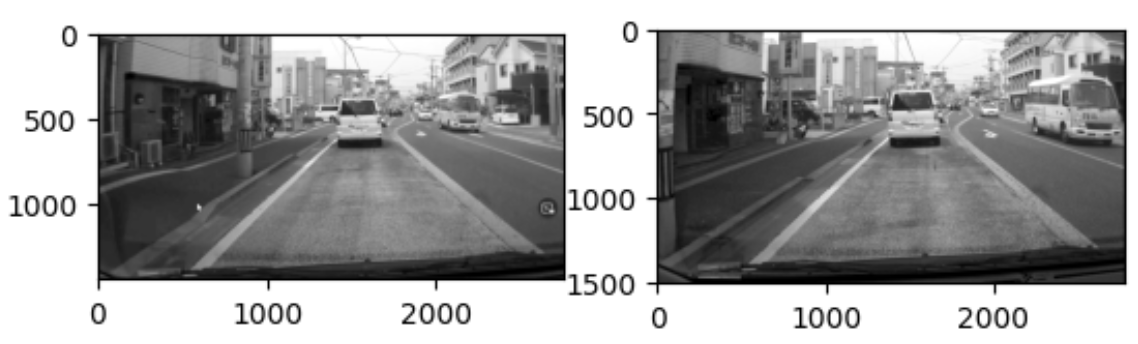

monodepth2 法

単一のカメラでの画像から depth image を推定する方法としては,ディープラーニングを用いる monodepth2 法 (2019 年発表) が知られる.

monodepth2 の GitHub のページ: https://github.com/nianticlabs/monodepth2

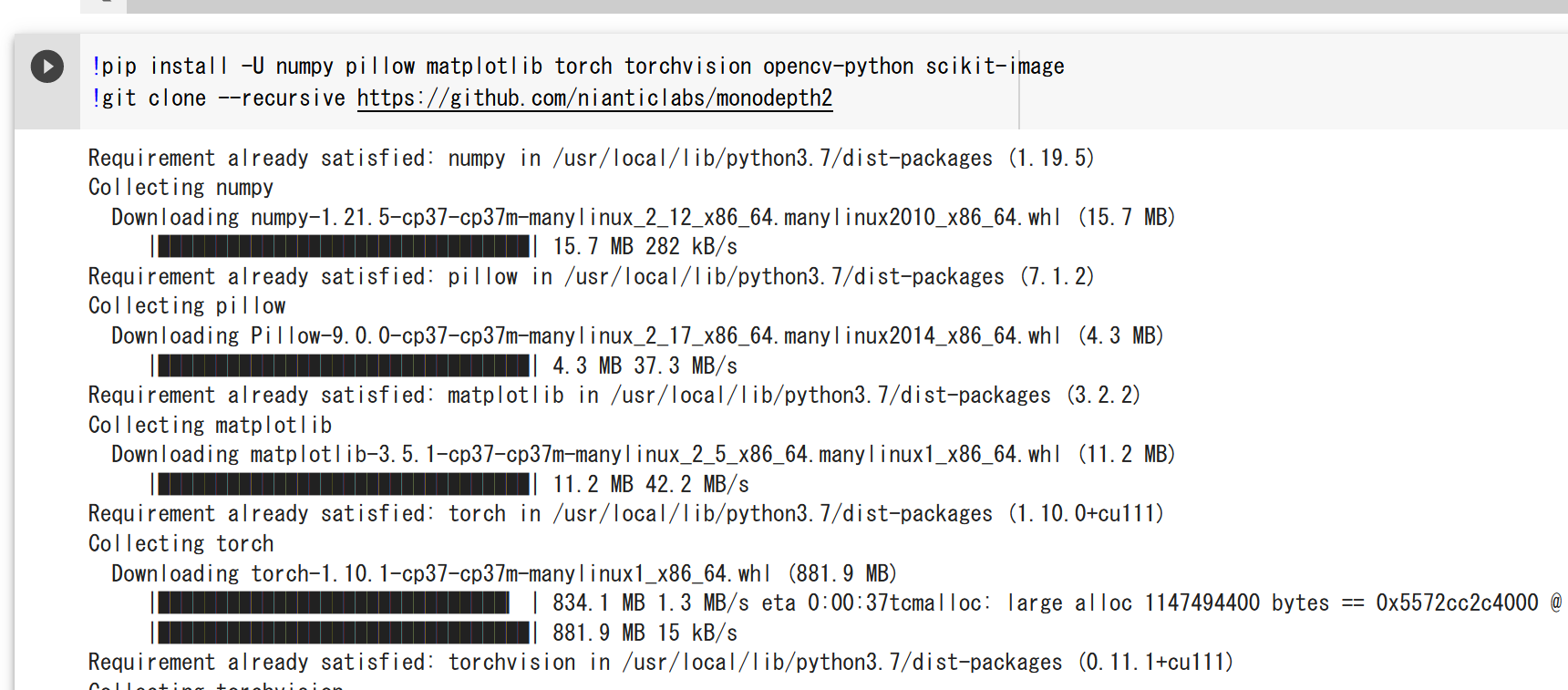

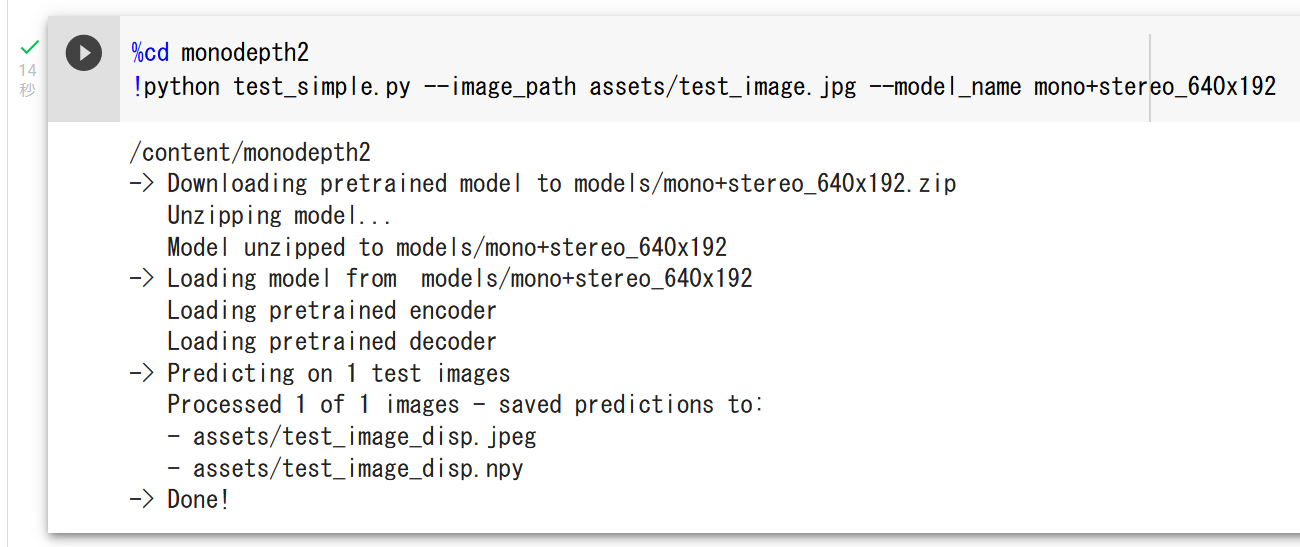

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- インストール

!pip3 install -U numpy pillow matplotlib torch torchvision opencv-python opencv-contrib-python scikit-image !git clone --recursive https://github.com/nianticlabs/monodepth2

- depth image プログラムの実行

%cd monodepth2 !python3 test_simple.py --image_path assets/test_image.jpg --model_name mono+stereo_640x192

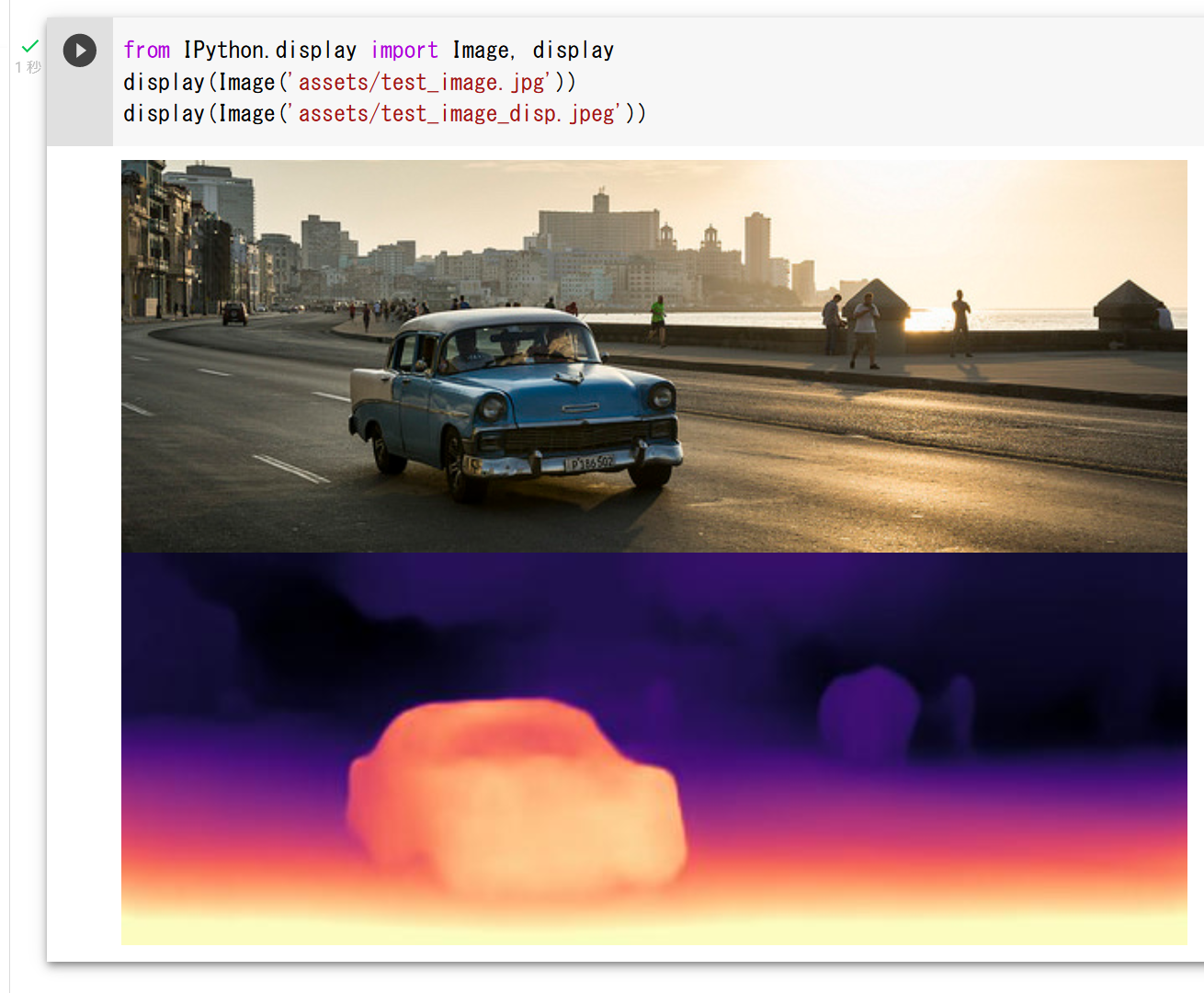

- 画像表示

from PIL import Image Image.open('assets/test_image.jpg').show() Image.open('assets/test_image_disp.jpeg').show()

- 他の画像で試した場合

Detectron2

【文献】

Yuxin Wu and Alexander Kirillov and Francisco Massa and Wan-Yen Lo and Ross Girshick, Detectron2, https://github.com/facebookresearch/detectron2, 2019.

【サイト内の関連ページ】

物体検出,インスタンス・セグメンテーション,パノプティック・セグメンテーションの実行(Detectron2,PyTorch, Python を使用)(Windows 上)

【関連する外部ページ】

- GitHub のページ: https://github.com/facebookresearch/detectron2

- ドキュメント: https://detectron2.readthedocs.io/en/latest/tutorials/getting_started.html

- 関連プロジェクトのページ: https://github.com/facebookresearch/detectron2/tree/master/projects

【関連項目】 ADE20K データセット, インスタンス・セグメンテーション (instance segmentation)

Google Colaboratory で,Detectron2 のインスタンス・セグメンテーションの実行

インストールは次のページで説明されている.

https://github.com/facebookresearch/detectron2/releases

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- Google Colaboratory で,ランタイムのタイプを GPU に設定する.

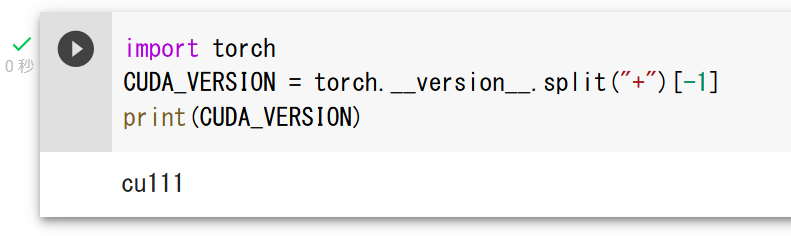

- まず,PyTorch のバージョンを確認する.

PyTorch は,ディープラーニングのフレームワークの機能を持つ Python のパッケージである.

次のプログラム実行により,PyTorch のバージョンが「1.10.0+cu111」のように表示される.

import torch print(torch.__version__) - NVIDIA CUDA ツールキット のバージョンを確認する.

NVIDIA CUDA ツールキットは,NVIDIA社が提供している GPU 用のツールキットである.GPU を用いた演算のプログラム作成や動作のための各種機能を備えている.ディープラーニングでも利用されている.

次のプログラム実行により,NVIDIA CUDA ツールキットのバージョンが「cu111」のように表示される.

import torch CUDA_VERSION = torch.__version__.split("+")[-1] print(CUDA_VERSION)

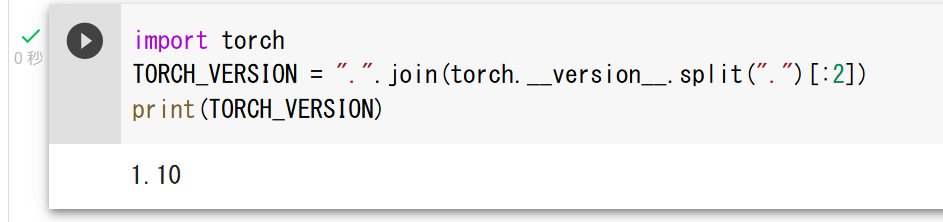

- PyTorch のバージョンを確認する.

import torch TORCH_VERSION = ".".join(torch.__version__.split(".")[:2]) print(TORCH_VERSION)

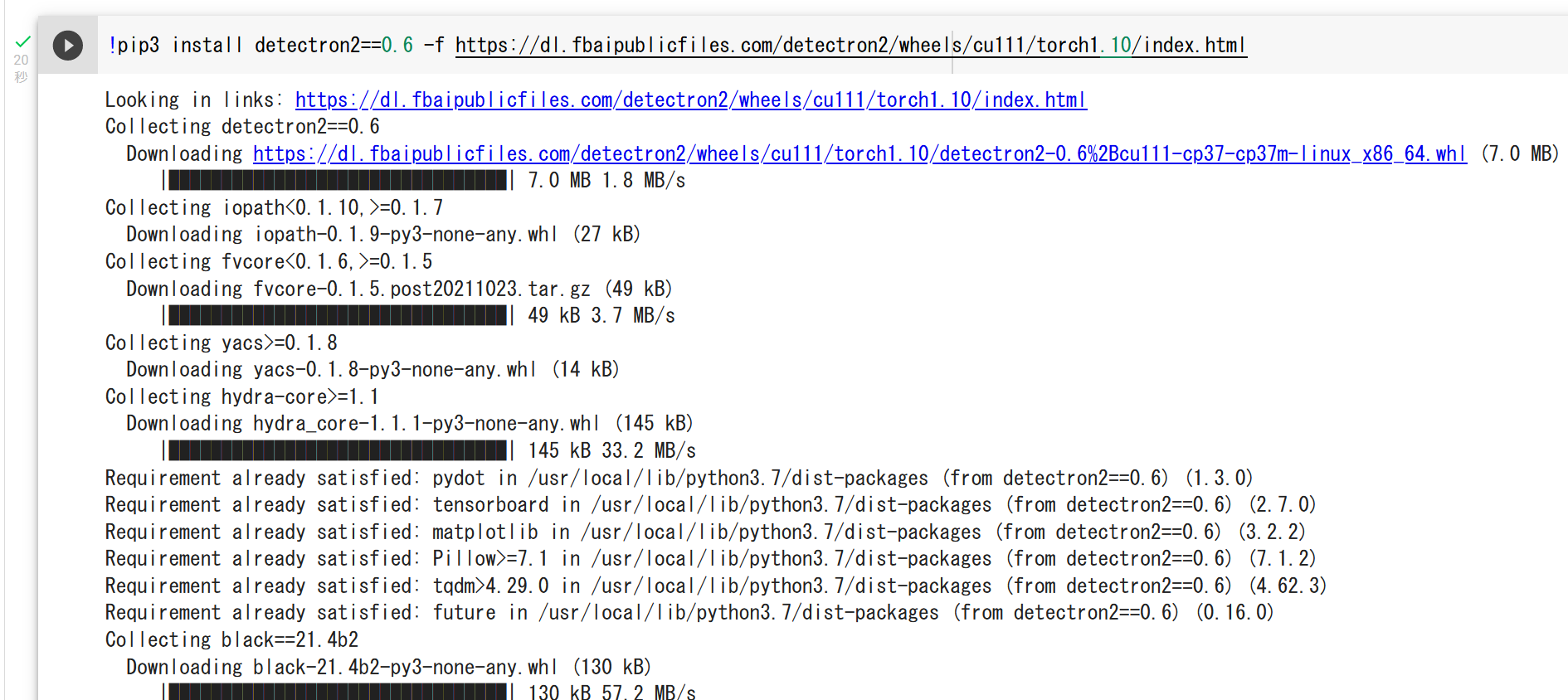

- Detectron2 のインストール

NVIDIA CUDA ツールキット 11.1, PyTorch 1.10 の場合には,次のようになる.

「cu111/torch1.10」のところは, NVIDIA CUDA ツールキット のバージョン, PyTorch のバージョンに合わせる.

!pip3 install detectron2==0.6 -f https://dl.fbaipublicfiles.com/detectron2/wheels/cu111/torch1.10/index.html

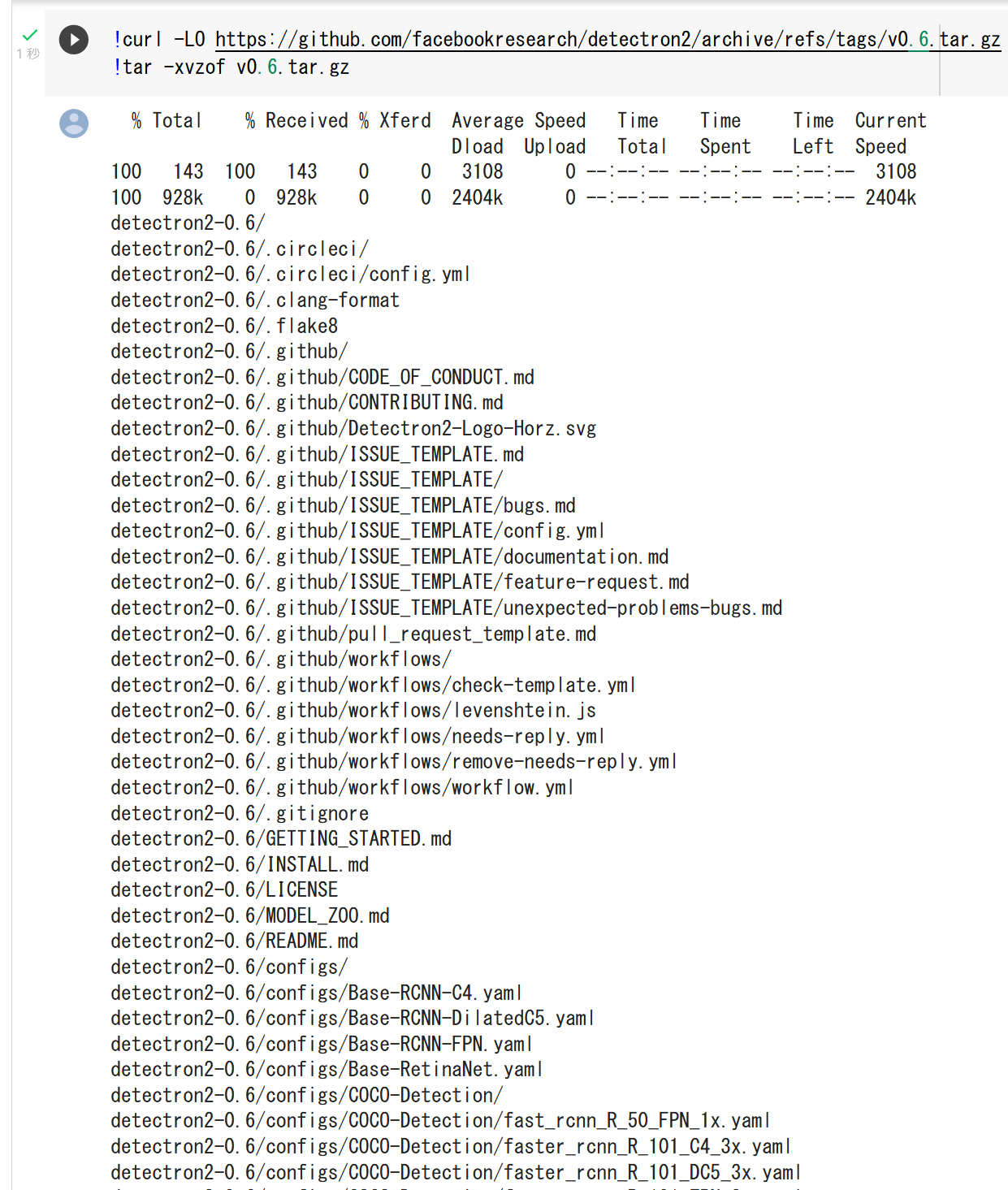

- Detectron2 のソースコードをダウンロード

必要に応じて,中のファイルを利用できるように準備しておく.

!curl -LO https://github.com/facebookresearch/detectron2/archive/refs/tags/v0.6.tar.gz !tar -xvzof v0.6.tar.gz

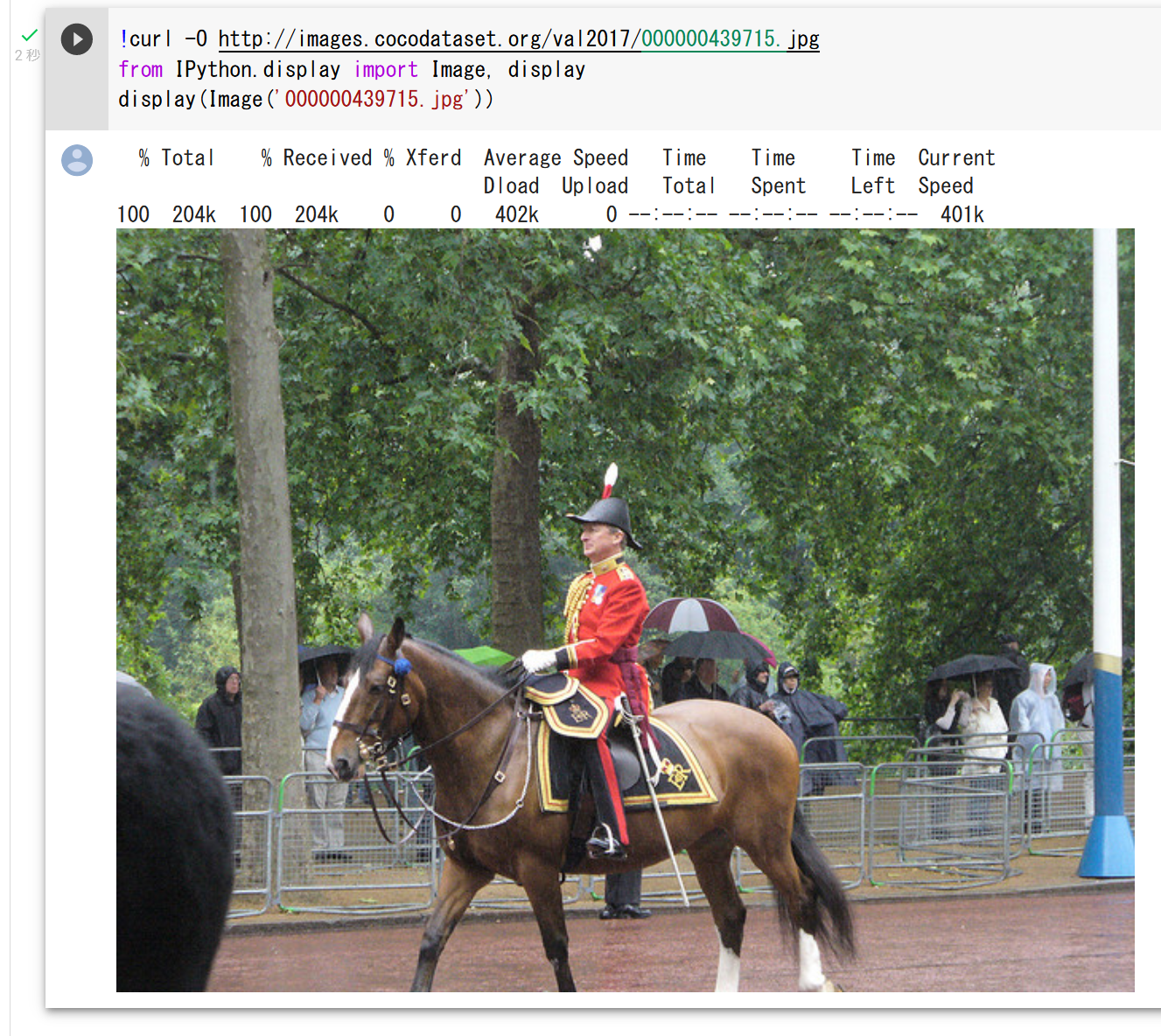

- COCO (Common Objects in Context) データセットの中の画像ファイルをダウンロード

https://colab.research.google.com/drive/16jcaJoc6bCFAQ96jDe2HwtXj7BMD_-m5#scrollTo=FsePPpwZSmqt の記載による.

!curl -O http://images.cocodataset.org/val2017/000000439715.jpg from PIL import Image Image.open('000000439715.jpg').show()

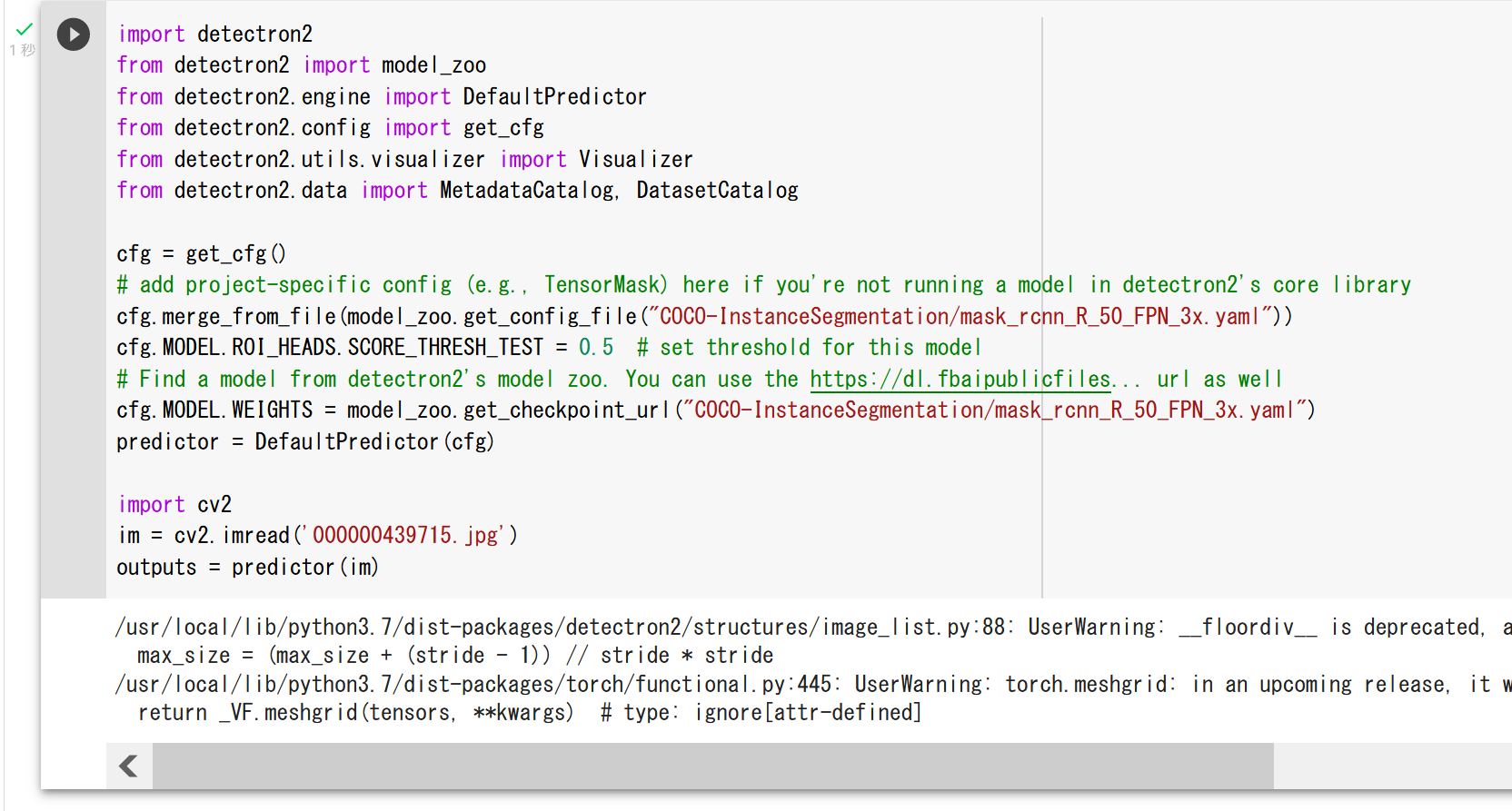

- インスタンス・セグメンテーションの実行

https://colab.research.google.com/drive/16jcaJoc6bCFAQ96jDe2HwtXj7BMD_-m5#scrollTo=FsePPpwZSmqt の記載による.

「im = cv2.imread('000000439715.jpg')」で,処理したい画像ファイルをロードしている.

import detectron2 from detectron2 import model_zoo from detectron2.engine import DefaultPredictor from detectron2.config import get_cfg from detectron2.utils.visualizer import Visualizer from detectron2.data import MetadataCatalog, DatasetCatalog cfg = get_cfg() # add project-specific config (e.g., TensorMask) here if you're not running a model in detectron2's core library cfg.merge_from_file(model_zoo.get_config_file("COCO-InstanceSegmentation/mask_rcnn_R_50_FPN_3x.yaml")) cfg.MODEL.ROI_HEADS.SCORE_THRESH_TEST = 0.5 # set threshold for this model # Find a model from detectron2's model zoo. You can use the https://dl.fbaipublicfiles... url as well cfg.MODEL.WEIGHTS = model_zoo.get_checkpoint_url("COCO-InstanceSegmentation/mask_rcnn_R_50_FPN_3x.yaml") predictor = DefaultPredictor(cfg) import cv2 im = cv2.imread('000000439715.jpg') outputs = predictor(im)

- インスタンス・セグメンテーションの結果の確認

https://colab.research.google.com/drive/16jcaJoc6bCFAQ96jDe2HwtXj7BMD_-m5#scrollTo=FsePPpwZSmqt の記載による.

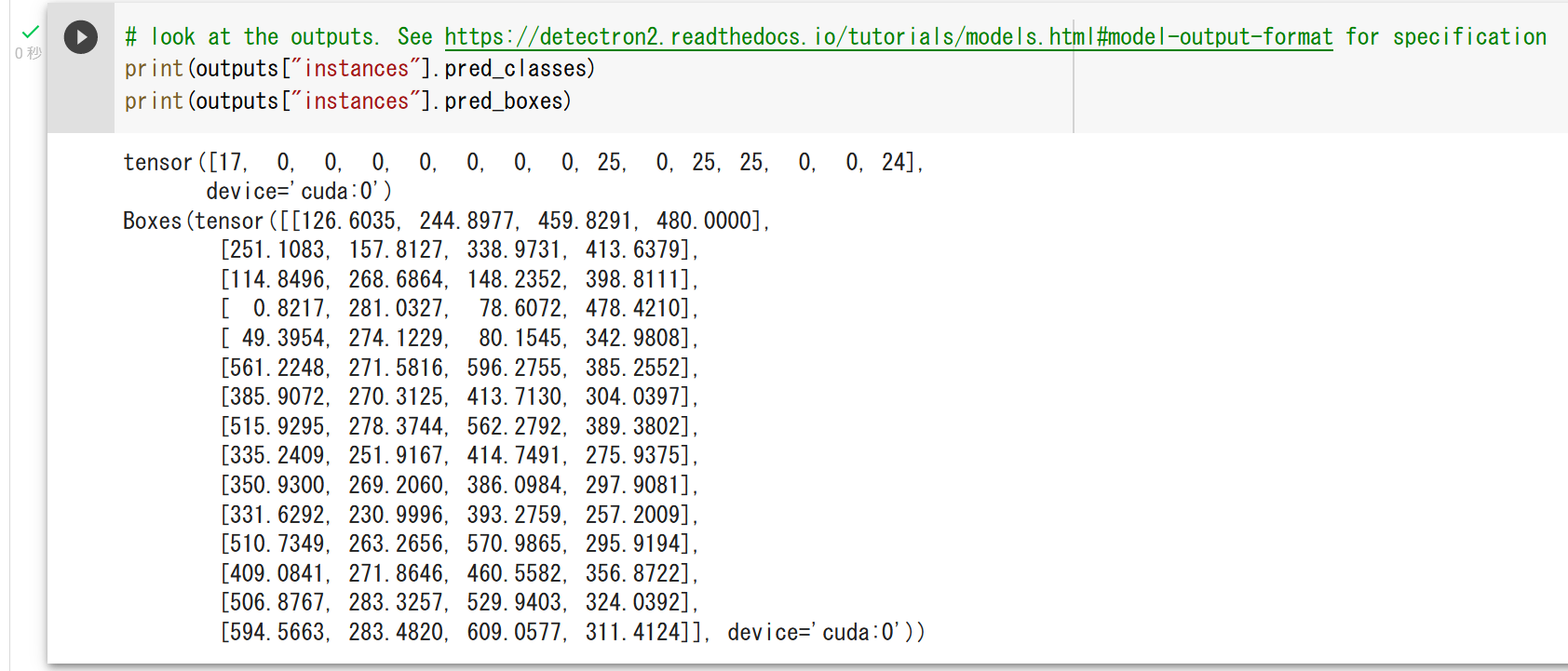

# look at the outputs. See https://detectron2.readthedocs.io/tutorials/models.html#model-output-format for specification print(outputs["instances"].pred_classes) print(outputs["instances"].pred_boxes)

- インスタンス・セグメンテーションの結果の表示

https://colab.research.google.com/drive/16jcaJoc6bCFAQ96jDe2HwtXj7BMD_-m5#scrollTo=FsePPpwZSmqt の記載による.

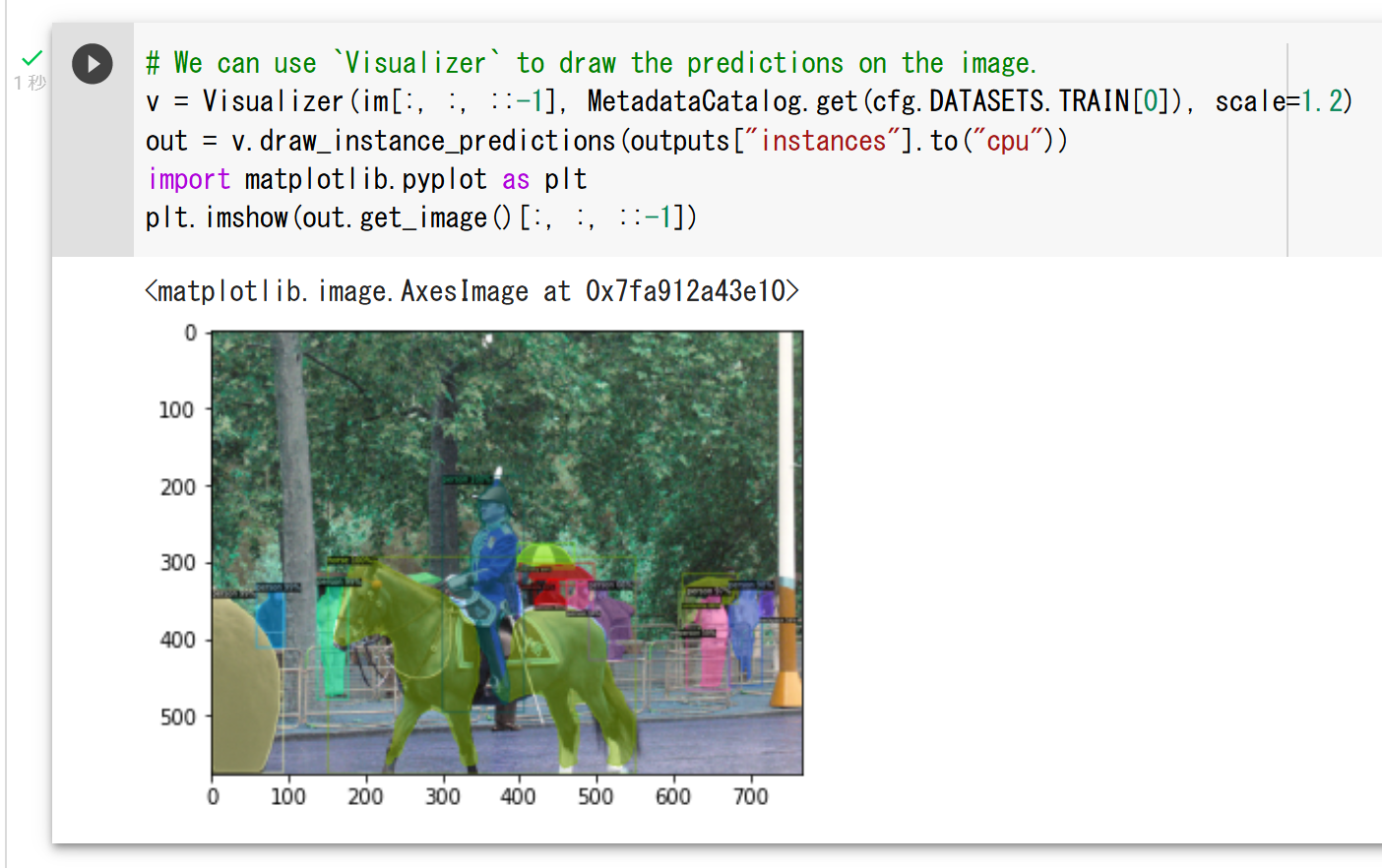

# We can use `Visualizer` to draw the predictions on the image. v = Visualizer(im[:, :, ::-1], MetadataCatalog.get(cfg.DATASETS.TRAIN[0]), scale=1.2) out = v.draw_instance_predictions(outputs["instances"].to("cpu")) import matplotlib.pyplot as plt plt.imshow(out.get_image()[:, :, ::-1])

Windows での Detectron2 のインストールと動作確認

別ページ »で説明している.

Linux での Detectron2 のインストール

https://github.com/facebookresearch/detectron2/releases

このページによれば,Linux マシンで,NVIDIA CUDA ツールキット 11.1, PyTorch 1.9 がインストール済みの場合には,次のような手順になる.

python -m pip install detectron2==0.5 -f https://dl.fbaipublicfiles.com/detectron2/wheels/cu111/torch1.9/index.html

DETR

物体検出, panoptic segmentation の一手法.2020年発表.

- 文献

Nicolas Carion, Francisco Massa, Gabriel Synnaeve, Nicolas Usunier, Alexander Kirillov, Sergey Zagoruyko, End-to-End Object Detection with Transformers, ECCV 2020, also CoRR, abs/2005.12872v3, 2020.

- 公式のソースコード (GitHub): https://github.com/facebookresearch/detr

- 公式のデモ (Google Colaboratory): https://colab.research.google.com/github/facebookresearch/detr/blob/colab/notebooks/detr_demo.ipynb

- Papers with Code のページ: https://paperswithcode.com/paper/end-to-end-object-detection-with-transformers

- TensorFlow のモデル: https://github.com/tensorflow/models/tree/master/official/projects/detr

- MMDetection のモデル: https://github.com/open-mmlab/mmdetection/blob/master/configs/detr/README.md

【関連項目】 Deformable DETR, MMDetection, panoptic segmentation, 物体検出

DiffBIR

DiffBIRは画像復元の手法の一つである. 画像復元は,低品質または劣化した画像を元の高品質な状態に修復するタスクである. このタスクでは,ノイズや歪みなどの複雑な問題に対処する必要がある. DiffBIRは,2つの主要なステージから成り立っている. 最初のステージでは,画像復元が行われ,低品質な画像が高品質に修復される. そして,2番目のステージでは,事前に訓練された Stable Diffusion を使用して,高品質な画像が生成される. DiffBIRは他の既存の手法よりも優れた結果を得ることができることが実験によって示されている.

【文献】

Xinqi Lin, Jingwen He, Ziyan Chen, Zhaoyang Lyu, Ben Fei, Bo Dai, Wanli Ouyang, Yu Qiao, Chao Dong, DiffBIR: Towards Blind Image Restoration with Generative Diffusion Prior, arXiv:2308.15070v1, 2023.

https://arxiv.org/pdf/2308.15070v1.pdf

【関連する外部ページ】

- 公式のデモページ(Google Colaboratory 上): https://colab.research.google.com/github/camenduru/DiffBIR-colab/blob/main/DiffBIR_colab.ipynb

- DiffBIR の公式の GitHub のページ: https://github.com/XPixelGroup/DiffBIR

- Papers with Code のページ: https://paperswithcode.com/paper/diffbir-towards-blind-image-restoration-with

diffusion model

Jascha Sohl-Dickstein, Eric A. Weiss, Niru Maheswaranathan, Surya Ganguli, Deep Unsupervised Learning using Nonequilibrium Thermodynamics, arXiv:1503.03585 [cs.LG].

Dlib

Dlib は,数多くの機能を持つソフトウェアである. Python, C++ のプログラムから使うためのインタフェースを持つ.

Dlib の機能には,機械学習,数値計算,グラフィカルモデル推論,画像処理,スレッド,通信,GUI,データ圧縮・一貫性,テスト,さまざまなユーティリティがある.

Dlib には,顔情報処理に関して,次の機能がある.

- 顔検出 (face detection)

- 顔ランドマーク (facial landmark)の検出

- 顔のアラインメント

- 顔のコード化

ディープニューラルネットワークの学習済みモデルも配布されている.

Dlib の URL: http://dlib.net/

【関連項目】 FairFace, Max-Margin 物体検出 , 顔検出 (face detection), 顔ランドマーク (facial landmark), 顔のコード化

Windows での Dlib のインストール

Dlib のインストールは,複数の方法がある.

- Windows での Dlib,face_recognition のインストール(ソースコードを使用): 別ページ »で説明している.

- Windows での Python の Dlib ライブラリのインストール,Dlib のソースコード等と,Dlib の学習済みモデルのダウンロード: 別ページ »で説明している.

私がビルドしたもの,非公式,無保証. 公開されている Dlib のソースコードを改変せずにビルドした. Windows 10, Build Tools for Visual Studio 2022 を用いてビルドした.NVIDIA CUDA は使用せずにビルドした. Eigen の MPL2 ライセンスによる.

zip ファイルは C:\ 直下で展開し,C:\dlib での利用を想定している.

Ubuntu での Dlib のインストール

Dlib の顔検出

Dlib の顔検出 は次の仕組みで行われる.

Dlib には,ディープラーニングの CNN (convolutional neural network) を用いた物体検出 が実装されている. そこでは,Max-Margin 物体検出法が利用されている(文献は次の通り). それにより,Dlib の顔検出 が行われる.

Davis E. King, Max-Margin Object Detection, CoRR, abs/1502.00046, 2015

- 前準備として,パッケージのインストールと,学習済みモデルのダウンロードを行う.

ここでダウンロードしている mmod_human_face_detector.dat は,学習済みモデルのファイルである. ImageNet データセット, AFLW, Pascal VOC, VGG, WIDER FACE データセット, face scrub 画像について, Dlib の作者がアノテーションしたものを用いて学習済みである. 詳細は https://github.com/davisking/dlib-models を参照のこと.

Windows では, コマンドプロンプトを管理者として開き次のコマンドを実行する.

python -m pip install dlib opencv-python matplotlib curl -O http://dlib.net/files/mmod_human_face_detector.dat.bz2 "c:\Program Files\7-Zip\7z.exe" x mmod_human_face_detector.dat.bz2Linux では次のコマンドを実行する.

# パッケージリストの情報を更新 sudo apt update sudo apt -y install python3-matplotlib libopencv-dev libopencv-core-dev python3-opencv libopencv-contrib-dev opencv-data sudo pip3 install dlib curl -O http://dlib.net/files/mmod_human_face_detector.dat.bz2 bzip2 -d mmod_human_face_detector.dat.bz2 - Dlib を用いた顔検出の Python プログラムは次の通りである.

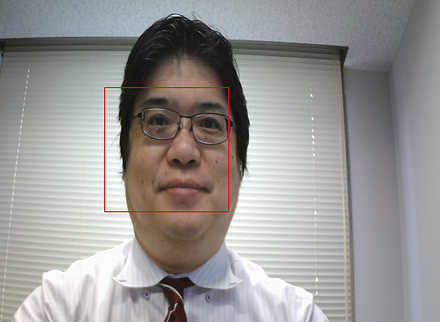

import dlib import cv2 %matplotlib inline import matplotlib.pyplot as plt import warnings warnings.filterwarnings('ignore') # Suppress Matplotlib warnings import time import argparse # 使い方: 次のプログラムを a.py というファイル名で保存し,「python a.py」のように実行. # あるいは python a.py --image IMG_3264.png --model mmod_human_face_detector.dat のように. # --model は学習済みモデルのファイル名を指定できる ap = argparse.ArgumentParser() ap.add_argument("-i", "--image", help="input image", default="a.png") ap.add_argument("-m", "--model", help="pre-trained model", default="python_examples/mmod_human_face_detector.dat") ap.add_argument("-u", "--upsample", type=int, default=1) args = vars(ap.parse_args()) # face_detector = dlib.cnn_face_detection_model_v1(args['model']) # 画像ファイル名を a.png のところに設定 bgr = cv2.imread(args['image']) if bgr is None: print("画像ファイルがない") exit() # 顔検出を行う. start = time.time() faces = face_detector(cv2.cvtColor(bgr, cv2.COLOR_BGR2RGB), args['upsample']) end = time.time() print("秒数 : ", format(end - start, '.2f')) # 顔検出で得られた顔(複数あり得る)それぞれについて,赤い四角を書く for i, f in enumerate(faces): x = f.rect.left() y = f.rect.top() width = f.rect.right() - x height = f.rect.bottom() - y cv2.rectangle(bgr, (x, y), (x + width, y + height), (0, 0, 255), 2) print("%s, %d, %d, %d, %d" % (args['image'], x, y, x + width, y + height)) # 画面に描画 plt.style.use('default') plt.imshow(cv2.cvtColor(bgr, cv2.COLOR_BGR2RGB)) # ファイルに保存 cv2.imwrite("result.png", bgr) - 次のような結果が表示される.

次のページは,上のプログラム等を記載したGoogle Colaboratory のページである.ページを開き実行できる.

URL: https://colab.research.google.com/drive/1q-dGCfre8MT5Zet2O3xYoYMUP0sx_KLc?usp=sharing [Google Colaboratory]

Dlib の顔検出の詳しい手順: 別ページ »で説明している.

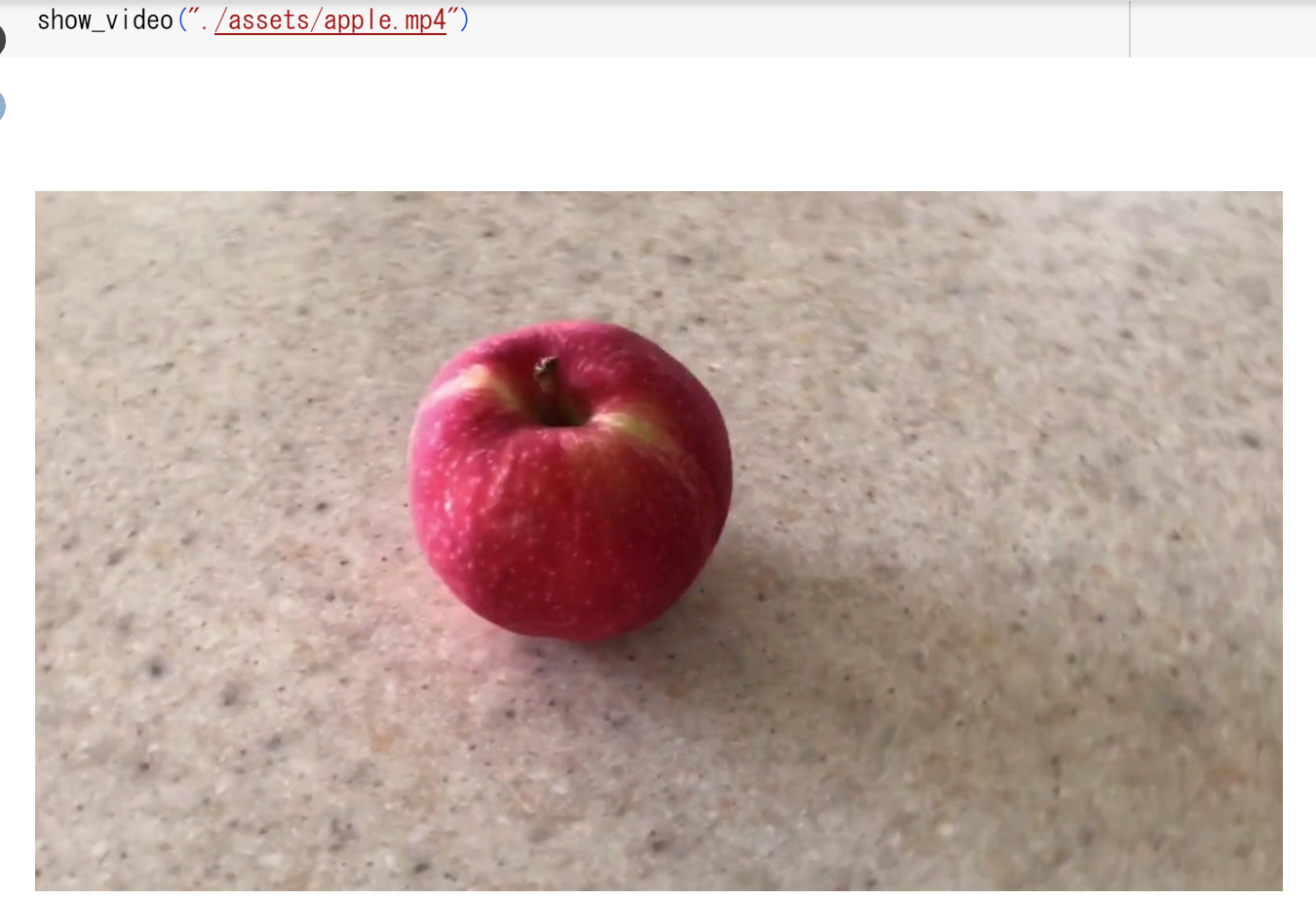

DreamGaussian

DreamGaussianは3Dコンテンツ生成のフレームワークであり,画像から3Dモデルを生成する(Image-to-3D)とテキストから3Dモデルを生成する(Text-to-3D)の二つの主要なタスクに対応している.既存の手法である Neural Radiance Fields(NeRF)は高品質な結果を出すものの,計算時間が長いという課題があった.DreamGaussianの特長は,3Dガウススプラッティングモデルを用いることで,メッシュの抽出とUV空間でのテクスチャの精緻化が効率的に行える点である.このアプローチにより,DreamGaussianは既存の NeRF ベースの手法よりも高速な3Dコンテンツ生成を実現している.さらに,実験結果では,DreamGaussianが Image-to-3D と Text-to-3D の両方のタスクで既存の方法よりも高速であることが確認されている.

【文献】

Jiaxiang Tang, Jiawei Ren, Hang Zhou, Ziwei Liu, Gang Zeng, DreamGaussian: Generative Gaussian Splatting for Efficient 3D Content Creation, arXiv:2309.16653v1, 2023.

https://arxiv.org/pdf/2309.16653v1.pdf

【関連する外部ページ】

- 公式のオンラインデモ(Google Colaboratory): https://colab.research.google.com/drive/1sLpYmmLS209-e5eHgcuqdryFRRO6ZhFS?usp=sharing

- Image-to-3D の公式のオンラインデモ(Google Colaboratory): https://colab.research.google.com/drive/1sLpYmmLS209-e5eHgcuqdryFRRO6ZhFS?usp=sharing

元画像

中間結果(左),最終結果のスクリーンショット(右)

処理結果(3次元データ): b.obj, b.mtl, b_albedo.png

処理結果のスクリーンショット(動画):

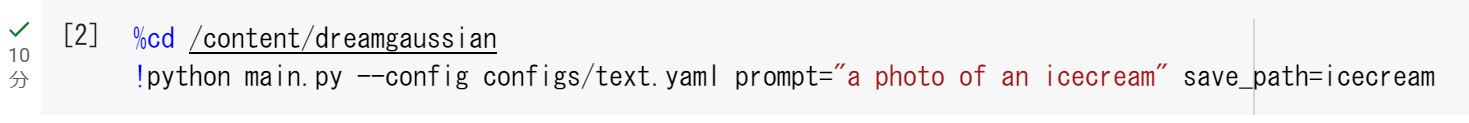

- Text-to-3D の公式のオンラインデモ(Google Colaboratory): https://colab.research.google.com/github/camenduru/dreamgaussian-colab/blob/main/dreamgaussian_colab.ipynb

処理結果(3次元データ): icecream_mesh.obj, icecream_mesh.mtl, icecream_mesh_albedo.png, icecream_model.ply

処理結果のスクリーンショット(動画): icecream.mp4

- GitHub のページ: https://github.com/dreamgaussian/dreamgaussian

- Papers with Code のページ: https://paperswithcode.com/paper/dreamgaussian-generative-gaussian-splatting

DUTS データセット

DUTS データセットは,saliency detection のためのデータセットである. 10,553枚の訓練画像と5,019枚のテスト画像を含む.

- 訓練画像は ImageNet DET training/val set から収集された.

- テスト画像は ImageNet DET training/val set と SUN データセットから収集された.

いずれも手動でアノテーションされている.

次の URL で公開されているデータセット(オープンデータ)である.

URL: http://saliencydetection.net/duts/

- Papers with Code: https://paperswithcode.com/dataset/duts

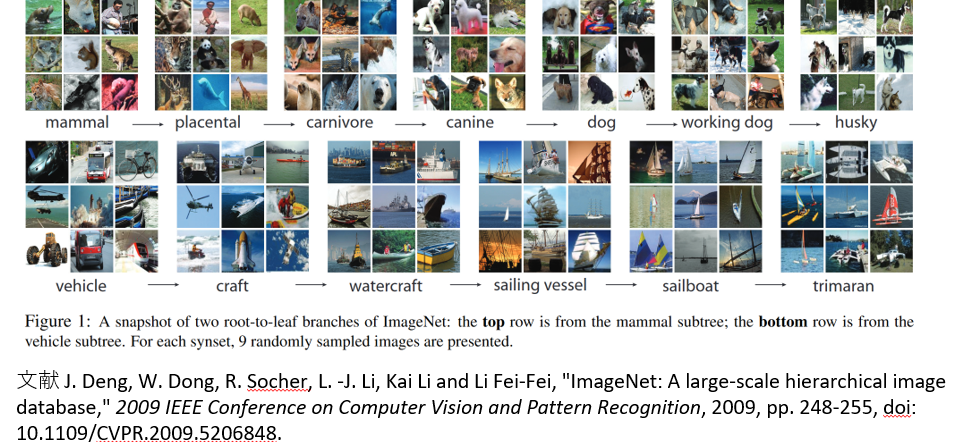

- ImageNet データセットの文献

J. Deng, W. Dong, R. Socher, L.-J. Li, K. Li, and L. Fei-Fei, Imagenet: A large-scale hierarchical image database, CVPR, 2009.

- SUN データセットの文献

J. Xiao, J. Hays, K. A. Ehinger, A. Oliva, and A. Torralba, SUN database: Large-scale scene recognition from abbey to zoo, CVPR, 2010.

- DUTS データセットの文献

Lijun Wang, Huchuan Lu, Yifan Wang, Mengyang Feng, Dong Wang, Baocai Yin, and Xiang Ruan, Learning to detect salient objects with image-level supervision, CVPR, 2017.

https://openaccess.thecvf.com/content_cvpr_2017/papers/Wang_Learning_to_Detect_CVPR_2017_paper.pdf

【関連項目】 salient object detection, 物体検出

Early Stopping

Early Stopping は, 正則化 (regularization) のための一手法である. training loss の減少が終わるのを待たずに,学習の繰り返しを打ち切る. このとき,検証用データでの検証において,validation loss が増加を開始した時点で,学習の繰り返しを打ち切る.

【Keras のプログラム】

from keras.callbacks import EarlyStopping

cb = EarlyStopping(monitor='val_loss', patience = 10)

コールバックは,次のようにして使用する.

【Keras のプログラム】

history = m.fit(x_train, y_train, batch_size=32, epochs=50, validation_data=(x_test, y_test), callbacks=[cb])

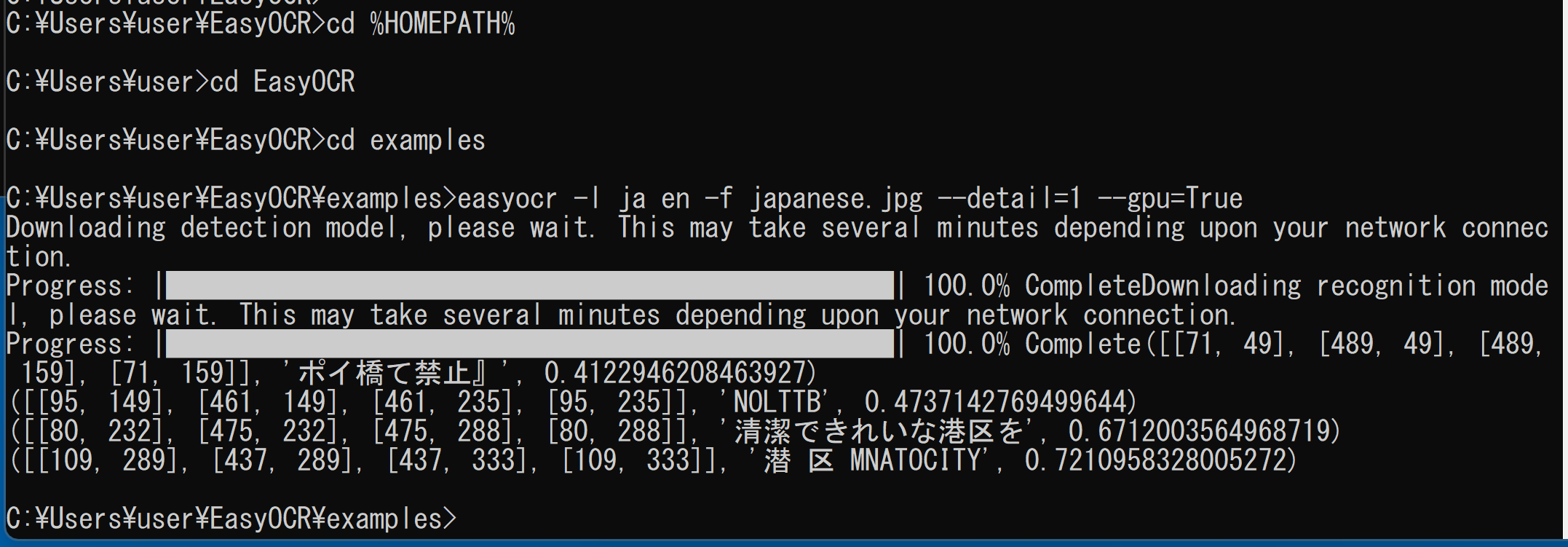

EasyOCR

EasyOCR は,多言語の文字認識のソフトウエアである. テキスト検出に CRAFT を使用している.

学習用のソースコードも公開されている.

【サイト内の関連ページ】

EasyOCR のインストールと動作確認(多言語の文字認識)(Python,PyTorch を使用)(Windows 上): 別ページ »で説明している.

【関連する外部ページ】

- 公式の GitHub のページ: https://github.com/JaidedAI/EasyOCR

- 公式のオンラインデモ: https://www.jaided.ai/easyocr/

【関連項目】 CRAFT, OCR

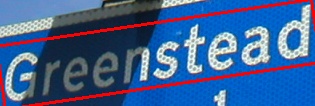

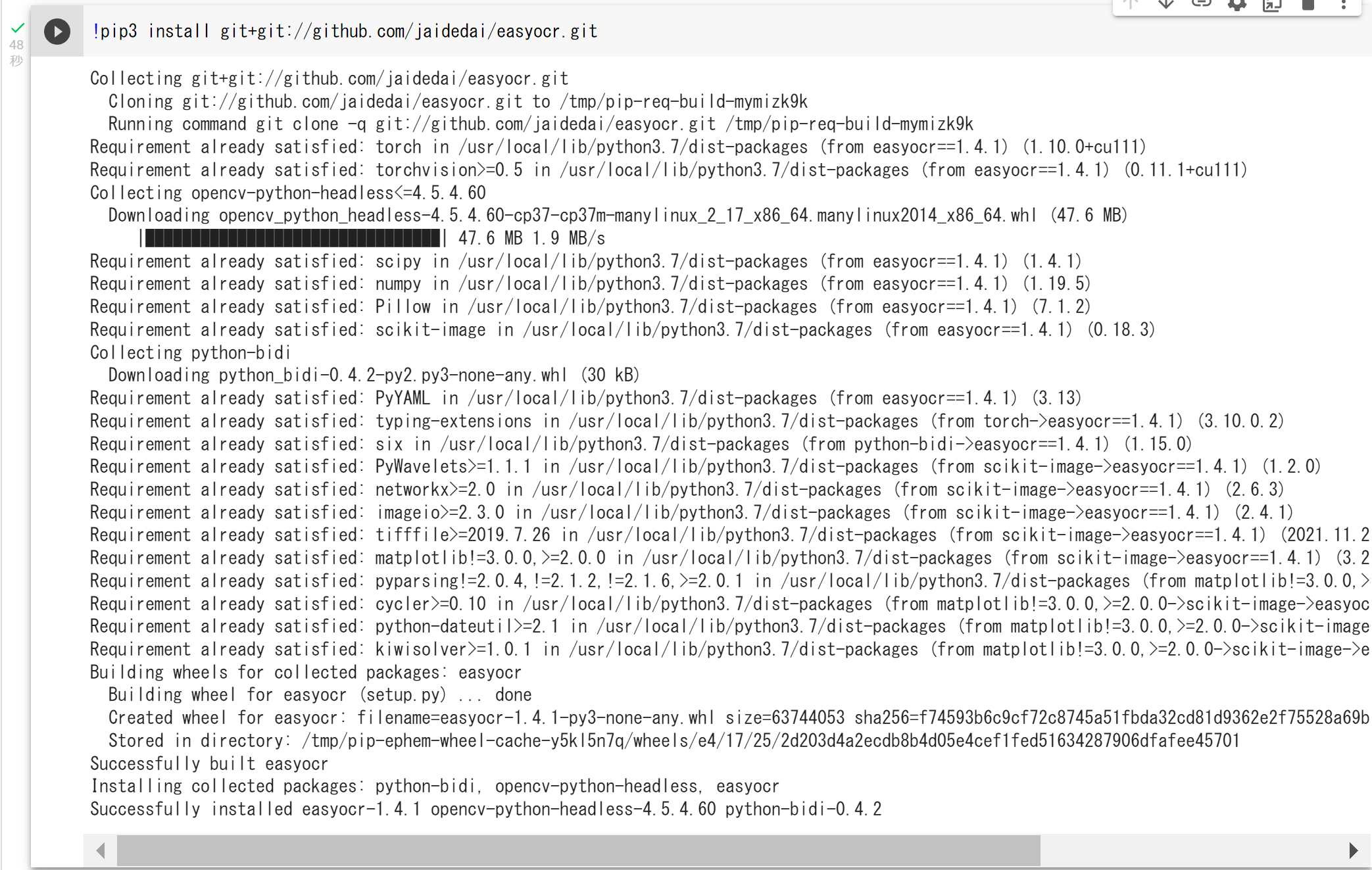

Google Colaboratory で,EasyOCR による日本語読み取りの実行

公式の手順 (https://github.com/JaidedAI/EasyOCR)による.

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- EasyOCR のインストール

!pip3 install git+git://github.com/jaidedai/easyocr.git

- 処理したい画像ファイルを Google Colaboratory にアップロードする.

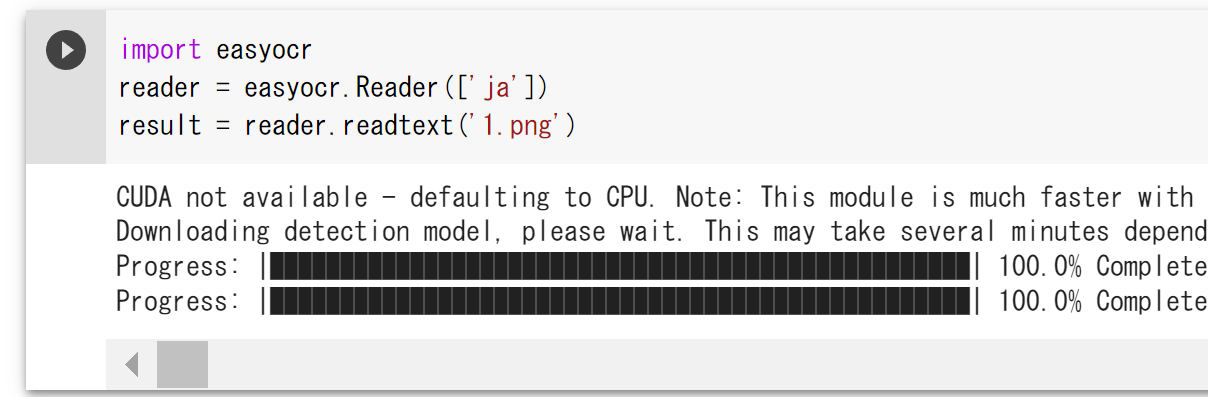

- OCR の実行

「ja」は「日本語」の意味である.

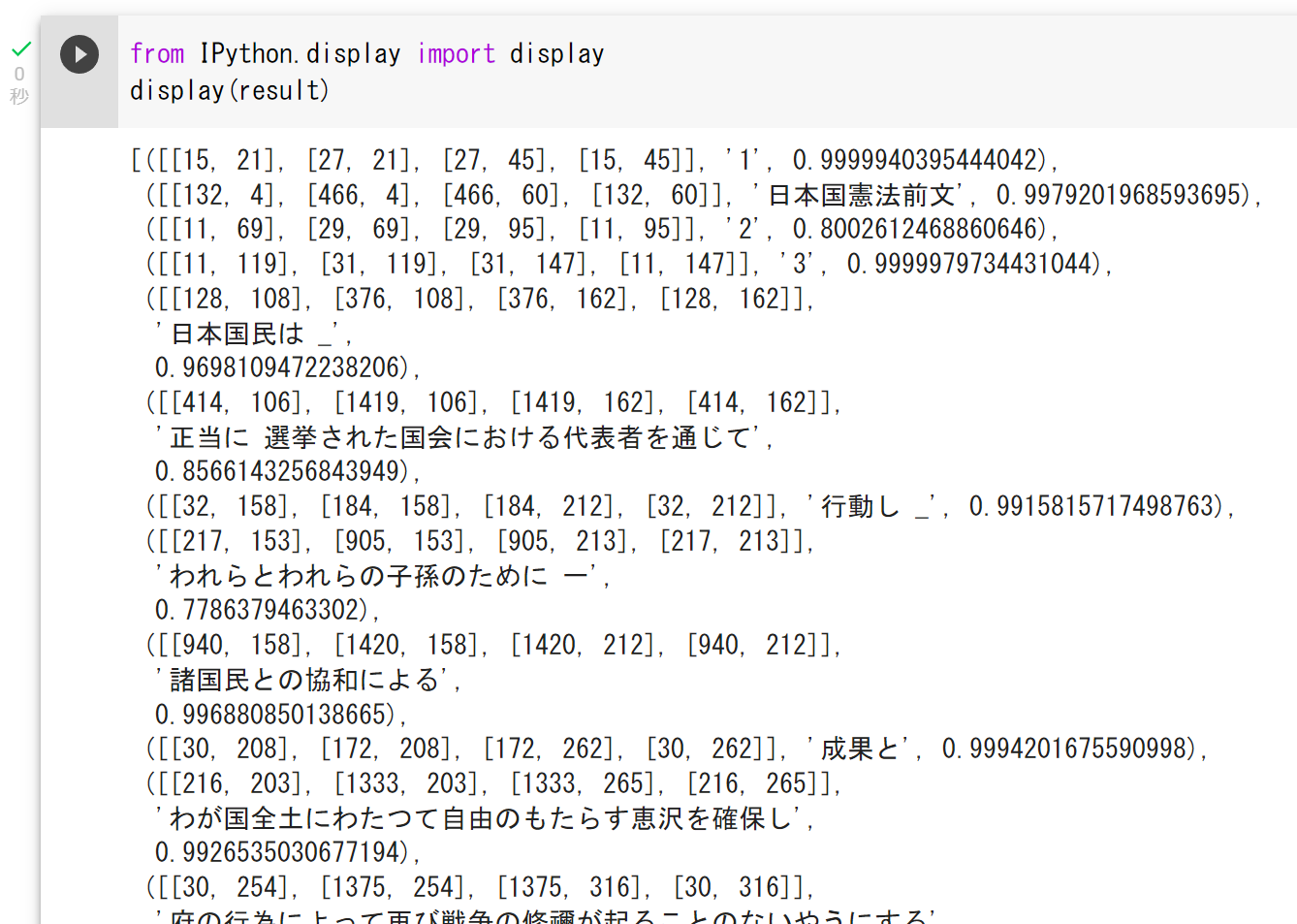

import easyocr reader = easyocr.Reader(['ja']) result = reader.readtext('1.png')

- 結果の確認

from IPython.display import display display(result)

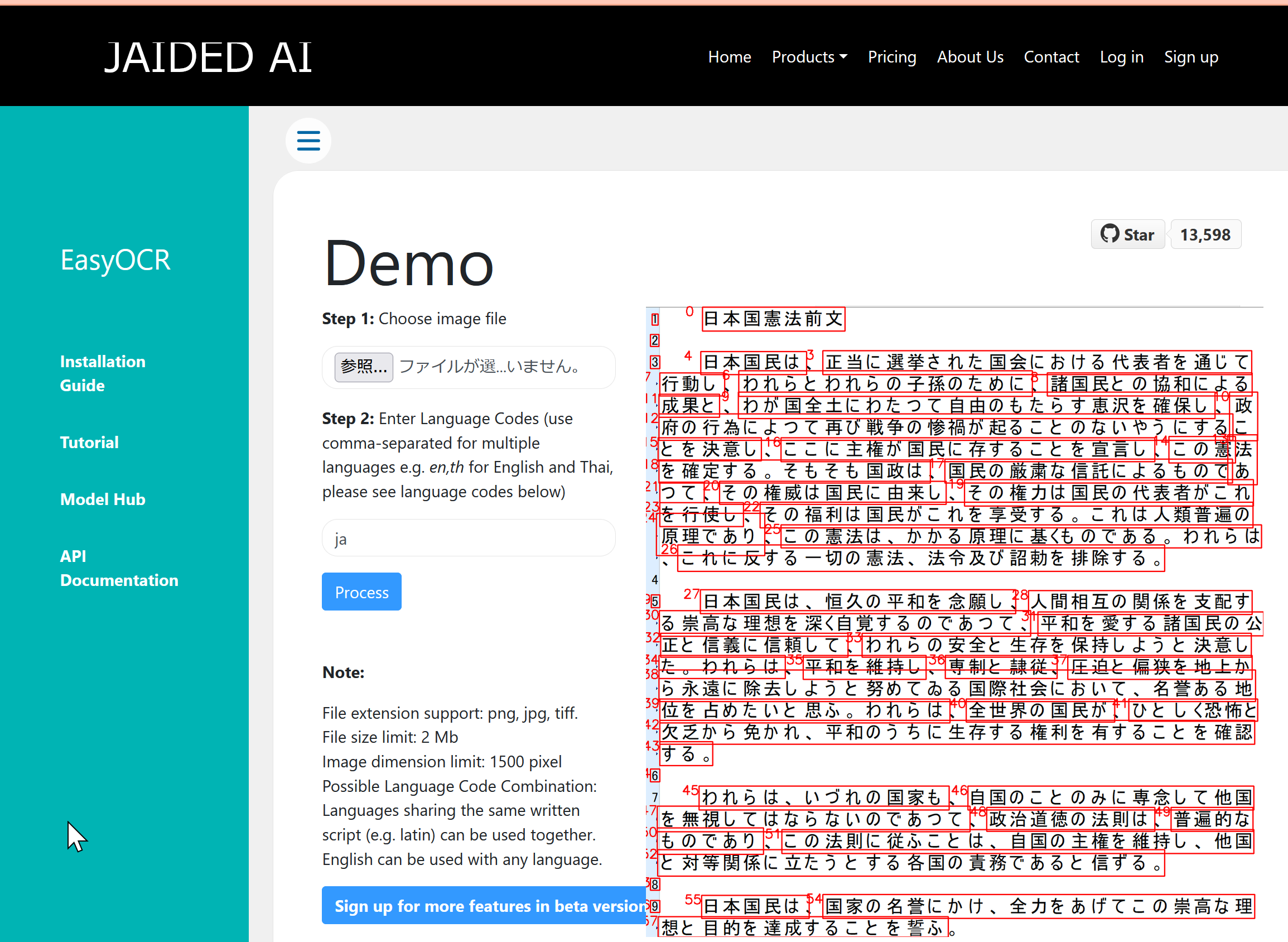

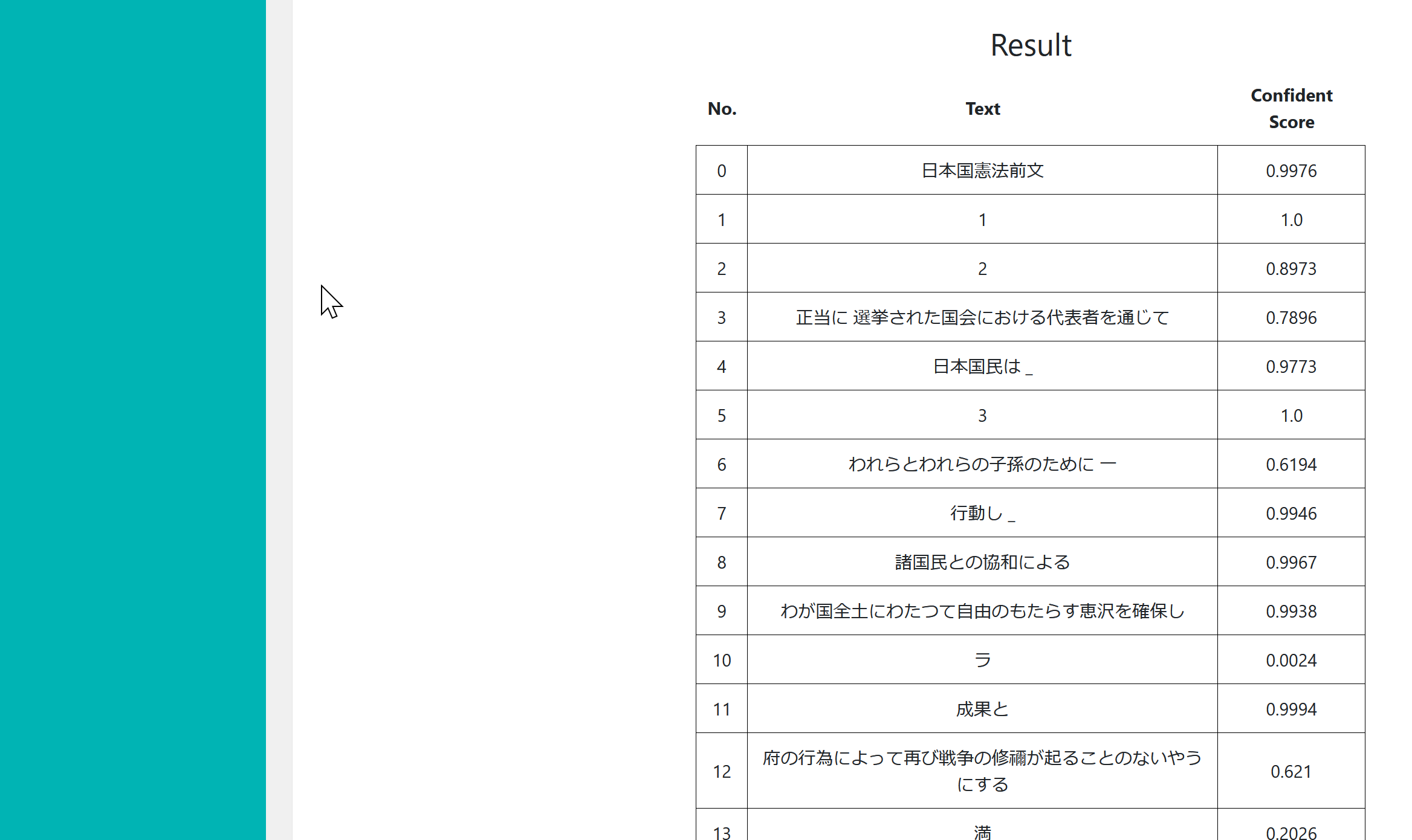

JAIDED AI による EasyOCR のオンラインデモ

JAIDED AI による EasyOCR のオンラインデモの URL: https://www.jaided.ai/easyocr/

EdgeBoxes 法

エッジから,オブジェクトのバウンディングボックス(包含矩形)を求める方法である.

- 文献

C. L. Zitnick and P. Dollár. Edge boxes: Locating object proposals from edges, ECCV, 2014.

- Papers with Code の EdgeBoxes のページ: https://paperswithcode.com/method/edgeboxes

【関連項目】 物体検出

EfficientDet

zylo117 による EfficientDet の実装 (GitHub) のページ: https://github.com/zylo117

【関連項目】 物体検出

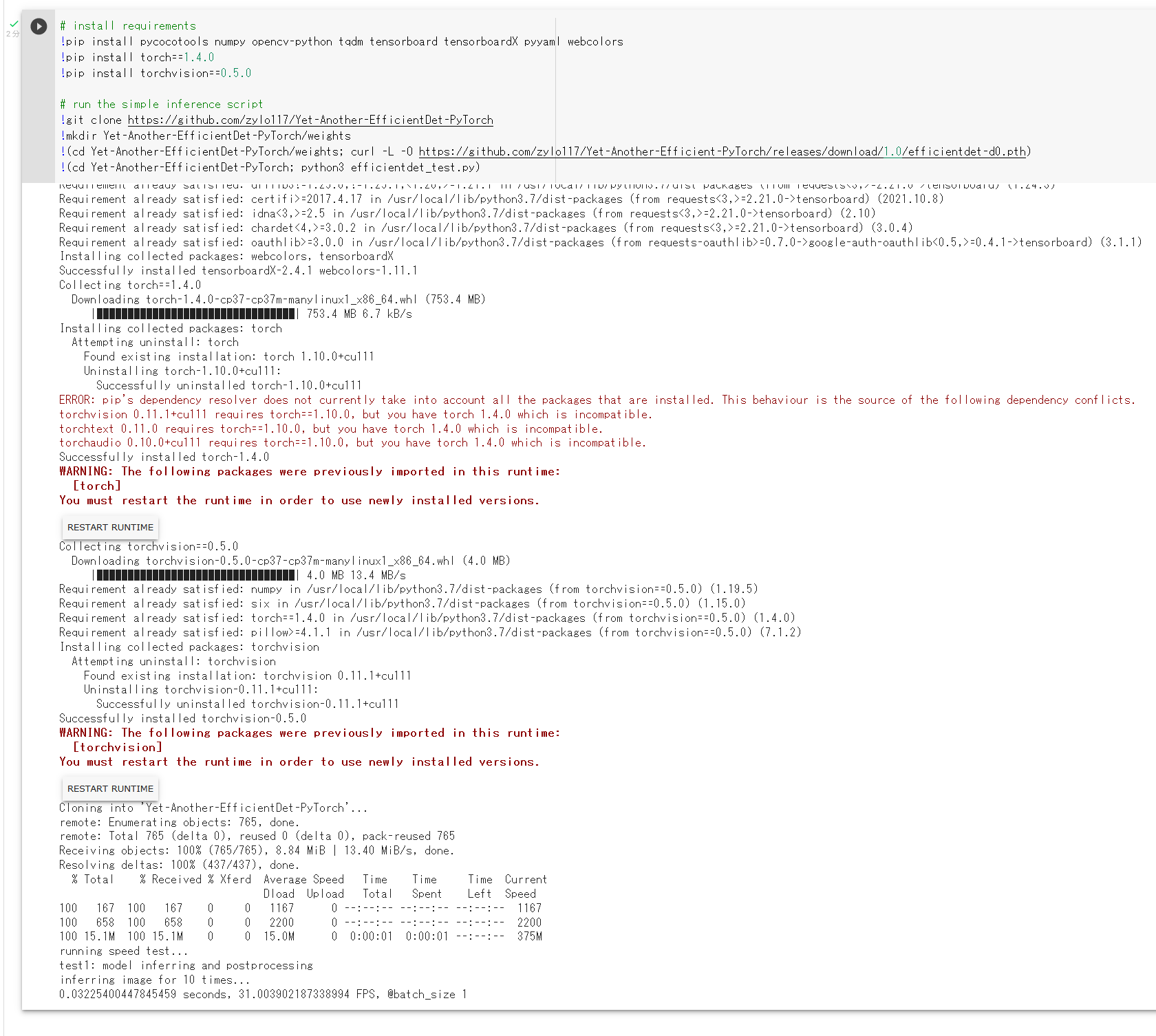

Google Colaboratory で,EfficientDet のインストール

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

# install requirements

!pip3 install pycocotools numpy opencv-python opencv-contrib-python tqdm tensorboard tensorboardX pyyaml webcolors

!pip3 install torch==1.4.0

!pip3 install torchvision==0.5.0

# run the simple inference script

!rm -rf Yet-Another-EfficientDet-PyTorch

!git clone https://github.com/zylo117/Yet-Another-EfficientDet-PyTorch

!mkdir Yet-Another-EfficientDet-PyTorch/weights

!(cd Yet-Another-EfficientDet-PyTorch/weights; curl -L -O https://github.com/zylo117/Yet-Another-Efficient-PyTorch/releases/download/1.0/efficientdet-d0.pth)

!(cd Yet-Another-EfficientDet-PyTorch; python3 efficientdet_test.py)

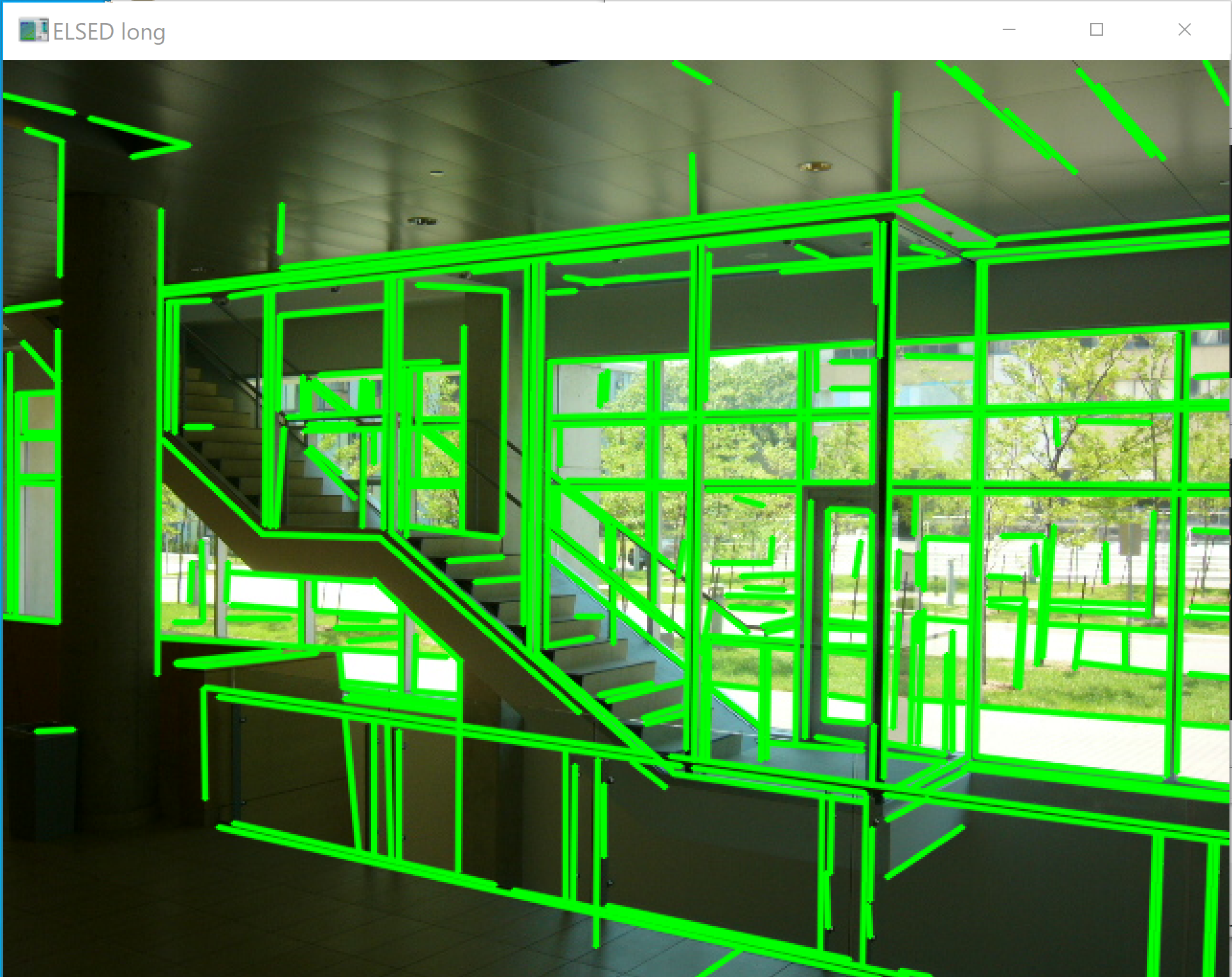

ELSED

【文献】

Iago Suárez and José M. Buenaposada and Luis Baumela, ELSED: Enhanced Line SEgment Drawing, Pattern Recognition, vol. 127, pages 108619, arXiv:2108.03144, 2022. doi: https://doi.org/10.1016/j.patcog.2022.108619.

arXiv: https://arxiv.org/abs/2108.03144

https://arxiv.org/pdf/2108.03144.pdf

【サイト内の関連ページ】

ELSED のインストールと動作確認(線分検知)(Build Tools, Python を使用)(Windows 上)

【関連する外部ページ】

- ELSED の GitHub のページ: https://github.com/iago-suarez/ELSED

- Google Colab のデモ: https://colab.research.google.com/github/iago-suarez/ELSED/blob/main/Python_ELSED.ipynb

- Papers with Code のページ: https://paperswithcode.com/paper/elsed-enhanced-line-segment-drawing

【関連項目】 線分検知

Emotion-Investigator

SanjayMarreddi の Emotion-Investigator は,顔検出 (face detection)と,Happy, Sad, Disgust, Neutral, Fear, Angry, Surprise の表情推定を行う.

【サイト内の関連ページ】

- 顔検出と表情推定(SanjayMarreddi/Emotion-Investigator,Python,TensorFlow を使用)(Windows 上): 別ページ »で説明している.

【関連する外部ページ】

- SanjayMarreddi/Emotion-Investigator の GitHub の公式ページ: https://github.com/SanjayMarreddi/Emotion-Investigator

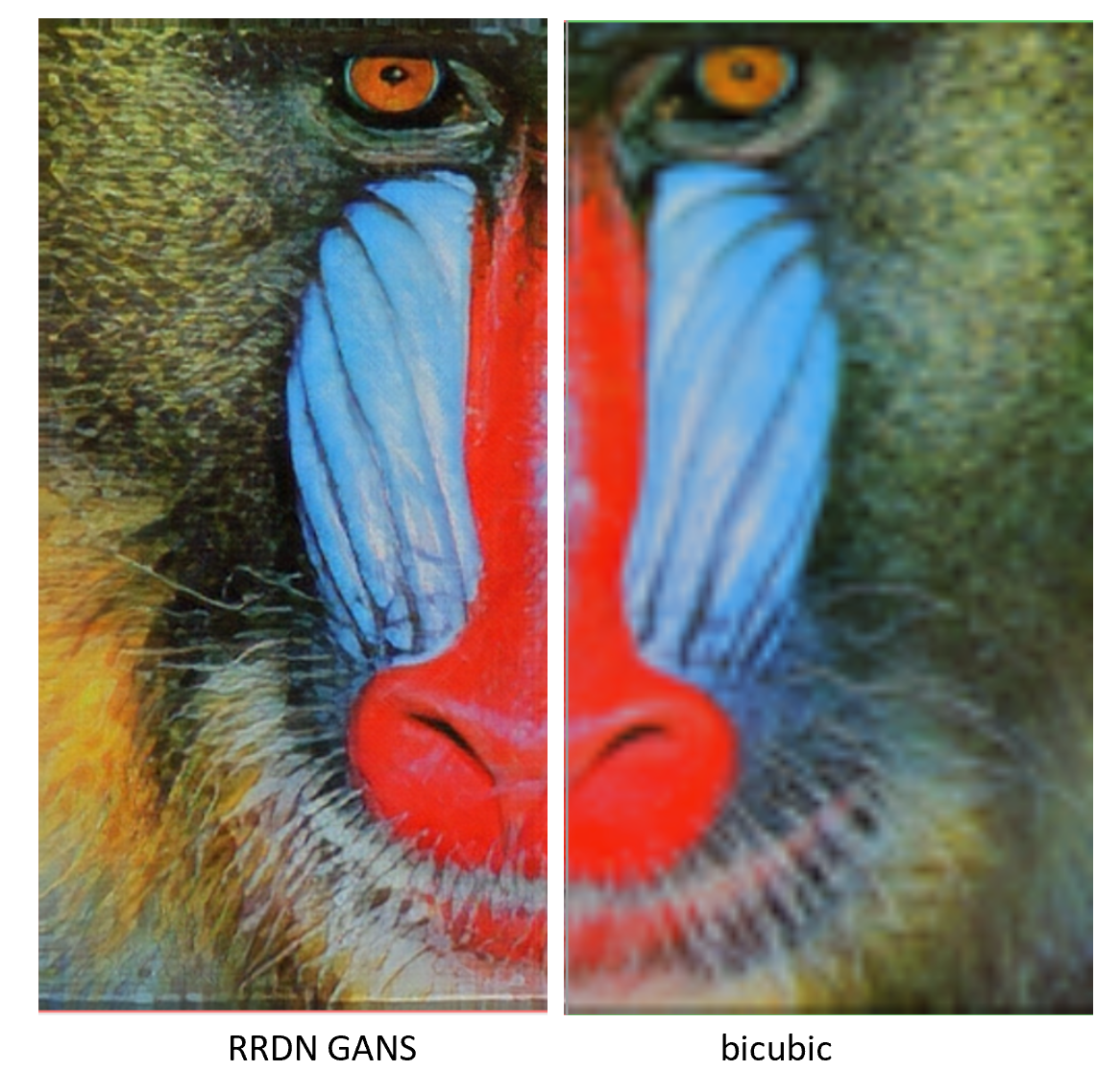

ESRGAN

超解像 (super resolution) の一手法.2018 年発表.

- 文献

Wang, Xintao and Yu, Ke and Wu, Shixiang and Gu, Jinjin and Liu, Yihao and Dong, Chao and Qiao, Yu and Loy, Chen Change, ESRGAN: Enhanced super-resolution generative adversarial networks, The European Conference on Computer Vision Workshops (ECCVW), 2018.

- 公式のソースコード: https://github.com/xinntao/ESRGAN

- Papers with Code のページ: https://paperswithcode.com/paper/esrgan-enhanced-super-resolution-generative

- 超解像に関する Google Colaboratory のノートブック: https://colab.research.google.com/github/AwaleSajil/ISR_simplified/blob/master/ISR_simplified(youtube).ipynb#scrollTo=yn2qU_Gstb12

【関連項目】 GAN (Generative Adversarial Network), image super resolution, video super resolution, 超解像 (super resolution)

FaceForensics++ データセット

FaceForensics++ データセットは,自動合成された顔画像のデータセットである.

- FaceForensics++ は,977本の YouTube 動画を使用.Deepfakes, Face2Face, FaceSwap and NeuralTextures を用いて顔データを操作し,1000 個の動画を作成したものである.

- 動画は,オクルージョンのない,ほぼ正面の顔を含むように選択されている.

FaceForensics++ データセットは,次の URL で公開されているデータセット(オープンデータ)である.

URL: https://github.com/ondyari/FaceForensics

【関連情報】

- FaceForensics++: Learning to Detect Manipulated Facial Images, Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Riess, Justus Thies, Matthias Nießner

- Papers With Code の FaceForensics++ データセットのページ: https://paperswithcode.com/dataset/faceforensics-1

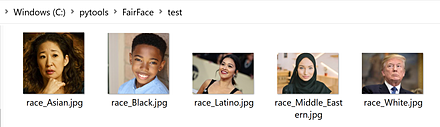

FairFace (Face Attribute Dataset for Balanced Race, Gender, and Age)

性別,年齢,人種に関するバイアス (bias) 等の問題がないとされる顔データセットが発表された.2021年発表. 顔の性別,年齢等の予測の精度向上ができるとされている.

- Karkkainen, Kimmo and Joo, Jungseock, FairFace: Face Attribute Dataset for Balanced Race, Gender, and Age for Bias Measurement and Mitigation, Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision, pp. 1548-1558, 2021

- GitHub のページ: https://github.com/dchen236/FairFace

【関連項目】 Dlib, 顔のデータベース, 顔ランドマーク (facial landmark), 顔の性別,年齢等の予測

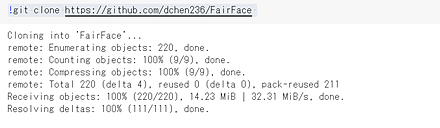

Google Colaboratory での FairFace デモプログラムの実行

顔の性別,年齢等の予測を行う.

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- Google Colaboratory で,ランタイムのタイプを GPU に設定する.

- ソースコード等のダウンロード

!git clone https://github.com/dchen236/FairFace

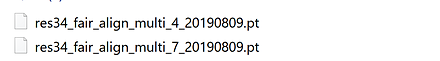

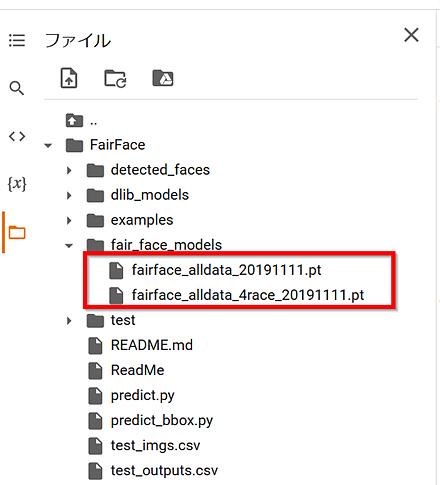

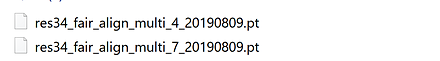

- 公式の GitHub のページの記載により,事前学習済みモデルをダウンロードする.

公式の GitHub のページ: https://github.com/dchen236/FairFace

2つのファイルをダウンロードする.

- いまダウンロードしたファイルについて.

Google Colaboratory で「fair_face_models」という名前のディレクトリを作る. そして,いまダウンロードしたファイルのファイル名を次のように変えて, 「fair_face_models」ディレクトリの下に置く. (ファイル名については,predict.py の中で指定されているファイル名にあわせる)

- 実行する.

%cd FairFace !python3 predict.py --csv test_imgs.csv

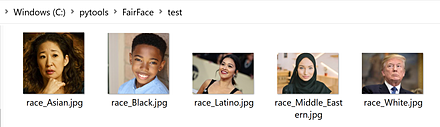

test_imgs.csv には,次の画像ファイルのファイル名が設定されている.

自前の画像で動作確認したいときは,画像ファイル名を書いた csv ファイルを準備する.

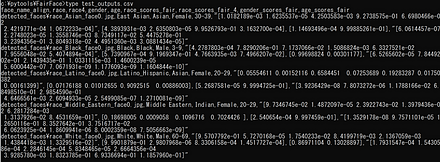

自前の画像で動作確認したいときは,画像ファイル名を書いた csv ファイルを準備する. - 実行結果の確認

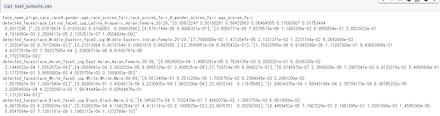

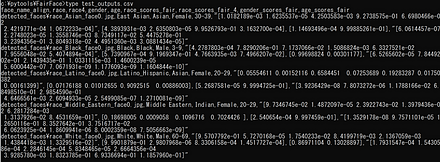

性別,年齢などが推定されている.

!cat test_outputs.csv

Windows での FairFace デモプログラムの実行

顔の性別,年齢等の予測を行う.

- 前準備として PyTorch, Dlib のインストール,Git のインストール(別項目で説明している)を行っておくこと.

Git の公式ページ: https://git-scm.com/

- ソースコード等のダウンロード

git clone https://github.com/dchen236/FairFace - 公式の GitHub のページの記載により,事前学習済みモデルをダウンロードする.

公式の GitHub のページ: https://github.com/dchen236/FairFace

2つのファイルをダウンロードする.

- いまダウンロードしたファイルについて.

「fair_face_models」という名前のディレクトリを作る. そして,いまダウンロードしたファイルのファイル名を次のように変えて, 「fair_face_models」ディレクトリの下に置く. (ファイル名については,predict.py の中で指定されているファイル名にあわせる)

- 実行する.

cd FairFace python predict.py --csv test_imgs.csv

test_imgs.csv には,次の画像ファイルのファイル名が設定されている.

自前の画像で動作確認したいときは,画像ファイル名を書いた csv ファイルを準備する.

自前の画像で動作確認したいときは,画像ファイル名を書いた csv ファイルを準備する. - 実行結果の確認

性別,年齢などが推定されている.

type test_outputs.csv

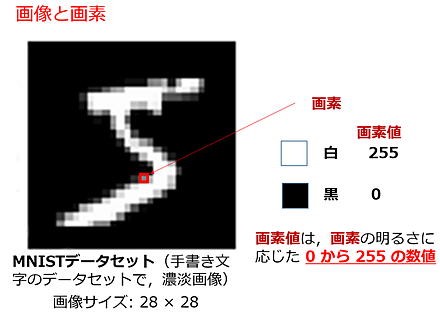

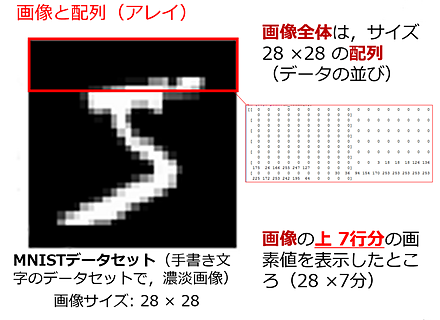

Fashion MNIST データセット

Fashion MNIST データセットは,公開されているデータセット(オープンデータ)である.

Fashion MNIST データセットは,10 種類のモノクロ画像と,各画像に付いたラベル(10 種類の中の種類を示す)から構成されるデータセットである.

- 画像の枚数:合計 70000枚.

(内訳)70000枚の内訳は次の通りである.

60000枚:教師データ

10000枚:検証データ

- 画像のサイズ: 28x28 である.

- ラベル

- 0: T-shirt/top

- 1: Trouser

- 2: Pullover

- 3: Dress

- 4: Coat

- 5: Sandal

- 6: Shirt

- 7: Sneaker

- 8: Bag

- 9: Ankle boot

- 画素はグレースケールであり,画素値は0~255である.0が白,255が黒.

【文献】

Han Xiao, Kashif Rasul, and Roland Vollgraf, Fashion-MNIST: a Novel Image Dataset for Benchmarking Machine Learning Algorithms, arXiv:1708.07747 [cs.LG], 2017.

【サイト内の関連ページ】

- Fashion MNIST データセットを扱う Python プログラム: 別ページ で説明している.

- Fashion MNIST データセットによる学習と分類(TensorFlow データセット,TensorFlow,Python を使用)(Windows 上,Google Colaboratory の両方を記載)

【関連する外部ページ】

- 公式ページ: https://github.com/zalandoresearch/fashion-mnist

- TensorFlow データセットの Fashion MNIST データセット: https://www.tensorflow.org/datasets/catalog/fashion_mnist

【関連項目】 Keras に付属のデータセット, MNIST データセット, TensorFlow データセット, オープンデータ, 画像分類

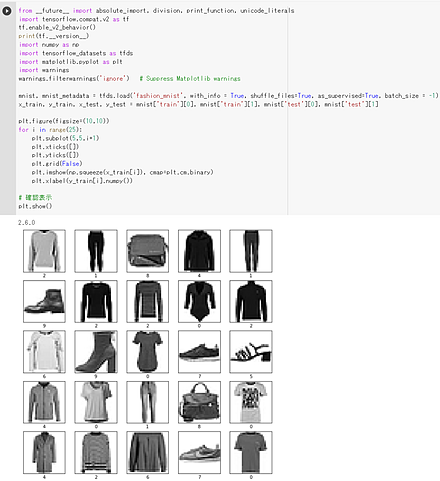

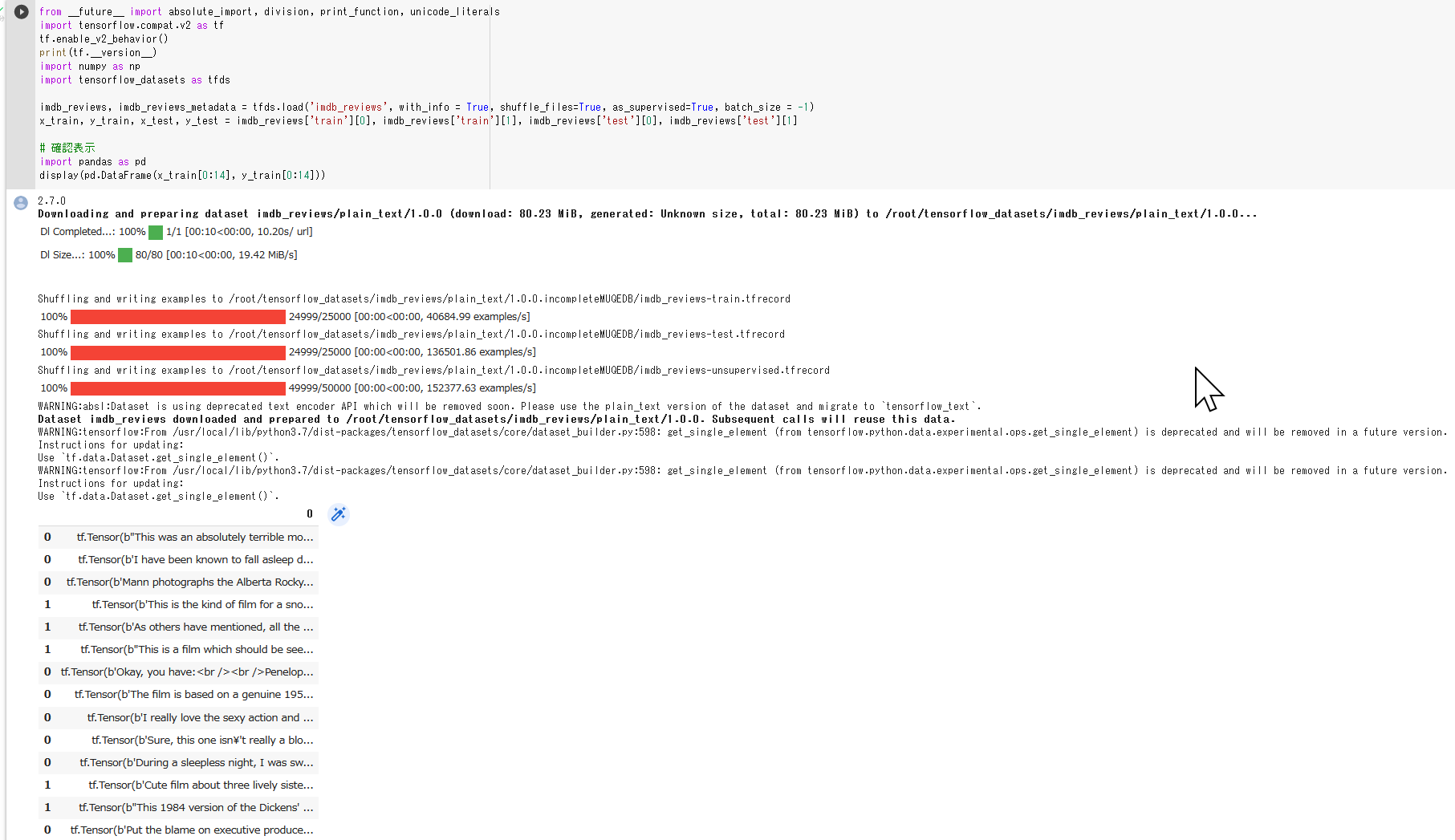

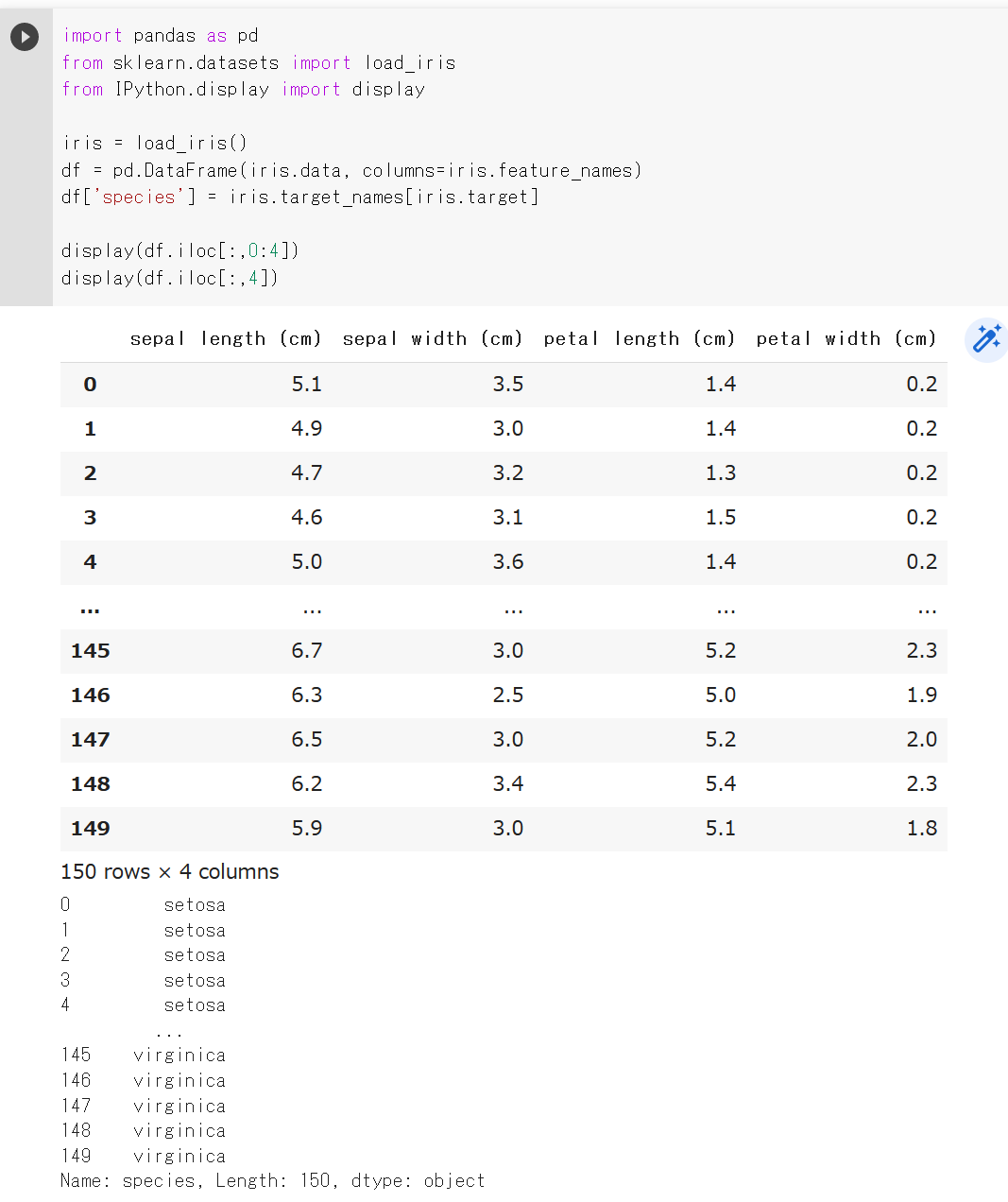

Python での Fashion MNIST データセットのロード(TensorFlow データセットを使用)

次の Python プログラムは,TensorFlow データセットから,Fashion MNIST データセットのロードを行う. x_train, y_train が学習用のデータ,x_test, y_test が検証用のデータになる.

- x_train: サイズ 28 × 28 の 60000枚の濃淡画像

- y_train: 60000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

- x_test: サイズ 28 × 28 の 10000枚の濃淡画像

- y_test: 10000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

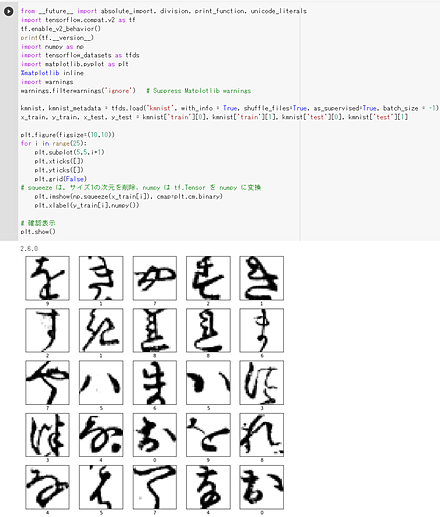

次の Python プログラムでは,TensorFlow データセットから,Fashion MNIST データセットのロードを行う. x_train と y_train を 25枚分表示することにより,x_train と y_train が,モノクロ画像であることが確認できる.

tensorflow_datasets の loadで, 「batch_size = -1」を指定して,一括読み込みを行っている.

from __future__ import absolute_import, division, print_function, unicode_literals

import tensorflow as tf

import numpy as np

import tensorflow_datasets as tfds

%matplotlib inline

import matplotlib.pyplot as plt

import warnings

warnings.filterwarnings('ignore') # Suppress Matplotlib warnings

# Fashion MNIST データセットのロード

fashion_mnist, fashion_mnist_metadata = tfds.load('fashion_mnist', with_info = True, shuffle_files=True, as_supervised=True, batch_size = -1)

x_train, y_train, x_test, y_test = fashion_mnist['train'][0], fashion_mnist['train'][1], fashion_mnist['test'][0], fashion_mnist['test'][1]

plt.style.use('default')

plt.figure(figsize=(10,10))

for i in range(25):

plt.subplot(5,5,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

# squeeze は,サイズ1の次元を削除.numpy は tf.Tensor を numpy に変換

plt.imshow(np.squeeze(x_train[i]), cmap=plt.cm.binary)

plt.xlabel(y_train[i].numpy())

# 確認表示

plt.show()

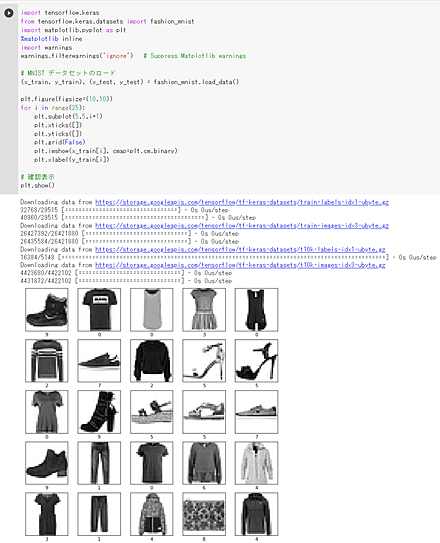

Python での Fashion MNIST データセットのロード(Keras を使用)

次の Python プログラムは,Keras に付属のデータセットの中にある Fashion MNIST データセットのロードを行う. x_train, y_train が学習用のデータ,x_test, y_test が検証用のデータになる.

- x_train: サイズ 28 × 28 の 60000枚の濃淡画像

- y_train: 60000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

- x_test: サイズ 28 × 28 の 10000枚の濃淡画像

- y_test: 10000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

from tensorflow.keras.datasets import fashion_mnist

(x_train, y_train), (x_test, y_test) = fashion_mnist.load_data()

次の Python プログラムは,Keras に付属のデータセットの中にある Fashion MNIST データセットのロードを行う. x_train と y_train を 25枚分表示することにより,x_train と y_train が,モノクロ画像であることが確認できる.

import tensorflow.keras

from tensorflow.keras.datasets import fashion_mnist

%matplotlib inline

import matplotlib.pyplot as plt

import warnings

warnings.filterwarnings('ignore') # Suppress Matplotlib warnings

# Fashion MNIST データセットのロード

(x_train, y_train), (x_test, y_test) = fashion_mnist.load_data()

plt.style.use('default')

plt.figure(figsize=(10,10))

for i in range(25):

plt.subplot(5,5,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(x_train[i], cmap=plt.cm.binary)

plt.xlabel(y_train[i])

# 確認表示

plt.show()

TensorFlow データセットからのロード,学習のための前処理

【TensorFlow データセット から Fashion MNIST データセット をロード】

- x_train: サイズ 28 × 28 の 60000枚の濃淡画像

- y_train: 60000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

- x_test: サイズ 28 × 28 の 10000枚の濃淡画像

- y_test: 10000枚の濃淡画像それぞれの,種類番号(0 から 9 のどれか)

結果は,TensorFlow の Tensor である.

type は型,shape はサイズ,np.max と np.min は最大値と最小値である.

tensorflow_datasets の loadで, 「batch_size = -1」を指定して,一括読み込みを行っている.

from __future__ import absolute_import, division, print_function, unicode_literals

import tensorflow as tf

import numpy as np

import tensorflow_datasets as tfds

%matplotlib inline

import matplotlib.pyplot as plt

import warnings

warnings.filterwarnings('ignore') # Suppress Matplotlib warnings

# Fashion MNIST データセットのロード

fashion_mnist, fashion_mnist_metadata = tfds.load('fashion_mnist', with_info = True, shuffle_files=True, as_supervised=True, batch_size = -1)

x_train, y_train, x_test, y_test = fashion_mnist['train'][0], fashion_mnist['train'][1], fashion_mnist['test'][0], fashion_mnist['test'][1]

print(fashion_mnist_metadata)

# 【x_train, x_test, y_train, y_test の numpy ndarray への変換と,値の範囲の調整(値の範囲が 0 〜 255 であるのを,0 〜 1 に調整)】

x_train = x_train.numpy().astype("float32") / 255.0

x_test = x_test.numpy().astype("float32") / 255.0

y_train = y_train.numpy()

y_test = y_test.numpy()

print(type(x_train), x_train.shape, np.max(x_train), np.min(x_train))

print(type(x_test), x_test.shape, np.max(x_test), np.min(x_test))

print(type(y_train), y_train.shape, np.max(y_train), np.min(y_train))

print(type(y_test), y_test.shape, np.max(y_test), np.min(y_test))

Fast-Robust-ICP

ICP の一手法である.

Fast-Robust-ICP のページ(GitHub): https://github.com/yaoyx689/Fast-Robust-ICP

【関連項目】 K 近傍探索 (K nearest neighbour), ICP

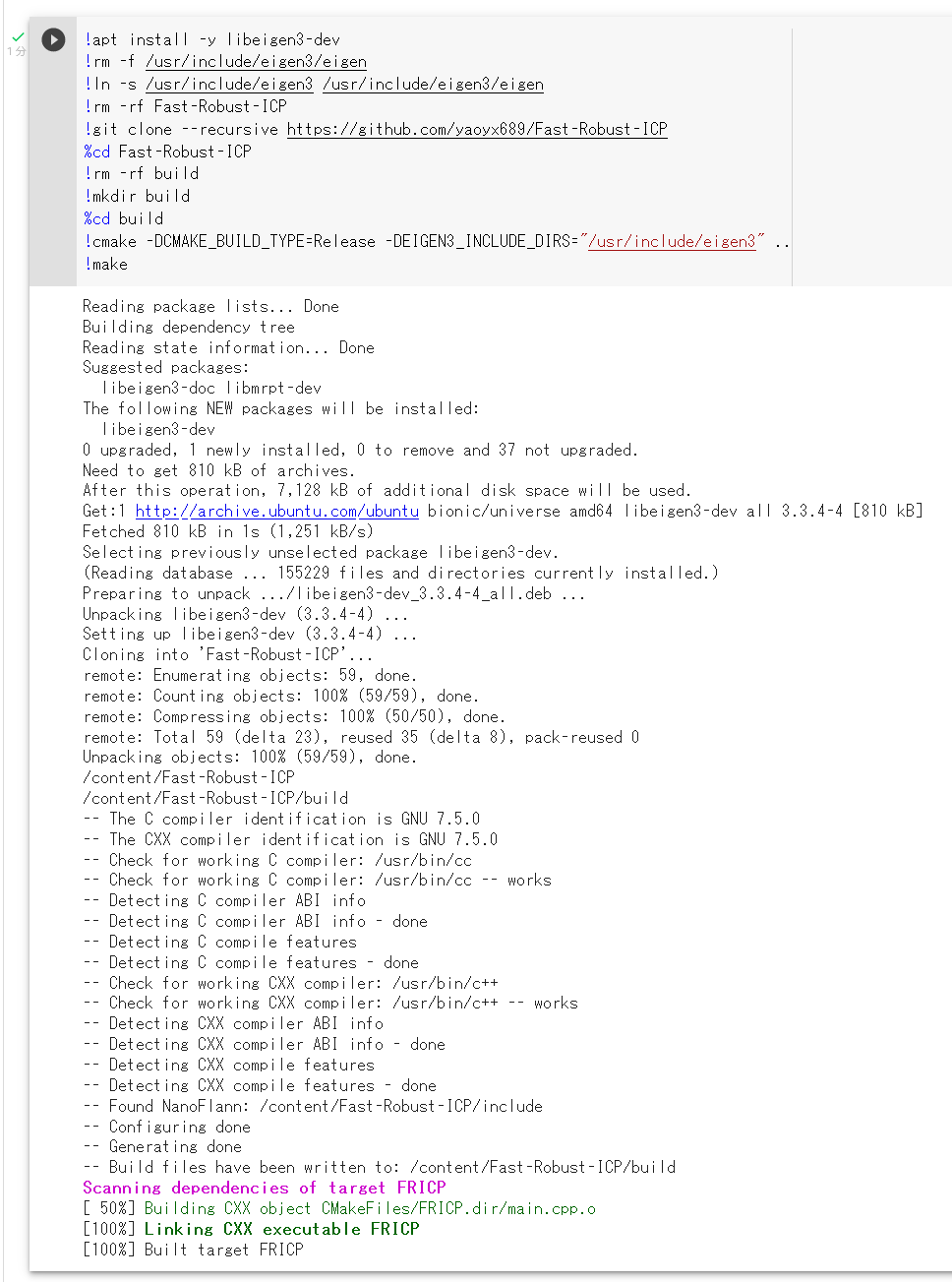

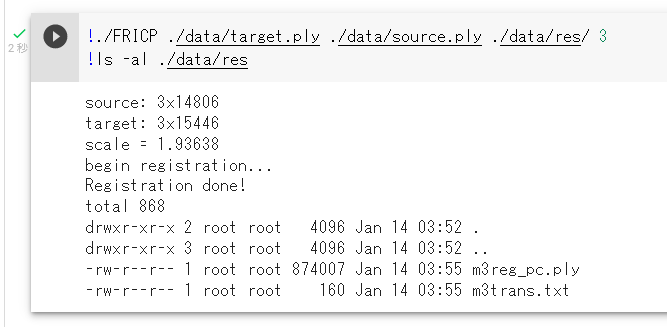

Google Colaboratory で,Fast-Robust-ICP の実行

次のコマンドやプログラムは Google Colaboratory で動く(コードセルを作り,実行する).

- インストール

- Fast-Robust-ICP の実行

実行でのオプションについては,Fast-Robust-ICP のページ(GitHub): https://github.com/yaoyx689/Fast-Robust-ICP を参照のこと.

Windows での Fast-Robust-ICP のインストール

ソースコードからビルドする.

- Windows では,前準備として次を行う.

- Build Tools for Visual Studio 2022 のインストール(別項目で説明している).

- Git のインストール(別項目で説明している).

Git の公式ページ: https://git-scm.com/

- cmake のインストール(別項目で説明している).

CMake の公式ダウンロードページ: https://cmake.org/download/

- Eigen 3 のインストール

-

コマンドプロンプトを管理者として開き次のコマンドを実行する.

c:\Fast-Robust-ICP にインストールされる.

cd /d c:%HOMEPATH% rmdir /s /q Fast-Robust-ICP git clone --recursive https://github.com/yaoyx689/Fast-Robust-ICP cd Fast-Robust-ICP rmdir /s /q build mkdir build cd build del CMakeCache.txt rmdir /s /q CMakeFiles cmake -A x64 -T host=x64 ^ -DCMAKE_INSTALL_PREFIX="c:/Fast-Robust-ICP" ^ -DEIGEN3_INCLUDE_DIRS="c:/eigen/include;c:/eigen/include/eigen3" ^ .. mklink c:\eigen\include\eigen c:\eigen\include\eigen3 cmake --build . --config Release del c:\eigen\include\eigen

FERET データベース

FERET データベースは顔のデータベースである.詳細情報は,次の Web ページにある.

https://www.nist.gov/itl/products-and-services/color-feret-database

【関連項目】 顔のデータベース

FFHQ (Flickr-Faces-HQ) データセット

FFHQ (Flickr-Faces-HQ) データセット は,70,000枚の顔画像データセットである. 機械学習による顔の生成などの学習や検証に利用できるデータセットである.

- サイズ 1024×1024,70,000枚の画像

- 年齢,民族,画像背景はさまざま

- 眼鏡,サングラス,帽子などもさまざま

- Flickr から取得.位置合わせとトリミング済み(Dlib を使用),画像の選別, 顔の彫刻や顔の絵画や顔の写真を除去(Amazon Mechanical Turk を使用)

FFHQ (Flickr-Faces-HQ) データセットは次の URL で公開されているデータセット(オープンデータ)である.

URL: https://github.com/NVlabs/ffhq-dataset

【関連情報】

- 文献

A Style-Based Generator Architecture for Generative Adversarial Networks, Tero Karras (NVIDIA), Samuli Laine (NVIDIA), Timo Aila (NVIDIA), CoRR, abs/1812.04948

- Papers With Code の FFHQ データセットのページ: https://paperswithcode.com/dataset/ffhq

【関連項目】 顔のデータベース

FIDTM (FIDT map)

FIDTM (Focal Inverse Distance Transform Map) は, crowd counting の一手法である.2021年発表.

従来の density maps での課題を解決し,従来法よりも精度が上回るとされる. FIDT map を用いて頭部を得る LMDS もあわせて提案されている.

- 文献

Focal Inverse Distance Transform Maps for Crowd Localization and Counting in Dense Crowd, Liang, Dingkang and Xu, Wei and Zhu, Yingying and Zhou, Yu, arXiv preprint arXiv:2102.07925, 2021.

- FIDTM の公式のソースコード

- NWPU-Crowd データセットのダウンロード URL: https://drive.google.com/file/d/1drjYZW7hp6bQI39u7ffPYwt4Kno9cLu8/view

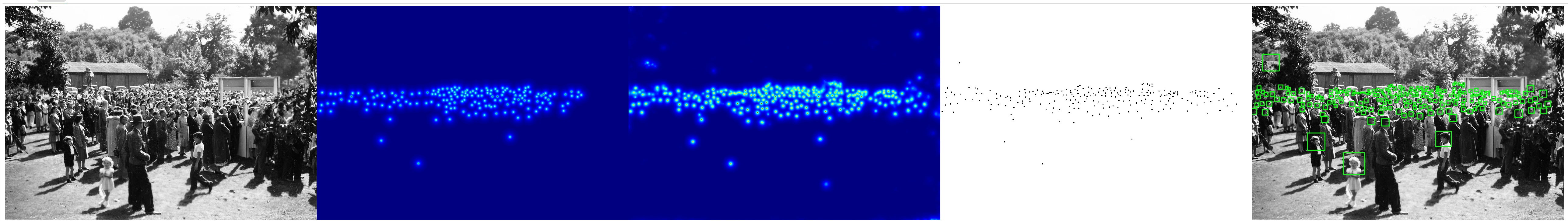

crowd counting の結果の例

- Google Colaboratory のページ

群衆の数のカウントと位置の把握 (crowd counting) (FIDTM を使用)

このページでは,FIDTMの作者による公式のプログラムおよび学習済みモデルを使用して,群衆の数のカウントと位置の把握 (crowd counting) を行う手順を示している.

手順は,FIDTM 公式ページの説明通りに進める.このページでは,Google Colaboratory で簡単に実行できるように,いくつかのコマンドを補っている.説明も補っている.

【関連項目】 crowd counting, JHU-CROWD++ データセット, NWPU-Crowd データセット, ShanghaiTech データセット, UCF-QNRF データセット

fine tuning (ファイン・チューニング)

学習済みモデルを使用する. 学習済みモデルの一部に新しいモデルを合わせた上で,追加のデータを使い学習を行う. このとき,学習済みモデルの部分と,新しいモデルの部分の両方について,パラメータ(重みなど)の調整を行う.

【関連項目】 画像分類 (image classification), 分類, 物体検出

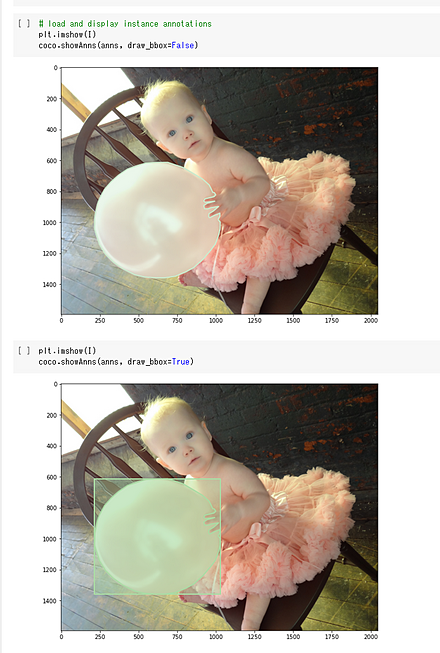

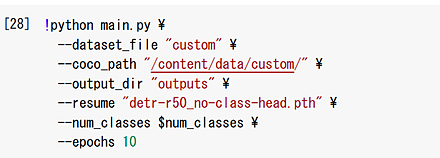

画像分類のモデル DETR でのファイン・チューニング(woctezuma の Google Colaboratory のページを使用)

woctezuma の Google Colaboratory のページを使用する.

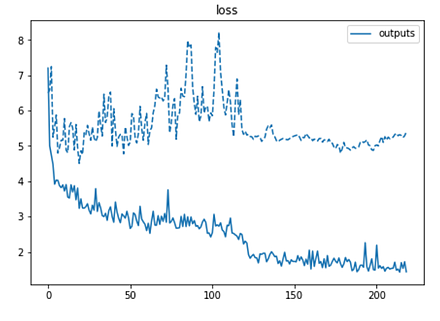

このプログラムは,物体検出等の機能を持つモデルである DETR を使い, fine tuning (ファイン・チューニング)と,物体検出を行う.

COCO データセットで学習済みの DETR について,確認のため, 物体検出を行ったあと, 風船(balloon)についてのfine tuning (ファイン・チューニング)を行い, 風船(balloon)が検出できるようにしている. 風船(balloon)は,COCO データセット には無い.

- woctezuma の Google Colaboratory のページを開く.

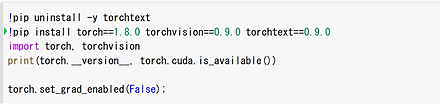

- torch 1.8.0, torchvision 0.9.0, torchtext 0.9.0 を使うように書き換える.

!pip3 uninstall -y torchtext !pip3 install torch==1.8.0 torchvision==0.9.0 torchtext==0.9.0 import torch, torchvision print(torch.__version__, torch.cuda.is_available()) torch.set_grad_enabled(False);

- ソースコードの要点を確認する.

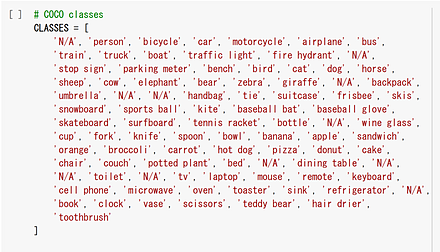

COCO データセットのクラス名を確認する.

orange, apple, banana, dog, person などがある.balloon は無い.

detr_resnet50 の事前学習済みのモデルをダウンロードしている.

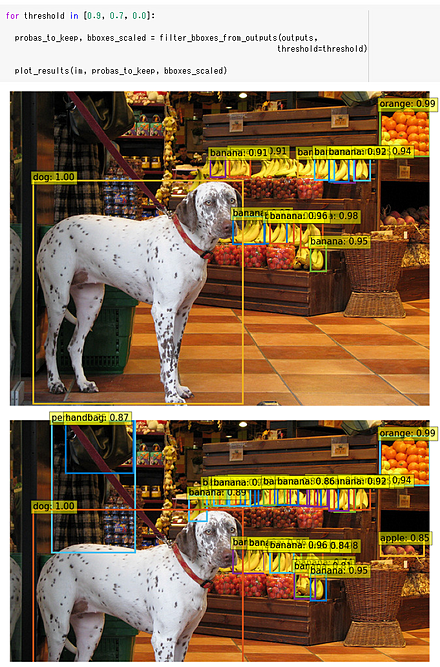

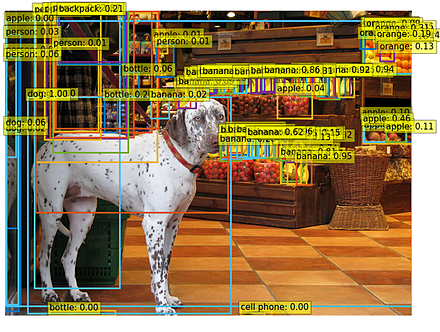

しきい値 0.9, 0.7, 0.0 の 3 通りで実行.しきい値を下げるほど,検出できる物体は増えるが,誤検知も増える傾向にある.

fine tuning を行うため,風船 (balloon) の画像,そして,風船の領域を示した情報(輪郭線,包含矩形)の情報を使う. 画像は複数.そのうち1枚は次の通りである.

過学習は起きていないようである.

fine tuning により,風船(balloon)を検出できるようになった. しきい値は 0.9, 0.7 の 2通りである.

- 自前のデータで fine tuning を行いたいときは,このページの説明通り,COCO データのフォーマットでデータを準備する.

そのフォーマットは,/content/data/custom (Google Colaboratory の data/custom の下のファイル)が参考になる.

自前のデータが準備できたら,Google Colaboratory にアップロードし, 次のコードセルの「/content/data/custom」のところを書き換えて,再度実行する.

画像ファイルをアップロードし,プログラムは次のように書き換える.

fname = '/content/5m126sn2pov30qzu3pc49lampcp6.jpg'

im = Image.open(fname)

scores, boxes = detect(im, detr, transform)

URL: https://github.com/woctezuma/finetune-detr

FlexGen

FlexGen は,大規模言語モデル (large language model) を用いた推論で必要とされる計算とメモリの要求を削減する技術である. 実験では,大規模言語モデル OPT を,16GB の単一 GPU で実行したとき 100倍以上の高速化が可能であるとされている.

【文献】

Ying Sheng, Lianmin Zheng, Binhang Yuan, Zhuohan Li, Max Ryabinin, Beidi Chen, Percy Liang, Ce Zhang, Ion Stoica, Christopher Ré, High-throughput Generative Inference of Large Language Model with a Single GPU, 2023.

【サイト内の関連ページ】

- FlexGen のインストールと動作確認(大規模言語モデル,チャットボット)(Python,PyTorch を使用)(Windows 上): 別ページ »で説明している.

- Meta の言語モデルと日本語で対話できる chatBOT プログラム(chatBOT)(FlexGen, DeepL, Python を使用)(Windows 上): 別ページ »で説明している.

- 対話システム,chatBOT: PDFファイル, パワーポイントファイル

【関連する外部ページ】

FlexGen の GitHub のページ: https://github.com/FMInference/FlexGen

【関連項目】 OPT

FLIC (Frames Labeled In Cinema)データセット

FLIC は, 5003枚の画像(訓練データ: 3987枚,検証データ: 1016枚)で構成されている. 画像の上半身についてアノテーションが行われている. ほとんどの人物がカメラ正面を向いている.

ディープラーニングにより姿勢推定を行うためのデータとして利用できる.

次の URL で公開されているデータセット(オープンデータ)である.

http://bensapp.github.io/flic-dataset.html

【関連情報】

- 文献

Sapp, B., Taskar, B.: Modec: Multimodal decomposable models for human pose estimation. In: Computer Vision and Pattern Recognition (CVPR), 2013 IEEE Conference on, IEEE (2013) 3674-3681, https://www.cv-foundation.org/openaccess/content_cvpr_2013/papers/Sapp_MODEC_Multimodal_Decomposable_2013_CVPR_paper.pdf

- Papers With Code の FLIC データセットのページ: https://paperswithcode.com/dataset/flic

- TensorFlow データセットの FLIC データセット: https://www.tensorflow.org/datasets/catalog/flic

FordA データセット

FordA データセットは,時系列データである.

FordA データセットは,公開されているデータセット(オープンデータ)である.

URL: http://www.timeseriesclassification.com/description.php?Dataset=FordA

教師データ数:3601

テストデータ数: 1320

モーターセンサーにより計測されたエンジンノイズの計測値である.

FSDnoisy18k データセット

20種類, 約 42.5 時間分のサウンドである.

次の URL で公開されているデータセット(オープンデータ)である.

http://www.eduardofonseca.net/FSDnoisy18k/

- 文献

Eduardo Fonseca, Manoj Plakal, Daniel P. W. Ellis, Frederic Font, Xavier Favory, and Xavier Serra, "Learning Sound Event Classifiers from Web Audio with Noisy Labels", arXiv preprint arXiv:1901.01189, 2019

【関連項目】 sound data

F 検定 (F test)

帰無仮説: 正規分布に従う2群の標準偏差が等しい. F 検定を,t 検定を行う前の等分散性の検定に使うのは正しくないという指摘もある.

var.test(s1, s2)

【関連項目】 検定

GAN (generative adversarial network)

GAN (Generative Adversarial Network) では, 生成器 (generator) でデータを生成し, 識別器 (discriminator) で,生成されたデータが正当か正当でないかを識別する.

- 文献

Ian J. Goodfellow, Jean Pouget-Abadie, Mehdi Mirza, Bing Xu, David Warde-Farley, Sherjil Ozair, Aaron Courville, Yoshua Bengio, Generative Adversarial Networks, Proceedings of the 27th International Conference on Neural Information Processing Systems 2014

- PyTorch-GAN のページ: https://github.com/eriklindernoren/PyTorch-GAN

- Keras-GAN のページ: https://github.com/eriklindernoren/Keras-GAN

- labmlai/annotated_deep_learning_paper_implementations のページ: https://github.com/labmlai/annotated_deep_learning_paper_implementations

【関連項目】 Applications of Deep Neural Networks, Real-ESRGAN, TecoGAN, Wasserstein GAN (WGAN), Wasserstein GAN with Gradient Penalty (WGAN-GP), ディープラーニング

GlueStick

GlueStick 法はイメージ・マッチングの一手法である.2023年発表. 線分を使ったイメージ・マッチングは,照明条件や視点の変化,テクスチャのない領域でもマッチングできるメリットがある. GlueStick 法は,点と線分の両方を利用してイメージ・マッチングを行う. その際に CNN を利用している.

【文献】

Rémi Pautrat, Iago Suárez, Yifan Yu, Marc Pollefeys, Viktor Larsson, GlueStick: Robust Image Matching by Sticking Points and Lines Together, ArXiv, 2023.

https://arxiv.org/pdf/2304.02008v1.pdf

【関連する外部ページ】

- GlueStick の GitHub のページ: https://github.com/cvg/GlueStick

- Google Colab のデモ: https://colab.research.google.com/github/cvg/GlueStick/blob/main/gluestick_matching_demo.ipynb

- Papers with Code のページ: https://paperswithcode.com/paper/gluestick-robust-image-matching-by-sticking

GNN (グラフニューラルネットワーク)

GNN は,グラフ構造を持つデータを用いた学習を可能とする技術である.

【関連項目】 PyTorch Geometric Temporal

He の初期値

He らの方法 (2015年) では,前層のユニット数(ニューロン数)を n とするとき, sqrt( 2 / n ) を標準偏差とする正規分布に初期化する. ただし,この方法は ReLU に特化した手法であるとされている. この方法を使うとき,層の入力は,正規化済みであること.

Kaiming He, Xiangyu Zhang, Shaoqing Ren and Jian Sun, Delving Deep into Rectifiers: Surpassing Human-Level Performance on ImageNet Classification, pp. 1026-1034.

HELEN データセット

HELENデータセットは,顔画像と,顔のパーツの輪郭のデータセットである.

- 400×400 画素の顔画像2330枚

- 目,眉,鼻,唇,顎の輪郭を手動で作成.輪郭は,194個の顔ランドマークで扱う.

次の URL で公開されているデータセット(オープンデータ)である.

http://www.ifp.illinois.edu/~vuongle2/helen/

【関連情報】